Command Palette

Search for a command to run...

Pulco Chemical の大型モデル ChemLLM-7B のワンクリック導入 - チャット デモ

チュートリアルの紹介

このチュートリアルは、ChemLLM-7B-Chat のワンクリック展開デモです。コンテナを複製して起動し、生成された API アドレスを直接コピーするだけで、モデル上の推論を体験できます。

ChemLLM-7B-Chatは、上海人工知能研究所(上海AIラボ)が2024年にリリースした化学・分子科学向け初のオープンソース大規模言語モデル「ChemLLM」であり、InternLM-2を基盤としています。関連研究論文には以下が含まれます… ChemLLM: 化学大規模言語モデル 。

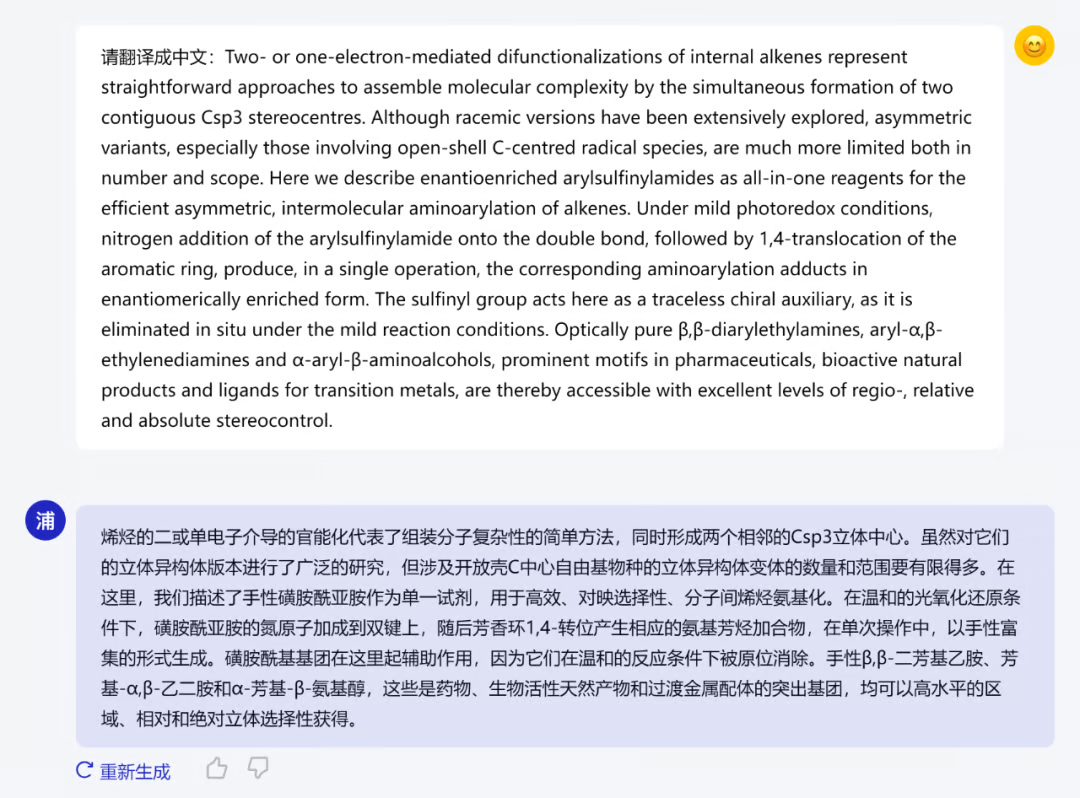

Puke Chemical は、Scholar Puyu 2.0 基本モデルの優れた多言語機能を利用して、専門的な化学知識のトレーニングを受けた後、化学における優れた中国語と英語の翻訳機能も備えています。これにより、化学研究者は言語の壁を克服し、化学分野の固有名詞を正確に翻訳できます。より多くの化学知識を習得するための化学文献。

さらに、研究チームはオープンソース化も行っています。 ChemData700K データ セット、ChemPref-10K 中国語および英語版データ セット、C-MHChem データ セットそして ChemBench4K 化学能力評価ベンチマーク データ セット。

以下の図は、2024 年 1 月 16 日にジャーナル「Nature Chemistry」に掲載され、PUCCO Chemicals が翻訳した論文の要約を示しています。

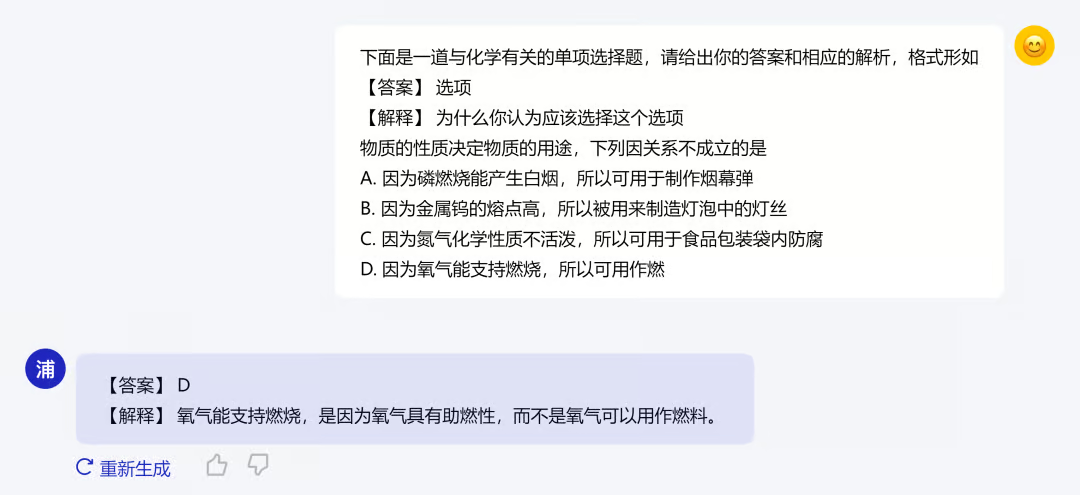

プコケミストリーでは、専門的な化学知識の研修に加え、中学・高校の知識の学習も行っています。中学や高校の化学の問題に答えるときは、単に答えるだけでなく、具体的な説明をすることもできます。次の図にその例を示します。

推論ステップをデプロイする

このチュートリアルでは、モデルと環境をデプロイしました。チュートリアルのガイドラインに従って、推論ダイアログに大規模なモデルを直接使用できます。具体的なチュートリアルは次のとおりです。

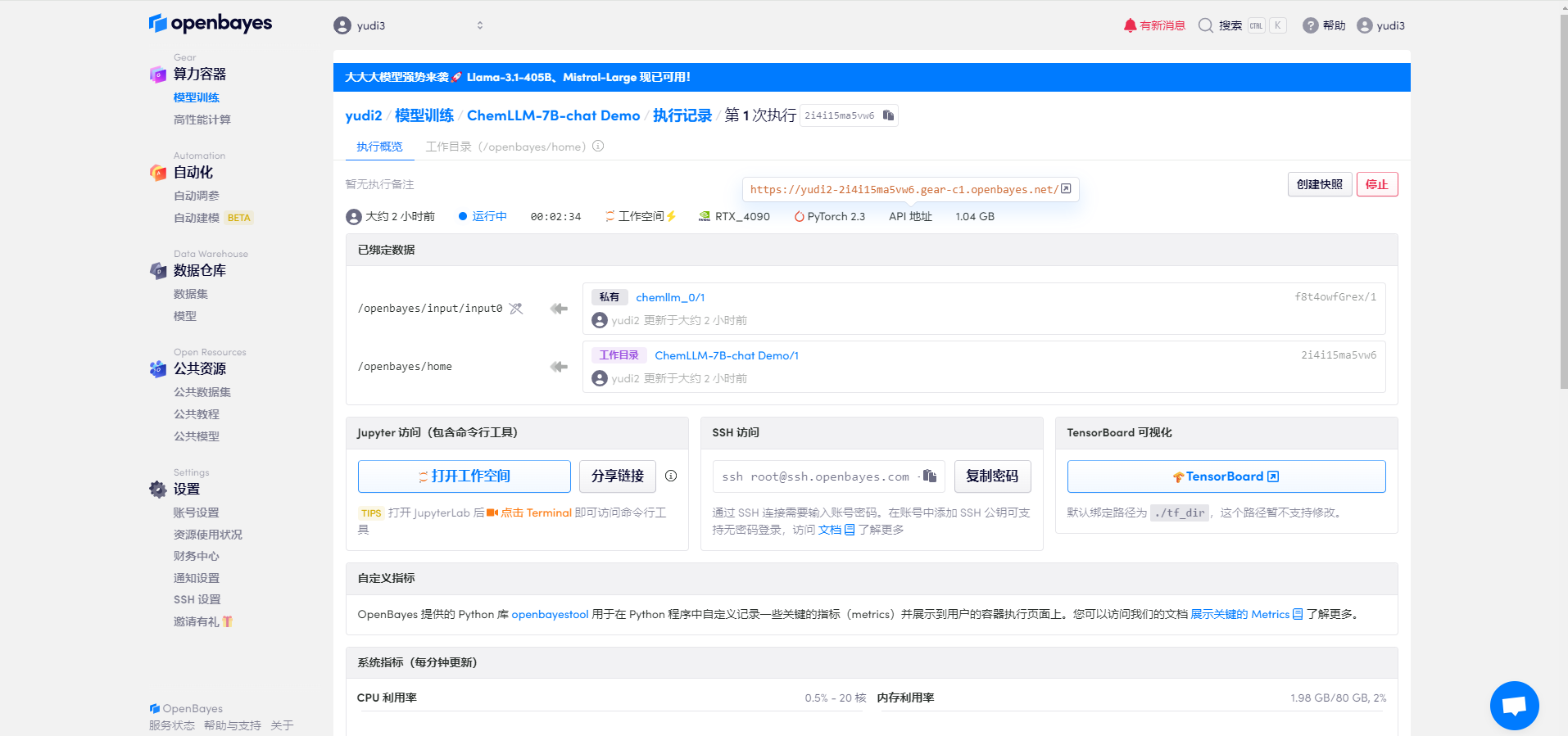

1. モデル構成

リソースが構成されたら、コンテナを起動し、API アドレスで接続をクリックしてデモ インターフェイスに入ります (コンテナが正常に起動した後にモデルをロードする必要があるため、Web が開くまでに約 30 分待つ必要があります)ページ)

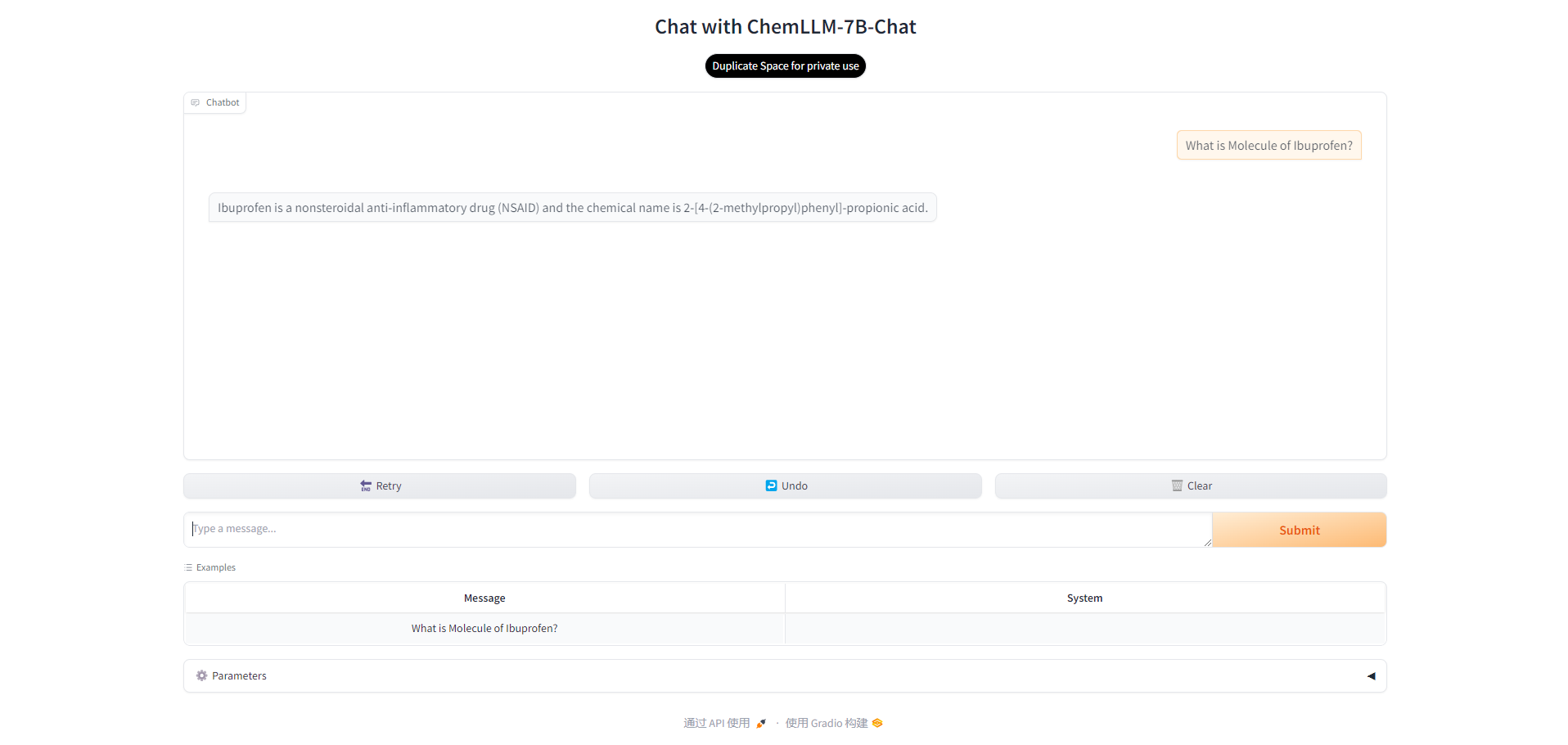

2.インターフェースを開きます

しばらくすると、モデルのインターフェイスが表示され、モデルと会話できるようになります。サンプルの質問を入力することも、質問したい質問を入力することもできます。

3.パラメータ調整

モデルには調整できるパラメータが多数あります。で:

- 温度: 生成されたテキストのランダム性を調整するために使用されます。値が低いほど、モデルによって生成されるテキストは最も高い確率で単語を選択する可能性が高く、値が高いほど、モデルがより低い確率で単語を探索する可能性が高くなります。生成されるテキストはより多様になりますが、より多くのエラーが含まれる可能性があります。

- 新しいトークンの最大数: テキストを生成するときにモデルが生成できる単語の最大数を指定します。生成される単語の数を制限することで、出力の長さを制御し、テキストが長すぎたり短すぎたりするのを防ぐことができます。

必要に応じてパラメータを調整できます。