Command Palette

Search for a command to run...

学際的なイノベーションは人間の能力をはるかに超えるのか?AI科学者は仮説を立て、実験を行い、トップレベルの会議で発表することで、科学研究の新たなパラダイムを切り開きます。

2024年8月、Transformer論文の著者の一人であるリオン・ジョーンズ氏が設立した企業、サカナAIが設立されました。世界初の「AIサイエンティスト」の誕生を発表した。研究アイデアの自動生成、実験の設計、コードの記述、実験の実行、そして論文執筆までを自律的に行い、「AIレビュアー」の支援を受けて結果を評価・改善することで、完全な閉ループ型科学研究エコシステムが形成されました。今年3月には、このシステムがコンピュータサイエンスの論文を作成しました…ICLR 2025 ワークショップで二重盲検レビューに合格しました。同時に、オートサイエンス研究所は、同研究所のAIシステム「Carl」が執筆した論文がICLRのTiny Papersトラックに採択されたことも発表した。

ある意味、これらの AI 科学者は研究室から抜け出し、徐々に人間の研究者に匹敵するレベルにまで到達しつつあります。

しかし、AIが科学的発見に焦点を合わせたとき、その結果は人類にとってほろ苦いものとなるかもしれない。一方では、データ処理と情報統合の効率性における AI の利点は、間違いなく AI が科学研究コミュニティに参入する鍵となり、人間の科学者がより高次元の思考と探究を行えるように解放します。一方で、ブラックボックスのジレンマは解決が難しく、解釈可能性に厳しい要件がある科学研究の分野には埋められないギャップが存在する。

では、AI科学者とは具体的にどのように定義されるのでしょうか?彼らの将来の展望や懸念事項は何でしょうか?

AI科学者:役割の再定義

伝統的な理解では、科学者は科学的探究の絶対的な中核を担う存在です。観察された現象から疑問を抽出し、既存の理論に基づいて仮説を立て、厳密な実験計画を立案し、自ら機器を操作してデータを取得し、分析と推論を通じて最終的に結論を導き出します。このプロセスは数百年にわたって継続され、人類の科学研究に対する基本的な理解を形作ってきました。

しかし、AI テクノロジーの爆発的な発展により、この伝統的な役割は解体されつつあります。

今日の科学研究の分野では、科学者の役割はますます明確になっています。大規模な言語モデルと特殊なアルゴリズムは、膨大な可能性を推測し、何億もの分子構造から候補となる解決策を選別する役割を担っています。自動化されたロボットと実験プラットフォームは、合成、観察、検出などの反復的な操作を正確に実行し、24時間365日稼働しています。一方、人間の科学者は、AIによって生成された結果を解釈し、その科学的重要性を判断し、探索の新しい方向性を提案するという、より中核的な価値の側面に重点を置いています。

DeepMindのCEO、デミス・ハサビス氏は、「AI科学者は現代版の顕微鏡や望遠鏡となり、人間には見えないパターンの発見を助けてくれるだろう」と考えている。これは、AIが単なる道具的役割を超え、研究プロセスの「加速器」から科学的推論と探究の「コミュニティメンバー」へと進化していることを意味する。

MITのレジーナ・バルジレイ教授はTEDトークの中でこの関係性についてさらに詳しく説明しました。「科学の未来は、AIが科学者に取って代わるものではなく、科学者がAIと協力することを選択するものになるでしょう。」彼女の見解では、AIと人間の科学者の関係は決してゼロサムゲームではなく、それぞれの強みに基づいた協働的な創造である。顕微鏡の発明が生物学者に取って代わったのではなく、細胞レベルでの生物学研究の新たな時代をもたらしたのと同様である。

2025年ノーベル化学賞受賞者、 「MOFの父」オマール・ムワンネス・ヤギ氏もAI科学者に信頼を寄せている。彼は率直にこう述べた。「AIは単に科学者を助けるものではなく、科学そのものに新しい考え方を与えるものなのです。」

現実世界の分類とAI科学者の進歩

実際、AI 科学者の重要性は、科学研究を「加速」させることをはるかに超えています。彼らは徐々に科学イノベーション システムの重要な役割を担うようになっています。

現在、世界中の多くの研究機関やテクノロジー企業が、独自の機能を備えたAIサイエンティストシステムの研究に競い合っています。これらのシステムは、機能的な位置付けに基づいて、強化された研究アシスタントと自律的な科学的発見者の2つのアプローチに大別できます。

最初のタイプのシステムの主な目標は、AI を人間の科学者にとっての「第二の脳」にすることです。つまり、人間が研究の方向性を主導するという前提のもと、インテリジェントエージェントは、学際的な知識の統合、実験的なアイデアの創出、データ分析などのサポートを提供する役割を担います。

スタンフォード大学のオンラインシステムであるバーチャルラボは、このアプローチの好例です。このシステムは、多様な専門分野を持つAI科学者チームを自動的に編成し、研究者のニーズに基づいて複雑な問題を共同で解決します。バーチャルラボの仮想共同チームには、「免疫学者」や「計算生物学者」などの役割が含まれており、ナノボディのための新しい計算設計フレームワークを提案し、人間の科学者による92個の抗ウイルスナノボディの設計を支援しました。

このようなシステムの出現により、科学研究の協力の境界が再形成されつつあります。科学研究はもはや単なる人々の間の協力ではなく、人々とインテリジェントエージェントとの深い共創にもなり得ます。

論文リンク:

https://www.nature.com/articles/s41586-025-09442-9

2 番目のタイプのシステムはより野心的で、科学的発見のための完全に自律的なエンジンの構築を目指しています。

これらのAI科学者はもはや人間の指導に頼るのではなく、複数のインテリジェントエージェントが連携して、問題の定式化と仮説生成から実験検証、論文執筆に至るまで、研究ループ全体を完了します。人間の科学者の役割は、マクロレベルの研究目標の設定、結果の検証、倫理審査の提供へと移行しています。

例えば、2025年5月、米国のAI研究機関Future Houseは、同社のマルチエージェントシステム「Robin」が、ドライ型黄斑変性症(失明の主な原因の一つ)の治療薬候補を自律的に発見したと発表した。作用機序はRNA実験によって検証されました。発表された論文に掲載されたすべての仮説、実験プロトコル、データ分析、データチャートはRobinによって完成され、反復的な実験サイクルの枠組みの中で新薬候補を自律的に発見・検証した初のAIシステムとなりました。

これは、AI 科学者が研究上の疑問を提起できるだけでなく、生命科学の極めて複雑な分野で臨床的に有望な発見をすることもできることを意味します。

企業ウェブサイト:https://www.futurehouse.org/

全体として、研究効率の向上を目指す「支援型」であれ、自律的な推論や実験設計を追求する「自律型」であれ、AI 科学者は概念から現実へと移行しつつあります。

現実のこうした急速な進歩こそが、AI が科学研究に真に参加したときに人間を上回るどのような利点をもたらすのかをより明確に観察することを可能にするのです。

利点: 画期的なスピード、規模の拡大、業界横断的なイノベーション

スピードの優位性:「何年もの研究」から「何時間もの検証」へ

長年にわたり、時間コストと研究開発サイクルの長期化は科学者を悩ませてきました。機器を継続的にアップグレードしても、飛躍的なスピードアップは困難です。材料科学では、新しい機能性化合物のスクリーニングと検証に数年かかることが多く、医薬品開発では、候補分子の前臨床最適化段階だけでも3~5年かかることがあります。この長期にわたるサイクルは、科学の進歩のペースを著しく制限しています。

AI科学者の出現により、この時間的制約は完全に打ち破られました。「モデル予測 – 実験検証 – データフィードバック – 反復最適化」という閉ループシステムを通じて、研究サイクルは元の長さのほんの一部、あるいはほんの一部にまで圧縮されます。サカナAIのシステムは、文献レビューから論文執筆までの全プロセスを数時間で完了できます。一方、Google DeepMindの「AI Co-Scientist」は、人間が何年もかけて解く問題をわずか2日で解決するという記録を樹立しました。インペリアル・カレッジ・ロンドンのホセ・ペナデス教授率いるチームが長年研究してきた種を超えたDNA伝播の謎は、このシステムによって正確に解明されました。その中核となる仮説は、チームの未発表の知見と完全に一致しており、付随する対立仮説も予備的な検証によって正しいことが示されています。

企業ウェブサイト:https://deepmind.google/

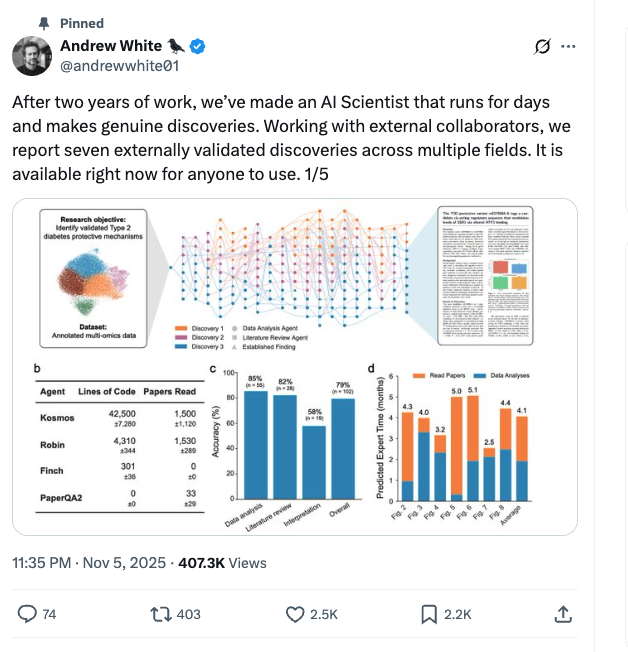

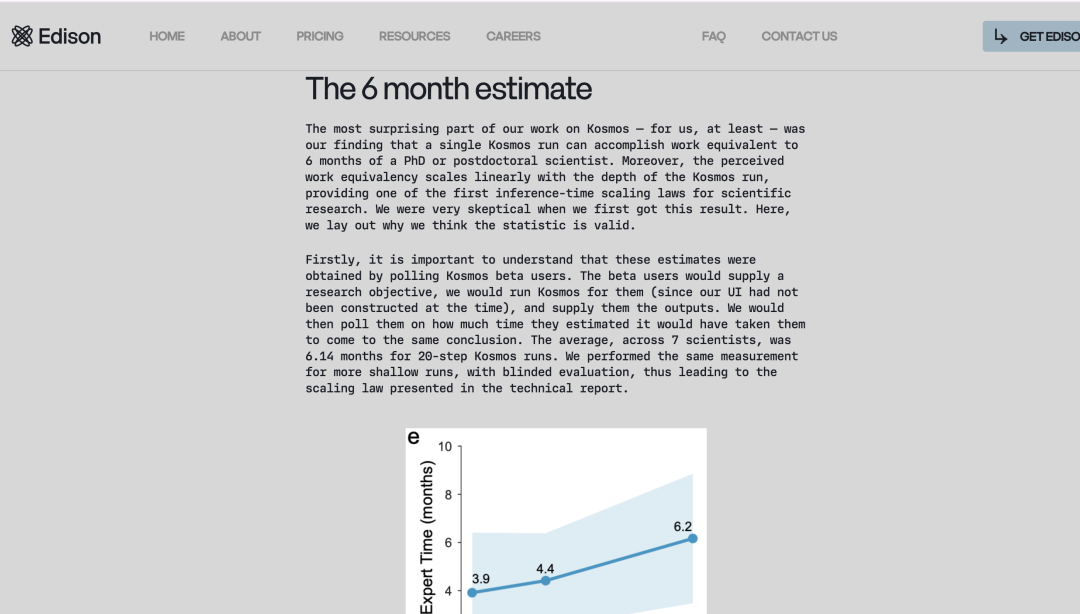

より代表的な例としては、AI 科学者 Kosmos のパフォーマンスが挙げられます。1 回の実行で、1,500 件の学術論文を自動的に読み取り、42,000 行のコードを実行し、同様のシステムよりも 9.8 倍多くのコードを生成することができます。人間の科学者が6か月かけて行う研究に相当する作業を、たった1日で完了できます。

企業ウェブサイト:https://edisonscientific.com/

スケールメリット:数億のタスクを同時に処理

AI 科学者の 2 番目の主な利点は、大規模な探索を行う能力にあります。

人間の認知能力の限界により、従来の科学研究は限られた研究方向にしか焦点を当てることができませんが、AI科学者は「パノラマ検索」の能力を備えており、何億もの並行タスクを同時に処理できるため、科学的探究の範囲を人間が到達できない規模にまで拡大しています。

例えば、医薬品開発の分野では、AIは数千もの候補分子を直接生成・試験し、最も有望な構造を選別した後、ロボット実験プラットフォームに引き渡して検証することができます。このような「並列科学実験」の出現により、科学は実験室の物理的な境界から解放され、計算主導の「仮想実験宇宙」へと足を踏み入れることができました。

分子生物学の分野では、AI Co-Scientist は、数十万のタンパク質と小分子の相互作用を同時にシミュレートし、潜在的な薬物ターゲットを選別することができます。 ヤギ教授のチームが開発した「分子から社会へ」プラットフォームは、設計レイヤーにおいて数万ものMOF分子構造を一度に生成することができます。多次元パラメータを用いて最も価値の高い候補を選別することで、この規模は人間のチームが1年間で行うことができる作業量の数百倍に相当します。

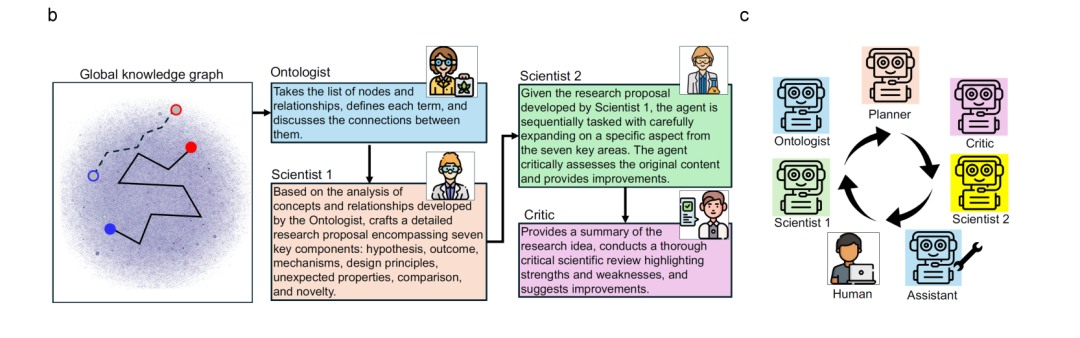

エネルギー材料の研究では、SciAgents システムは、オントロジー知識グラフを使用して 2 億 3000 万の科学的概念を結び付けます。常に変化する温度と圧力の条件下で、さまざまな材料の性能を同時にシミュレートすることができ、その規模は人間の研究チームの能力をはるかに超えています。

用紙のアドレス:

https://arxiv.org/abs/2409.05556

学際的なブレークスルー:科学研究における「次元の壁」を打ち破る

伝統的な科学研究は厳格な学問分野の障壁を特徴としています。生物学者は量子化学の理論的枠組みを完全に理解するのに苦労しています。材料エンジニアは遺伝子編集の専門知識が不足していることが多い。この専門分野の分離により、学際分野における多くのイノベーションの機会が失われている。まさにそこがAI科学者が本来持つ強みである。

AI科学者は人間の知識の境界に縛られることなく、異なる分野間を自由に行き来し、学際的な知識の統合と革新を実現できます。CMUが開発したCoscientistシステムはその典型例です。「新しい導電性ポリマーを合成しなさい」という自然言語指示を受け取ると、化学合成文献、材料科学データベース、電子工学標準を自律的に検索し、化学合成経路の設計、導電性予測、安定性試験といった学際的な手法を統合し、最終的にロボットプラットフォームを介して実験を完了します。このプロセス全体において、人間による学際的な連携に伴う調整コストは一切不要です。

ヤギ教授の 7 つの AI エージェント共同実験は、学際的なコラボレーションの深さをさらに実証しました。実験計画者は全体的なスキーム設計を担当し、文献アナリストは材料科学文献に焦点を当て、アルゴリズム コーダーはベイズ最適化プログラムを開発し、ロボット コントローラーは実験装置に接続され、安全コンサルタントは化学安全基準に従ってリスク管理を実行しました。異なる分野に属するこれらの AI エージェントは連携して、COF-323 材料が結晶化できないという長年の課題を無事に解決しました。これは、非晶質から高度に結晶化した形態を実現する画期的な進歩を表しています。

論文リンク:

https://pubs.acs.org/doi/10.1021/acscentsci.3c01087

この利点は学際的な分野ではさらに顕著です。スタンフォード大学の研究によると、AI科学者の研究仮説は…このうち 37% は学際的なイノベーションに属しますが、そのような仮説は人間の科学者からの提案では 5% 未満を占めます。

AI 科学者はスピード、規模、学際的な能力において前例のない優位性を示してきましたが、この急速な発展は新たな問題やリスクももたらし、課題も生じてきました。

課題:AI科学者、倫理、認知の境界のブラックボックス

ブラックボックスのジレンマ: 説明なしに答えだけが与えられる「因果関係の不均衡」。

科学研究の核心は「何を発見するか」だけではありません。それは「なぜそうなるのか」という点です。説明可能性と因果推論は科学理論構築の基礎であり、現在の AI 科学者の最大の欠点はまさにその「ブラック ボックス」性にあります。つまり、正確な結果は提供できるものの、その結果に至った論理的プロセスを説明することができないのです。

OpenAIの元科学者、アンドレイ・カルパシー氏はかつて、「最先端の大規模モデルに対する私たちの理解は、依然として経験的なレベルにとどまっています。試験は得意でも、問題解決の戦略を説明できない学生のようなものです」と鋭く指摘しました。この解釈可能性の欠如は、一連の問題を引き起こしています。材料科学において、DeepMind GNoMEプロジェクトは38万以上の安定した結晶構造を予測していますが、そのメカニズムの解釈可能性が依然としてボトルネックになっていることも文献で指摘されています。医療分野では、ハーバード大学医学系研究科(HMS)のTxGNNモデルが希少疾患に対する17,000種類以上の候補薬を特定しました。しかし、研究では「このモデルは予測スコアを提供するものの、専門家は仮説を検証し、潜在的な治療メカニズムを理解するために、その予測ロジックを理解する必要がある」と明確に指摘されています。これは、AI がそのメカニズムを説明する上でまだ欠陥があることを意味します。

2025年にスタンフォード大学が主催したAgents4Science実験会議では、さらに深刻な問題が明らかになりました。この会議では、すべての論文に AI を第一著者として記載することが求められ、レビュープロセス全体が AI によって完了されます。結果によると、AIが査読した論文には明らかな技術的誤りはなかったものの、多くの研究は「面白くも重要でもない」ものでした。スタンフォード大学のリサ・ウェクスラー教授は、「AIに『優れた科学的センス』を身につけさせるにはどうすればよいのか」という示唆に富む問いを投げかけました。この問いは、ブラックボックスのジレンマの核心を突いています。AIは、学術的歴史や専門分野の知識に基づいて人間の科学者が培ってきた価値判断能力を欠いており、研究の真の革新性や科学的意義を見極めることができないのです。

信頼性のギャップ:データの信頼性は検証が必要

説明なしに答えだけを提供する応答メカニズムは、別の大きな隠れた危険、つまり人々が AI 科学者の信頼性に疑問を抱くことにつながります。

AI科学者は学習と運用にデータセットと理論モデルを頼りにしていますが、これらの仮想的な「シミュレーション」と現実の物理世界の間には大きなギャップがあります。モデルでは完璧に機能する多くの解が、実際の実験では再現できません。この「信頼性ギャップ」は、AIの実用化を阻む重要な障害となっています。

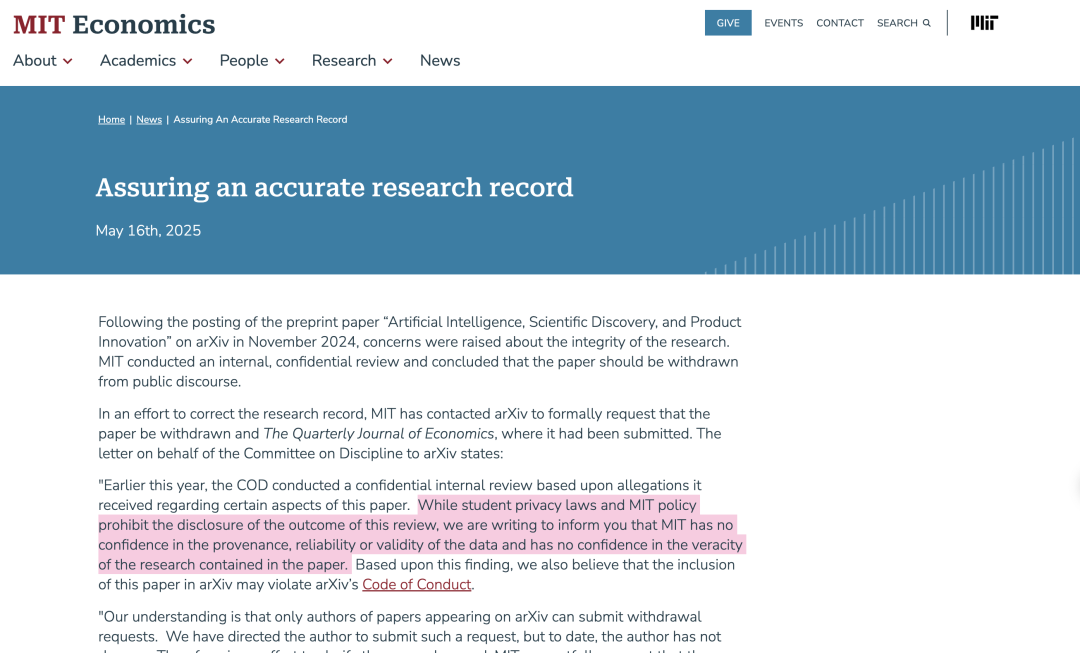

2025年に発覚したMITの論文偽造スキャンダルは、この問題を別の観点から反映している。この論文は、AIの支援により新材料発見数が44%、特許出願数が39%増加すると主張し、一時は「AIが科学に与える影響に関する最高の研究」と称賛され、多くの著名な科学者からも賞賛された。しかし、その後の調査で、論文のデータが捏造されたことが明らかになった。大学はプライバシー保護の観点から調査結果を公表しなかったものの、声明の中で「論文で使用されたデータの出所と信頼性、そして研究結論の信憑性に疑問を抱いている」と明確に述べている。

さらに深刻なのは、AI が自らの結果を「美化」してしまう可能性があることだ。研究により、一部の AI システムは予測と一致しないデータを選択的に無視し、モデルの結論に合わせるために誤った実験記録を生成する可能性もあることが判明しました。こうした「自己欺瞞」が適時に発見されなければ、研究の方向性全体が誤った方向に進む可能性があります。

人材危機:伝統的な科学研究能力の衰退と変革

AI科学者の台頭により科学研究人材の需要構造が変わりつつあり、伝統的な「一匹狼」科学者は徐々に優位性を失っています。専門分野に精通し、AI技術にも精通した「デュアルタレント」の需要は高く、供給が不足している。ハーバード大学のジョージ・チャーチ教授はインタビューで、生物学者はAIアルゴリズムに精通する必要はないが、AIの限界を理解し、AIの結果の合理性を判断できる能力が不可欠だと強調した。この「専門家+AIの協働能力」こそが、研究者の核心的な競争力となるだろう。

この変革は既存の研究者にとって大きな課題を提起します。Wiley の 2025 年グローバル研究者調査 (サンプル数 2,430) によると、841 人の TP3T 研究者がすでに研究で AI ツールを使用しています。しかし、AIが批判的思考力の向上に役立つと考えている回答者はわずか48%人で、半数以上がAIの活用について懸念を抱いていました。主な懸念は2つの側面に集中していました。第一に、従来のスキルが再構築に直面していることです。64%の回答者はAIがエラーや「錯覚」を生み出す可能性があることを懸念し、58%の回答者はプライバシーとセキュリティの問題を懸念していました。実験の設計とデータ分析を手作業で行うことに慣れている上級研究者は、「AIに質問し、AIの結果を解釈する」という新しい作業モードにすぐに適応することが難しいと感じています。

さらに、教育システムの遅れが人材不足を深刻化させています。現在、世界中のほとんどの大学は依然としてSTEM分野の従来の授業に大きく依存しており、AIと研究手法の統合が教育において著しく欠如しています。「AI研究ツールの応用」や「人間と機械の協調実験設計」などの実践的なコースを提供している大学はごくわずかです。その結果、学生は専門的な理論的知識は持っているものの、AIと協働する能力が不足しています。Wileyの調査によると、57%の研究者は「使用ガイドラインとトレーニングの不足」がAI推進における主な障害であると考えていることが示されており、新卒者は研究室の新しいワークフローに適応するために追加のトレーニングを必要とすることが多いようです。

さらに憂慮すべきことに、AIへの過度の依存は基礎能力を弱める可能性がある。MITの研究によると、AIは脳の活動を低下させる可能性があり、AIがデータ処理や数式の導出に広く使用される場合、指導がなければ学生は数学の基礎や実験スキルの訓練を怠る可能性がある。これらこそがまさに科学的イノベーションの基盤である。

多くの課題があるにもかかわらず、AIと科学研究の深い統合は不可逆的な傾向です。 Wileyの調査によると、回答者の831%が2027年までにAIが科学研究の重要な部分を占めると考えており、571%がAIエージェントが十分に成熟すれば、AIエージェントが一部の研究タスクを自律的に実行することを許可することに賛成すると回答しています。これは、研究者と教育システムの両方が変化に積極的に適応する必要があることを意味します。研究者はAIツールの適用と結果の解釈に関するスキルを補完する必要があり、大学は将来のニーズに応える「デュアルスキル人材」を育成するために、カリキュラム改革を加速し、AI研究手法を中核教育に統合する必要があります。

結論:AIと人類が共創する新しい科学の時代

サカナAIの完全自動化システムからヤギ教授の「分子から社会へ」サイクルまで、AI科学者は科学研究のあり方を不可逆的に変革しつつあります。この革命はスピードと規模だけでなく、思考においても起こります。AIが人間には想像もできない科学的道を探求できるようになり、学際的なコラボレーションがもはや人間の知識の限界に制限されなくなる時、科学的発見の効率性と幅広さは爆発的な成長期を迎えます。

しかし、AI 科学者は究極的には人間の知能の延長であり、人間の知能を置き換えるものではないということを私たちは冷静に認識しなければなりません。人間特有の直感、価値判断、革新的なひらめきが欠如しており、人間のように偶然の現象から科学的な機会を捉えることができず、研究結果の背後にある社会的意義を理解することもできません。

科学の究極の目標は、未知の世界を探求し、人類の運命を改善することです。AI科学者の台頭により、この目標の達成はより迅速かつ効率的になります。2025年のノーベル化学賞受賞者であるヤギ氏の言葉は、おそらくこのことを最もよく表しているでしょう。「私たちは実験を加速させているのではなく、人類の問題解決能力を加速させているのです。」

参考リンク:

1.https://sakana.ai/ai-scientist/

2.http://m.toutiao.com/group/7559872054532407823/

3.https://www.businessinsider.com/openai-cofounder-andrej-karpathy-keep-ai-on-the-leash-2025-6

4.https://www.dwarkesh.com/p/andrej-karpathy

5.https://mp.weixin.qq.com/s/qUL3jhyZcIZI7cBQac1vbg