Command Palette

Search for a command to run...

AI論文ウィークリー | Chai-2は抗体設計の効率性を向上させ、ヒット率が100倍に向上。ICML最終選考に残った複数の論文をざっと紹介

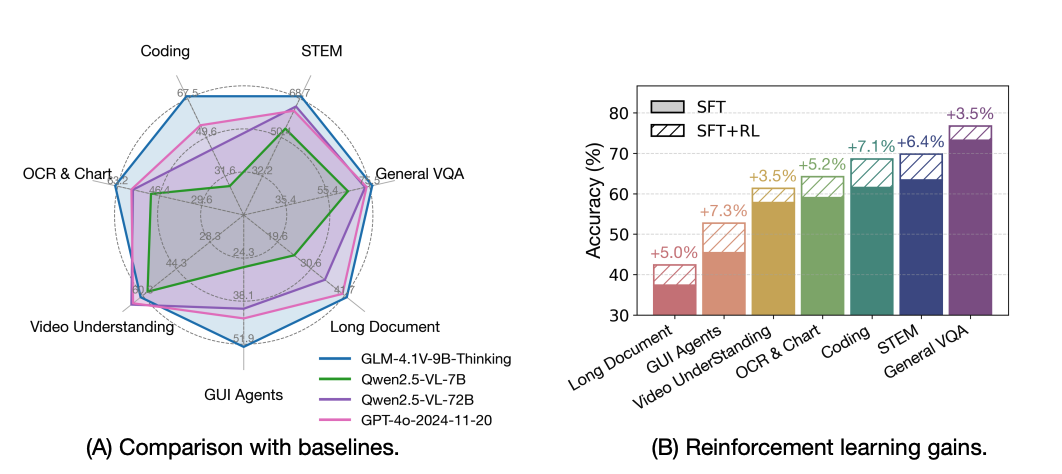

視覚言語モデル(VLM)は、従来のテキスト理解の限界を徐々に突破し、複雑な視覚情報の深い認識と分析へと進化を遂げ、今日の知能システムに不可欠な中核コンポーネントとなりつつあります。モデルの知能化の飛躍的な進歩に伴い、その応用シナリオは基本的な視覚認識から科学的問題の解決や自律型知能エージェントの構築へと拡大し、モデル能力に対する要求はますます高まっています。関連する研究は進行中ですが、これらの研究は主に特定の分野に限定されており、汎用的なマルチモーダル推論モデルは未だに不足しています。

この点に関して、Zhipu AIと清華大学は共同でGLM-4.1V-Thinkingを提案しました。汎用的なマルチモーダル理解・推論視覚言語モデルとして、このモデルはSTEM問題解決、ビデオ理解、コンテンツ認識、プログラミング、参照解決、GUIベースエージェント、長文文書理解など、様々なタスクにおいて優れた性能を発揮しています。特に、長文文書理解やSTEM推論といったタスクにおいては、GPT-4oなどのクローズドソースモデルと同等以上の性能を示しています。

ペーパーリンク:https://go.hyper.ai/fEPb4

最新のAI論文:https://go.hyper.ai/hzChC

学術界における人工知能分野の最新動向をより多くのユーザーに知ってもらうため、HyperAI の公式サイト (hyper.ai) に「最新論文」セクションが開設され、最先端の AI 研究論文が毎日更新されます。おすすめのAI論文5選、UniMate Mechanical Metamaterials Benchmark Datasetとそのダウンロードリンクが含まれています。今週の最先端のAI成果を簡単にご覧ください⬇️

今週のおすすめ紙

1 GLM-4.1V思考:スケーラブルな強化学習による多用途マルチモーダル推論に向けて

本論文では、汎用的なマルチモーダル理解と推論の高度化を目指して設計された視覚言語モデル、GLM-4.1V-Thinkingを紹介します。研究チームは、同規模のモデルの中で最先端の性能を誇るGLM-4.1V-9B-Thinkingモデルをオープンソース化しました。

28の公開ベンチマークで包括的な評価を行った結果、このモデルはほぼ全てのタスクでQwen2.5-VL-7Bを上回り、18のベンチマークでは、大幅に性能の高いQwen2.5-VL-72Bと同等以上の性能を示しました。特に、長文文書理解やSTEM推論といった難解なタスクにおいては、GPT-4oなどのクローズドソースモデルと同等以上の性能を示しており、その強力な能力をさらに際立たせています。

論文リンク:https://go.hyper.ai/fEPb4

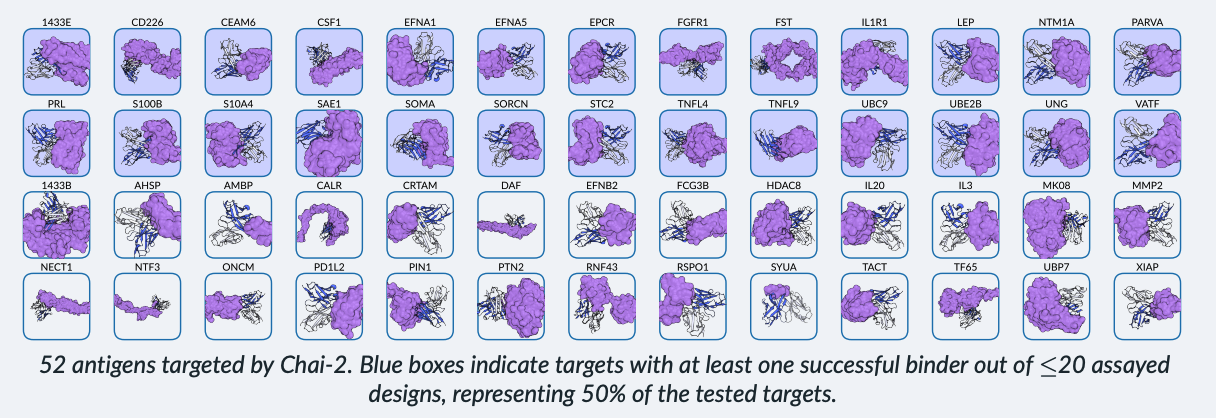

2 24ウェルプレートでのゼロショット抗体設計

本論文では、マルチモーダル生成モデルChai-2を紹介します。Chai-2は、完全なde novo抗体設計において16%のヒット率を達成しており、これは従来の計算手法と比較して100倍以上の改善となります。抗体設計に加え、Chai-2はミニタンパク質設計においてもウェットラボでの成功率68%を誇り、ピコモルレベルの結合剤を頻繁に生成します。Chai-2の高い成功率により、新規抗体を2週間以内に迅速に実験的に検証し、特性評価することが可能となり、迅速かつ高精度な原子スケールの分子工学の新たな時代への道が開かれます。

論文リンク:https://go.hyper.ai/rRRML

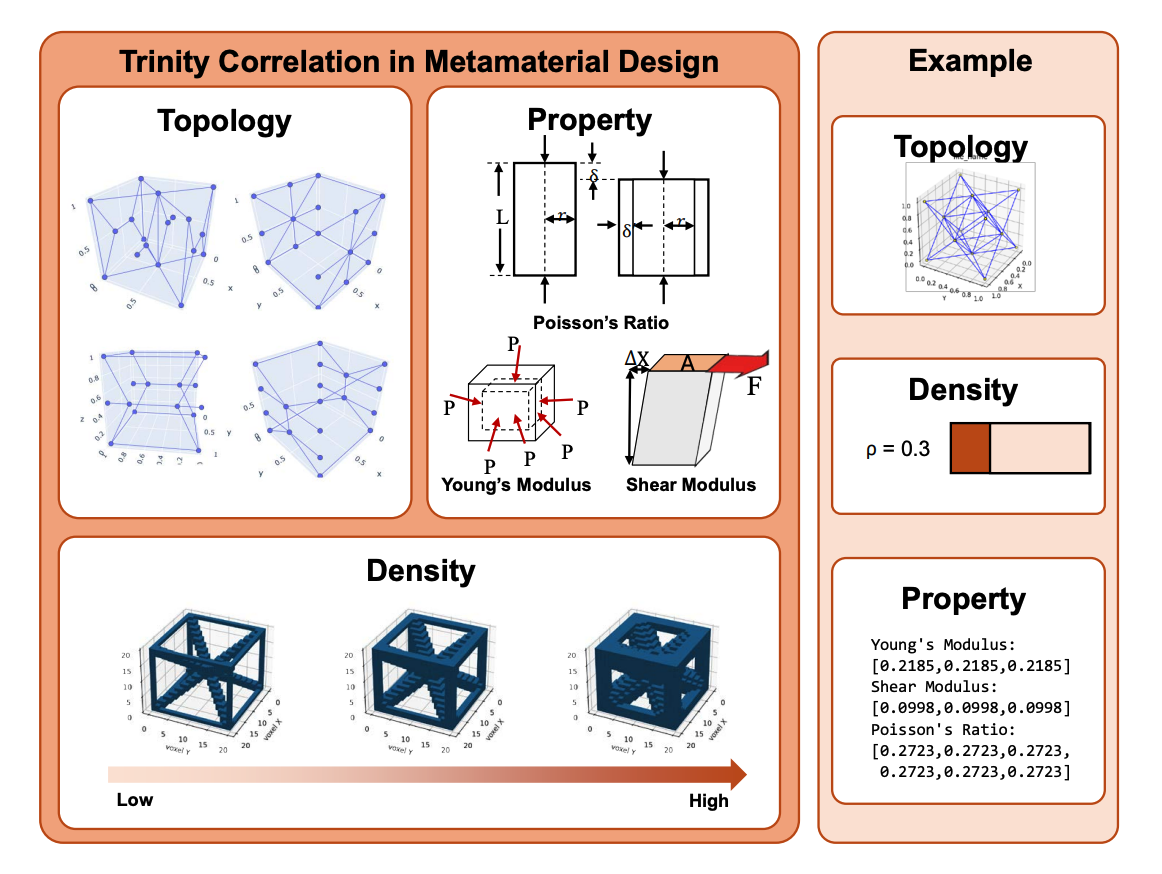

3 UniMate: 機械的メタマテリアルの生成、特性予測、状態確認のための統合モデル

機械メタマテリアルの設計には通常、3次元トポロジカル構造、密度条件、および機械的特性という3つの主要なモードが関係します。しかしながら、既存の研究のほとんどは2つのモードのみを考慮しています。本論文では、モードアライメントモジュールと協調拡散生成モジュールで構成される統合モデルUniMateを提案します。実験結果によると、UniMateは、トポロジー生成タスク、性能予測タスク、および状態確認タスクにおいて、それぞれ80.2%、5.1%、50.2%だけ他のベースラインモデルよりも優れた性能を示しました。

論文リンク:https://go.hyper.ai/KNcmr

UniMate メカニカルメタマテリアルベンチマークデータセット:https://go.hyper.ai/p4535

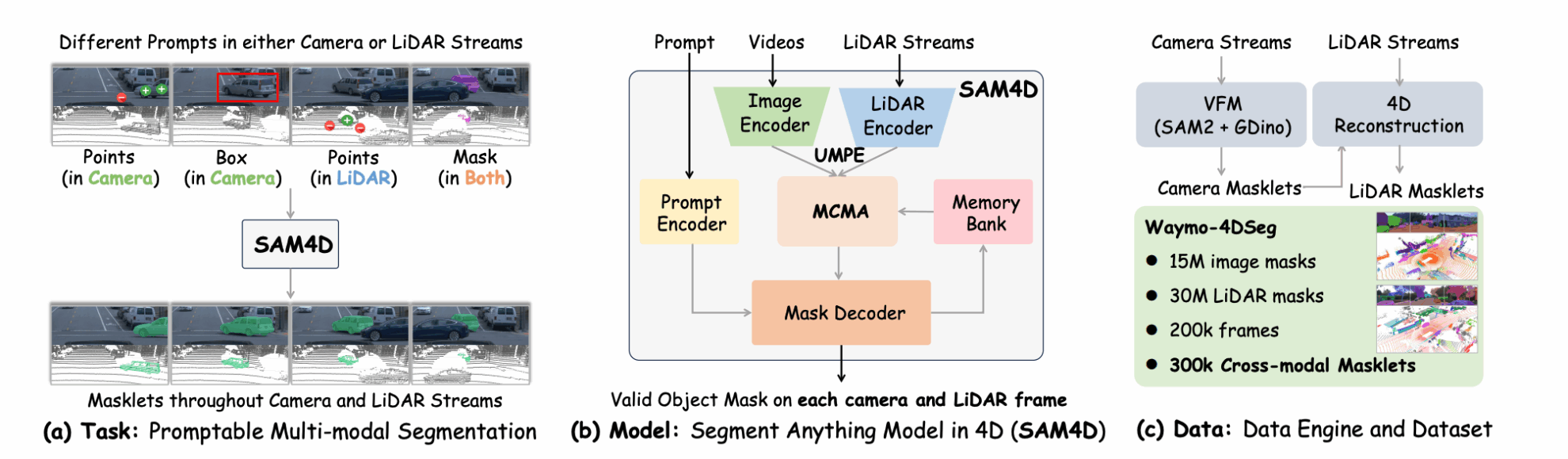

4 SAM4D: カメラとLiDARストリーム内のあらゆるものをセグメント化

本稿では、カメラとレーダーストリーム間のマルチモーダルかつ時空間に敏感なセグメンテーションタスクを実現することを目的とした新しいモデルSAM4Dを紹介します。このモデルは、統一されたマルチモーダル位置エンコーディングによってカメラとレーダーの特徴を整合させ、動きを考慮したクロスモーダルメモリアテンションメカニズムを用いて時間的な一貫性を高め、動的環境における堅牢なセグメンテーションを実現します。また、アノテーションのボトルネックを回避するため、本稿では、ビデオフレームマスクレット、4D再構成、クロスモーダルマスクレット融合に基づいて高品質の疑似ラベルを自動生成できる自動データエンジンも提案します。これにより、VFMから得られるセマンティック精度を維持しながら、アノテーション効率を効果的に向上させることができます。

論文リンク:https://go.hyper.ai/QtQEx

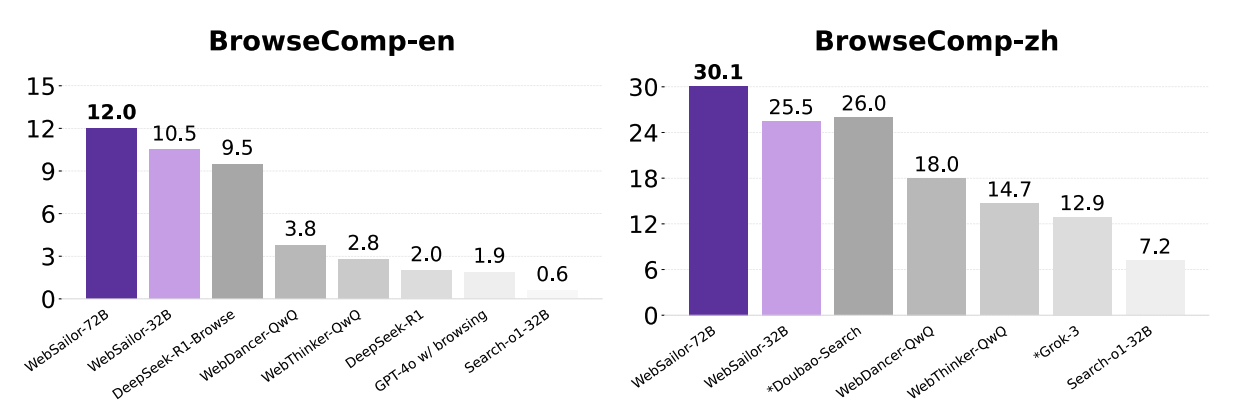

5 WebSailor: Webエージェントのための超人的な推論のナビゲーション

本論文では、人間の認知限界を超える推論能力を大規模言語モデルに学習させる手法を提案し、特に複雑な情報探索タスクのパフォーマンスに焦点を当てています。この手法は、解析困難なタスクデータの生成、効果的な強化学習戦略の活用、そして適切なコールドスタート手法の実装によってモデルの能力を向上させることに基づいています。このようにして開発されたWebSailorモデルは、BrowseCompなどの複雑な英語および中国語の情報探索ベンチマークにおいて、オープンソースモデルを大幅に上回り、一部の独自システムのパフォーマンスレベルに近づくか、あるいはそれに匹敵する性能を実現しています。

論文リンク:https://go.hyper.ai/qyvf2

今週の論文推薦は以上です。さらに最先端のAI研究論文をご覧になりたい方は、hyper.ai公式サイトの「最新論文」セクションをご覧ください。

質の高い研究成果や論文の提出を歓迎いたします。ご興味のある方は、NeuroStar WeChat(WeChat ID: Hyperai01)にご登録ください。

また来週お会いしましょう!