Command Palette

Search for a command to run...

オンラインチュートリアル:北京大学のShi Boxinチームとベイジアンコンピューティングが、複数のパフォーマンス指標がSOTAに到達したビデオインスタンス再描画手法VIRESを提案

ビデオもPhotoshopで加工できますか?

ご存知の通り、動画編集は非常に難しいものです。被写体を調整したり置き換えたり、シーンや色を変えたり、オブジェクトを削除したりしたい場合、これは多くの場合、手動での注釈付け、マスク ペイント、および無数のフレームの慎重なカラー グレーディングを意味します。経験豊富なポストプロダクションチームでさえ、複雑なシーンの編集において時間的な一貫性を維持することは困難です。近年、生成AIの急速な発展に伴い、「ワンクリック削除」などの機能が様々な編集ソフトウェアに徐々に登場し、映像編集におけるAIの大きな可能性を人々に認識させています。

実際、実用化においては、「画一的な」除去機能に加えて、被写体の置き換えや追加といった、より高精度なターゲット認識、セグメンテーション、そして動画生成を伴う機能が、より頻繁に使用され、かつより高度な機能として挙げられます。しかしながら、現在のAI手法は、複雑なシーンにおけるこのような動画の再描画タスクの処理において依然として課題を抱えています。例えば、現在の多くのゼロショット方式では、連続したビデオ フレームを処理するときに画面のちらつきが発生する傾向があり、複雑な背景や複数のターゲットがあるシーンでは、ずれ、ぼやけ、または意味的な偏差が発生する可能性があります。

これに対応して、北京大学カメラインテリジェンス研究所(Shi Boxin 氏のチーム)は、OpenBayes ベイジアンコンピューティングおよび北京郵電大学人工知能学院パターン認識研究所の Li Si 准教授のチームと提携しました。彼らは、スケッチとテキストガイダンスを組み合わせたビデオサンプル再描画手法VIRESを共同で提案しました。ビデオ本体の再描画、置換、生成、削除などの複数の編集操作をサポートします。

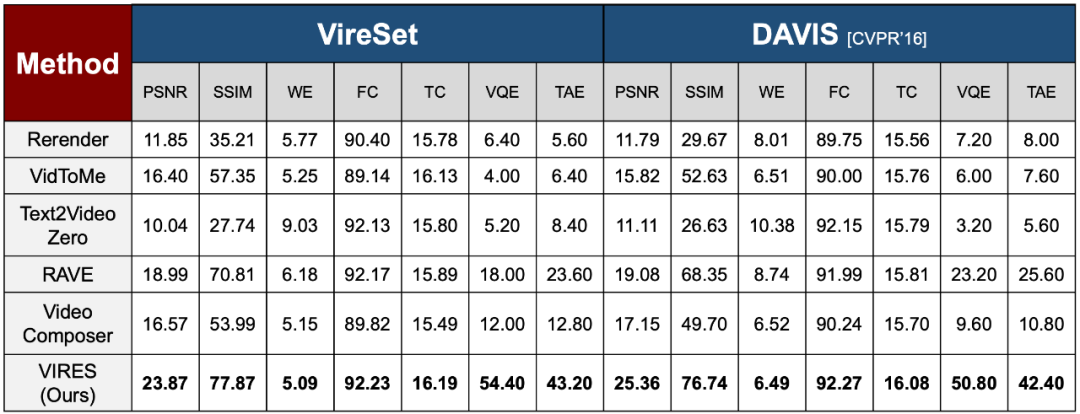

この手法は、テキストから動画への変換モデルの事前知識を用いて時間的な一貫性を確保するとともに、標準化された適応型スケーリング機構を備えたSequential ControlNetを提案しています。これにより、構造レイアウトを効果的に抽出し、高コントラストのスケッチの詳細を適応的に捉えることができます。さらに、研究チームはDiT(拡散変換)バックボーンにスケッチアテンション機構を導入し、細粒度のスケッチセマンティクスを解釈・注入しました。実験結果から、VIRES は、ビデオ品質、時間的一貫性、条件付きアライメント、ユーザー評価など、多くの面で既存の SOTA モデルよりも優れています。

関連研究は「VIRES: スケッチとテキストによるガイド付き生成によるビデオインスタンスの再描画」と題され、CVPR 2025 に選出されました。

現在、「VIRES:スケッチとテキストのデュアルガイドによるビデオ再描画」は、HyperAI公式サイト(hyper.ai)のチュートリアルセクションに公開されています。ワンクリックで展開でき、高品質なビデオ編集機能をオンラインで体験できます。カスタマイズインスタンスの生成を例に、著者は屋外の雪の中を走るコーギーを追加しました。リアルで、反抗的な雰囲気は全くありません⬇️

チュートリアルのリンク:https://go.hyper.ai/49koQ

新規登録ユーザーの皆様には、サプライズ特典をご用意しております。OpenBayesプラットフォームへのご登録には、招待コード「VIRES」をご利用ください。RTX A6000 を 4 時間無料でご利用いただけます (リソースの有効期限は 1 か月です)。数量限定、早い者勝ち!

デモの実行

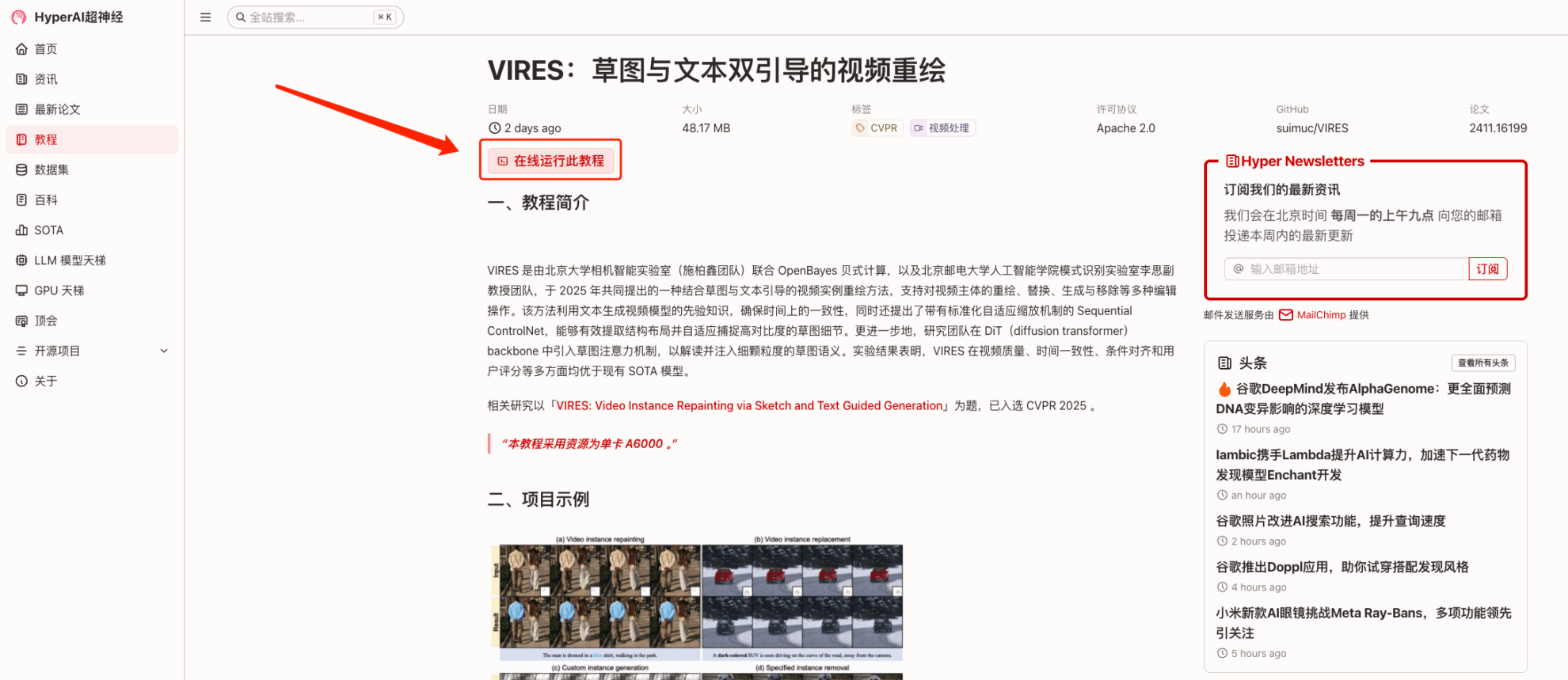

1. hyper.ai ホームページにアクセス後、「チュートリアル」ページを選択し、「VIRES: スケッチとテキストのデュアル ガイドによるビデオ再描画」を選択して、「このチュートリアルをオンラインで実行」をクリックします。

2. ページがジャンプしたら、右上隅の「クローン」をクリックしてチュートリアルを独自のコンテナにクローンします。

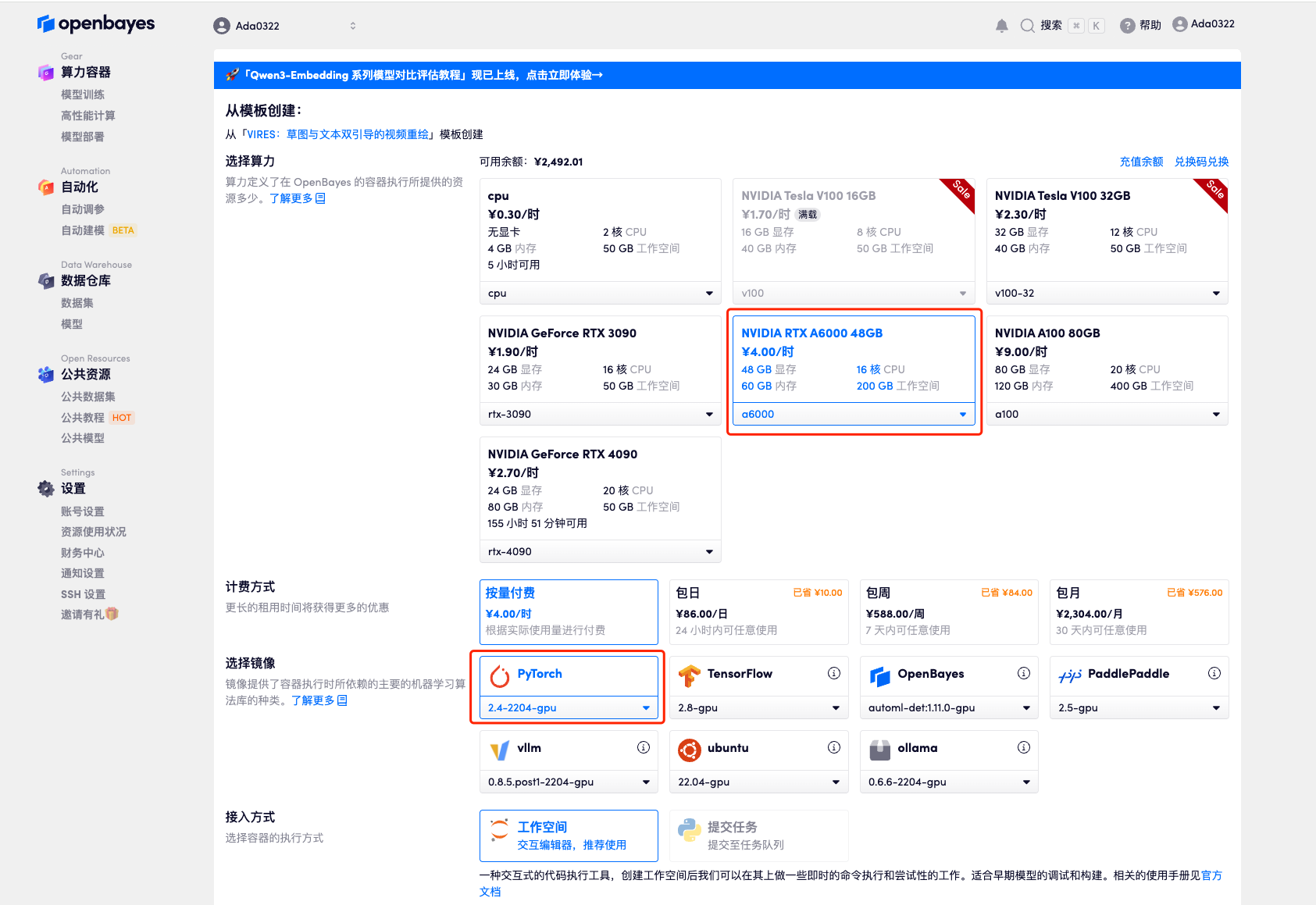

3. 「NVIDIA RTX A6000」と「PyTorch」のイメージを選択してください。OpenBayesプラットフォームでは4つの課金方法をご用意しています。ニーズに合わせて「従量課金制」または「日次/週次/月次」からお選びいただけます。「続行」をクリックしてください。新規ユーザーは、以下の招待リンクから登録すると、RTX 4090を4時間分とCPUを5時間無料でご利用いただけます。

HyperAI ハイパーニューラルの専用招待リンク (ブラウザに直接コピーして開きます):

https://openbayes.com/console/signup?r=Ada0322_NR0n

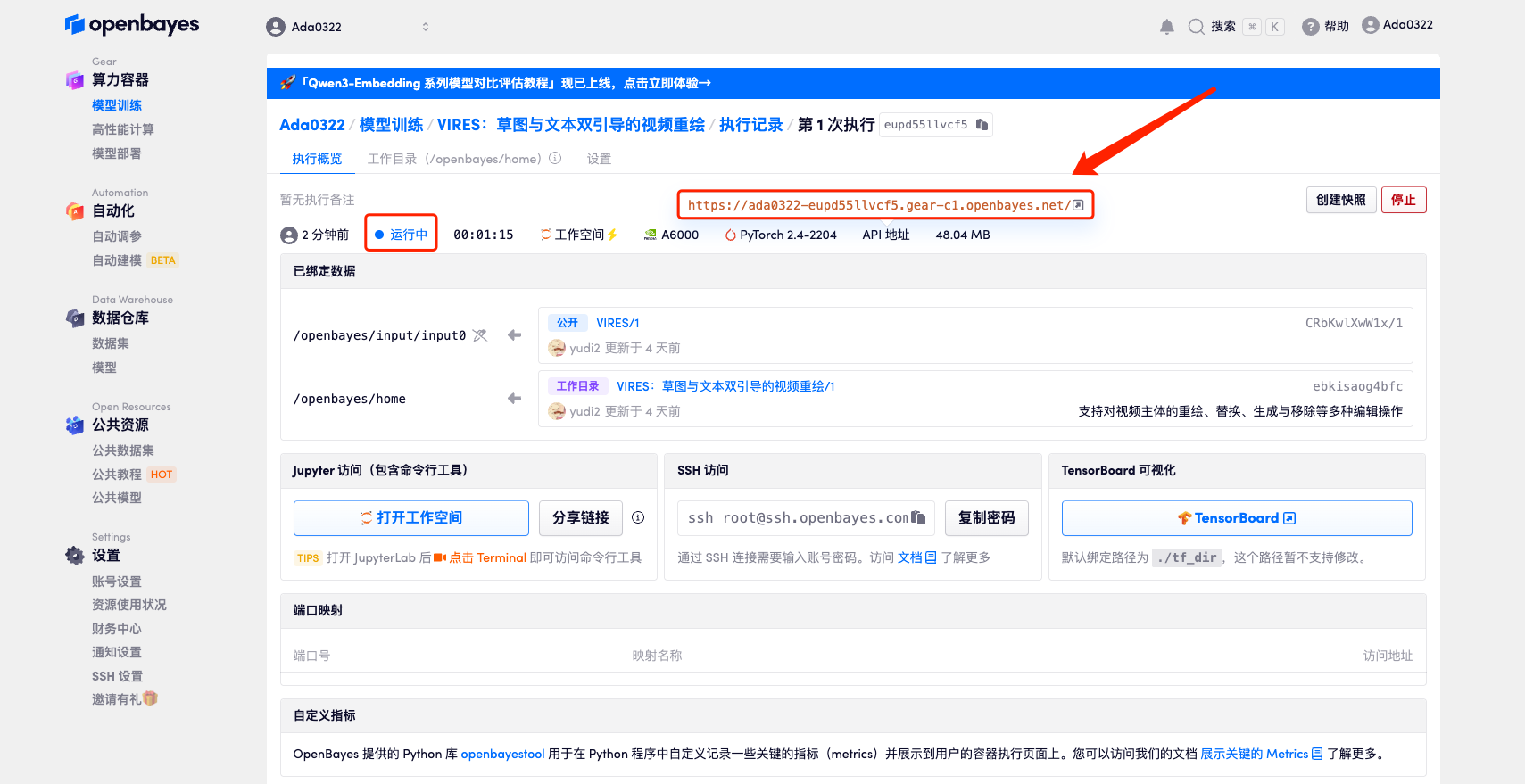

4. リソースが割り当てられるのを待ちます。最初のクローン作成プロセスには約 2 分かかります。ステータスが「実行中」に変わったら、「API アドレス」の横にあるジャンプ矢印をクリックしてデモ ページに移動します。モデルが大きいため、WebUI インターフェイスが表示されるまでに約 3 分かかります。そうでない場合は、「Bad Gateway」と表示されます。 APIアドレスアクセス機能を使用する前に、ユーザーは実名認証を完了する必要がありますのでご注意ください。

効果実証

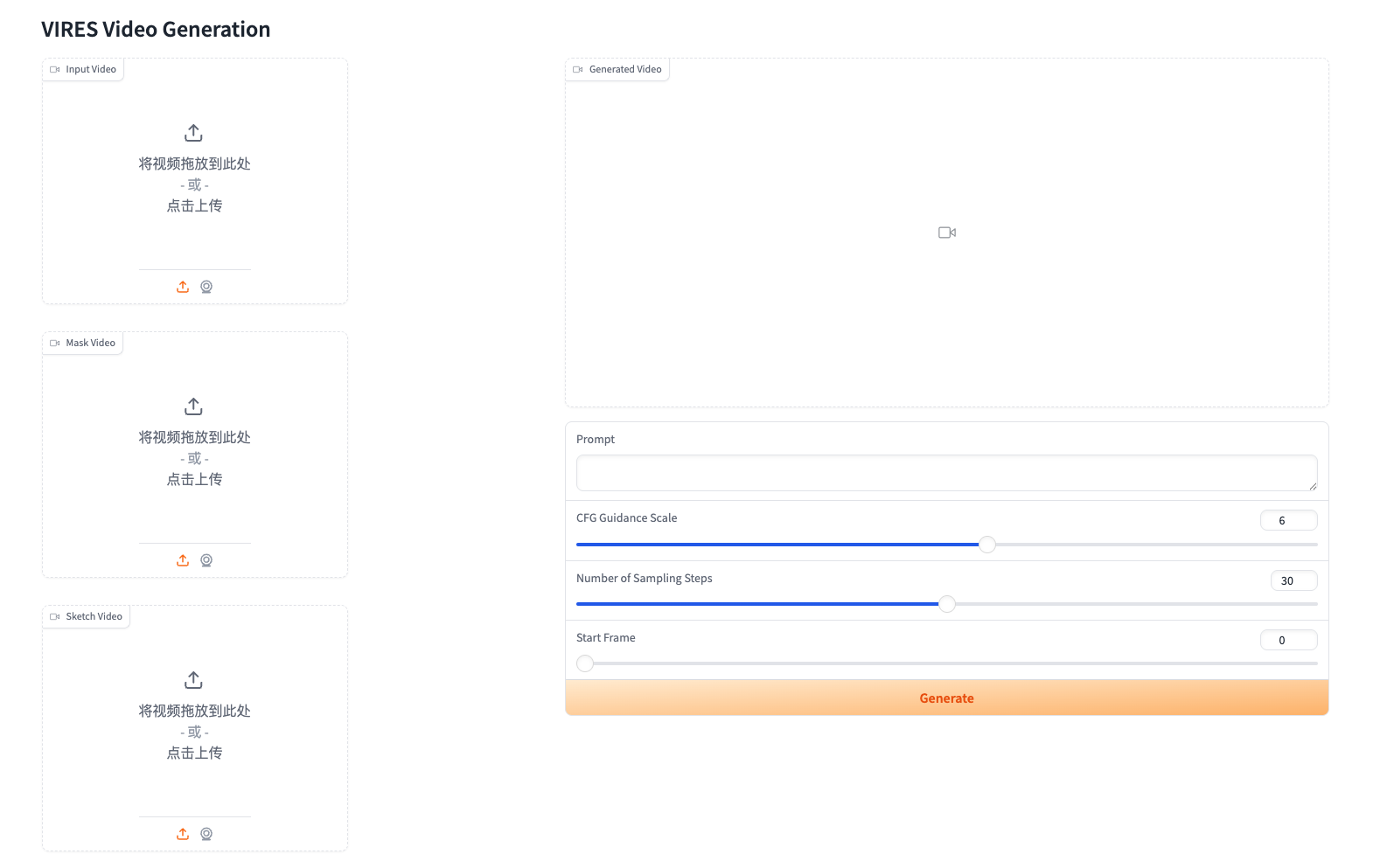

下の図に示すように、APIアドレスをクリックすると、モデルを直接体験できます。チュートリアルには複数の例をご用意していますので、ぜひご体験ください。

「カスタムインスタンス生成」を例に挙げると、作者は屋外の雪の中を走るコーギーを追加しました。これは本物そっくりで、反抗的な感じは全くありません。

* オリジナルビデオ:

* 効果を生成する:

* プロンプト:

この動画は、雪景色の公園を楽しそうに駆け回るコーギーの愛らしい姿を捉えています。公園には木々が飾られ、背景には遊具があり、絵のように美しい冬の雰囲気を醸し出しています。オレンジと白の毛並みと表情豊かな瞳を持つコーギーは、カメラに向かって走ったり、遠ざかったりを繰り返し、前足で雪を蹴り上げ、遊び心のある様子を見せています。動画では、雪の中で戯れるコーギーの輝く瞳、たくましい脚、俊敏な動きを中心に、細部まで捉えています。制作者は、愛するペットの喜びと躍動感を美しい雪景色の中で表現した、心温まる、そして視覚的にも魅力的な瞬間を届けようとしたのでしょう。

以上が今回HyperAIがおすすめするチュートリアルです。ぜひ皆さんも体験してみてください!

チュートリアルのリンク:https://go.hyper.ai/49koQ