Command Palette

Search for a command to run...

オンラインチュートリアル | 19 の言語をサポートし、生成速度が 15 倍になります。 ACE-Step音楽生成モデルが利用可能になりました

現在の音楽生成モデルは、生成速度、音楽の一貫性、制御可能性の間で本質的なトレードオフに直面しています。例えば、LLM ベースのモデル (Yue、SongGen など) は歌詞のアライメントでは優れたパフォーマンスを発揮しますが、推論速度が遅く、構造的なアーティファクトが発生するという問題があります。一方、拡散モデル (DiffRhythm など) は、より高速な合成を可能にする一方で、長距離構造の一貫性を欠くことがよくあります。これを受けて、人工知能企業StepFunとデジタル音楽プラットフォームACE Studioが共同で基本音楽生成モデルACE-Step-v1-3.5Bをリリースし、2025年5月7日にオープンソース化しました。このモデルは、NVIDIA A100 GPU 上でわずか 20 秒で最大 4 分の音楽を合成することができ、これは LLM ベースのベースライン メソッドよりも 15 倍高速です。メロディー、ハーモニー、リズムの面で優れた音楽の一貫性と歌詞の調和を実現します。

ACE-Step は、従来の AI 音楽ツールと比較して、既存の方法の主な制限を克服し、全体的なアーキテクチャ設計を通じて最適なパフォーマンスを実現します。多様なスタイルとジャンル、多言語サポート、楽器の表現力、ボーカルの表現力という 4 つの面で優れた利点があります。オープンソース版ではすでに 19 の言語での入力をサポートしており、微細な音響の詳細も保持しています。音声の複製、歌詞の編集、ミキシング、トラック生成などの高度な制御メカニズムをサポートします。さらに、すべての主流の音楽スタイル、複数の歌唱スタイル、ジャンルを超えた楽器生成もサポートします。楽器の音色特性を正確に復元し、複雑なアレンジのマルチトラック音楽を生成できます。

ACE-Step-v1-3.5B を使用すると、音楽スタイルや歌詞などのパラメータを入力するだけで、30 秒の音楽クリップをすばやく生成できます。クリックして聴いてみてください〜

* タグ入力: ファンク、ポップ、ソウル、ロック、メロディック、ギター、ドラム、ベース、キーボード、パーカッション、105 BPM、エネルギッシュ、アップビート、グルーヴィー、活気のある、ダイナミック

現在のところ、HyperAI公式サイトの「チュートリアル」セクションに「ACE-Step: 音楽生成のための基本モデル」が公開されました。ワンクリックデプロイチュートリアルを体験するには、以下のリンクをクリックしてください⬇️

チュートリアルのリンク:https://go.hyper.ai/tTmib

デモの実行

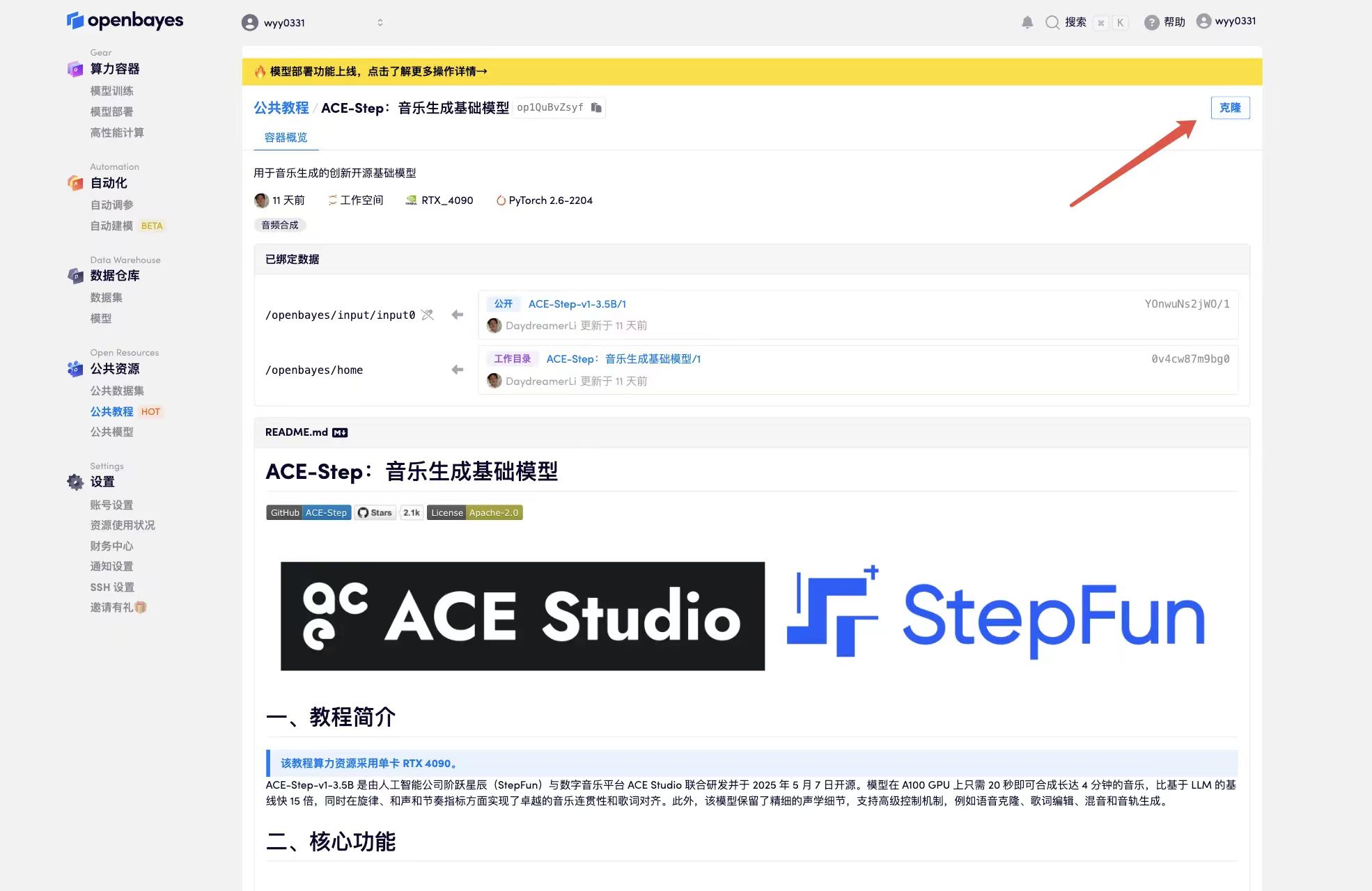

1. hyper.ai ホームページにアクセス後、「チュートリアル」ページを選択し、「ACE-Step: 音楽生成の基本モデル」を選択して、「このチュートリアルをオンラインで実行」をクリックします。

2. ページがジャンプしたら、右上隅の「クローン」をクリックしてチュートリアルを独自のコンテナにクローンします。

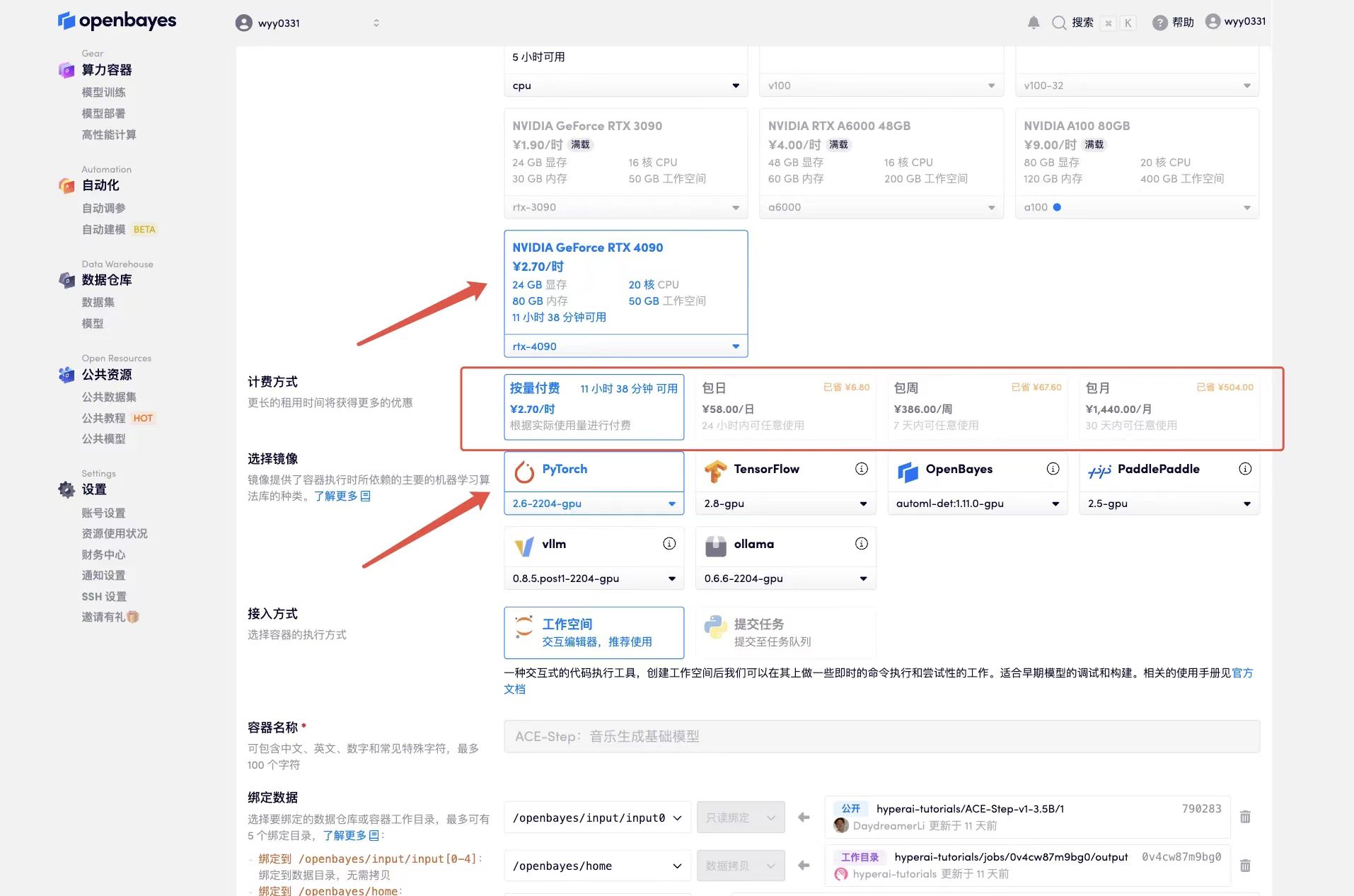

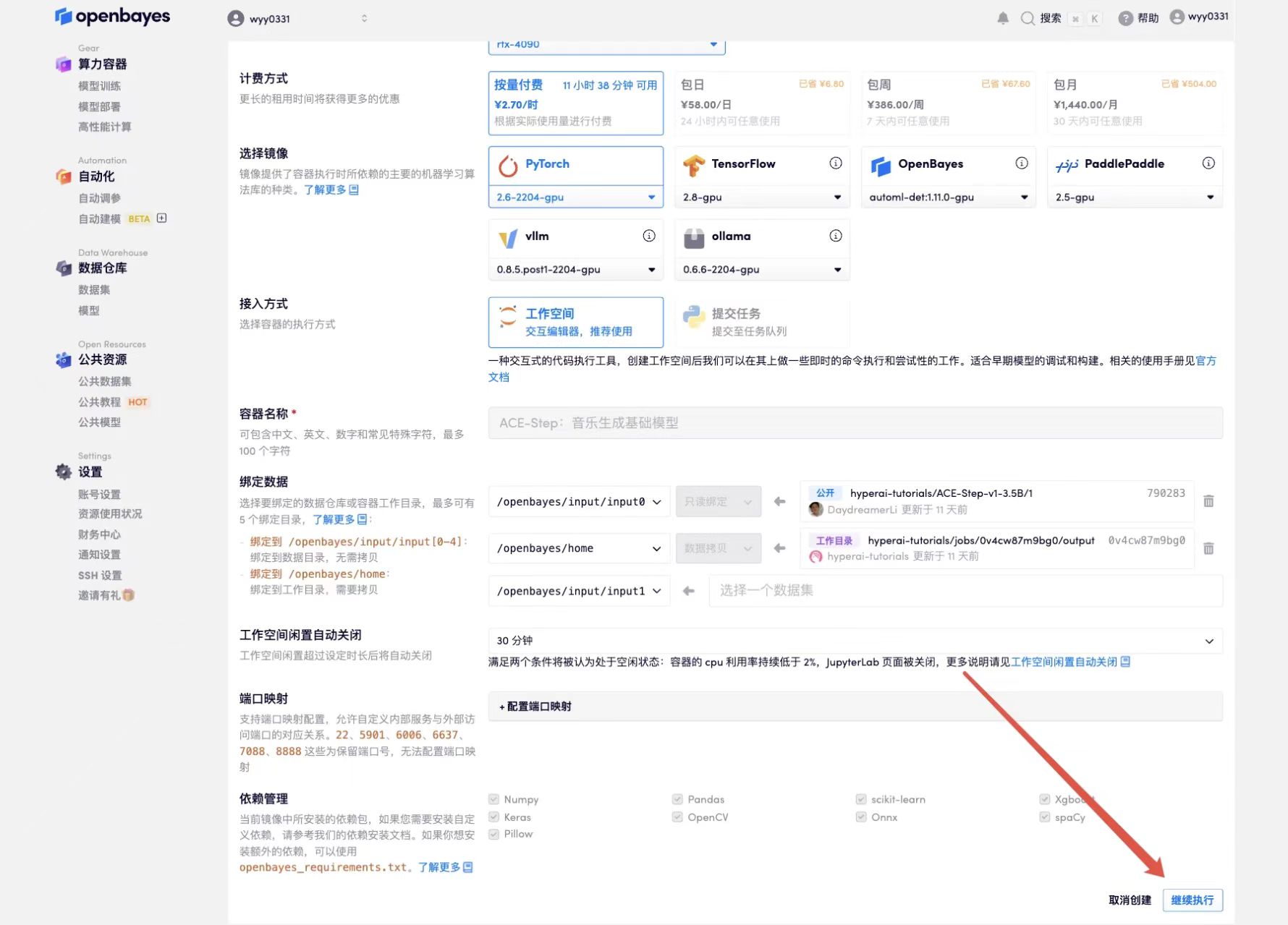

3. 「NVIDIA GeForce RTX 4090」と「PyTorch」のイメージを選択します。 OpenBayes プラットフォームは 4 つの課金方法を提供します。ニーズに応じて、「従量制」または「日次/週次/月次」を選択できます。 「続行」をクリックします。新規ユーザーは、以下の招待リンクを使用して登録すると、4 時間の RTX 4090 + 5 時間の CPU フリー時間を獲得できます。

HyperAI ハイパーニューラルの専用招待リンク (ブラウザに直接コピーして開きます):

https://openbayes.com/console/signup?r=Ada0322_NR0n

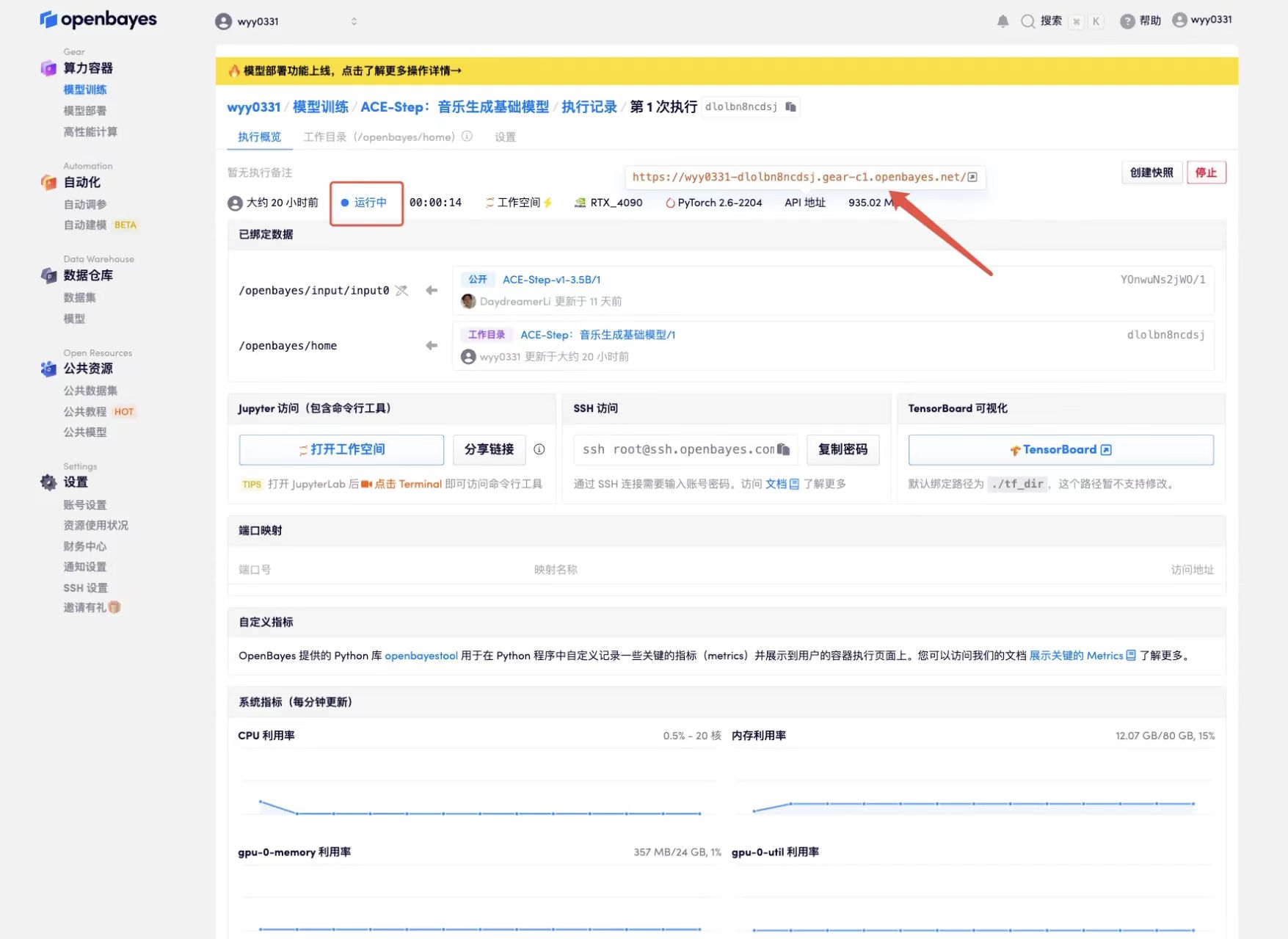

4. リソースが割り当てられるのを待ちます。最初のクローン作成プロセスには約 2 分かかります。ステータスが「実行中」に変わったら、「API アドレス」の横にあるジャンプ矢印をクリックしてデモ ページに移動します。モデルが大きいため、WebUI インターフェイスが表示されるまでに約 3 分かかります。そうでない場合は、「Bad Gateway」と表示されます。 APIアドレスアクセス機能を使用する前に、ユーザーは実名認証を完了する必要がありますのでご注意ください。

効果実証

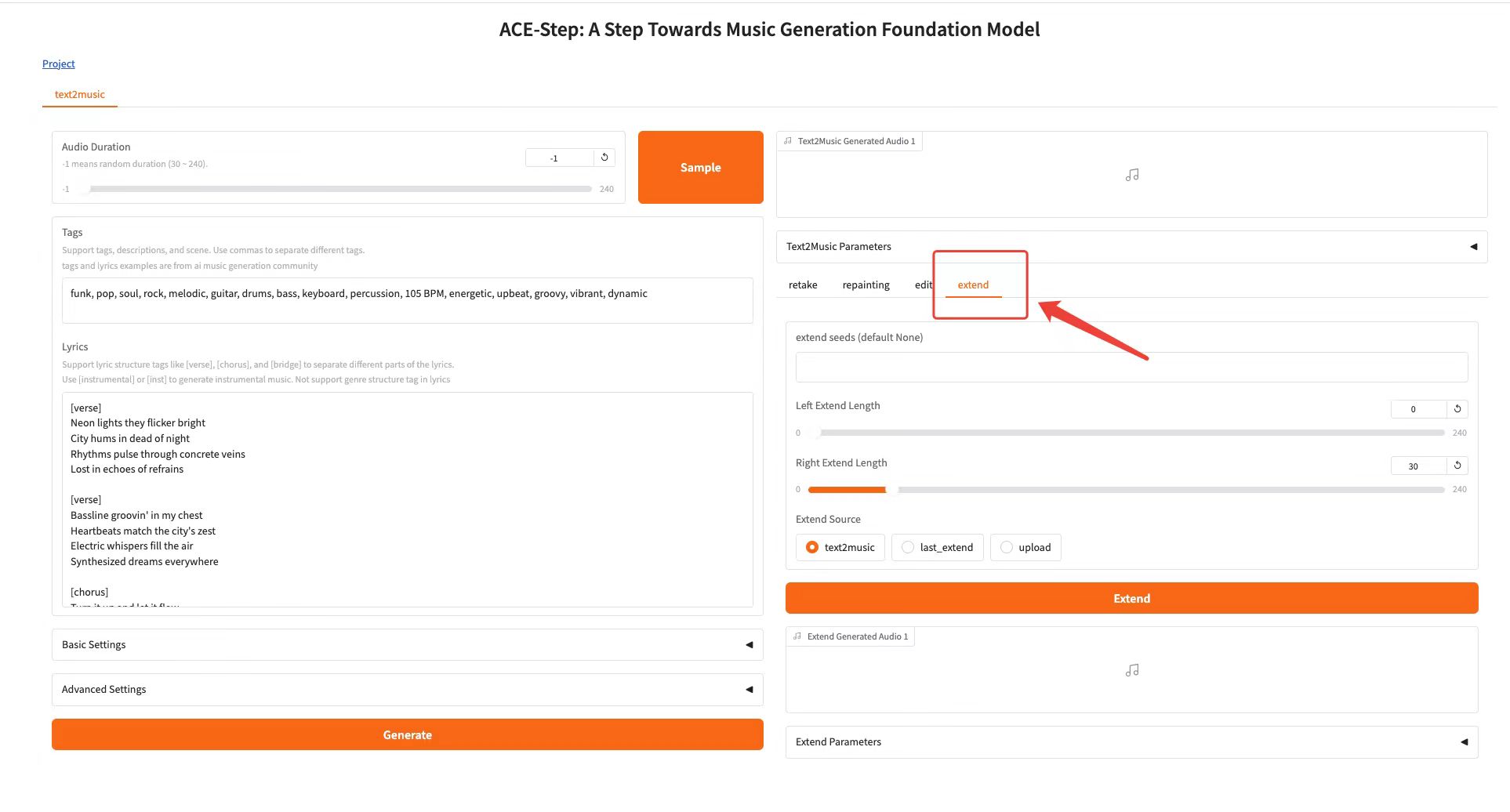

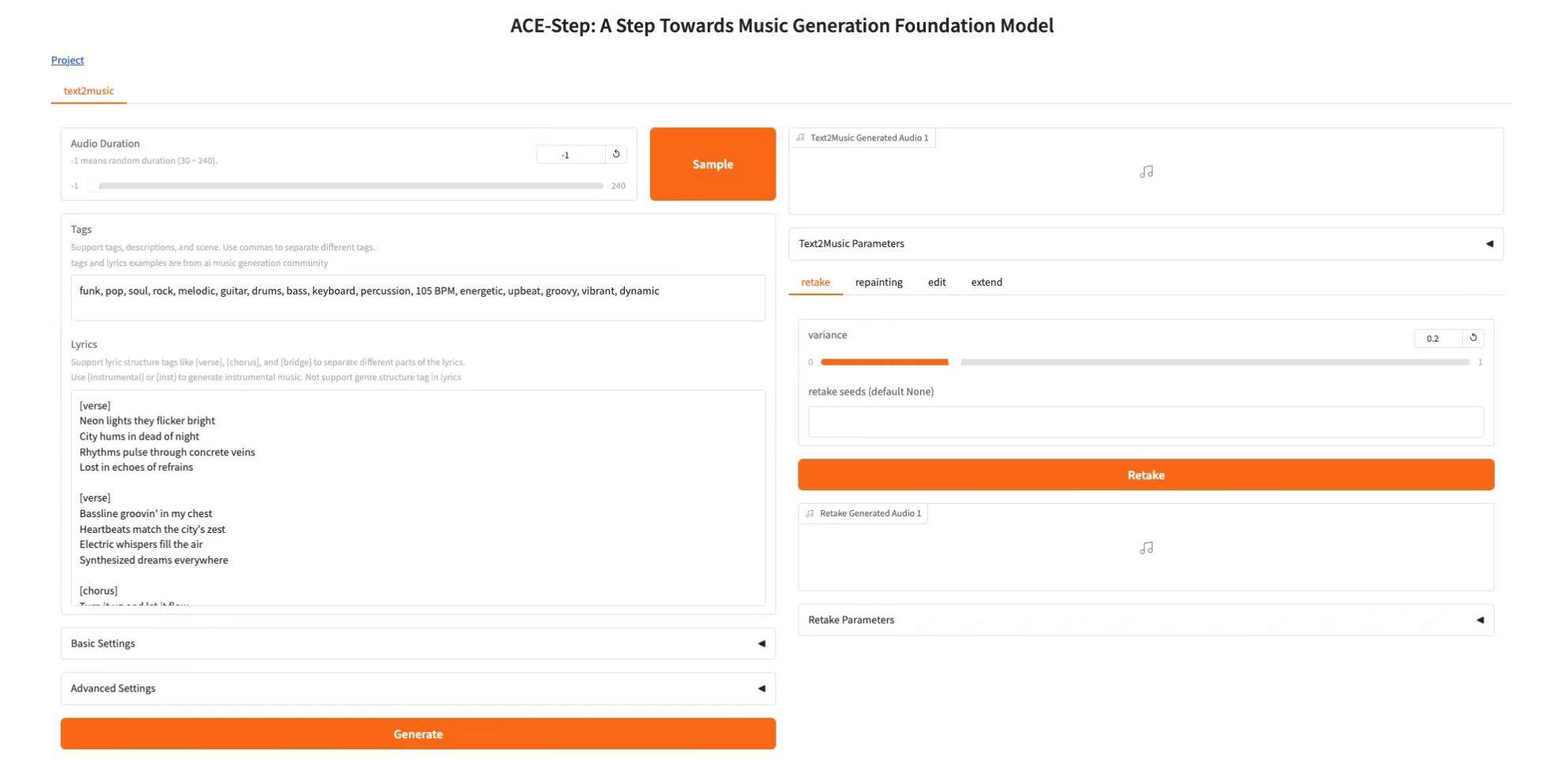

このプロジェクトは、Text2Music タブ、Retake タブ、Repainting タブ、Edit タブ、Extend タブというマルチタスク作成パネルを提供します。

各モジュールの機能とパラメータ調整について簡単に説明します。

Text2Musicタブ

* オーディオの長さ: 生成されるオーディオの長さを設定します (-1 はランダム生成を意味します)

* タグ: 説明タグ、音楽ジャンル、シーンの説明をカンマで区切って入力します

* 歌詞: [バース]、[コーラス]、[ブリッジ]などの構造タグ付きの歌詞を入力します。

* 基本設定: 推論ステップ数、ガイダンス比率、シード値を調整します

* 詳細設定: スケジューラタイプ、CFGタイプ、ERG設定、その他のパラメータを微調整します

* 「生成」ボタンをクリックすると、入力した内容に基づいて音楽が作成されます

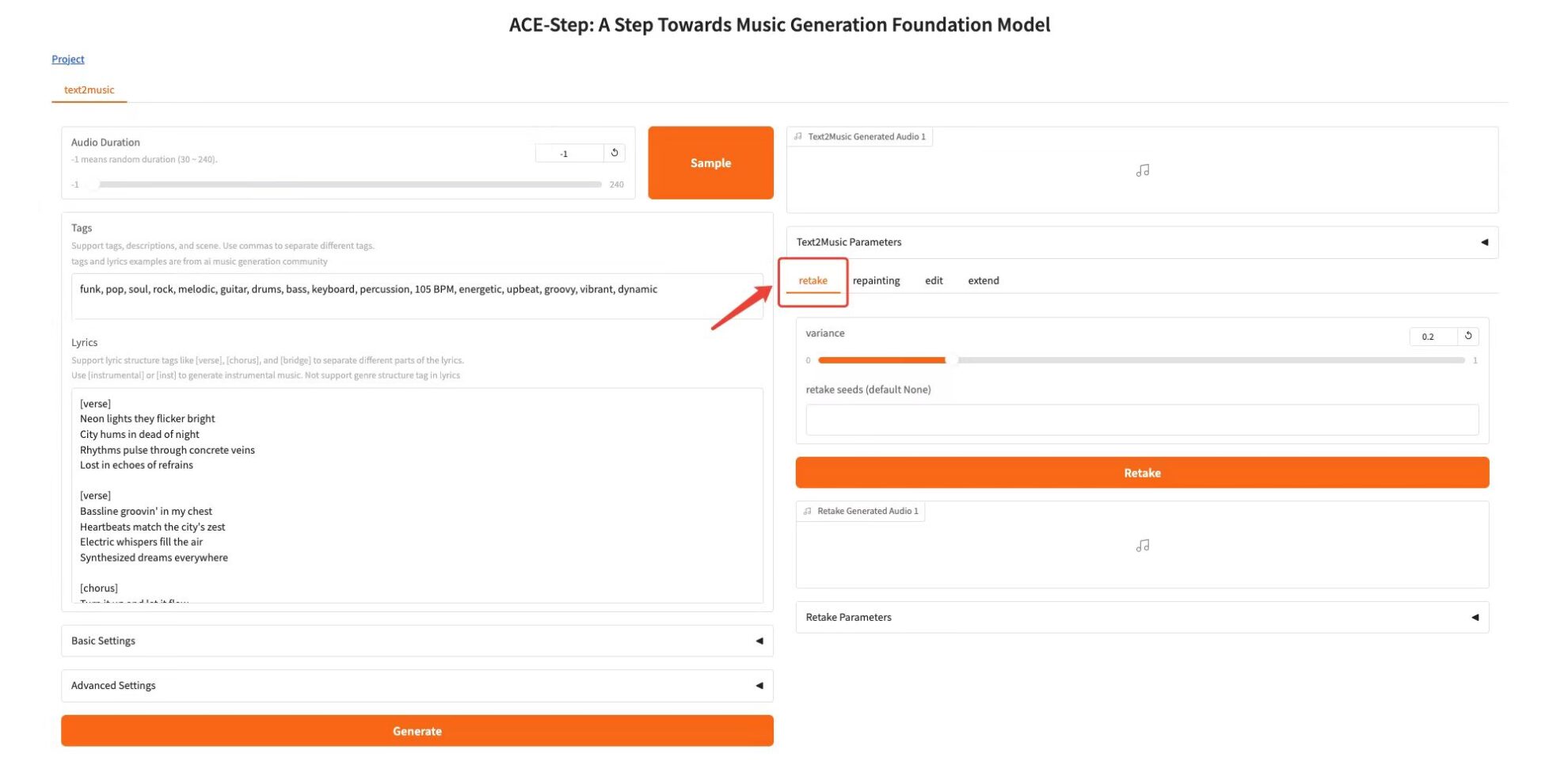

再受験タブ

関数:異なるシード値で音楽を再生成し、わずかなバリエーションを作成し、バリエーションパラメータを調整して、新しいバージョンがオリジナルとどの程度異なるかを制御します。

* 差異: 差異を入力してください

* 再取得シード(デフォルトなし):乱数シードを入力します

* 「再受験」ボタンをクリックして再生成してください

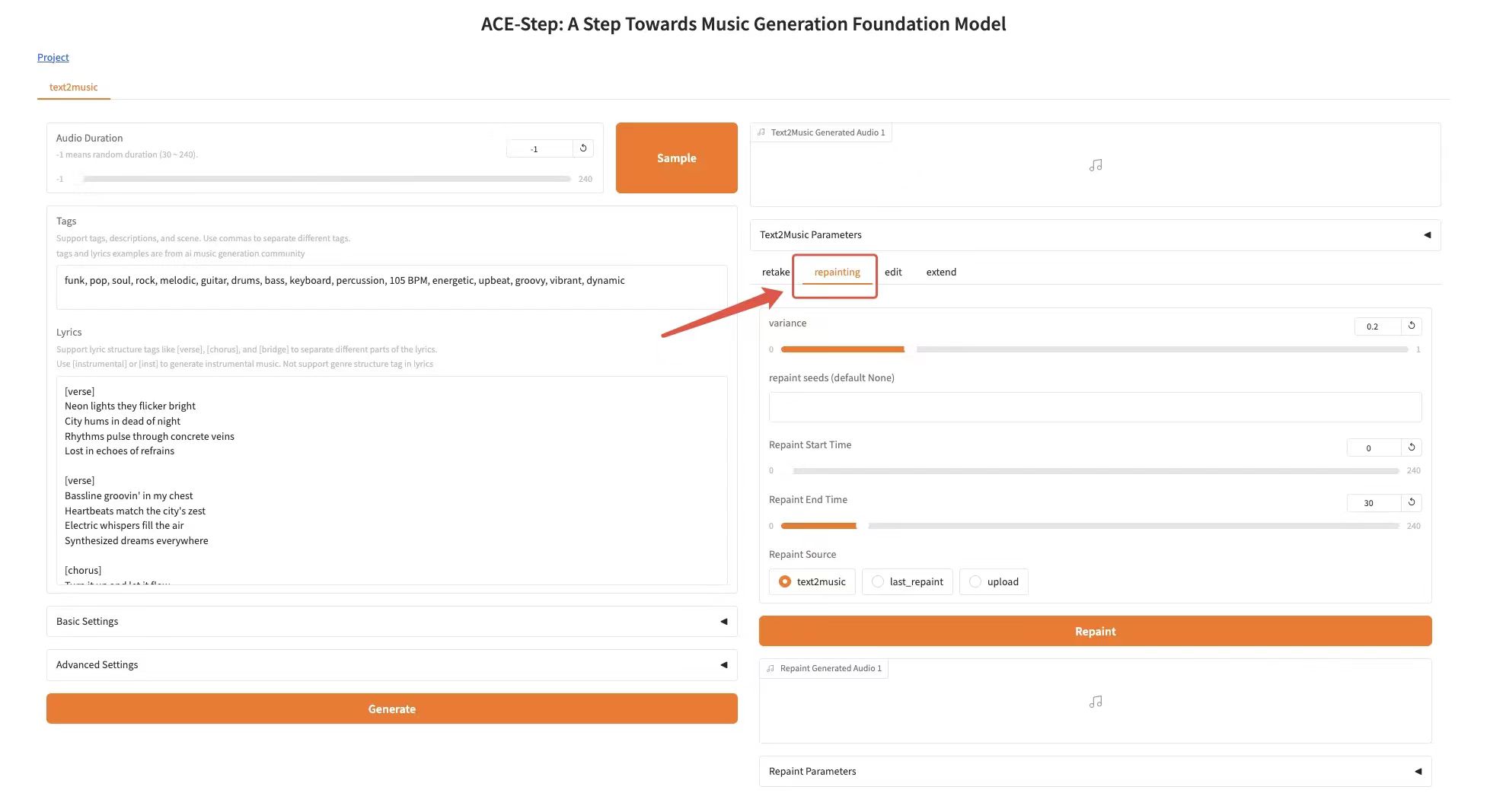

再描画タブ

関数:特定の音楽部分を選択的に再生する

* 分散: 分散

* 再取得シード(デフォルトなし): ランダムシード

* 再描画開始時間: 再生成する段落の開始時間を指定します

* 再描画終了時間: 再生成する段落の終了時間を指定します

* 再描画ソース: ソースオーディオを選択 (text2music、last_repaint、またはアップロード)

* 「再描画」ボタンをクリックして再生成します

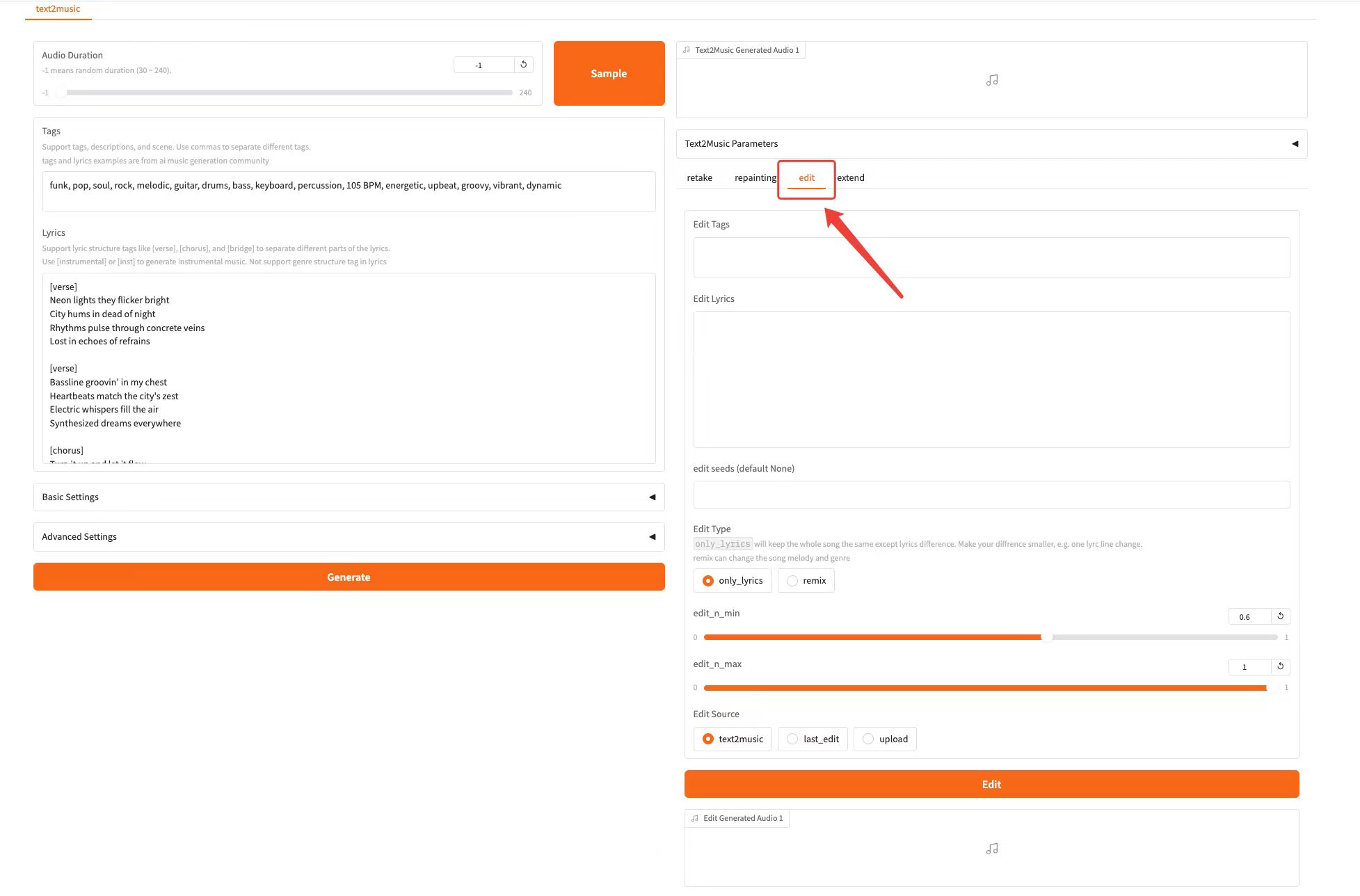

編集タブ

関数:編集パラメータを調整して、元の曲の保存度合いを制御します

* タグの編集: 既存の音楽に合わせてタグを変更します

* 歌詞の編集: 既存の音楽に合わせて歌詞を変更します

* シードを編集 (デフォルト: なし): ランダムシードを編集

* 編集タイプ: 編集タイプ。「only_lyrics」モード (元のメロディーを保持) または「remix」モード (メロディーを変更) を選択できます。

* 再描画終了時間: 再生成する段落の終了時間を指定します

* edit_n_min: 最小範囲を編集します

* edit_n_max: 最大編集範囲

* ソースを編集: リソースを編集

* 編集するには「編集」ボタンをクリックしてください

タブを拡張

関数:既存の音楽の最初または最後に音楽を追加する

* シードを編集 (デフォルト:なし): ランダムシードを拡散

* 左延長長さ: 左延長長さを指定します

* 右延長長さ: 右延長長さを指定します

* ソースの拡張: 拡張する必要があるソースオーディオを選択します

* 「拡張」ボタンをクリックして拡張します