Command Palette

Search for a command to run...

オンラインチュートリアル丨YOLO シリーズの重要な革新!清華大学チームがオープンシーン内のオブジェクトをリアルタイムで検出・セグメント化できるYOLOEをリリース

YOLO (You Only Look Once) は、2015 年の最初のリリース以来、コンピューター ビジョンの分野で最も影響力のあるリアルタイム オブジェクト検出モデルの 1 つになりました。 1 段階検出アーキテクチャに基づくこのエンドツーエンドのターゲット検出テクノロジは、過去 10 年間で 10 バージョン以上更新されています。高精度、高フレームレートの画像をリアルタイムに処理できるため、自動運転、医療画像解析、ロボットビジョンなど、さまざまな分野で幅広く活用されています。

しかし、従来のYOLOシリーズのモデルは畳み込みニューラルネットワークを使用して高性能なリアルタイム検出を実現していますが、ただし、これは事前に定義されたターゲット カテゴリに依存しており、実際のオープン シナリオでは柔軟性に欠けます。

この問題に対処するために、清華大学のチームはYOLOをベースに、オープン オブジェクト検出およびセグメンテーション モデル YOLOE が提案されており、テキスト プロンプト、視覚的なキュー、プロンプトなしの 3 つのシナリオをサポートしています。このマルチモーダル機能により、言語コマンドを理解し、画像を確認し、さらには新しいものを独自に発見することができ、まさに「すべてをリアルタイムで見る」ことを実現します。

現在、HyperAI公式サイトのチュートリアルセクションでは、ワンクリック展開チュートリアル「YOLOE: すべてをリアルタイムで見る」が公開されています。興味のある方はぜひ体験してみてください!

チュートリアルのリンク:

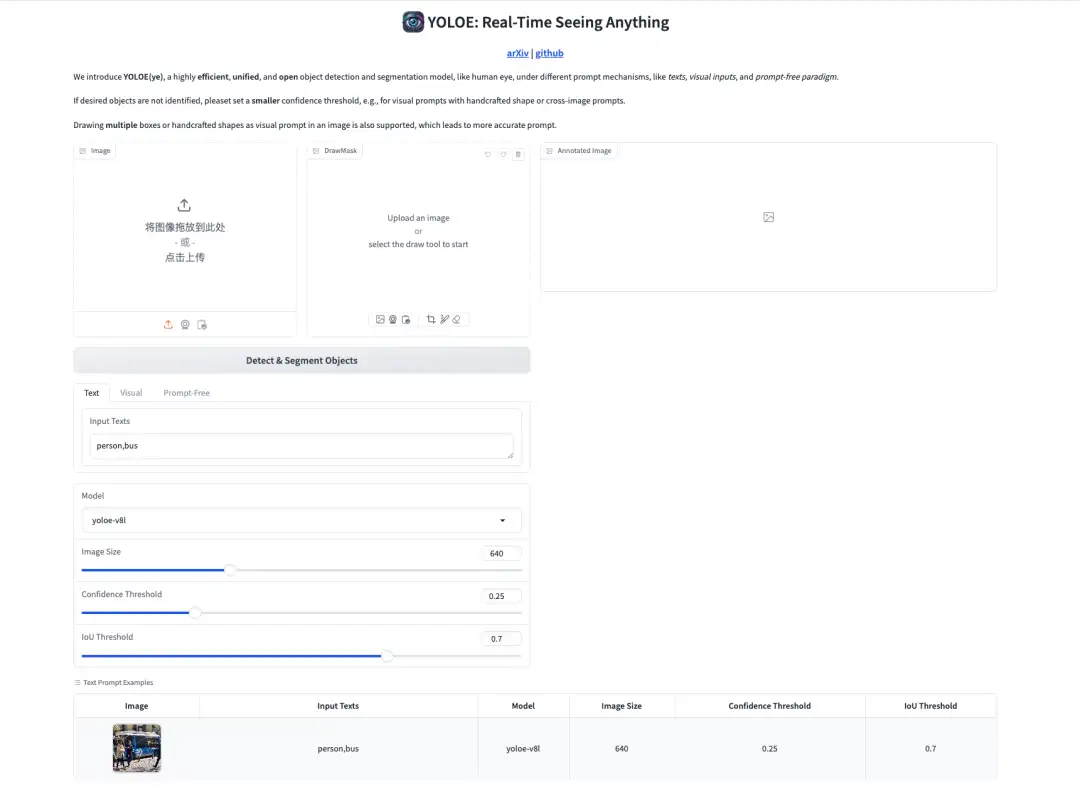

デモの実行

1. hyper.ai にログインし、チュートリアル ページで YOLOE: See Everything in Real Time を選択し、このチュートリアルをオンラインで実行をクリックします。

2. ページがジャンプしたら、右上隅の「クローン」をクリックしてチュートリアルを独自のコンテナにクローンします。

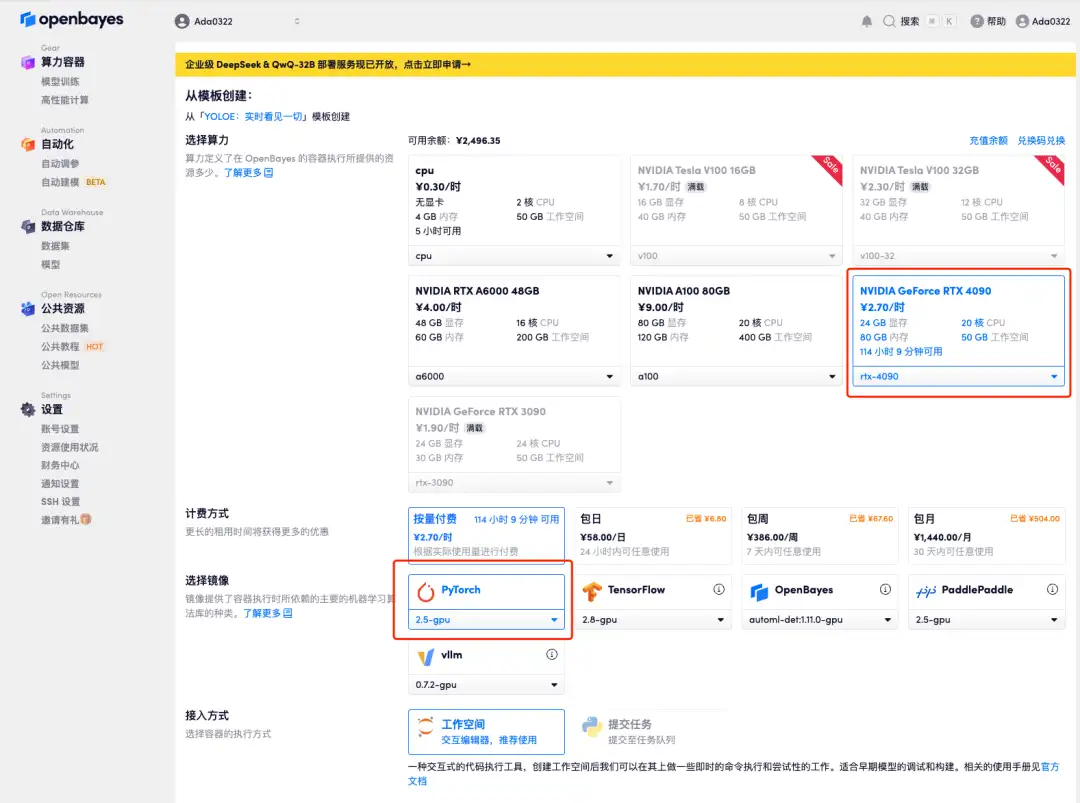

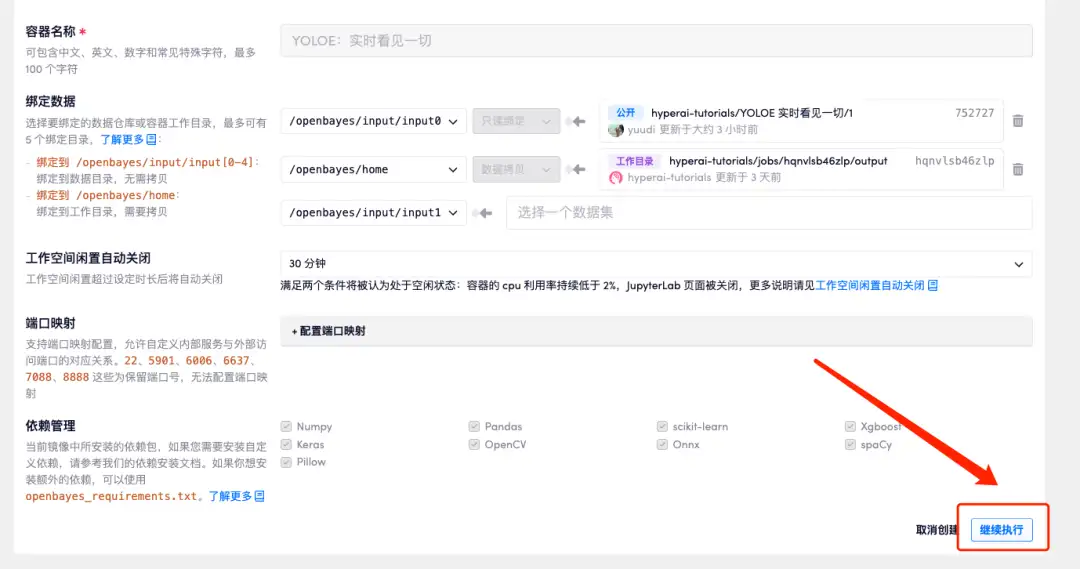

3. 「NVIDIA RTX 4090」と「PyTorch」のイメージを選択します。 OpenBayes プラットフォームは新しい課金方法を導入しました。ニーズに応じて、「従量課金制」または「日次/週次/月次パッケージ」を選択できます。 「続行」をクリックします。新規ユーザーは、以下の招待リンクを使用して登録すると、4 時間の RTX 4090 + 5 時間の CPU フリータイムを獲得できます。

HyperAI ハイパーニューラルの専用招待リンク (ブラウザに直接コピーして開きます):

https://go.openbayes.com/9S6Dr

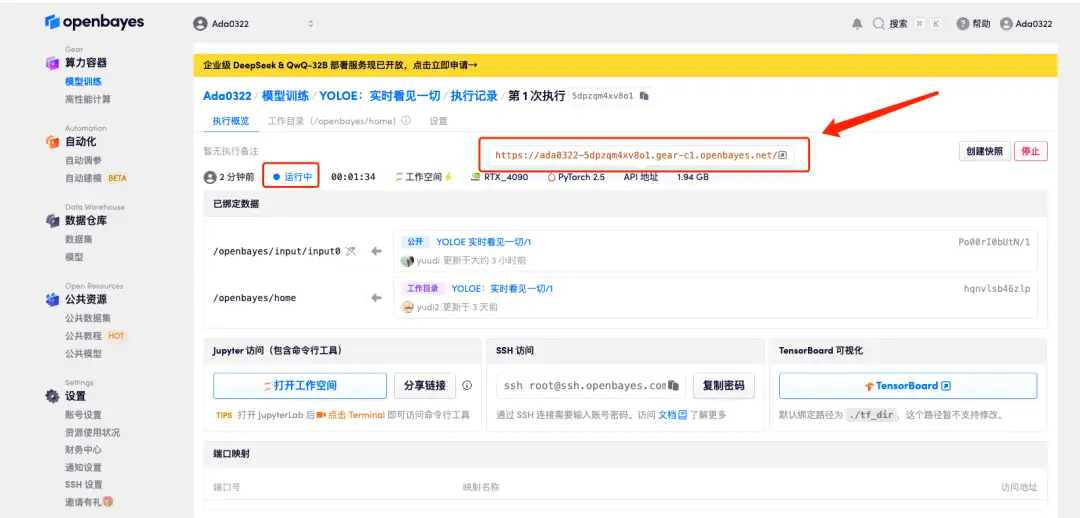

4. リソースが割り当てられるまで待ちます。最初のクローン作成プロセスには約 2 分かかります。ステータスが「実行中」に変わったら、「API アドレス」の横にあるジャンプ矢印をクリックしてデモ ページに移動します。モデルが大きいため、WebUI インターフェイスが表示されるまでに約 3 分かかります。そうでない場合は、「Bad Gateway」と表示されます。 APIアドレスアクセス機能を使用する前に、ユーザーは実名認証を完了する必要がありますのでご注意ください。

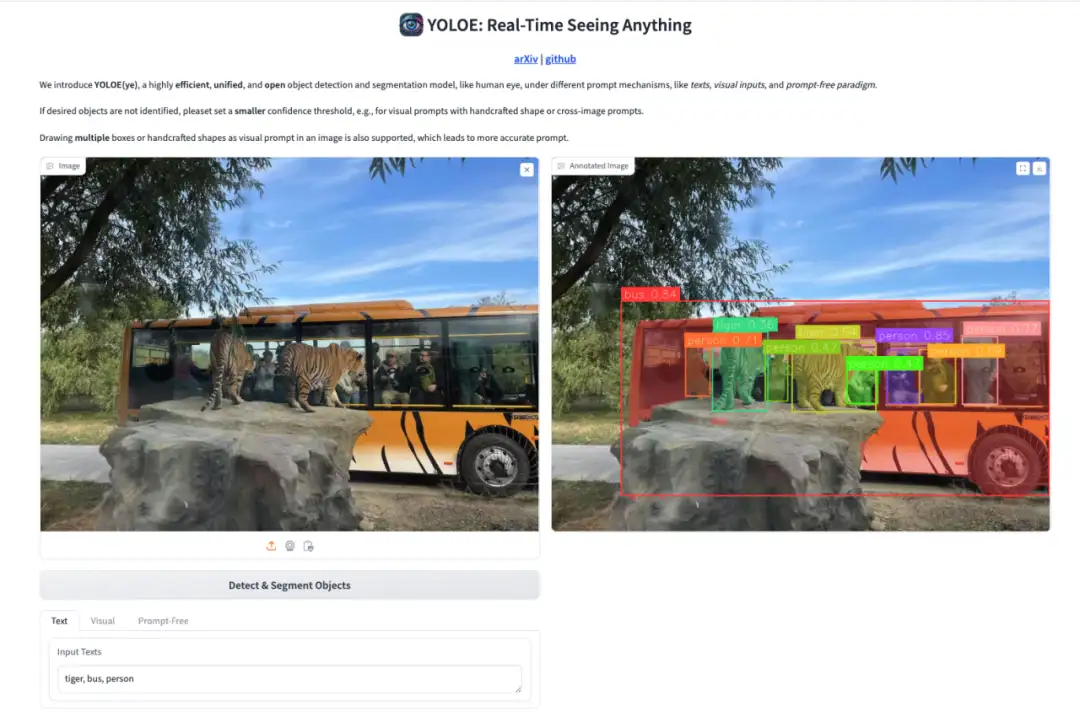

エフェクト表示

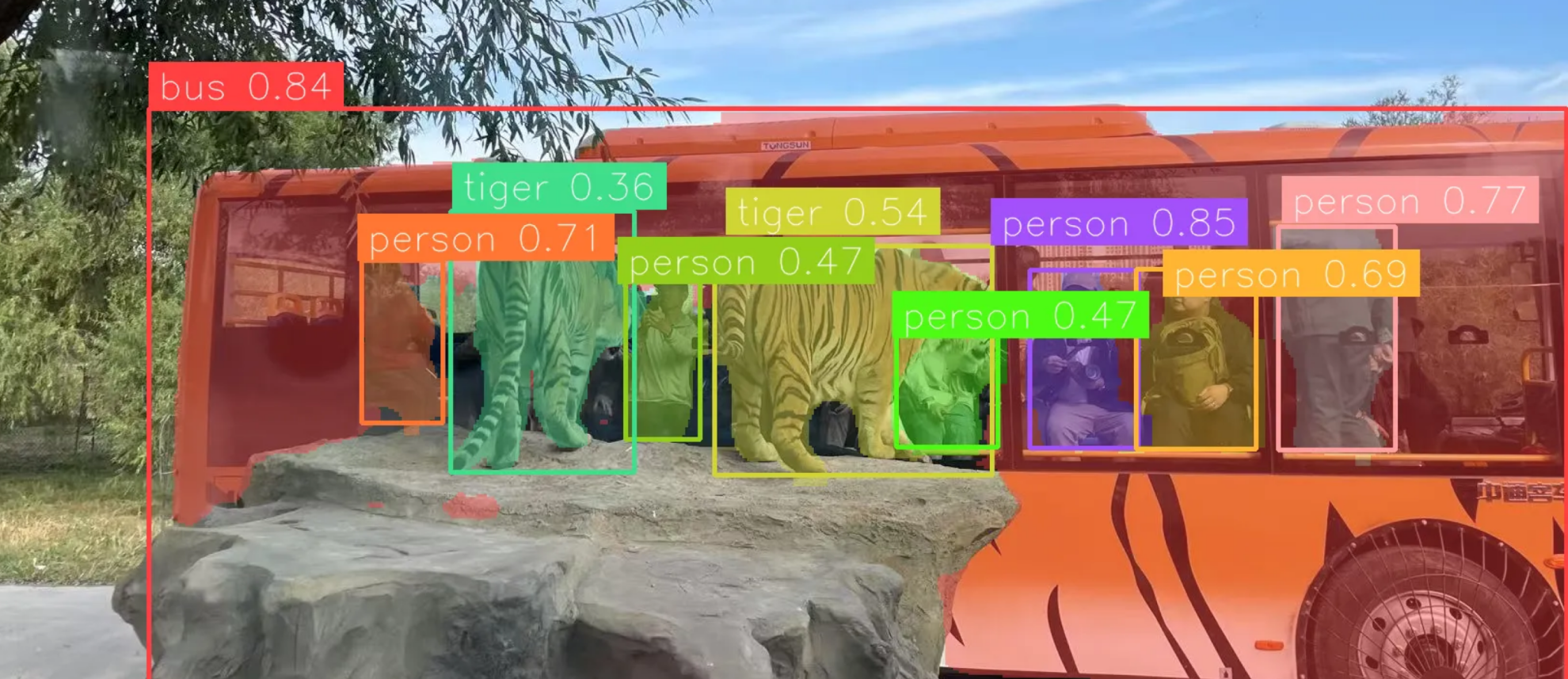

1つ目はテキストプロンプトの検出です。YOLOE は、あらゆるテキスト カテゴリのテキスト ヒントの検出とセグメンテーションをサポートします。下の図で入力されているテキストは「虎、バス、人」です。検出結果は右の図の通りで、写真に写っているトラ、観光バス、観光客が明確に識別されています。頭が隠れていたり、暗い場所にいる観光客でもはっきりと識別できることがわかります。

2つ目は視覚的な手がかりです。検出対象をボックス/ポイント/手描きの図形/参照画像で指定すると、次の図に示すように、類似の検出オブジェクトを正確に識別できます。

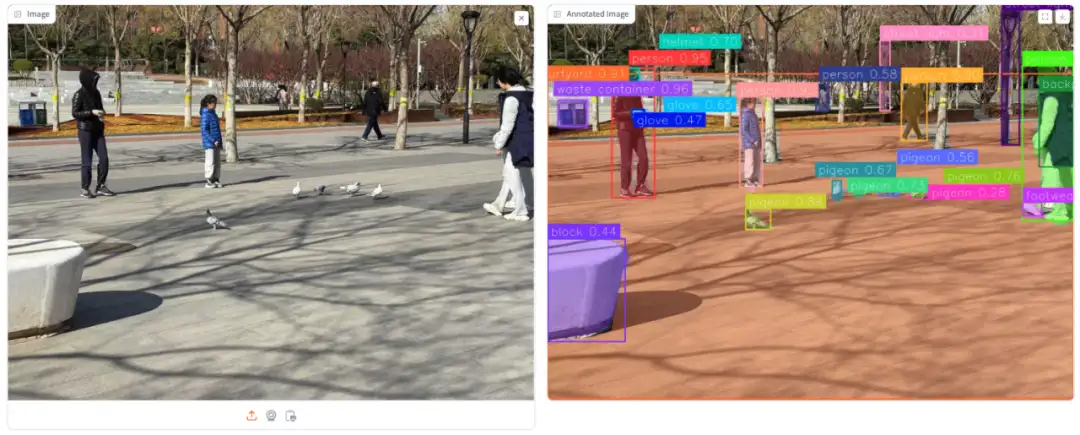

最後に、完全に自動のサイレント検出があります。次の図に示すように、シーン オブジェクトを自動的に識別できます。

以上が今回HyperAIが推奨するチュートリアルです。ぜひご自身でお試しください!

チュートリアルのリンク: