Command Palette

Search for a command to run...

オンラインチュートリアル丨超大規模モデルをストレスなくデプロイ! Llama 3.1 405B と Mistral Large 2 をワンクリックで実行

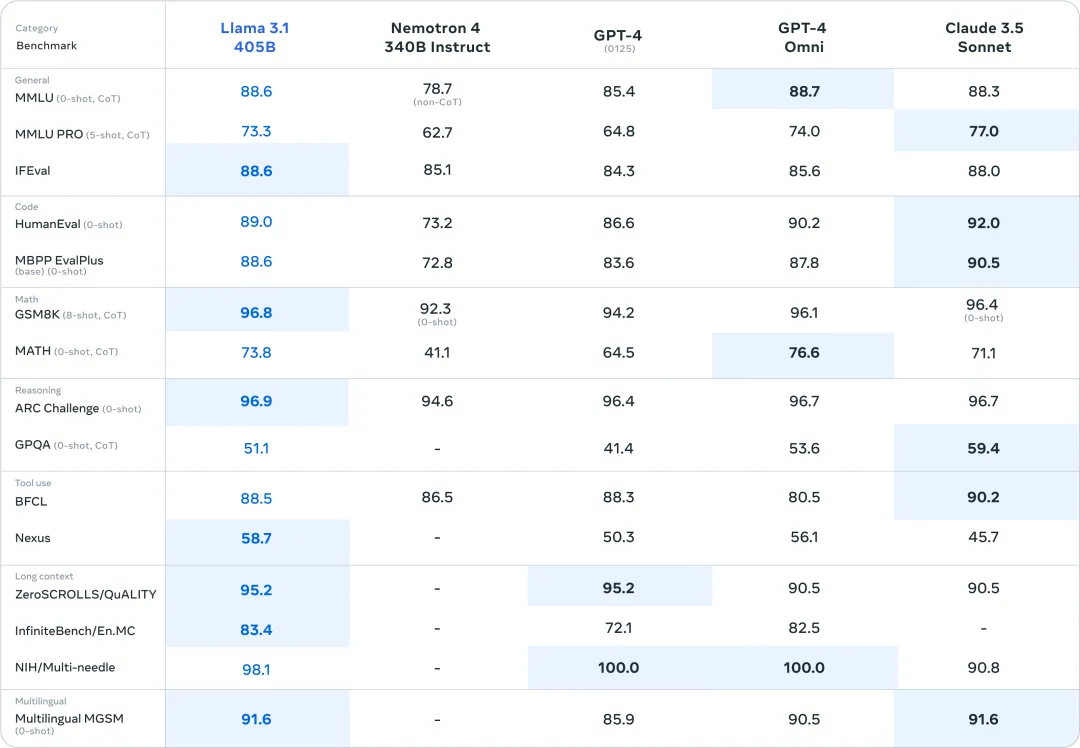

現地時間の 7 月 23 日、Meta は Llama 3.1 を正式にリリースしました。超大規模な 405B パラメータ バージョンは、複数のベンチマーク テストで、既存の SOTA モデル GPT-4o と同等かそれを上回るパフォーマンスを示しました。そしてクロード3.5。

ザッカーバーグ氏はまた、Llama 3.1のリリース日に「オープンソースAIが今後の進むべき道」と題した長い記事を書き、Llama 3.1が業界の転換点になると述べた。同時に、業界は Llama 3.1 が実証する強力な機能を試したいと考えている一方で、クローズドソースの大規模モデルがどのように引き継がれるかにも期待しています。

興味深いのは、Llama 3.1 がまだ王位を主張しつつある一方、Mistral AI が Mistral Large 2 をリリースし、405B モデルの「弱点」である展開の難しさを直接狙うことで、より積極的なアプローチをとっているということです。

405B パラメータ スケールに必要なハードウェア機能が個人の開発者にとって簡単に越えられる敷居ではないことは疑いなく、ほとんどの愛好家は近づかないしかありません。 Mistral Large 2 モデルのパラメータ サイズはわずか 123B で、Llama 3.1 の 405B の 3 分の 1 以下であり、導入しきい値も低くなりますが、そのパフォーマンスは Llama 3.1 と同等です。

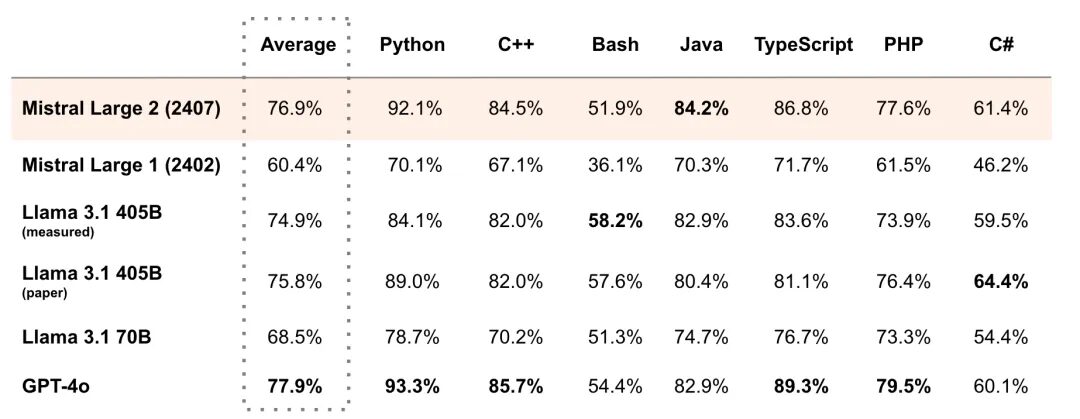

たとえば、MultiPL-E の複数のプログラミング言語ベンチマークでは、Mistral Large 2 の平均スコアは Llama 3.1 405B を上回り、GPT-4o よりも 1% 遅れており、Python、C++、Java などでは Llama 3.1 405B を上回っています。公式の主張どおり、Mistral Large 2 はパフォーマンス/サービスコストの評価指標の面で新たな境地を開拓します。

一方には現在のオープンソースモデルのパラメータスケールの「天井」があり、もう一方には非常に高い「費用対効果」を備えたオープンソース新時代のリーダーであることを友人は望んでいないのだと思います。見逃してください!心配しないでください。HyperAI は、Llama 3.1 405B および Mistral Large 2407 のワンクリック導入チュートリアルを開始しました。コマンドを入力する必要はなく、「クローン」をクリックするだけで体験できます。

* Open WebUI を使用して、ワンクリックで Llama 3.1 405B モデルを展開します。

* Open WebUI を使用して、ワンクリックで Mistral Large 2407 123B を展開します。

同時に、高度なチュートリアルも用意されており、ニーズに応じて選択できます。

* Llama 3.1 405B モデル OpenAI 互換 API サービスのワンクリック展開:

* Mistral Large 2407 123B モデル OpenAI 互換 API サービスのワンクリック展開:

編集者は Open WebUI を使用して Mistral Large 2407 123B をワンクリックで導入し、大型モデルでよくある「9.9 と 9.11 のどちらが大きいか」という問題についてテストを実施しましたが、Mistral Large 2 もその影響を受けませんでした。

興味のある方はぜひ体験してみてください。詳しいチュートリアルは以下の通りです⬇️

デモの実行

このテキスト チュートリアルでは、「Open WebUI を使用した Mistral Large 2407 123B のワンクリック デプロイメント」と「Llama 3.1 405B モデル OpenAI 互換 API サービスのワンクリック デプロイメント」を例として、誰でも簡単に操作手順を説明します。

Open WebUI を使用してワンクリックで Mistral Large 2407 123B を導入

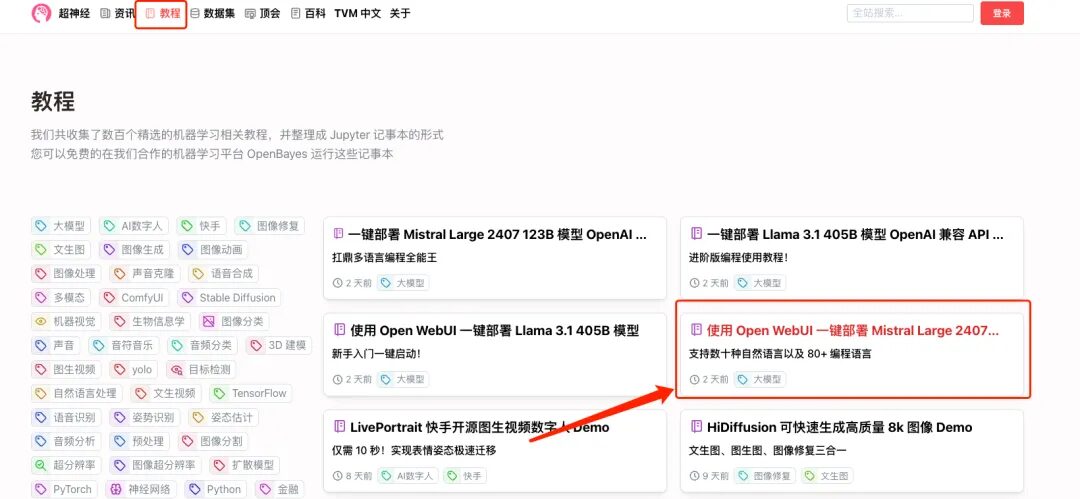

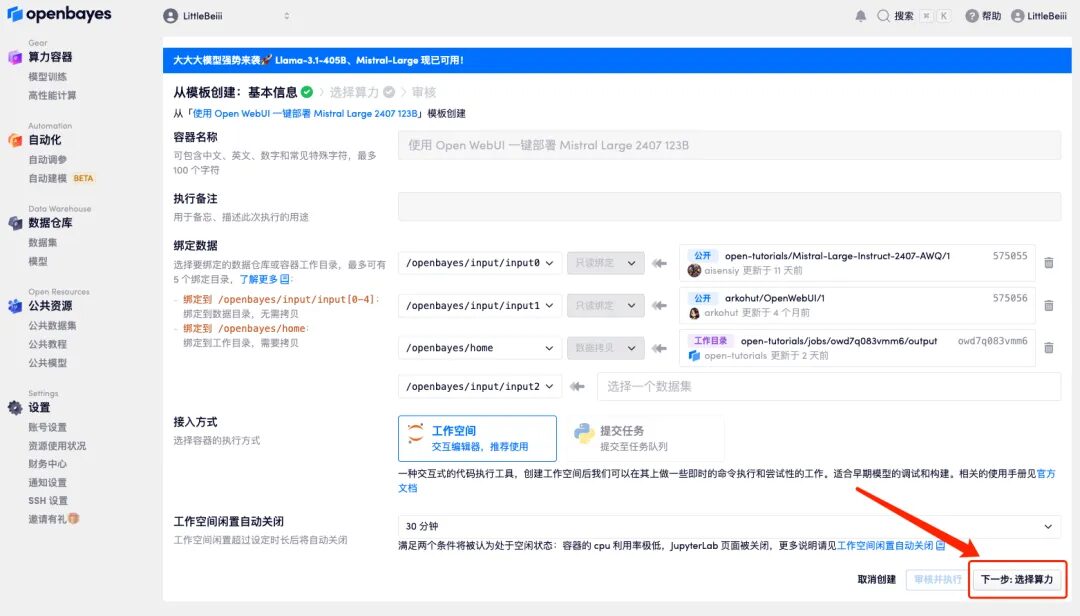

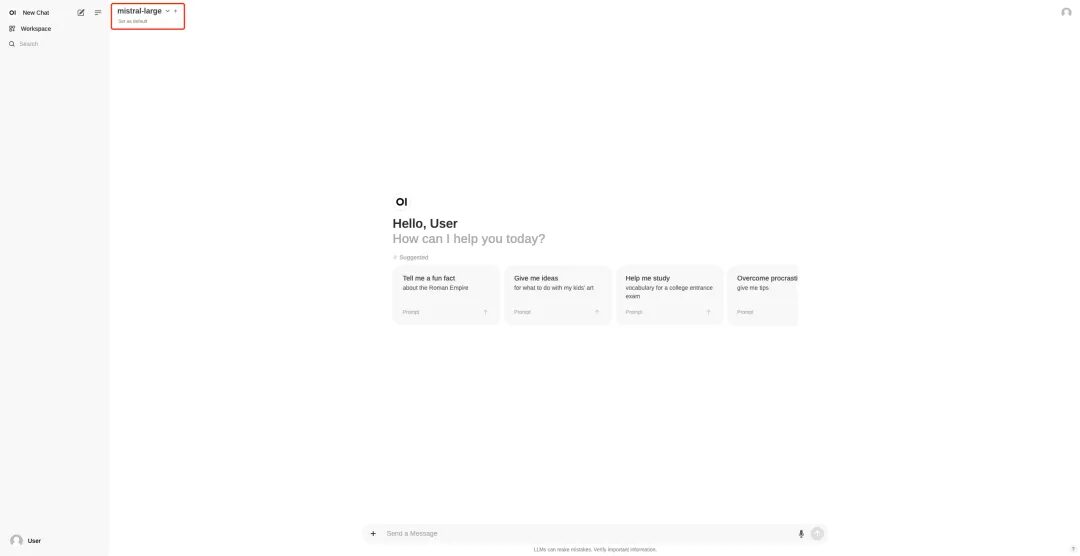

1. hyper.ai にログインし、「チュートリアル」ページで「Open WebUI を使用して、ワンクリックで Mistral Large 2407 123B を展開する」を選択し、「このチュートリアルをオンラインで実行する」をクリックします。

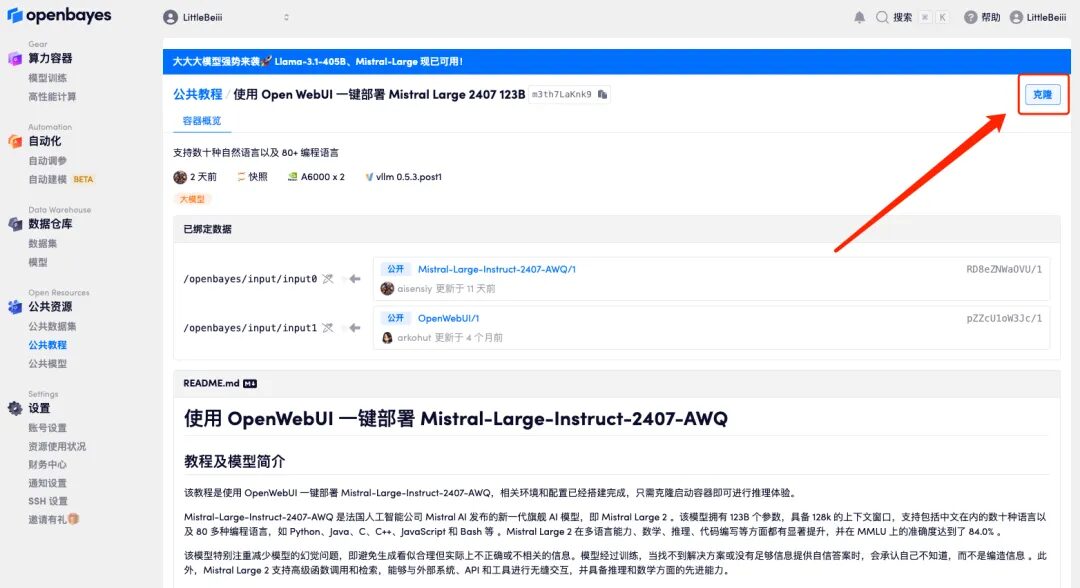

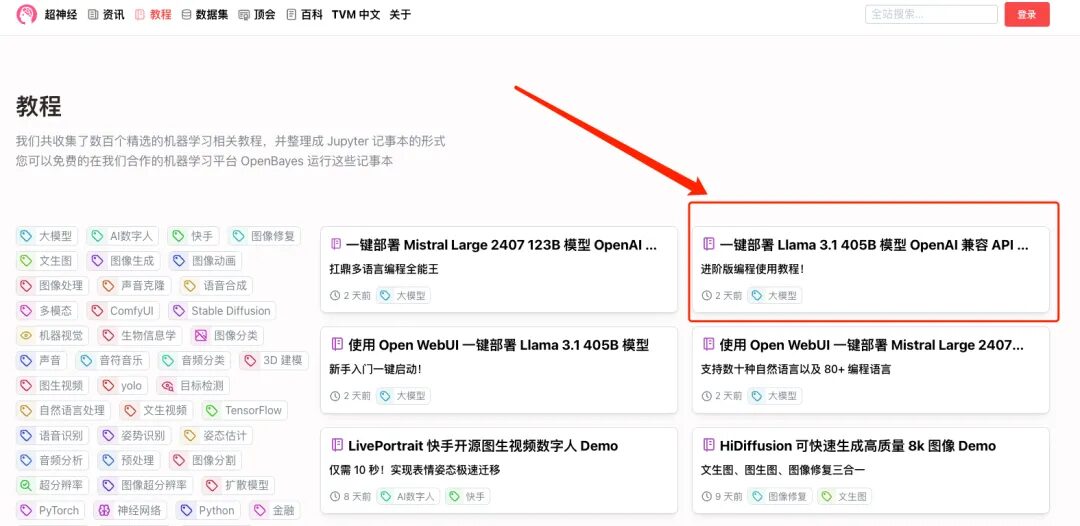

2. ページがジャンプしたら、右上隅の「クローン」をクリックしてチュートリアルを独自のコンテナにクローンします。

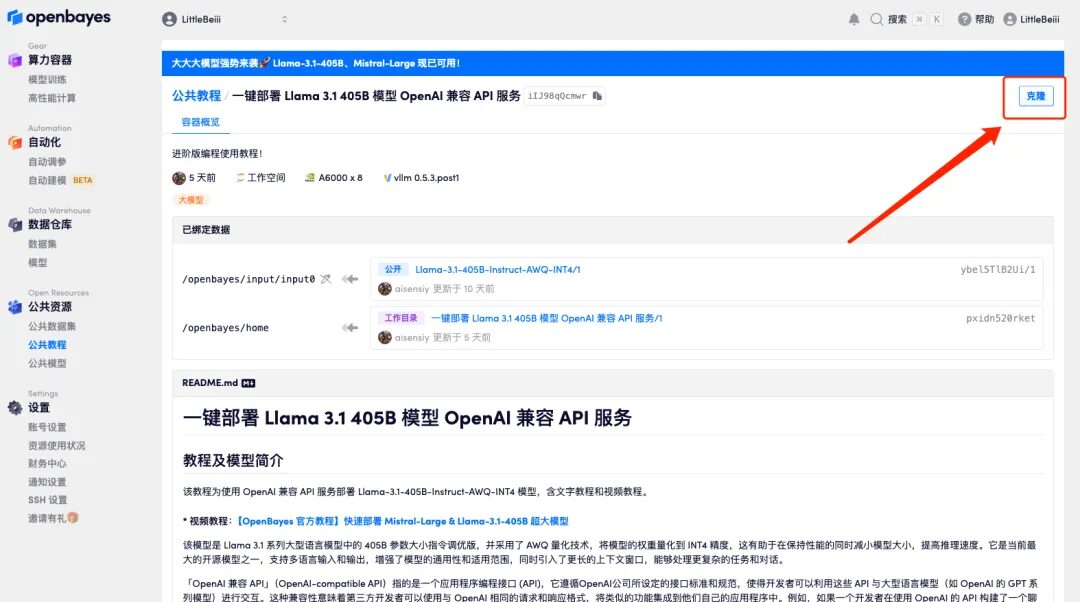

3. 右下隅の「次へ: コンピューティング能力の選択」をクリックします。

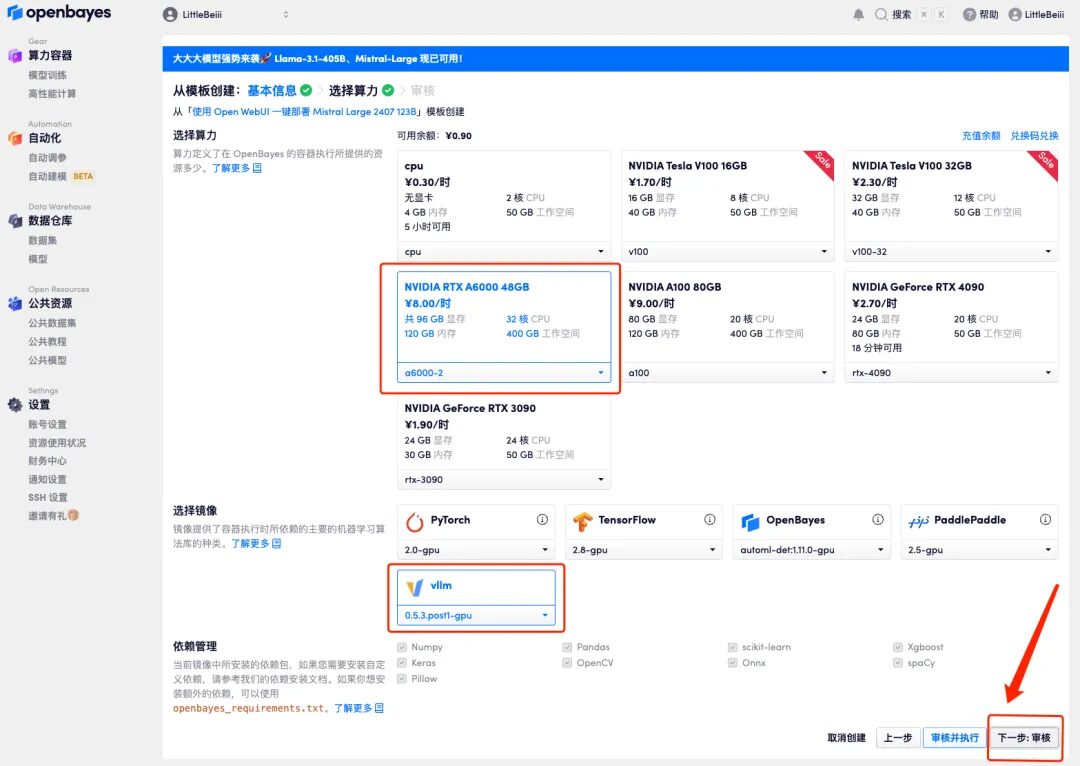

4. ページがジャンプしたら、「NVIDIA RTX A6000-2」と「vllm」のイメージを選択し、「次へ: 確認」をクリックします。以下の招待リンクを使用してサインアップした新規ユーザーは、4 時間の RTX 4090 + 5 時間の CPU を無料で入手できます。

HyperAI ハイパーニューラルの専用招待リンク (ブラウザに直接コピーして開きます):

https://openbayes.com/console/signup?r=6bJ0ljLFsFh_Vvej

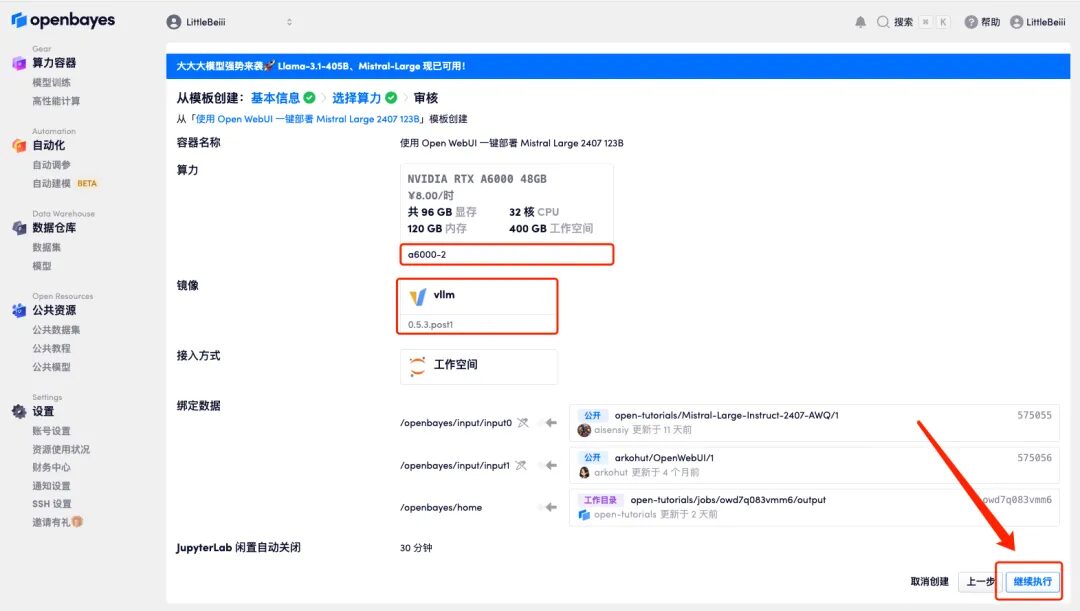

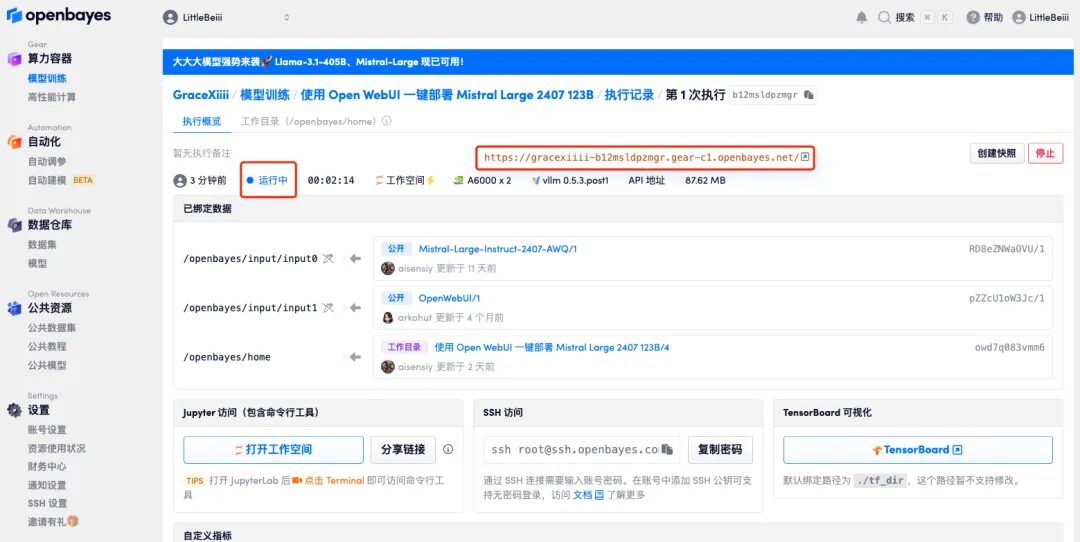

5. すべてが正しいことを確認したら、[続行] をクリックし、最初のクローンが割り当てられるまで待ちます。ステータスが「実行中」に変わったら、「API アドレス」の横にあるジャンプ矢印をクリックしてデモ ページにジャンプします。APIアドレスアクセス機能を利用するには実名認証が必要となりますのでご注意ください。

10 分以上「リソースを割り当てています」状態が続く場合は、コンテナを停止して再起動してみてください。再起動しても問題が解決しない場合は、公式 Web サイトのプラットフォーム カスタマー サービスにお問い合わせください。

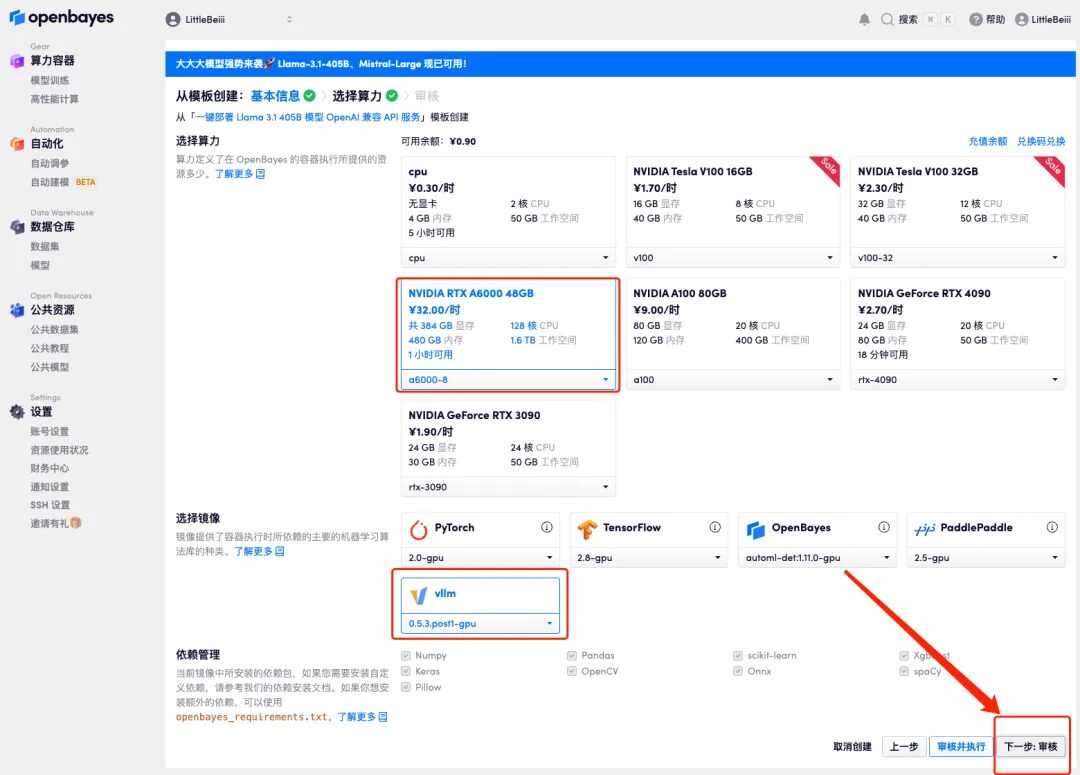

6. デモを開いたら、すぐに会話を開始できます。

Llama 3.1 405Bモデル OpenAI対応APIサービスをワンクリックで導入

1. OpenAI 互換 API サービスをデプロイしたい場合は、チュートリアル インターフェースで「Llama 3.1 405B モデル OpenAI 互換 API サービスのワンクリック デプロイ」を選択し、同様に「チュートリアルをオンラインで実行する」をクリックします。

2. ページがジャンプしたら、右上隅の「クローン」をクリックしてチュートリアルを独自のコンテナにクローンします。

3. 右下隅の「次へ: コンピューティング能力の選択」をクリックします。

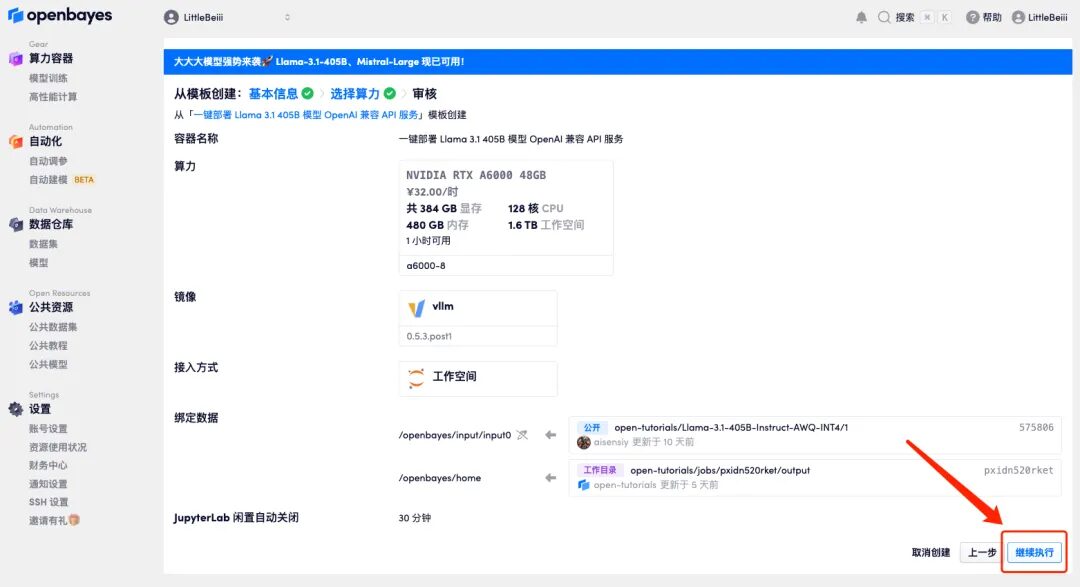

4. ページがジャンプした後、モデルが大きいため、コンピューティング リソースとして「NVIDIA RTX A6000-8」を選択する必要がありますが、イメージとしては「vllm」が選択されたままです。「次へ: レビュー」をクリックします。

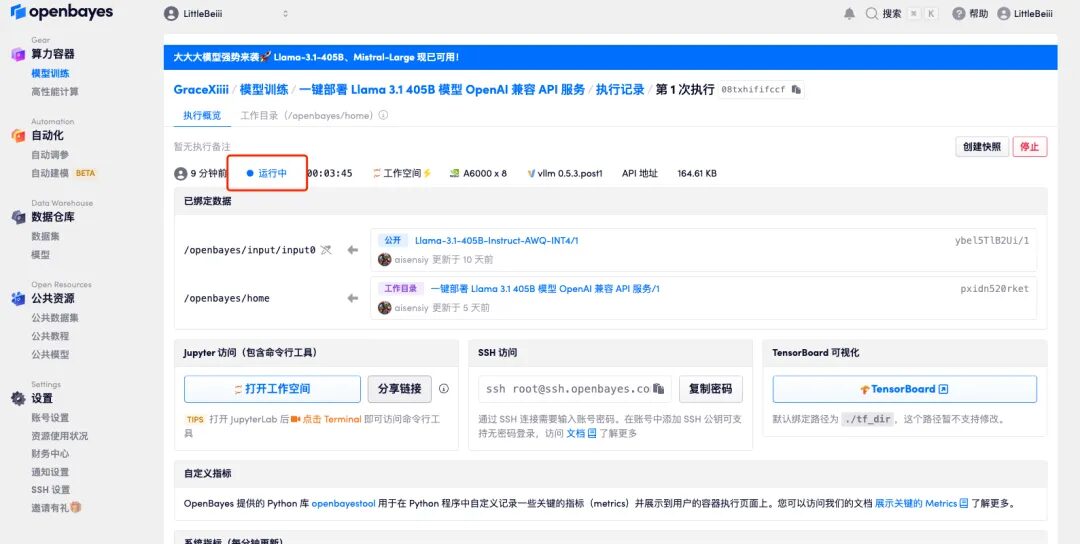

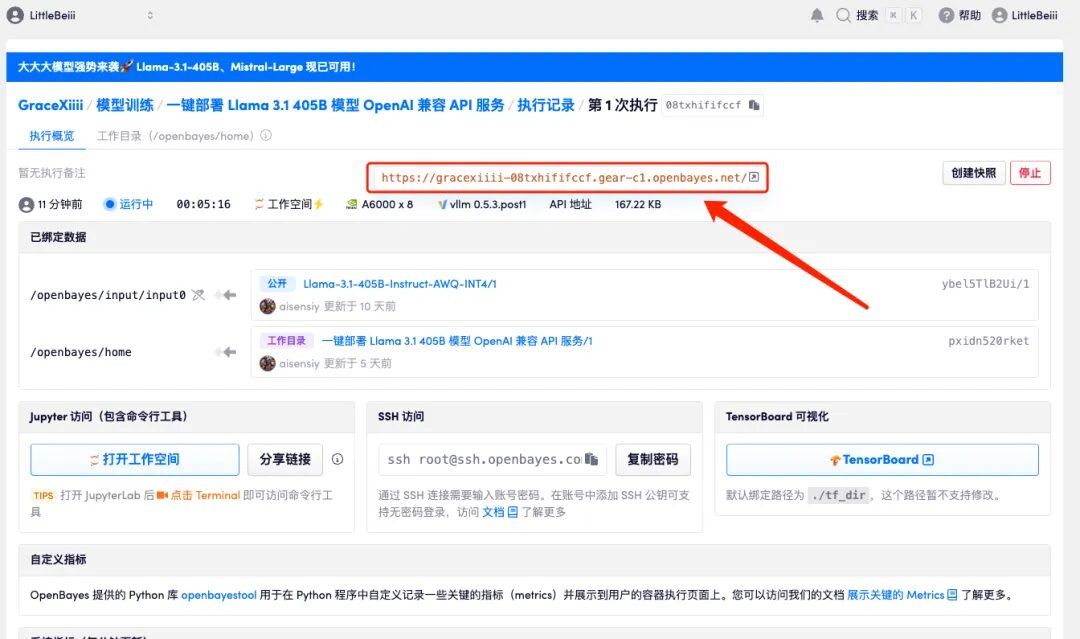

5. すべてが正しいことを確認したら、[続行] をクリックし、リソースが割り当てられるまで待ちます。ステータスが [実行中] と表示された後、モデルのロードが自動的に開始されます。

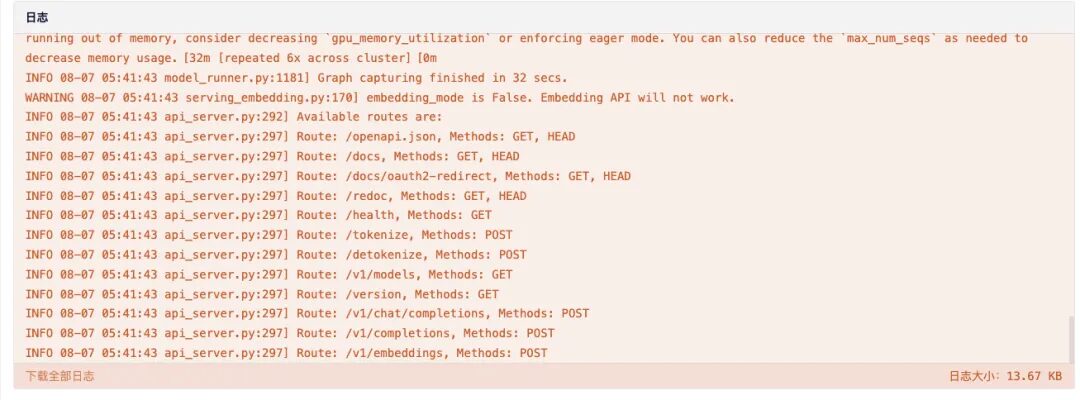

6. インターフェースを一番下に引き下げると、ログに次のルーティング情報が表示されます。これは、サービスが正常に開始されたことを意味します。

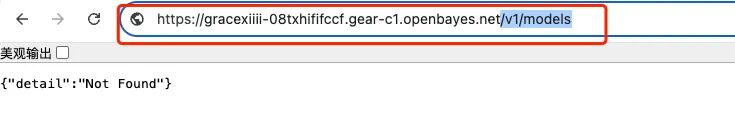

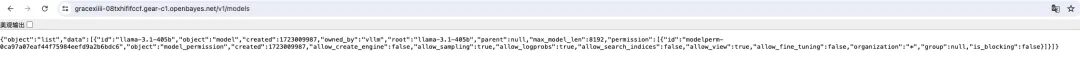

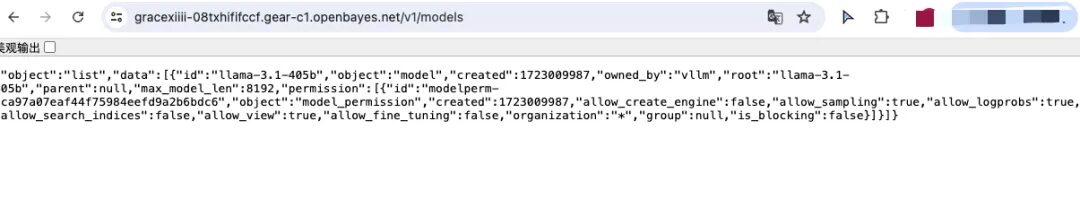

7. 開くと、デフォルトで 404 情報が表示されます。赤いボックスにパラメータ「/v1/models」を追加して、現在のモデルのデプロイメント情報を表示します。

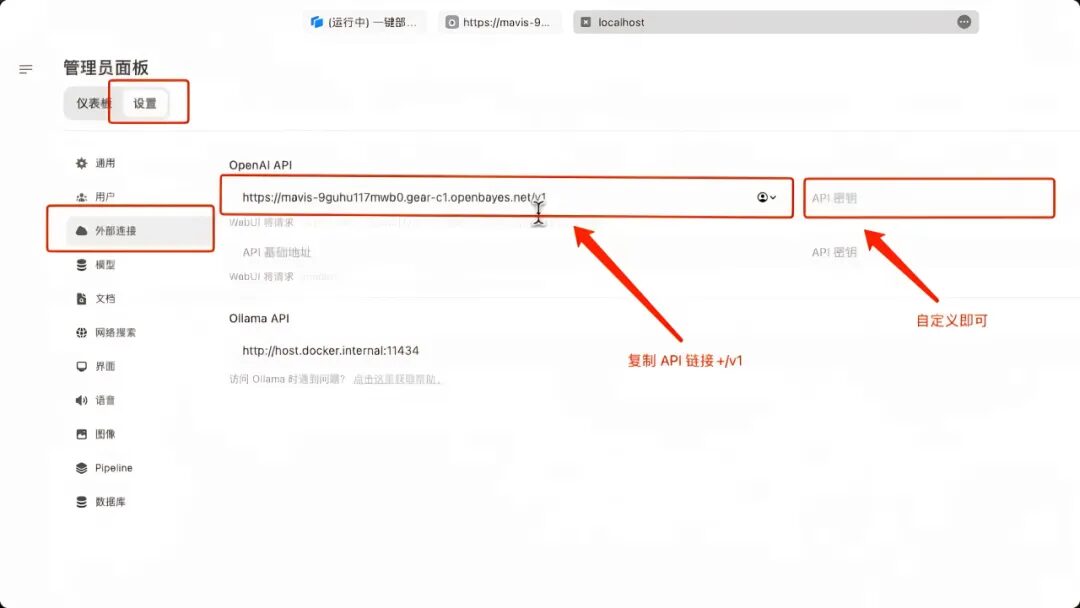

8. Open WebUI サービスをローカルで開始し、「外部接続」で追加の接続を開き、「OpenAPI」と ➕「/v1」に前の API アドレスを入力します。ここでは「API キー」が設定されていません。入力を定義するだけです。 。右下隅にある「保存」をクリックします。

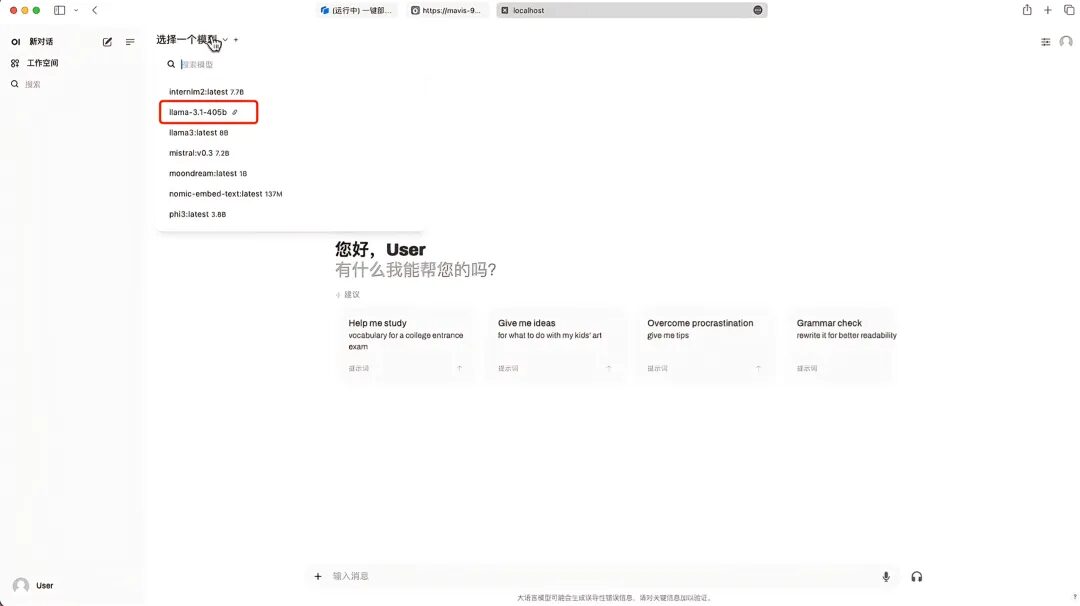

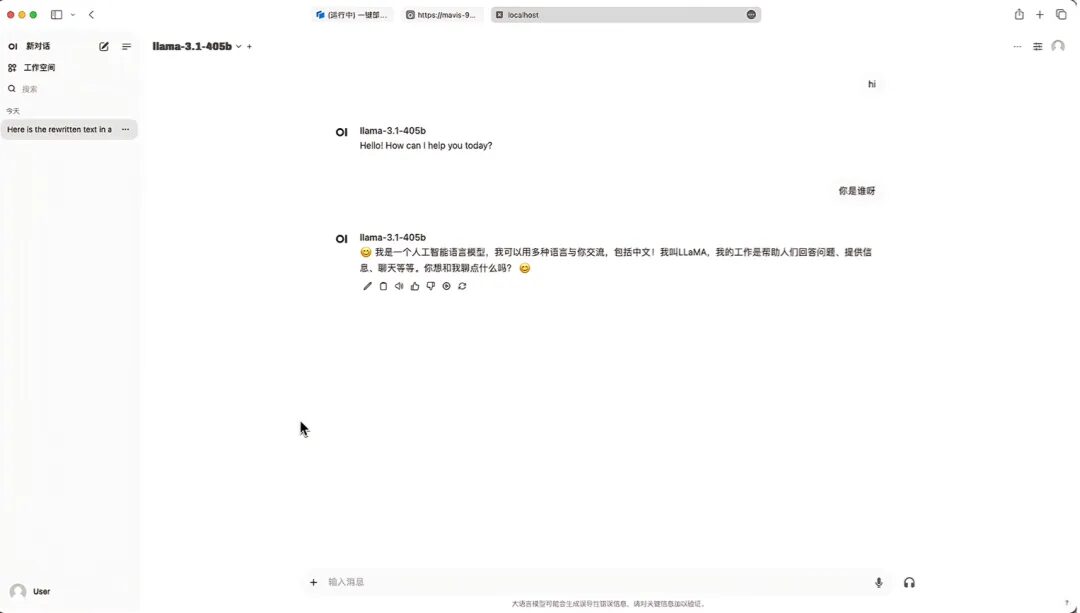

9. 保存後、「モデルの選択」に Llama-3.1-405B が表示されます。モデルを選択したら、会話を開始できます。

最後に、興味のある友人は QR コードをスキャンして参加できる、オンラインの学術共有アクティビティをお勧めします。