Command Palette

Search for a command to run...

科学技術省が行動を起こす!科学研究者向けの AIGC ユーザー マニュアルがここにあり、学術コミュニティは AI ガンマンに対する警戒を開始しています

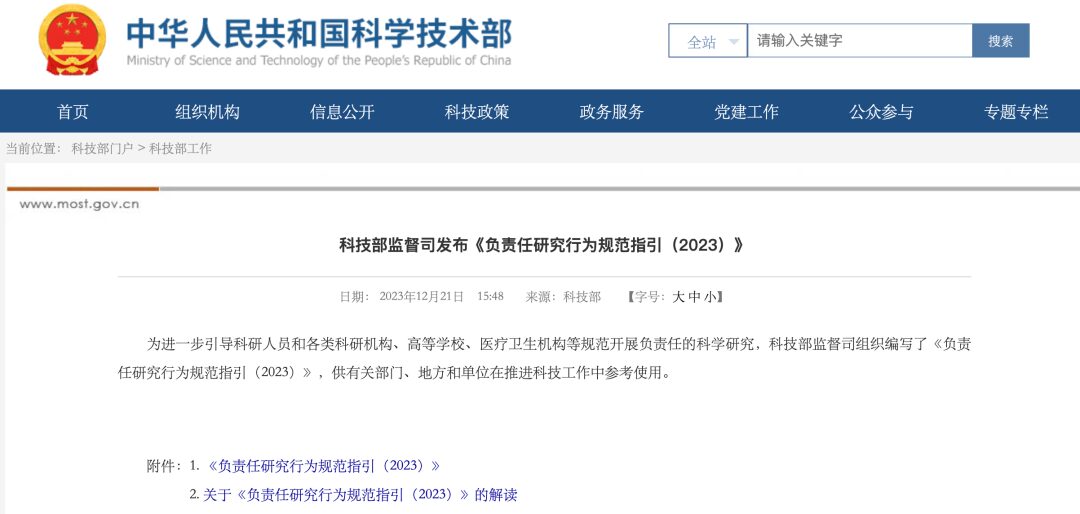

科学技術省監督局は「責任ある研究行動に関するガイドライン(2023年)」を発行し、人工知能や社会的に懸念される重大な成果の発表などのホットな問題について、明確に境界線を引いている。

実験データの改ざん、実験写真の改ざん、論文への不適切な署名、教科書の文章の盗用…1月16日午後、華中農業大学の学生11人が125ページの報告書で同校の苗字が黄であることを実名で報告した。教授は学術上の不正行為を犯した。一時は世論が急速に高まり、「学問の無実を守るために未来に賭ける」や「誰もが学術詐欺の被害者である」などの関連コンテンツが主要プラットフォームで激しい議論を巻き起こした。

一部のネチズンは、2,300回以上引用され、16年間にわたって世界のアルツハイマー病研究を誤解させてきた、アルツハイマー病に関する先駆的な論文の以前の改ざんを思い出した。

雑念を一切持たずに真実を求めるなら、芸術が深遠でなければ何も言うことはありません。過去 100 年にわたり、学問の誠実さと人類に利益をもたらすという崇高な信念が、多くの学生を科学研究の道に導く灯台となってきました。しかし、今日では、名声と富の誘惑がますます混入し、学問につながっています。繰り返し禁止される詐欺。特にAIや大型モデルなどのテクノロジーの急速な発展に伴い、新興テクノロジーは科学研究不正行為の「共犯者」となっており、研究を続ける研究者にとって不公平であるだけでなく、虚偽の研究データは重大な結果をもたらす可能性もあります。

したがって、学術不正を厳しく捜査する一方で、科学研究におけるAIなどの技術の応用を規制することも非常に重要です。

明確な境界線を引き、生成人工知能を規制に従って適切に使用する

不正な学術論文には長い歴史があり、盗作、データの捏造、その他の従来の手段に加えて、執筆者や「製紙工場」にお金を払って執筆を依頼したり、論文を捏造したりすることも一般的です。

現在では、ChatGPT(AIGC)人々が論文を書くのに新たな助けとなることが判明した。トピックの選択から原稿の推敲、統計分析からグラフの作成まで...その機能は非常に強力で、学術論文執筆プロセスのほぼすべての側面をカバーしており、科学研究者が文献の検索、データ処理、翻訳、および分析を迅速に完了するのに実際に役立ちます。研磨など

しかし、AIGC が生成したテキストを研究者が自分の創作物とみなすと、無価値な「学術バブル」が大量に発生します。さらに、信頼性の低い研究結果を生み出すために AIGC に過度に依存すると、科学研究の信頼性が大幅に低下します。

2023年12月21日科学技術省監督局は「責任ある研究の実施に関するガイドライン(2023年)」(以下「」という)を発行しました。ガイドライン》)、人工知能や社会にとって大きな関心のある主要な成果の発表など、ホットな問題には赤い線が明確に引かれています。

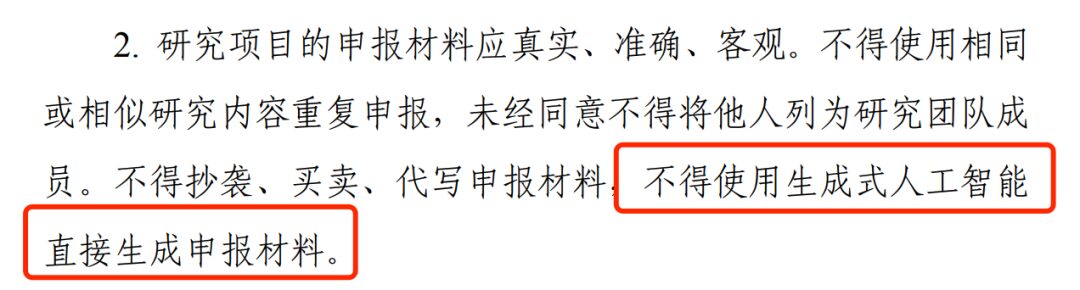

「ガイドライン」は、研究テーマの選択と実施のセクションで次のように指摘しています:科学研究者の研究プロジェクトの申請資料は、真実、正確、客観的でなければなりません。同一または類似の研究内容を繰り返して宣言することはできません。また、同意なしに他の者を研究チームのメンバーとしてリストすることはできません。応募資料の盗作、取引、またはゴーストライティングは許可されません。生成人工知能は、アプリケーション資料を直接生成するために使用されないものとします。

関連する法律、規制、学術規範を遵守し、データの偽造や改ざんなどのリスクを防ぐために、規制に従ってテキスト、データ、または学術画像を処理するために生成人工知能を合理的に使用する必要があります。

文献の引用に関しても、「ガイドライン」は次のように明確に規定しています。生成人工知能を使用して生成されたコンテンツ、特に事実や意見などの重要なコンテンツが含まれる場合、信頼性と正確性を確保し、引用を尊重するために、その生成プロセスを明確にラベル付けして説明する必要があります。他者の知的財産権。他の著者によって人工知能によって生成されたものとしてマークされているコンテンツは、通常、原文献として引用すべきではありません。実際に引用する必要がある場合は、説明を与える必要があります。生成 AI によって生成された参照は、検証なしに直接使用することはできません。

「ガイドライン」は、研究の実施、データ管理、結果の著者と出版、文献の引用に関して、生成型人工知能の合理的な使用の境界を明確にします。これらは、科学研究の信頼性と倫理原則を保護する上で非常に重要です。生成型人工知能の不適切な使用を防止します。生成型 AI と関連テクノロジーを責任を持って使用します。

国内外の有名雑誌がAI生成論文を規制

学術論文における不正行為は世界的な問題となっており、生成型 AI の出現により、ChatGPT などのチャットボットが「真剣に嘘をつき、自分を正当化する」能力を備えているため、こうした人々に利便性がもたらされています。しかし、規制や仕様の明確化に加えて、AIGC利用の境界が明確になるにつれ、国内外の学術機関が合意に達し、AIの利用に向き合い、標準化を始めているところが増えてきました。

多くの国内ジャーナルは、寄稿者が論文作成プロセスで AI を使用できるさまざまな方法を制限する声明を発表しました。 「Journal of Jinan」、「Journal of Literature and Data」、「China Science and Technology Journal Research」、「Think Tank Theory and Practice」、「Library and Information Work」などの雑誌はすべて、次のような声明を発表した。論文の主要な内容がAIツールを利用して生成されている場合、発見されれば学術不正として対処される。

外国の学術雑誌も論文執筆における AI の適用を標準化しています。不完全な統計によると、Nature、Cell、The Lancet、 自工会』(Journal of the American Medical Association)やその他のトップジャーナルは、次のような声明を発表しました。AI は著者権を付与するものではないため、AI を使用する研究者は原稿にこれを示す必要があります。

AI を使用して AI を倒し、紙の「砲手」を明らかにします

AI の開発を促進するには、効果的な技術的手段を使用する必要があります。現在の技術レベルでは、AI によって生成された論文は元の論文と形式が似ており、従来のテキスト類似性比較ツールではそれらを正確に検出できない可能性があることに注意してください。そのため、国内外で AIGC 専用の検出ツールの探索と開発が行われています。

「AI 生成コンテンツ識別子の中心的なアイデアは、まず実際のコンテンツと AI 生成コンテンツを含むトレーニング データ セットを構築し、次に 2 種類のコンテンツを区別する分類子をトレーニングすることです。」 -MILA研究所の著名な中国学者がメディアインタビューで説明を受け入れた。

具体的には、AI 言語モデルは、一度に 1 つずつ単語を予測して生成することによって機能します。単語を生成した後、透かしアルゴリズムは言語モデルの語彙を「グリーン リスト」と「レッド リスト」にランダムに分割し、モデルに「グリーン リスト」の単語を選択するように促します。記事内のグリーンリストに含まれる単語が多いほど、そのテキストが機械によって生成された可能性が高く、ランダムな単語の組み合わせが含まれる傾向があります。

簡単に言えば、AIGC検出技術は「AIを使ってAIを倒す」というものです。膨大なテキストとデータのサンプルに基づいて、平均文の長さ、語彙の多様性、テキストの長さの点で人間と AIGC ツールの違いを特定し、それによって AI 論文の「砲手」を特定できます。

しかし、これには技術的な問題がいくつかあります。たとえば、言語モデルは人間が作成したテキストに近づくほど、区別が難しくなります。 、テキストの長さによっても検出が制限されます。テキストの長さが十分に長い場合にのみ、検出の精度が保証されます。

科学研究では AI を合理的に使用し、窒息による食事の放棄を避けてください。

科学のための AI このアプリケーションの成功により、科学研究者はテキストやデータ処理からある程度「救われ」、研究そのものに集中できるようになり、効率がある程度向上し、科学研究の進歩が加速する可能性があります。さらに、人工知能は、一部の詳細で複雑な科学研究内容の探索を完了するのに劣りません。

たとえば、予測モデルは近年医学研究の分野で大きな注目を集めていますが、一部の新人科学研究者は頭を悩ませています。 AI は、研究者が適切なモデルを迅速に構築できるよう、アイデアや手法を徐々に確立していきます。

別の例として、実験計画と最適化の観点では、AI は実験の目的、方法、材料などの情報を提供するだけで詳細な実験計画を生成できるため、研究者が既存の計画を評価して最適化し、実験の消費量を削減するのに役立ちます。

要するに、生成人工知能について無駄に語られるべきではなく、正しい軌道に沿って科学研究に役立つように規制され、指導されるべきです。科学研究者にとって、科学研究や論文執筆を効率的かつ正確に完了するには、AI テクノロジーをうまく利用し、その利点を活用する必要があります。ただし、一部の虚偽や捏造を避けるために、すべての意見やデータは著者によってレビューされなければなりません。科学の尊厳を維持するための生成的 AI の結論。

実際、これはまさに AI for Science の本来の目的であり、AI を使用して従来の科学研究パラダイムを再構築し、革新するというものです。現在、科学用 AI は生物医学、材料化学、数学、物理学などの多くの分野で改良され、実用化価値のある多くの重要な成果を生み出しています。しかし、多くの研究者はまだ様子見の姿勢をとっている一方で、自分の分野には敷居の低い AI ツールが不足している可能性があり、他方では AI 間の統合ポイントを見つけていない可能性があります。そしてその研究分野。

科学のための AI の探求の旅は、まだ始まったばかりです。科学研究と AI が手を携えて進歩する場合にのみ、より普遍的なツールと手法を作成できます。