Command Palette

Search for a command to run...

80,000 点の絵画と手動の注釈でトレーニングした後、アルゴリズムは有名な絵画を鑑賞する方法を学習しました

芸術作品には作者の内なる感情が託されることが多く、人が音楽や絵画を鑑賞するとき、感情的な共鳴も生じます。コンピュータは絵画の感情を理解できるのでしょうか?スタンフォード大学の研究チームがこのアルゴリズムを開発しています。

レフ・トルストイはかつてこう言いました。「芸術は人間の活動です。人は自分が経験した感情を、外部のシンボルを通じて意識的に他の人に伝えます。そして、他の人もその感情に感染します。それは本当に真実です。これらの感情を経験してください。」

絵画を例に挙げると、それぞれの作品の背後には、アーティストの特定の感情があります。ゴッホやピカソなどの有名な画家は、創作のさまざまな時期に、さまざまな色や構成を使用して、独自の気分や感情を表現しました。

コンピューターはこれらの芸術的な絵画に含まれる感情を理解できるのでしょうか?スタンフォード大学のコンピューターサイエンス研究チームは、ArtEmis と呼ばれる新しいデータセットを収集しました。このデータセットには、多数の芸術作品と、それに対応する手動でラベル付けされた感情体験が含まれており、ビジュアルアートに対する感情的な反応を生成できるコンピューターモデルをトレーニングしました。

絵画の理解は感情ラベル付きデータセットから始まります

WikiArt: オンライン名画美術館

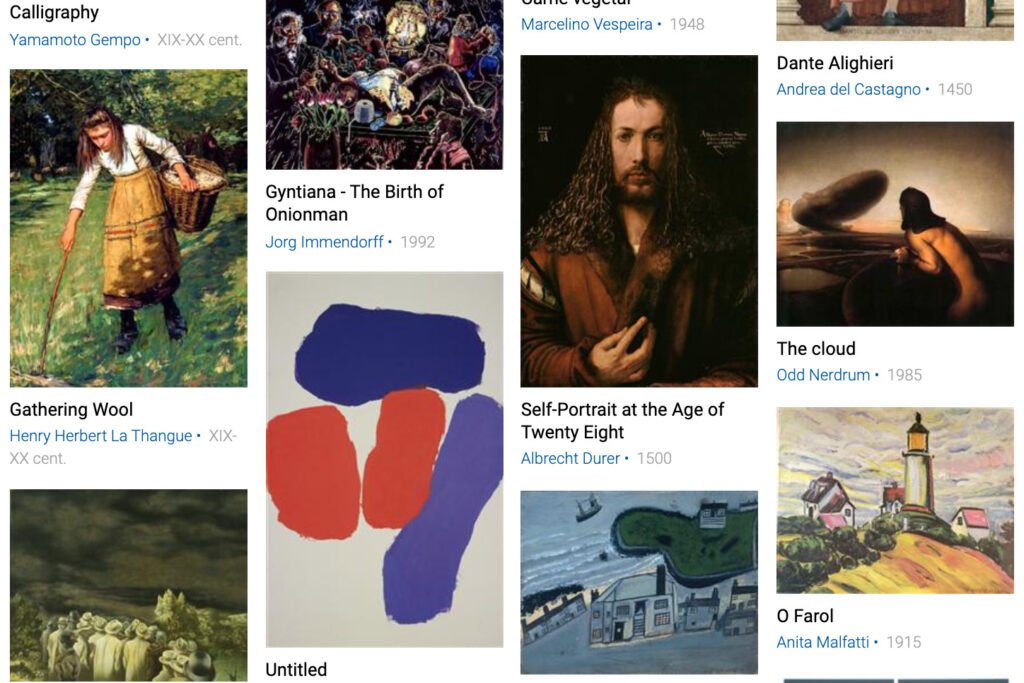

非営利のボランティアプロジェクトであるWikiArtは、2010年からオンライン化されており、世界中からビジュアルアート作品を集めた大規模なオンライン名画美術館と言えます。

ウェブサイトのデータによると、2020 年 1 月現在、このウェブサイトには、61 のジャンルを含む 3,293 人のアーティストによる合計 169,057 点の絵画が掲載されています。

WikiArtには膨大な数の絵画があり、明確な分類がされているため、AI分野の多くの研究者がアルゴリズムを訓練するために使用するデータセットとなっています。

2015 年、ラトガース大学と Facebook AI Lab の研究者が協力して GAN (Generative Adversarial Network) を開発し、それを WikiArt データでトレーニングして、GAN がさまざまなスタイルのアートを区別できるようにしました。

ArtEmis: WikiArt から生まれた新しいデータセット

スタンフォード大学チームは、WikiArt 上の作品に基づいて、新しいビジュアル アート アノテーション データ セット ArtEmis を作成しました。

彼らは、WikiArt 上の 1,119 人のアーティストによる 81,446 の芸術作品に 1 つずつ注釈を付けました。作品は15世紀の芸術作品から21世紀の現代美術絵画まで多岐にわたり、27の芸術スタイル(抽象、バロック、キュビスム、印象派など)と45のジャンル(都市景観、風景、肖像画、静物画)をカバーしています。人生など)、非常に多様な視覚的インパクトを視聴者にもたらします。

その中で、各作品には少なくとも 5 人の注釈者が、この絵を見たときに支配的な感情を書き留め、その感情の理由を説明する必要があります。

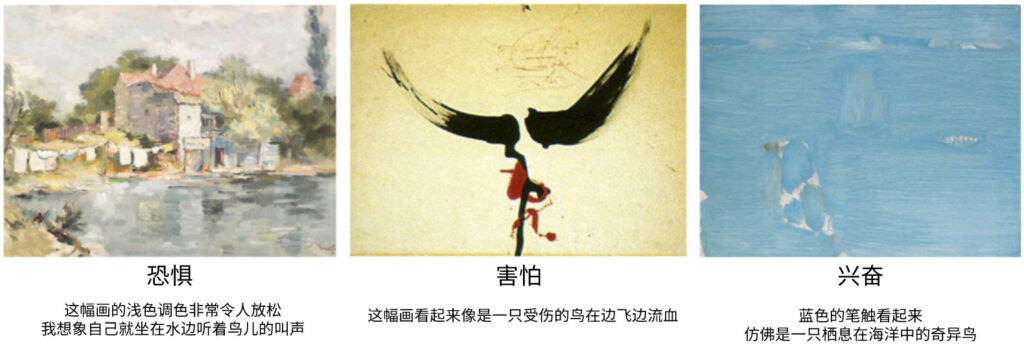

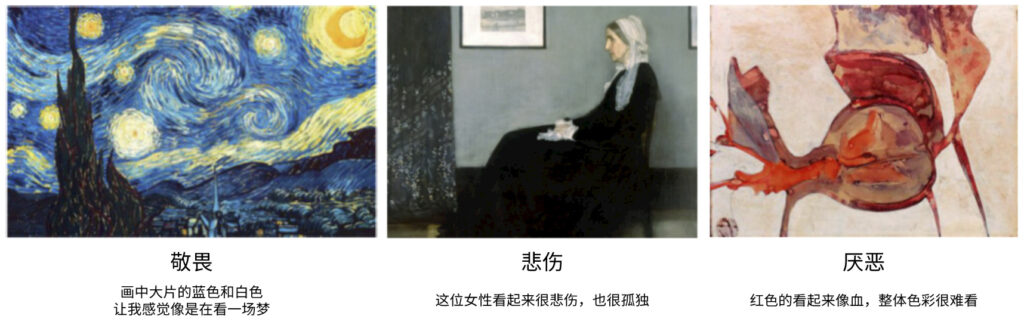

具体的には、アノテーターは、芸術作品を鑑賞した後に感じる 8 つの基本的な感情状態 (怒り、嫌悪、恐怖、悲しみ、楽しさ、畏怖、満足、興奮) から主な感情を 1 つ選択するように求められます。上記の 8 つのいずれにも当てはまらない場合。これらの感情は「その他」としてマークできます。

感情的な感情に注釈を付けた後、注釈付け者は、なぜそのように感じるのか、またはなぜ強い感情的反応を示さないのかを言葉を使ってさらに説明する必要があります。

以下は、ヒューマン・アノテーターが絵画に付けた感情ラベルと詳細な説明です。

このアノテーション作業は、Amazon クラウドソーシング プラットフォーム上で 6,377 人のアノテーターによって最終的に完了し、合計 10,220 時間かかりました。

研究チームは、他の既存の同様のデータセットと比較して、ArtEmis の注釈は、より豊かで感情的で多様な言語を使用しており、これらの注釈によって形成されたコーパスには合計 36,347 の異なる単語が含まれています。

アートエミス(ビジュアルアート用の感情ラベル付けデータセット)詳細:

発行機関:スタンフォード大学、エコール・ポリテクニック、キング・アブドラ科学技術大学

含まれる数量:合計 439121 件の絵画注釈

データ形式:csv データサイズ:21.8MB

住所:https://orion.hyper.ai/datasets/14861

感情を認識するアルゴリズムはどのように作られるのでしょうか?

コンピューターが人間と同じようにビジュアル アートに感情的に反応し、言語を使用してその感情の理由を証明できるようにするために、チームはこの大規模なデータ セットに基づいてニューラル スピーカーをトレーニングしました。

スタンフォード大学 HAI スクールの教授である Guibas 氏は、これはコンピューター ビジョンの分野における新たな探求であると述べました。これまでの古典的なコンピューター ビジョン手法では、画像の中にあるものを指摘することがよくありました。たとえば、3 匹の犬がいる、誰かがコーヒーを飲んでいる、などです。そして、その仕事はビジュアル アートにおける感情を定義することです。

ArtEmis データセットでトレーニングした後、このアルゴリズムは、さまざまな絵画に含まれる感情を識別し、そのような判断の根拠を自動的に生成します。結果の例は次のとおりです。

具体的なトレーニングのアイデアは論文内で紹介されています。まず、ArtEmis を使用してモデルをトレーニングし、芸術的な絵画の感情的な解釈の問題を解決します。これは古典的な 9 方向テキスト分類問題であり、チームはクロスエントロピー ベースの最適化を使用し、最初からトレーニングされた LSTM テキスト分類器に適用し、このタスク用に事前トレーニングされた BERT モデルの微調整も検討しました。

さらに、人間が仕事に対して通常抱くであろう感情的な反応をコンピューターに予測させます。

この問題を解決するために、チームは、出力と ArtEmis ユーザー アノテーションの間の KL 相違を最小限に抑えることにより、ImageNet に基づいて事前トレーニングされた ResNet32 エンコーダーを微調整しました。

特定の絵画について、分類器はまず、それが伝える感情がポジティブなものであるかネガティブなものであるかを判断し、次にそれがどの感情であるかをさらに判断します。

チーム紹介、絵画の場合、アルゴリズムは全体的な感情の色を認識できるだけでなく、絵画内のさまざまな登場人物の感情を区別することもできます。レンブラントの「洗礼者聖ヨハネ」を例に挙げると、AI アルゴリズムは首を切られたヨハネの苦痛を捉えただけでなく、絵画の中の首を切られた女性サロメの「満足感」も認識しました。

アルゴリズムが共感を得るとき

人間の感情は非常に豊かで複雑で繊細なものであるため、アーティストが表現したい雰囲気を100%理解することは、AIにとってもまだ難しい課題です。

しかし、ArtEmis データセットのリリースにより、画像の感情的属性を処理する AI の第一歩が踏み出されました。

研究チームは、さらなる研究と改良を経て、このアルゴリズムは人間の喜びや悲しみを認識できるようになる可能性があり、アーティストはこのアルゴリズムを利用して自分の作品が期待通りの感情表現を達成できるかどうかを評価できると述べた。さらに、アルゴリズムが人間の性質を理解できるようになると、人間とコンピューターの相互作用のプロセスはより自然で調和のとれたものになります。

ニュースソース:

https://techxplore.com/news/2021-03-artist-intent-ai-emotions-visual.html

データセットペーパー: https://arxiv.org/pdf/2101.07396.pdf

プロジェクトのホームページ: https://www.artemisdataset.org/#videos