Command Palette

Search for a command to run...

MMEvalPro マルチモーダル ベンチマーク評価データセット

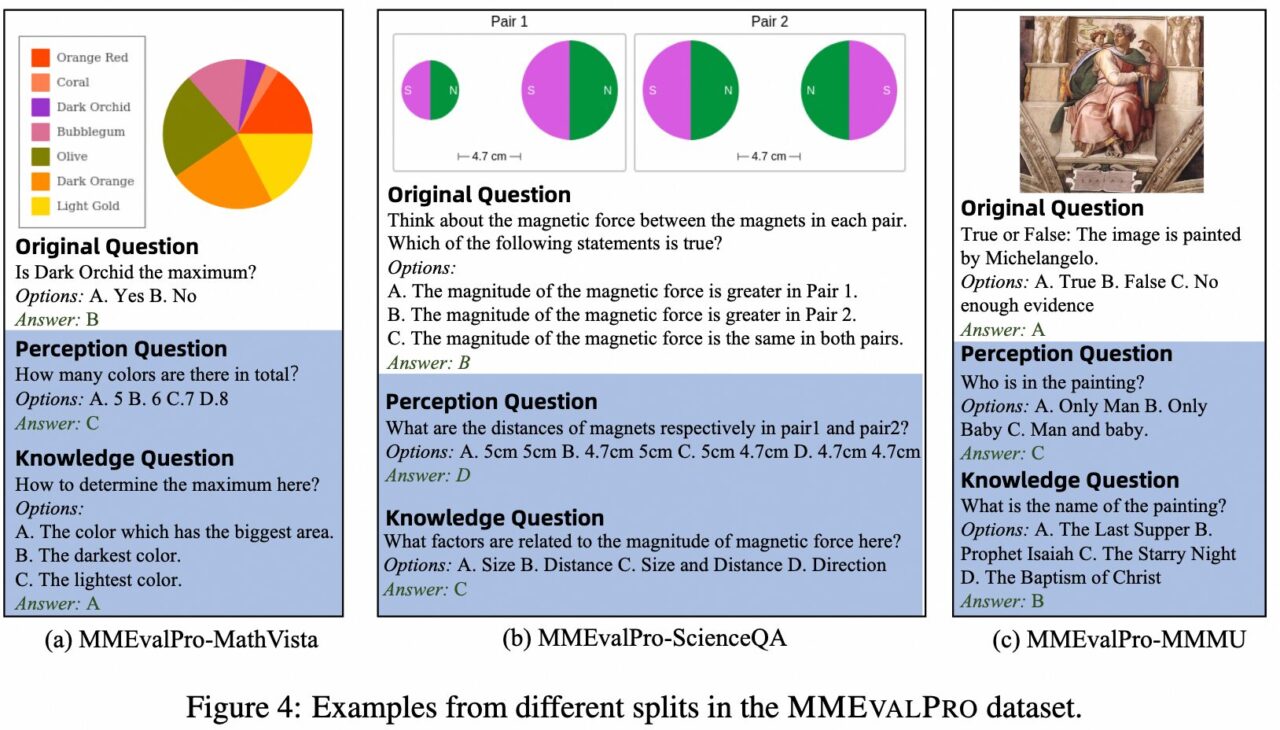

MMEvalProは、北京大学、中国医学科学院、香港中文大学、アリババの研究チームによって2024年に提案されたマルチモーダルラージモデル(LMM)評価ベンチマークであり、より信頼性が高く効率的な評価方法を提供することを目的としています。モーダル評価ベンチマークにおける既存の複数の問題を解決します。既存のベンチマークは、LMM の評価において体系的なバイアスに悩まされており、視覚認識機能を持たない大規模言語モデル (LLM) でさえ、これらのベンチマークで自明ではないパフォーマンスを達成する可能性があり、これらの評価の信頼性が損なわれます。 MMEvalPro は、2 つの「アンカー」質問 (認識質問と知識質問) を追加して、モデルのマルチモーダルな理解のさまざまな側面をテストする「トリプル質問」を形成することで、既存の評価方法を改善します。 MEvalPro の主な評価指標は「本物の精度」で、スコアを取得するには、モデルがトリプレット内のすべての質問に正しく答える必要があります。このプロセスには、質問が明確で、関連性があり、挑戦的であることを確認するために、複数の段階のレビューと品質チェックが含まれます。最終的なベンチマークには 2,138 の質問トリプルが含まれており、合計 6,414 の異なる質問がさまざまなトピックと難易度をカバーしています。