Command Palette

Search for a command to run...

TAPS : Distributions de propositions conscientes de la tâche pour l'échantillonnage spéculatif

TAPS : Distributions de propositions conscientes de la tâche pour l'échantillonnage spéculatif

Mohamad Zbib Mohamad Bazzi Ammar Mohanna Hasan Abed Al Kader Hammoud Bernard Ghanem

Résumé

Le décodage spéculatif accélère la génération autoregressive en permettant à un modèle de brouillon léger de proposer des tokens futurs qu'un modèle cible plus important vérifie ensuite en parallèle. En pratique, toutefois, les modèles de brouillon sont généralement entraînés sur des corpus génériques larges, ce qui laisse incertaine la mesure dans laquelle la qualité du décodage spéculatif dépend de la distribution d'entraînement du brouillon. Nous étudions cette question à l'aide de modèles de brouillon légers HASS et EAGLE-2 entraînés sur MathInstruct, ShareGPT et des variantes à données mixtes, évalués sur MT-Bench, GSM8K, MATH-500 et SVAMP. Mesurée par la longueur d'acceptation, l'entraînement spécifique à une tâche révèle une spécialisation nette : les brouillons entraînés sur MathInstruct obtiennent les meilleurs résultats sur les benchmarks de raisonnement, tandis que ceux entraînés sur ShareGPT surpassent les autres sur MT-Bench. L'entraînement sur des données mixtes améliore la robustesse, mais des mélanges plus importants ne dominent pas systématiquement à travers les différentes températures de décodage. Nous examinons également comment combiner des brouillons spécialisés au moment de l'inférence. Une moyenne naïve des checkpoints donne de piètres résultats, tandis qu'un routage basé sur la confiance surpasse les brouillons mono-domaine, et la vérification par arbre fusionné atteint la plus grande longueur d'acceptation globale pour les deux architectures de base. Enfin, la confiance constitue un signal de routage plus pertinent que l'entropie : les tokens rejetés tendent à présenter une entropie plus élevée, mais la confiance génère des décisions de routage au niveau du benchmark nettement plus claires. Ces résultats démontrent que la qualité du décodage spéculatif dépend non seulement de l'architecture du brouillon, mais aussi de l'adéquation entre les données d'entraînement du brouillon et la charge de travail en aval, et que les brouillons spécialisés sont mieux combinés au moment de l'inférence que dans l'espace des poids.

One-sentence Summary

Researchers from KAUST and the American University of Beirut propose TAPS, demonstrating that task-specific training of HASS and EAGLE-2 drafters significantly boosts speculative decoding acceptance on matched workloads. Their work reveals that combining specialized models via confidence-based routing or merged-tree verification at inference time outperforms naive weight averaging, optimizing LLM throughput for diverse domains like math and conversation.

Key Contributions

- The paper introduces an empirical analysis showing that task-specific training of draft models yields clear specialization, where MathInstruct-trained drafters excel on reasoning benchmarks while ShareGPT-trained drafters perform best on MT-Bench.

- This work demonstrates that combining specialized drafters at inference time via confidence-based routing and merged-tree verification significantly outperforms naive weight-space averaging, achieving the highest acceptance length across both HASS and EAGLE-2 backbones.

- Results indicate that confidence serves as a more effective routing signal than entropy for making benchmark-level decisions, as rejected tokens exhibit higher entropy but confidence provides clearer distinctions for selecting the optimal drafter.

Introduction

Autoregressive generation in LLMs faces a significant inference bottleneck that speculative decoding addresses by using a lightweight drafter to propose tokens for parallel verification by a larger target model. While prior work focuses on improving draft architectures or verification procedures, most draft models are trained on broad generic corpora, leaving the impact of training data distribution on acceptance quality under-explored. The authors leverage task-specific training on datasets like MathInstruct and ShareGPT to demonstrate that specialized drafters significantly outperform generic ones on matched benchmarks. They further show that combining these specialists at inference time through confidence-based routing and merged-tree verification yields superior results compared to naive weight averaging or mixed-data training.

Method

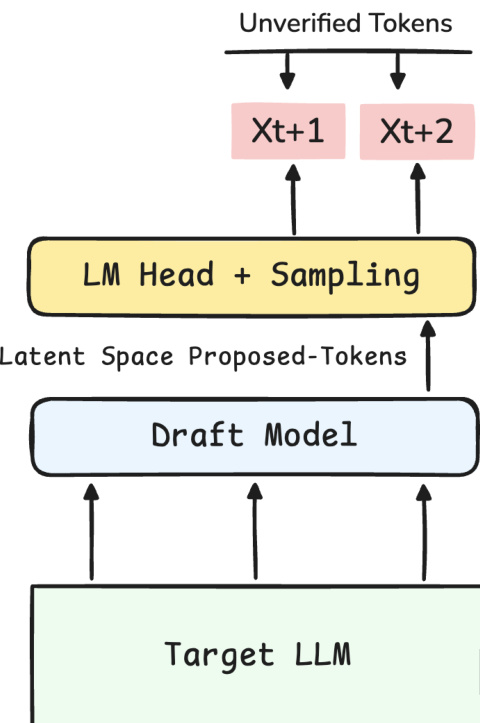

The authors leverage a speculative decoding framework where a lightweight draft model proposes future tokens for verification by a larger target LLM. As shown in the framework diagram, the process begins with the Target LLM providing context to the Draft Model. The draft model operates in latent space to propose tokens, which are then passed through an LM Head and sampling layer to generate unverified tokens like Xt+1 and Xt+2.

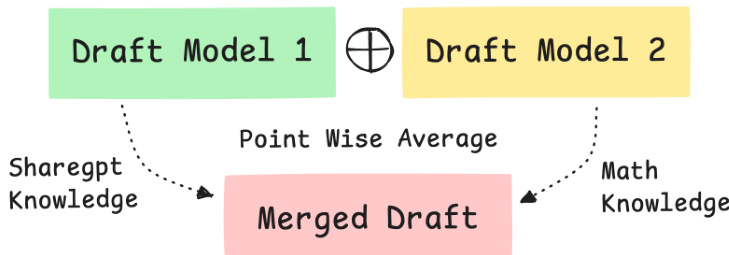

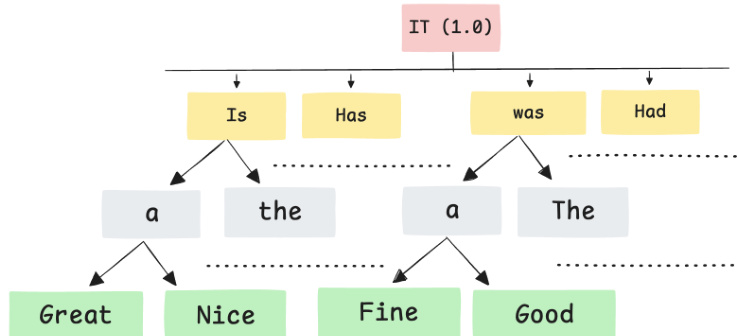

To enhance the quality of these drafts, the authors explore composition strategies for specialized models. One baseline approach is checkpoint averaging. As illustrated in the figure below, parameters from distinct draft models, such as one trained on ShareGPT data and another on Math data, are combined via point-wise averaging to create a single merged draft model.

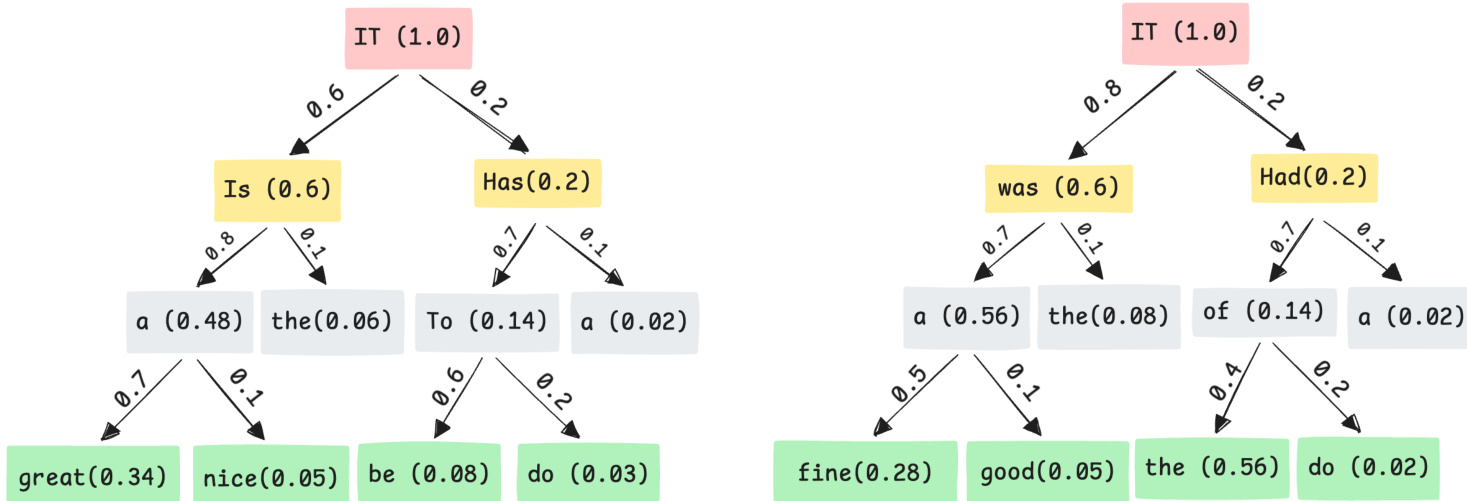

Alternatively, the authors investigate inference-time composition strategies that maintain separate specialized checkpoints. In this setting, specialized models generate distinct candidate continuations with associated confidence scores, as depicted in the tree diagrams showing separate branches for different experts.

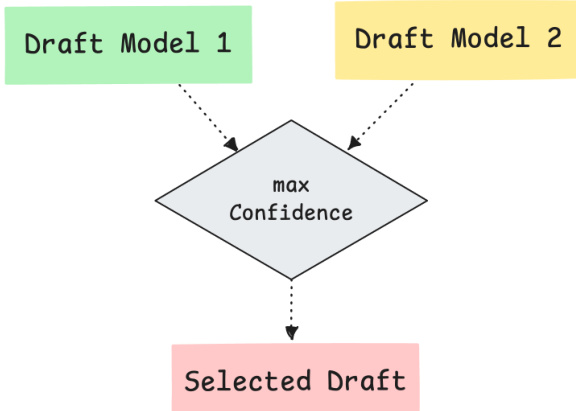

For inference-time selection, the authors propose confidence routing. This method generates separate draft trees from different checkpoints and selects the tree with the higher mean node confidence before verification, as shown in the routing diagram where the max confidence path is chosen.

A more comprehensive strategy is merged-tree verification. Instead of selecting a single tree, the method packs multiple draft trees under a shared root. This allows the verifier to evaluate candidates from all specialists in a single parallel pass. The flattened merged-tree input preserves ancestry through tree attention masks and depth-based position ids, enabling the verifier to process both specialized subtrees without cross-subtree attention.

Experiment

- Single-domain training validates that drafters achieve significantly higher acceptance lengths when their training distribution matches the target workload, with mathematical models excelling on reasoning tasks and conversational models on dialogue benchmarks.

- Mixed-data training demonstrates that combining domains improves cross-domain robustness, though the optimal mixture ratio depends on the decoding temperature and does not guarantee uniform generalization.

- Inference-time composition strategies, specifically confidence-based routing and merged-tree verification, substantially outperform weight-space averaging, proving that keeping specialized models separate and combining them at runtime is more effective than merging parameters.

- Analysis of confidence, entropy, and speculative depth reveals that confidence is the superior signal for routing between specialists, while deeper speculative steps increasingly favor task-matched experts over broad-coverage models.

- The overall conclusion establishes that proposal quality in speculative decoding is a function of both architecture and training distribution, necessitating task-aware drafting and dynamic composition rather than static, averaged checkpoints.