Command Palette

Search for a command to run...

Quadratique Gradient : Un cadre unifié reliant la descente de gradient et les méthodes de type Newton par la synthèse des Hessiens et des gradients

Quadratique Gradient : Un cadre unifié reliant la descente de gradient et les méthodes de type Newton par la synthèse des Hessiens et des gradients

John Chiang

Résumé

L'accélération de la convergence des méthodes d'optimisation du second ordre, en particulier les méthodes de type Newton, demeure un défi central dans la recherche algorithmique. Dans cet article, nous étendons les travaux antérieurs sur le Gradient Quadratique (Quadratic Gradient, QG) et validons rigoureusement son applicabilité aux problèmes d'optimisation numérique convexe généraux. Nous introduisons une variante novatrice du Gradient Quadratique qui s'écarte du cadre conventionnel de Newton à Hessien fixe. Nous proposons une nouvelle approche pour construire une version révisée du Gradient Quadratique. Cette nouvelle variante ne satisfait pas les conditions de convergence de la méthode de Newton à Hessien fixe. Néanmoins, les résultats expérimentaux montrent qu'elle peut, dans certains cas, surpasser la version originale en termes de vitesse de convergence. Bien que cette variante relâche certaines contraintes classiques de convergence, elle maintient une approximation du Hessien définie positive et démontre des performances empiriques comparables, voire supérieures, sur le plan de la vitesse de convergence. De plus, nous montrons que les deux variantes du QG, originale et proposée, peuvent être appliquées efficacement à des paysages d'optimisation non convexes. Une motivation clé de notre travail réside dans les limites des taux d'apprentissage scalaires traditionnels. Nous soutenons qu'une matrice diagonale permet d'accélérer plus efficacement les éléments du gradient à des rythmes hétérogènes. Nos résultats établissent le Gradient Quadratique comme un cadre polyvalent et puissant pour l'optimisation moderne. Par ailleurs, nous intégrons l'Estimateur de Hutchinson pour estimer efficacement la diagonale du Hessien via des produits Hessien-vecteur. Notamment, nous démontrons que la variante proposée du Gradient Quadratique est hautement efficace pour les architectures d'apprentissage profond (Deep Learning), offrant une alternative robuste du second ordre aux optimiseurs adaptatifs standards.

One-sentence Summary

John Chiang proposes a novel Quadratic Gradient variant that replaces fixed Hessian Newton frameworks with a diagonal matrix approach to accelerate convergence in Deep Learning. By integrating Hutchinson's Estimator for efficient Hessian diagonal approximation, this method outperforms traditional scalar learning rates in non-convex optimization landscapes.

Key Contributions

- The paper introduces a novel variant of the Quadratic Gradient that departs from the fixed Hessian Newton framework by maintaining a positive-definite Hessian proxy, which allows for effective application to non-convex optimization landscapes where traditional methods often fail.

- This work integrates Hutchinson's Estimator to efficiently approximate the Hessian diagonal via Hessian-vector products, reducing the computational complexity of second-order information from O(n2) to O(n) and enabling scalability for Deep Learning architectures.

- Experimental results demonstrate that the proposed Quadratic Gradient variants achieve comparable or superior convergence rates compared to original methods and standard adaptive optimizers, validating their utility as a robust second-order alternative for general convex and non-convex problems.

Introduction

Modern numerical optimization struggles to balance the scalability of first-order methods like SGD with the rapid convergence of second-order approaches like Newton's method, as the former fails on ill-conditioned curvatures while the latter incurs prohibitive computational costs and sensitivity to Hessian indefiniteness. Prior work on the Quadratic Gradient (QG) has shown promise in specific tasks like logistic regression but often relies on fixed Hessian approximations that limit general applicability and theoretical convergence guarantees. The authors leverage a novel QG variant that synthesizes curvature information into a diagonal matrix to replace scalar learning rates, enabling dimension-wise acceleration without satisfying the strict constraints of traditional fixed Hessian Newton methods. By integrating Hutchinson's Estimator for efficient Hessian diagonal approximation, they establish a unified framework that extends to general convex and non-convex landscapes, offering a robust second-order alternative to standard adaptive optimizers in Deep Learning.

Dataset

The provided text only lists the titles "mnist" and "credi" under the section "Large-Scale Datasets" without offering any descriptive content. Consequently, it is not possible to draft a dataset description covering composition, sources, filtering rules, training splits, or processing strategies based on this input. No further details regarding dataset size, metadata construction, or model usage are available in the source material.

Experiment

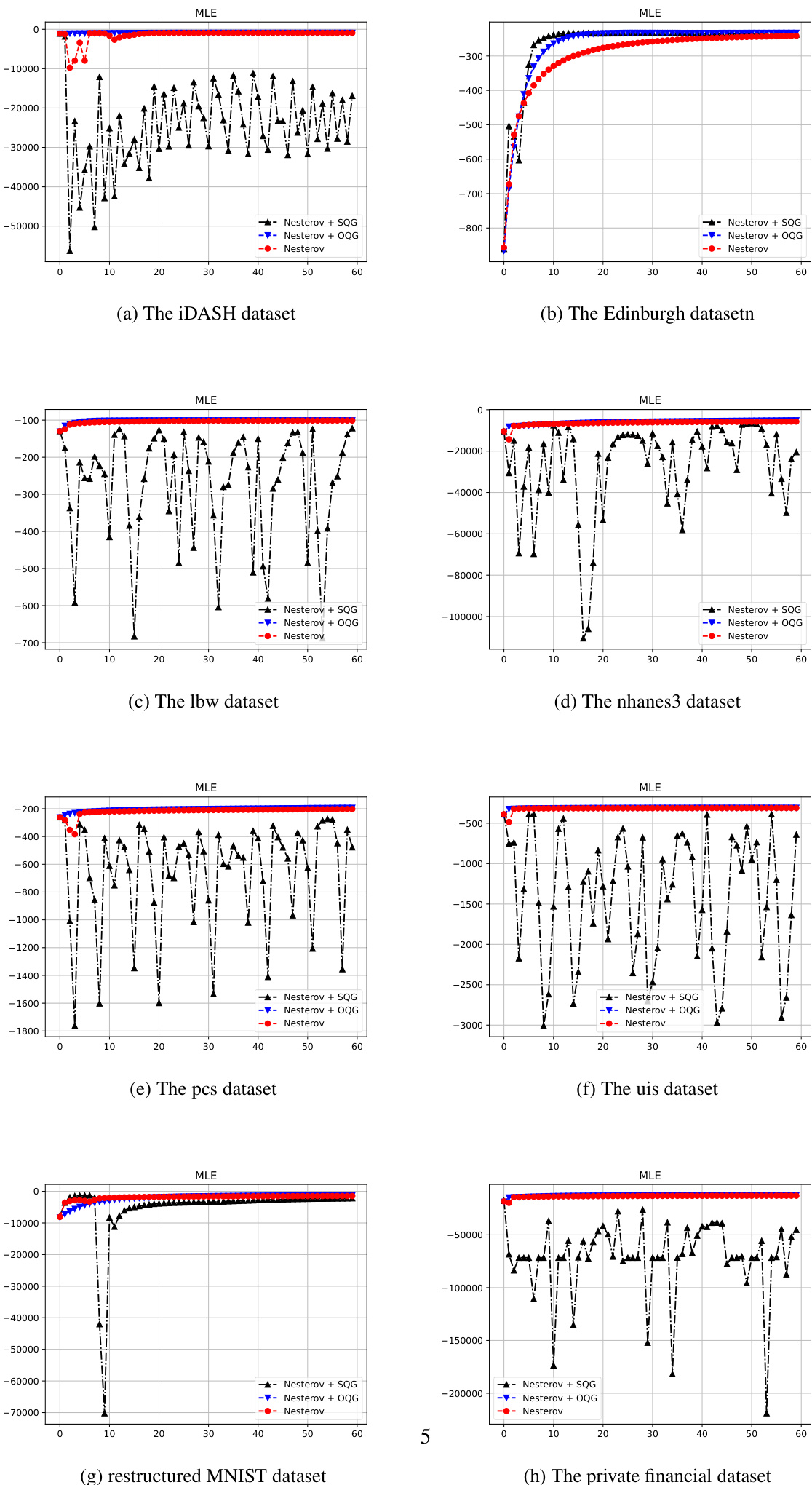

- Logistic regression experiments on multiple datasets validate that the Simplified Quadratic Gradient (SQG) framework maintains high computational efficiency and convergence speed comparable to the original method while offering a more streamlined architecture, though it requires conservative learning rate decay for NAG to ensure stability.

- Deep learning tests on ResNet-18 demonstrate that the new QG variant achieves faster convergence than Adam and exhibits superior stability in non-convex regions compared to AdaHessian, with computational overhead comparable to second-order methods.

- Benchmark evaluations on convex and non-convex functions confirm the algorithm's ability to handle dimensional scaling and navigate ill-conditioned valleys effectively.

- Saddle point analysis reveals that the QG variant overcomes the stagnation typical of first-order methods by utilizing spectral information to assign large adaptive steps along directions of minimal curvature, allowing the optimizer to escape saddle points efficiently.

- Overall, the framework successfully bridges first and second-order optimization by integrating Hessian approximations to accelerate convergence and robustly manage complex topological features in high-dimensional spaces.