Command Palette

Search for a command to run...

Hunyuan3D-2.1: 3D-generatives Modell, Das Physikalische Rendering-Texturen Unterstützt

Datum

Größe

1.89 GB

Tags

Lizenz

Other

Paper-URL

1. Einführung in das Tutorial

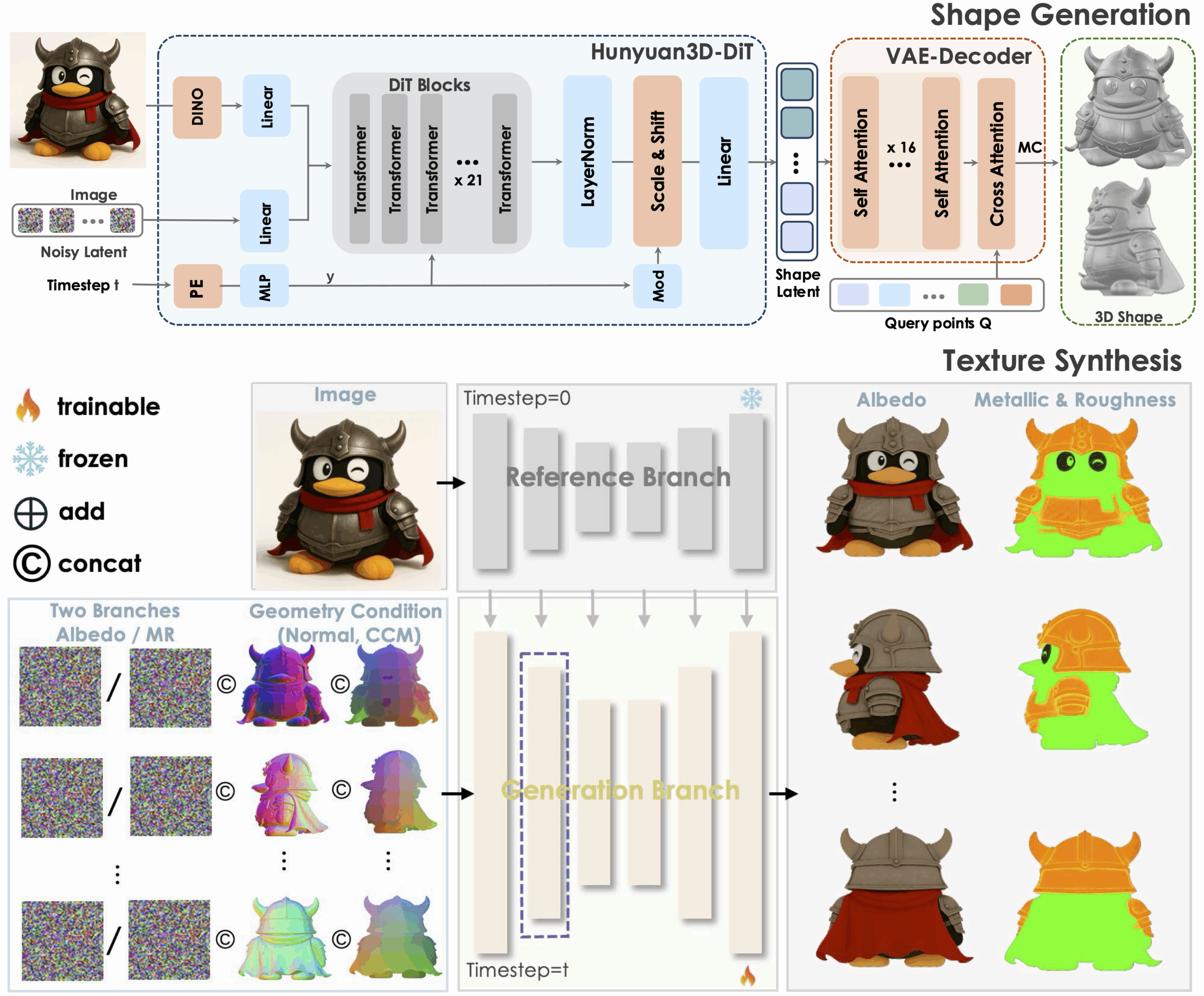

Tencent Hunyuan3D-2.1, veröffentlicht vom Tencent Hunyuan-Team am 14. Juni 2025, ist ein industrietaugliches Open-Source-3D-Generierungsmodell und ein skalierbares System zur Erstellung von 3D-Assets. Es treibt die Entwicklung modernster 3D-Generierungstechnologie durch zwei Schlüsselinnovationen voran: ein vollständig quelloffenes Framework und physikalisch basierte Textursynthese (PBR). Als erstes Materialgenerierungsmodell unterstützt es physikalisch basiertes Rendering und verfügt über ein vollständiges, auf physikalischen Gesetzen beruhendes Materialsystem, das diffuse Reflexion, Metallizität und Normal Mapping umfasst. Dadurch werden Licht- und Schatteneffekte auf Kinoniveau für Materialien wie Leder und Bronze erzielt, die den hohen Präzisionsanforderungen von Spiele-Assets und Industriedesign gerecht werden. Gleichzeitig sind Datenverarbeitung, Trainings- und Inferenzcode, Modellgewichte und Architektur vollständig offengelegt. Dies ermöglicht es Entwicklern, nachgelagerte Aufgaben zu optimieren, bietet eine reproduzierbare Grundlage für die akademische Forschung und reduziert die Entwicklungskosten für industrielle Anwendungen. Zugehörige Forschungsarbeiten sind verfügbar. Hunyuan3D 2.0: Skalierung von Diffusionsmodellen für die Generierung hochauflösender texturierter 3D-AssetsEs wurde von CVPR 2025 angenommen.

Die in diesem Tutorial verwendeten Rechenressourcen sind eine einzelne RTX A6000-Karte.

2. Effektanzeige

3. Bedienungsschritte

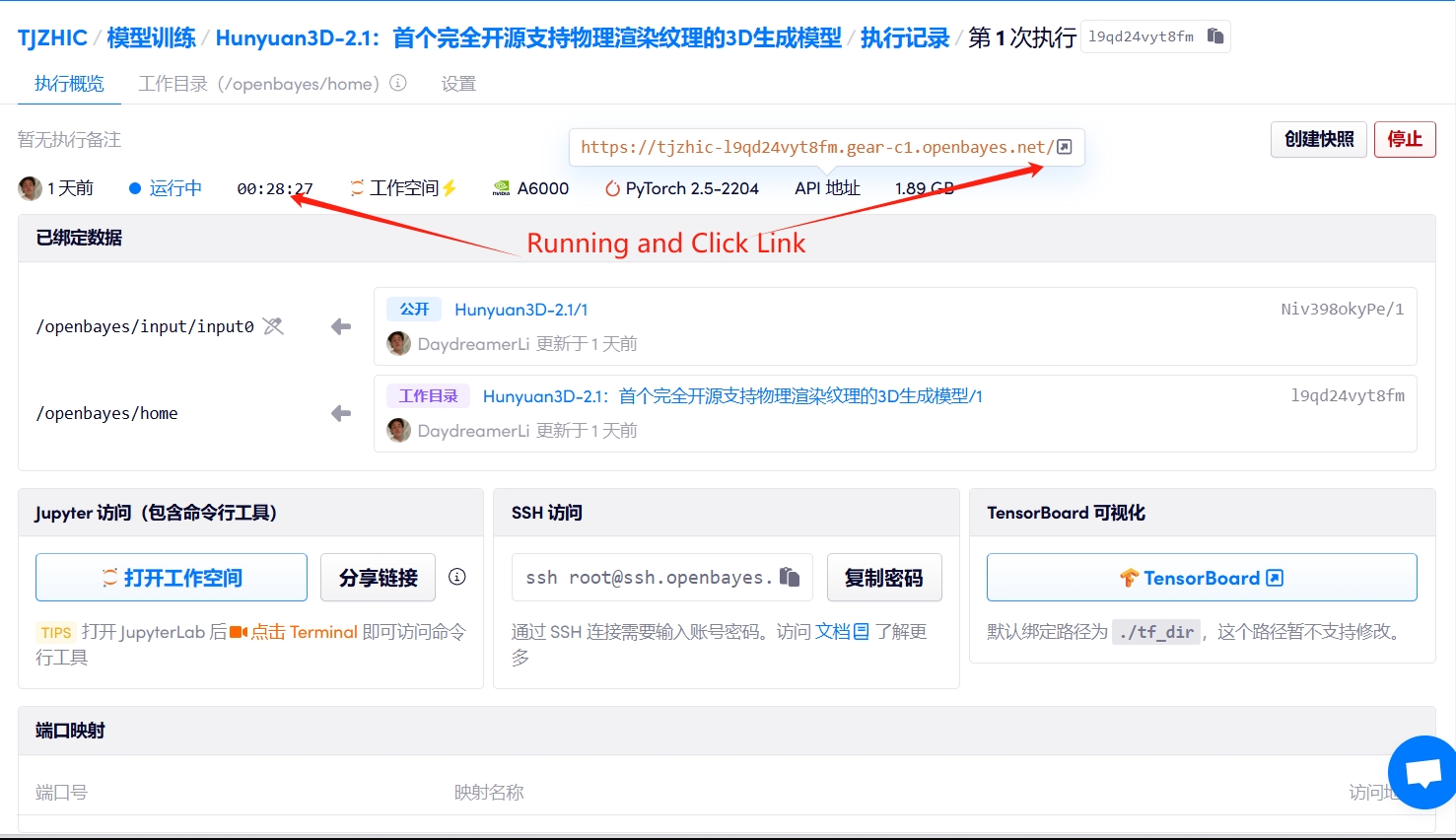

1. Starten Sie den Container

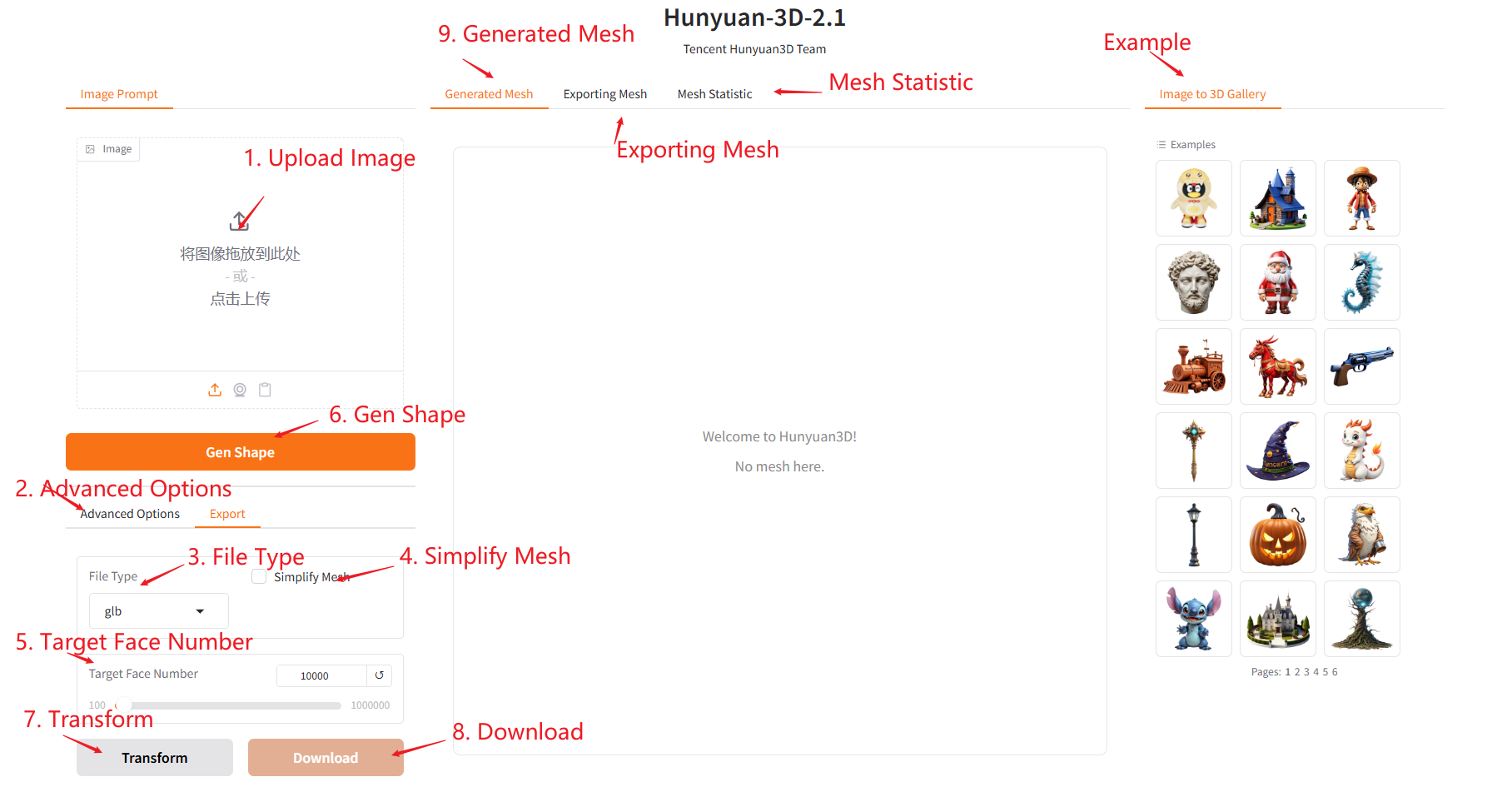

2. Anwendungsschritte

Wenn „Bad Gateway“ angezeigt wird, bedeutet dies, dass das Modell initialisiert wird. Da das Modell groß ist, warten Sie bitte etwa 3–4 Minuten und aktualisieren Sie die Seite.

Spezifische Parameter:

- Zielflächenanzahl: Gibt die maximale Anzahl von Dreiecksflächen zum Generieren des 3D-Modells an.

- Hintergrund entfernen: Ob der Hintergrund entfernt werden soll, ob der Bildhintergrund (z. B. Volltonfarben, überladene Szenen) automatisch erkannt und gelöscht werden soll und ob nur die Umrisse des Hauptobjekts erhalten bleiben sollen.

- Seed: Steuert die Zufälligkeit des Generierungsprozesses.

- Inferenzschritte: Steuert die Anzahl der Sampling-Iterationen des Diffusionsmodells.

- Octree-Auflösung: Definiert die Rastergenauigkeitsstufe für die 3D-Raumsegmentierung.

- Anleitungsskala: Steuert die Stärke der Einschränkungen, die durch die Textbeschreibung den generierten Ergebnissen auferlegt werden.

- Anzahl der Chunks: Teilen Sie große 3D-Rendering-Aufgaben in Unterchunks auf, die parallel verarbeitet werden, um einen Videospeicherüberlauf (OOM) zu vermeiden.

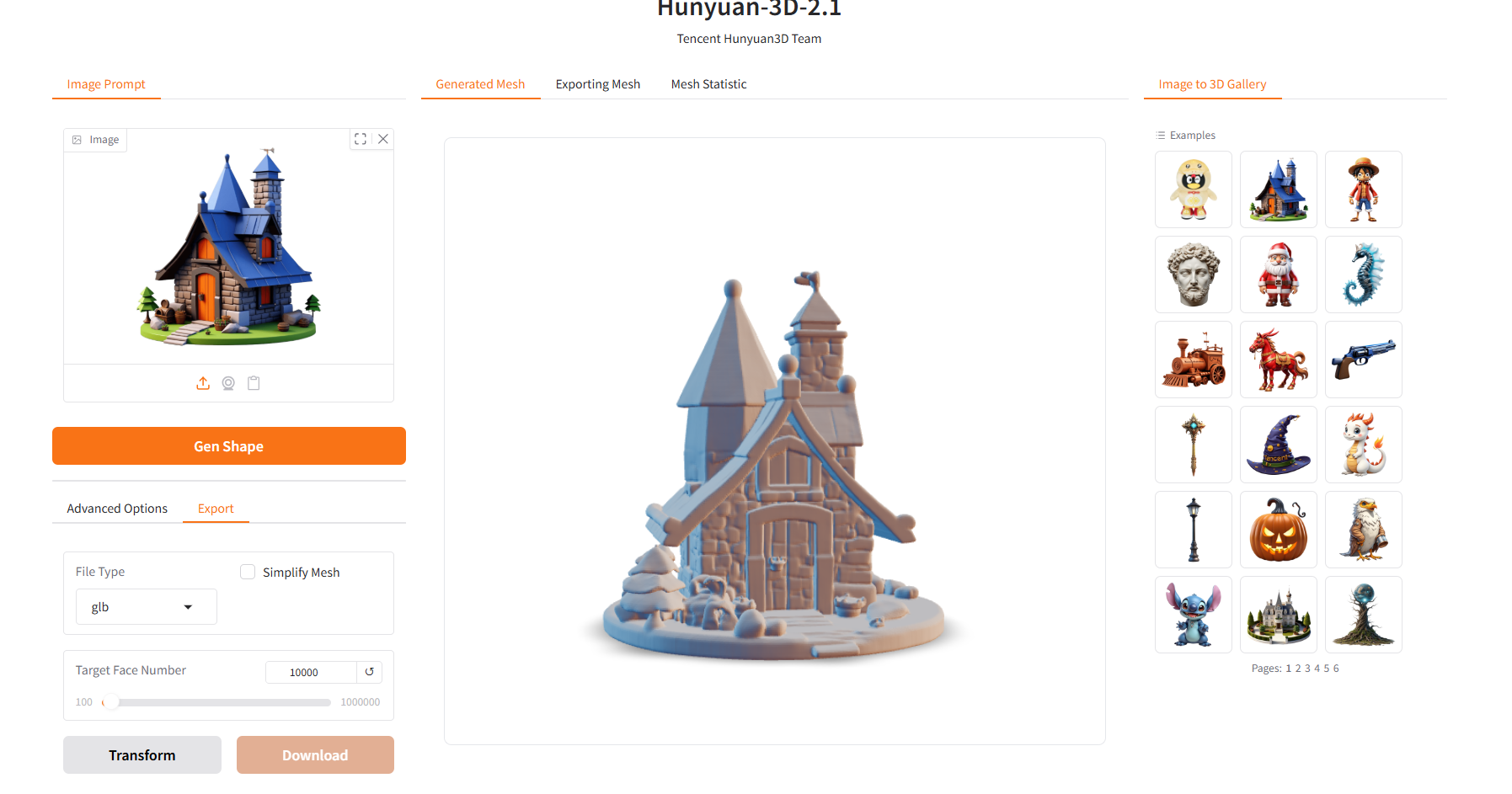

Ergebnis

4. Diskussion

🖌️ Wenn Sie ein hochwertiges Projekt sehen, hinterlassen Sie bitte im Hintergrund eine Nachricht, um es weiterzuempfehlen! Darüber hinaus haben wir auch eine Tutorien-Austauschgruppe ins Leben gerufen. Willkommen, Freunde, scannen Sie den QR-Code und kommentieren Sie [SD-Tutorial], um der Gruppe beizutreten, verschiedene technische Probleme zu besprechen und Anwendungsergebnisse auszutauschen ↓

Zitationsinformationen

Die Zitationsinformationen für dieses Projekt lauten wie folgt:

@misc{hunyuan3d22025tencent, title={Hunyuan3D 2.0: Scaling Diffusion Models for High Resolution Textured 3D Assets Generation}, author={Tencent Hunyuan3D Team}, year={2025}, eprint={2501.12202}, archivePrefix={arXiv}, primaryClass={cs.CV} }@misc{yang2024hunyuan3d,

title={Hunyuan3D 1.0: A Unified Framework for Text-to-3D and Image-to-3D Generation},

author={Tencent Hunyuan3D Team},

year={2024},

eprint={2411.02293},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

KI mit KI entwickeln

Von der Idee bis zum Launch – beschleunigen Sie Ihre KI-Entwicklung mit kostenlosem KI-Co-Coding, sofort einsatzbereiter Umgebung und bestem GPU-Preis.