Command Palette

Search for a command to run...

HealthGPT: KI-gestützter Medizinischer Assistent

Datum

Größe

600.63 MB

Lizenz

Apache 2.0

GitHub

Paper-URL

1. Einführung in das Tutorial

HealthGPT, ein umfangreiches medizinisches visuelles Sprachmodell (Med-LVLM), das am 16. März 2025 von der Zhejiang-Universität, der Universität für Elektronische Wissenschaft und Technologie Chinas, Alibaba, der Hong Kong University of Science and Technology und der National University of Singapore gemeinsam veröffentlicht wurde, bietet durch heterogene Wissensadaption ein einheitliches Framework für Aufgaben des medizinischen visuellen Verständnisses und der Bildgenerierung. Es verwendet eine innovative heterogene Low-Rank-Adaption (H-LoRA)-Technik, die Wissen für visuelles Verständnis und Bildgenerierung in unabhängigen Plugins speichert, um Konflikte zwischen den Aufgaben zu vermeiden. HealthGPT bietet zwei Versionen: HealthGPT-M3 (3,8 Milliarden Parameter) und HealthGPT-L14 (14 Milliarden Parameter), basierend auf den vortrainierten Sprachmodellen Phi-3-mini bzw. Phi-4. Das Modell führt hierarchische visuelle Wahrnehmung (HVP) und eine dreistufige Lernstrategie (TLS) ein, um das Lernen visueller Merkmale und die Anpassungsfähigkeit an die jeweilige Aufgabe zu optimieren. Zugehörige Forschungsarbeiten sind verfügbar. HealthGPT: Ein medizinisches umfassendes Vision-Language-Modell zur Vereinheitlichung von Verständnis und Generierung durch heterogene Wissensanpassung Es wurde in die ICML 2025 aufgenommen und als Spotlight ausgewählt.

Dieses Tutorial verwendet Ressourcen für eine einzelne RTX A6000-Karte. Englisch wird empfohlen.

Das Projekt bietet zwei Modellvarianten:

- HealthGPT-M3: Eine kleinere Version, optimiert für Geschwindigkeit und reduzierten Speicherverbrauch.

- HealthGPT-L14: Eine größere Version, die für höhere Leistung und komplexere Aufgaben entwickelt wurde.

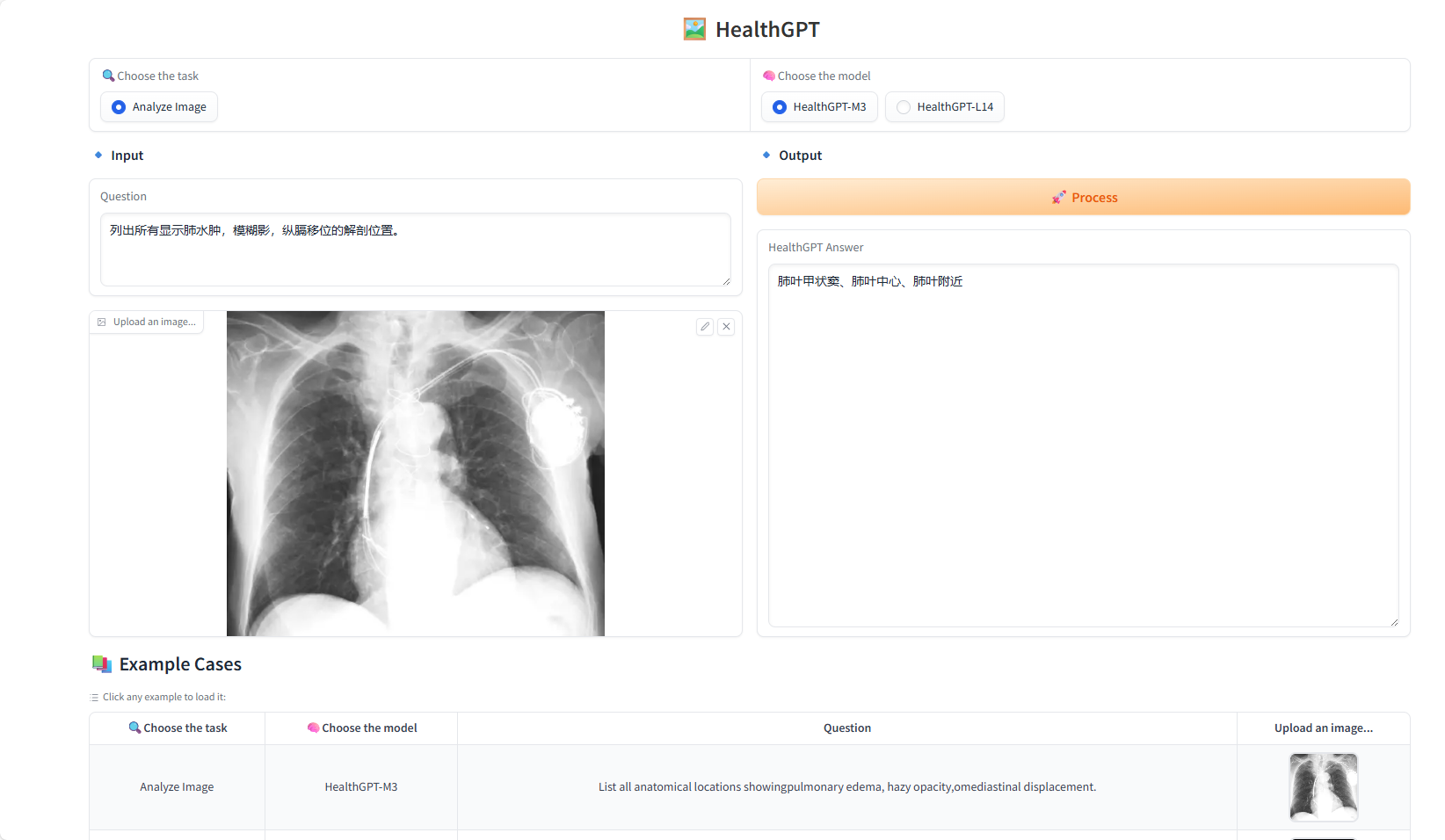

2. Projektbeispiele

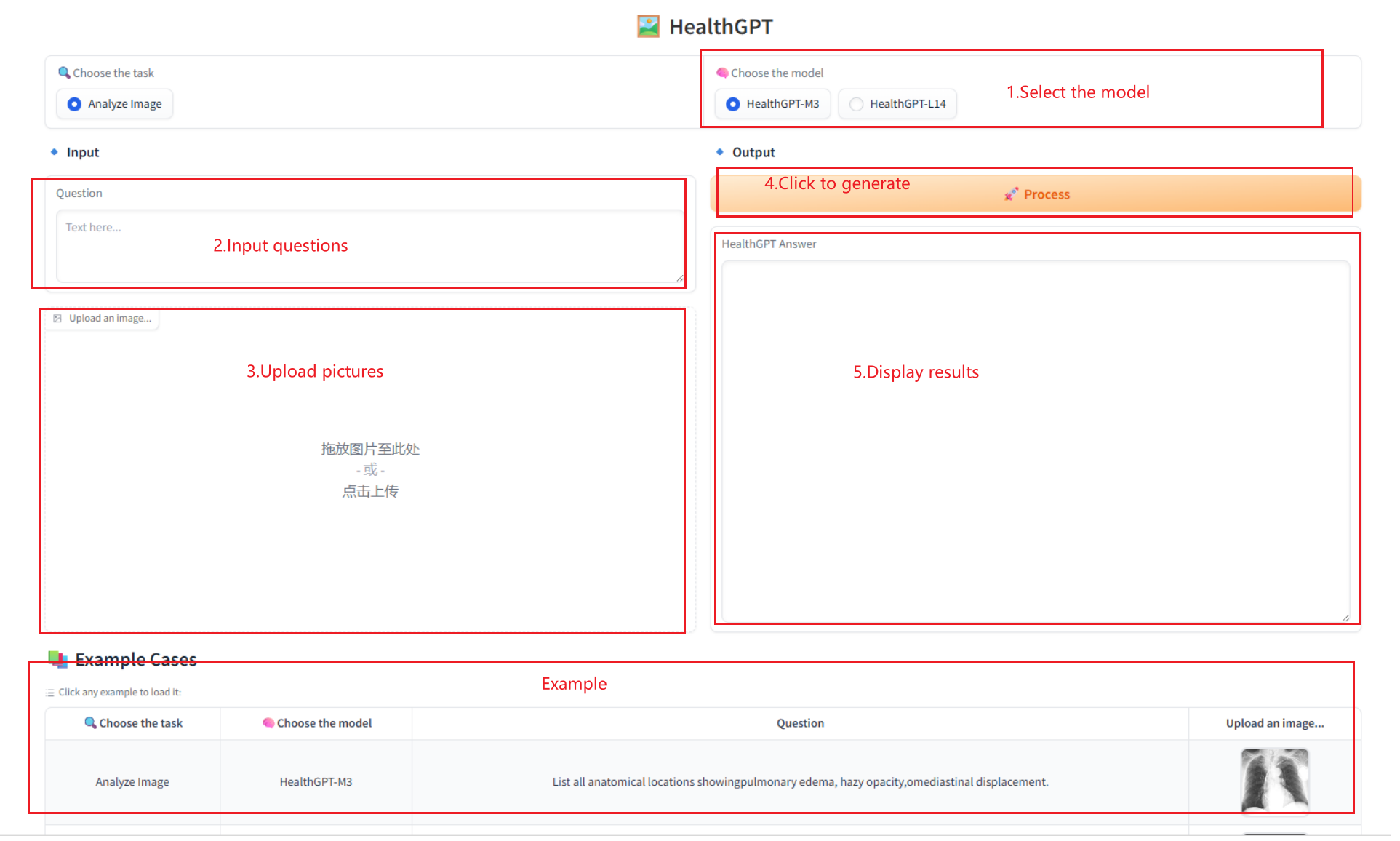

3. Bedienungsschritte

1. Klicken Sie nach dem Starten des Containers auf die API-Adresse, um die Weboberfläche aufzurufen

2. Anwendungsschritte

Wenn „Bad Gateway“ angezeigt wird, bedeutet dies, dass das Modell initialisiert wird. Da das Modell groß ist, warten Sie bitte etwa 2–3 Minuten und aktualisieren Sie die Seite.

4. Diskussion

🖌️ Wenn Sie ein hochwertiges Projekt sehen, hinterlassen Sie bitte im Hintergrund eine Nachricht, um es weiterzuempfehlen! Darüber hinaus haben wir auch eine Tutorien-Austauschgruppe ins Leben gerufen. Willkommen, Freunde, scannen Sie den QR-Code und kommentieren Sie [SD-Tutorial], um der Gruppe beizutreten, verschiedene technische Probleme zu besprechen und Anwendungsergebnisse auszutauschen ↓

Zitationsinformationen

Dank an den Github-Benutzer xxxjjjyyy1 Bereitstellung dieses Tutorials. Die Zitationsinformationen für dieses Projekt lauten wie folgt:

@misc{lin2025healthgptmedicallargevisionlanguage,

title={HealthGPT: A Medical Large Vision-Language Model for Unifying Comprehension and Generation via Heterogeneous Knowledge Adaptation},

author={Tianwei Lin and Wenqiao Zhang and Sijing Li and Yuqian Yuan and Binhe Yu and Haoyuan Li and Wanggui He and Hao Jiang and Mengze Li and Xiaohui Song and Siliang Tang and Jun Xiao and Hui Lin and Yueting Zhuang and Beng Chin Ooi},

year={2025},

eprint={2502.09838},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2502.09838},

}KI mit KI entwickeln

Von der Idee bis zum Launch – beschleunigen Sie Ihre KI-Entwicklung mit kostenlosem KI-Co-Coding, sofort einsatzbereiter Umgebung und bestem GPU-Preis.