Command Palette

Search for a command to run...

MMaDA: Multimodales Großes Diffuses Sprachmodell

Datum

Größe

757.43 MB

Lizenz

MIT

GitHub

Paper-URL

1. Einführung in das Tutorial

MMaDA-8B-Base ist ein multimodales, diffusionsbasiertes Sprachmodell für große Sprachsysteme, das gemeinsam von der Princeton University, dem ByteDance Seed Team, der Peking University und der Tsinghua University entwickelt und am 23. Mai 2025 veröffentlicht wurde. Dieses Modell ist das erste einheitliche Modell, das die Diffusionsarchitektur systematisch als grundlegendes Paradigma für multimodales Lernen untersucht. Ziel ist es, durch die tiefe Fusion von Textverarbeitung, multimodaler Informationsverarbeitung und Bildgenerierung allgemeine intelligente Fähigkeiten für verschiedene modale Aufgaben zu erreichen. Zugehörige Forschungsarbeiten sind verfügbar. MMaDA: Multimodale Sprachmodelle mit großer Verbreitung .

Die Rechenressourcen dieses Tutorials nutzen eine einzelne A6000-Karte. Das in diesem Tutorial eingesetzte Modell ist MMaDA-8B-Base. Drei Beispiele für Textgenerierung, multimodales Verständnis und Text-zu-Bild-Generierung stehen zum Testen zur Verfügung.

2. Bedienungsschritte

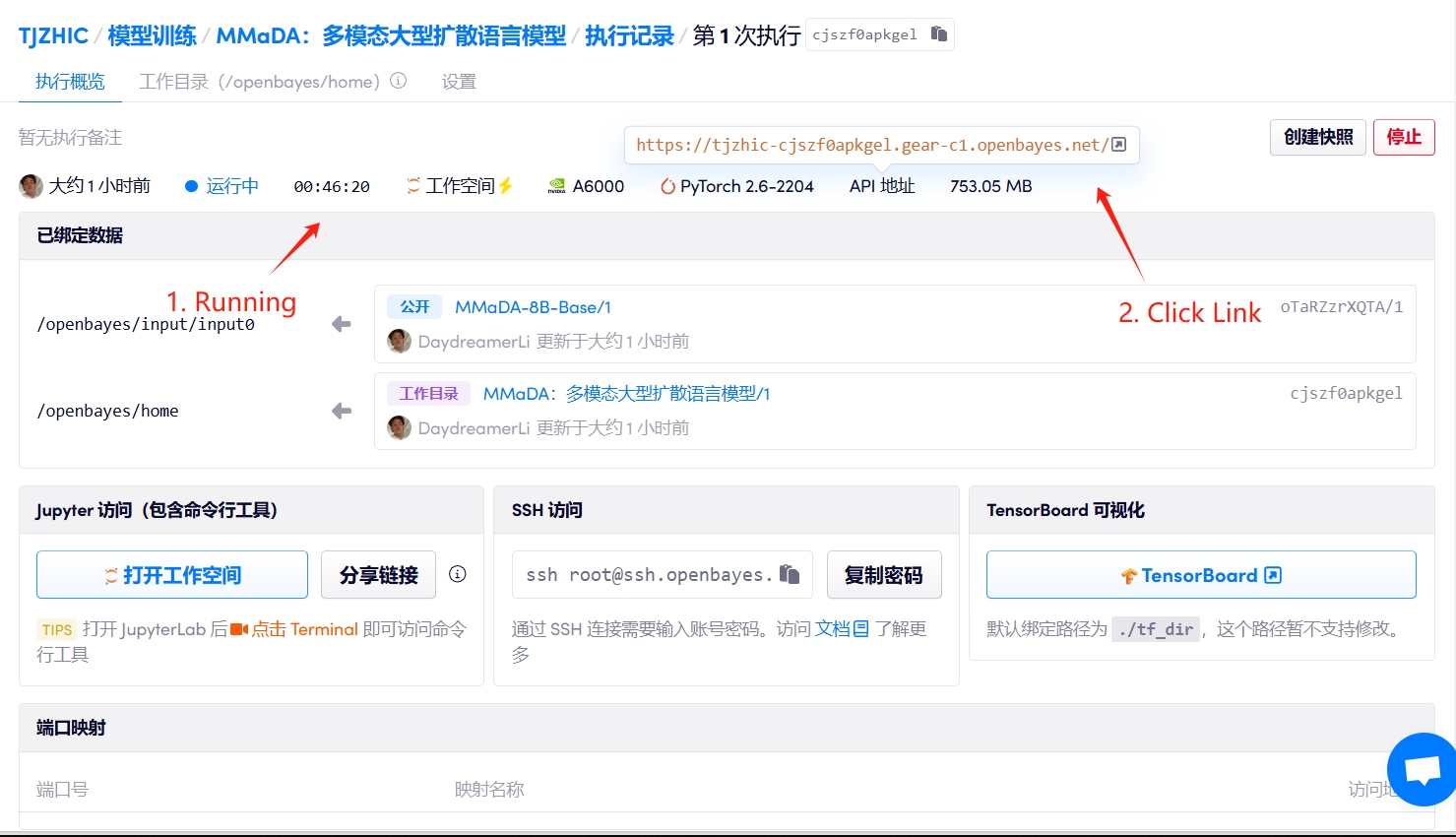

1. Starten Sie den Container

Wenn „Bad Gateway“ angezeigt wird, bedeutet dies, dass das Modell initialisiert wird. Da das Modell groß ist, warten Sie bitte etwa 2–3 Minuten und aktualisieren Sie die Seite.

2. Anwendungsschritte

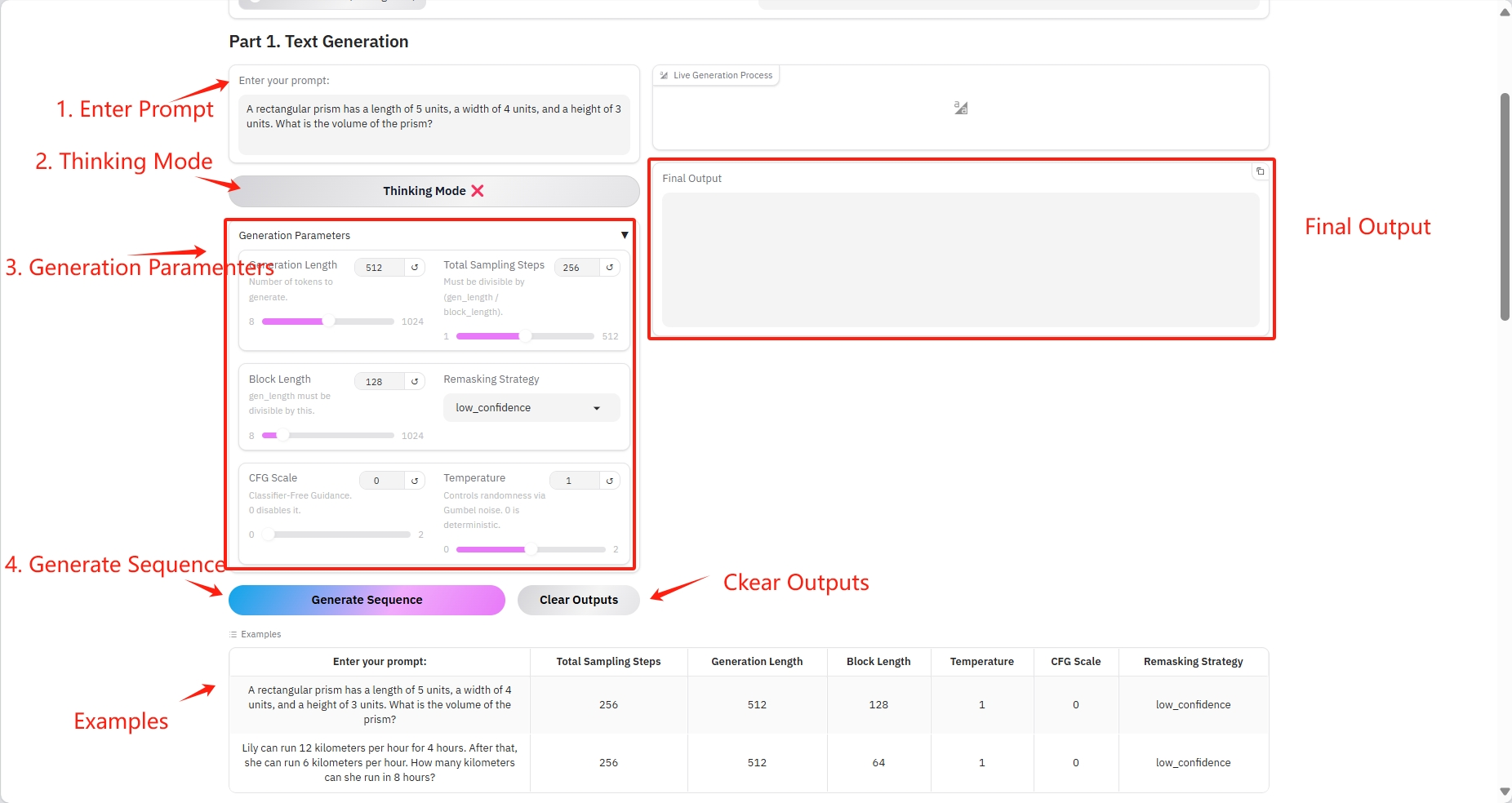

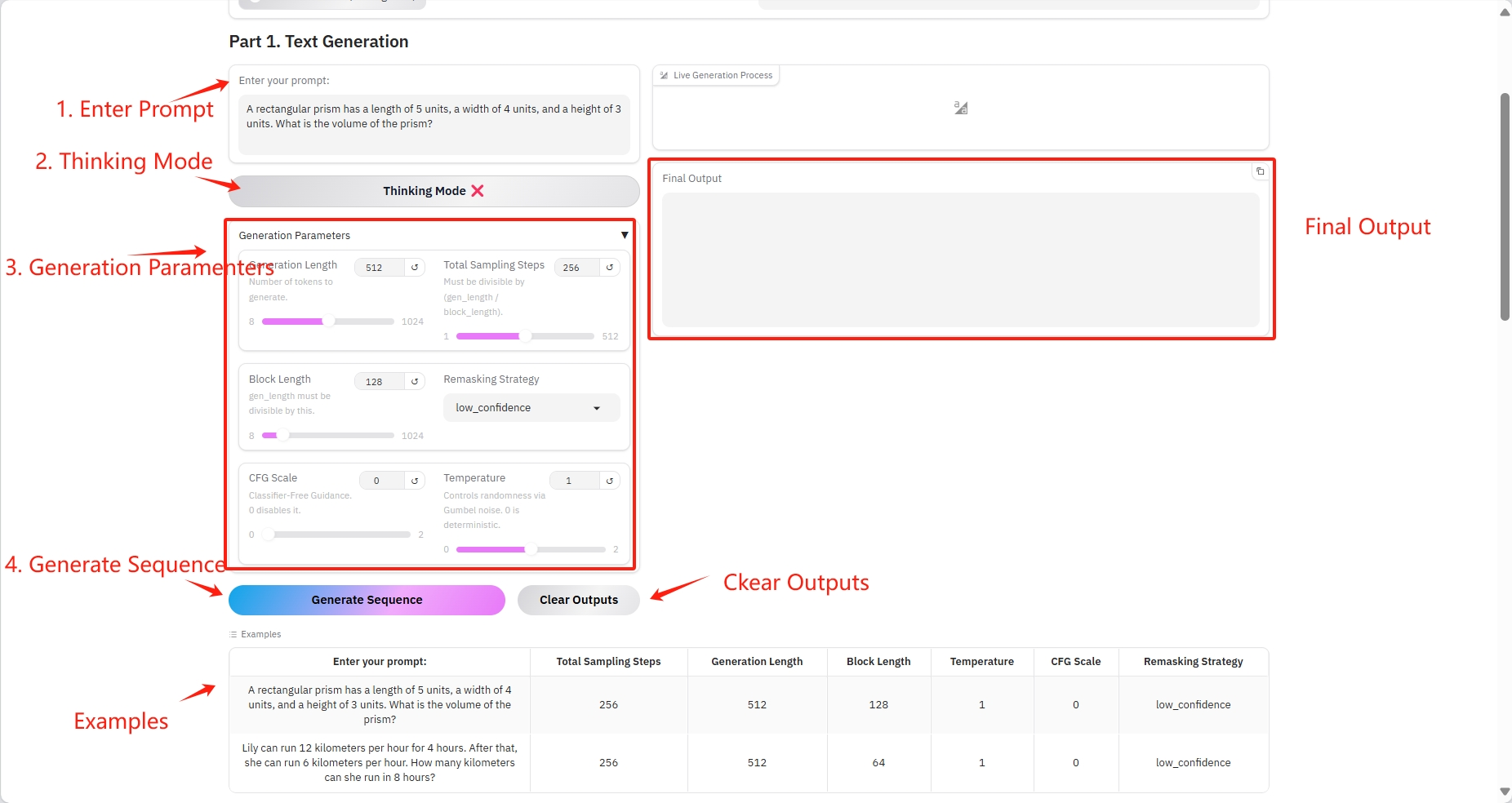

1. Textgenerierung

Spezifische Parameter:

- Eingabeaufforderung: Hier können Sie Text eingeben.

- Generierungslänge: Die Anzahl der generierten Token.

- Gesamtzahl der Sampling-Schritte: Muss durch (Gen_Länge / Block_Länge) teilbar sein.

- Blocklänge: gen_length muss durch diese Zahl teilbar sein.

- Remaskierungsstrategie: Remaskierungsstrategie.

- CFG-Skala: Kein Klassifikatorleitfaden. 0 deaktiviert ihn.

- Temperatur: Steuert die Zufälligkeit über Gumbel-Rauschen. 0 ist deterministisch.

Ergebnisausgabe

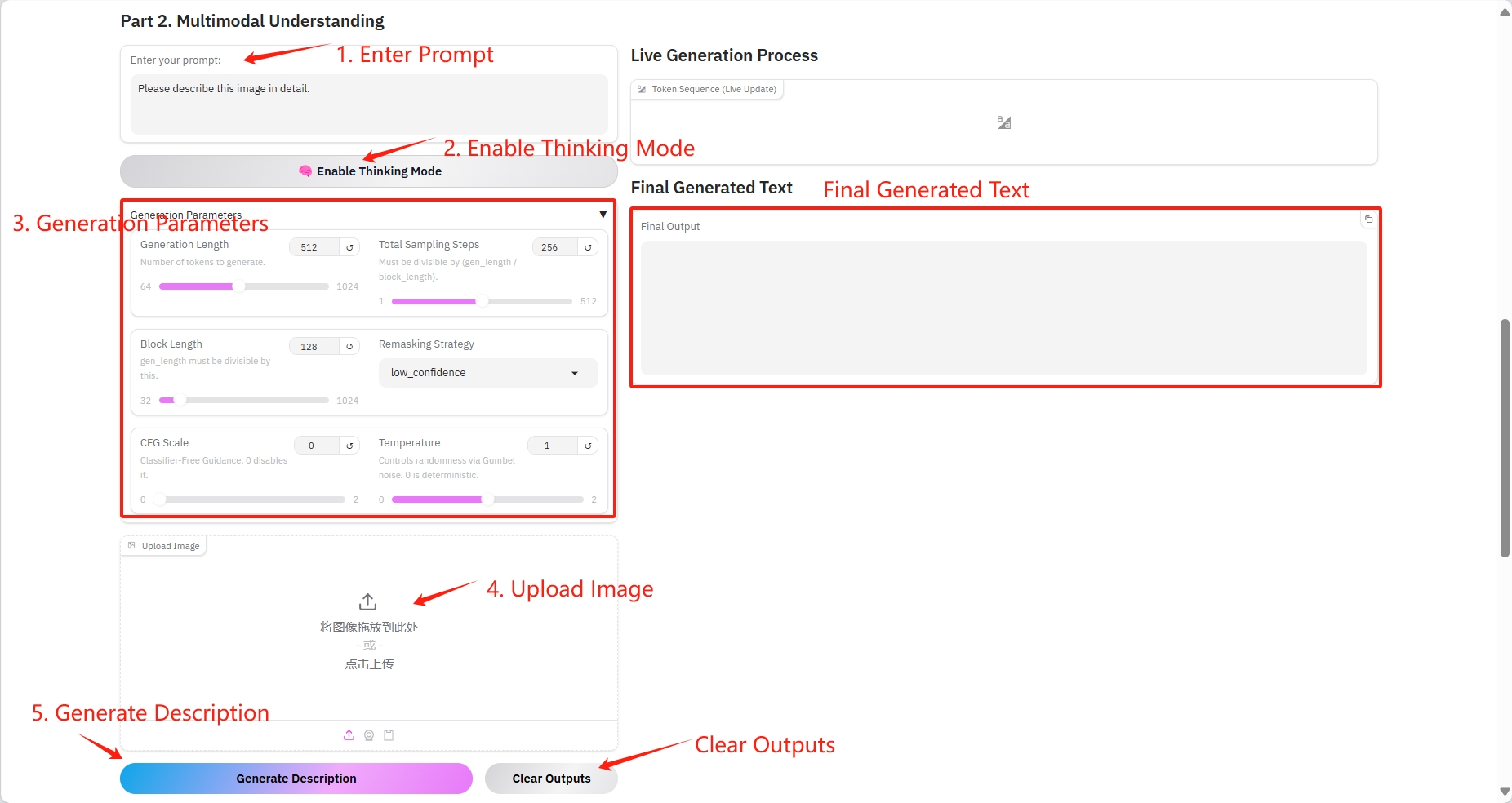

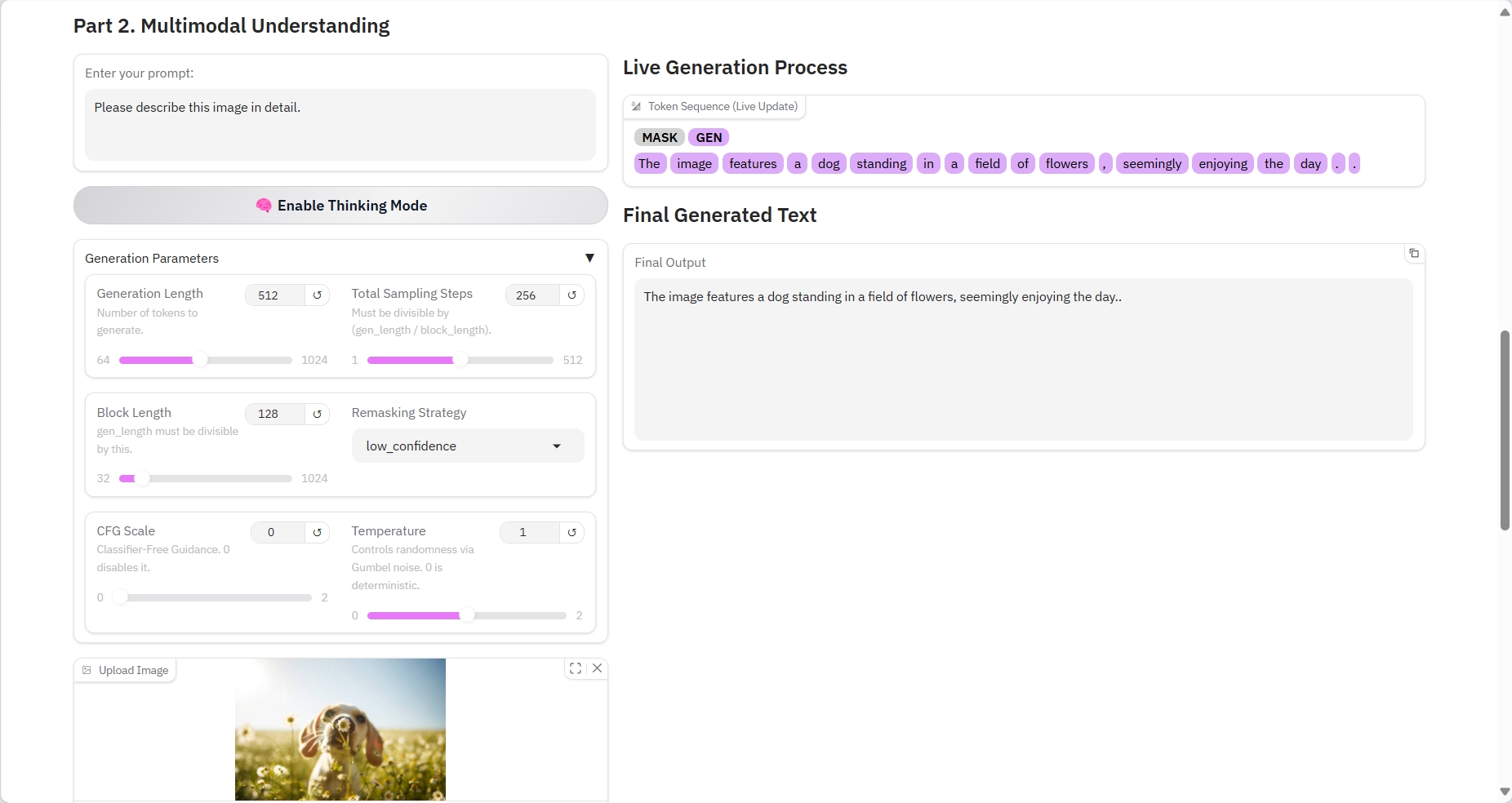

2. Multimodales Verständnis

Spezifische Parameter:

- Eingabeaufforderung: Hier können Sie Text eingeben.

- Generierungslänge: Die Anzahl der generierten Token.

- Gesamtzahl der Sampling-Schritte: Muss durch (Gen_Länge / Block_Länge) teilbar sein.

- Blocklänge: gen_length muss durch diese Zahl teilbar sein.

- Remaskierungsstrategie: Remaskierungsstrategie.

- CFG-Skala: Kein Klassifikatorleitfaden. 0 deaktiviert ihn.

- Temperatur: Steuert die Zufälligkeit über Gumbel-Rauschen. 0 ist deterministisch.

- Bild: Bild.

Ergebnisausgabe

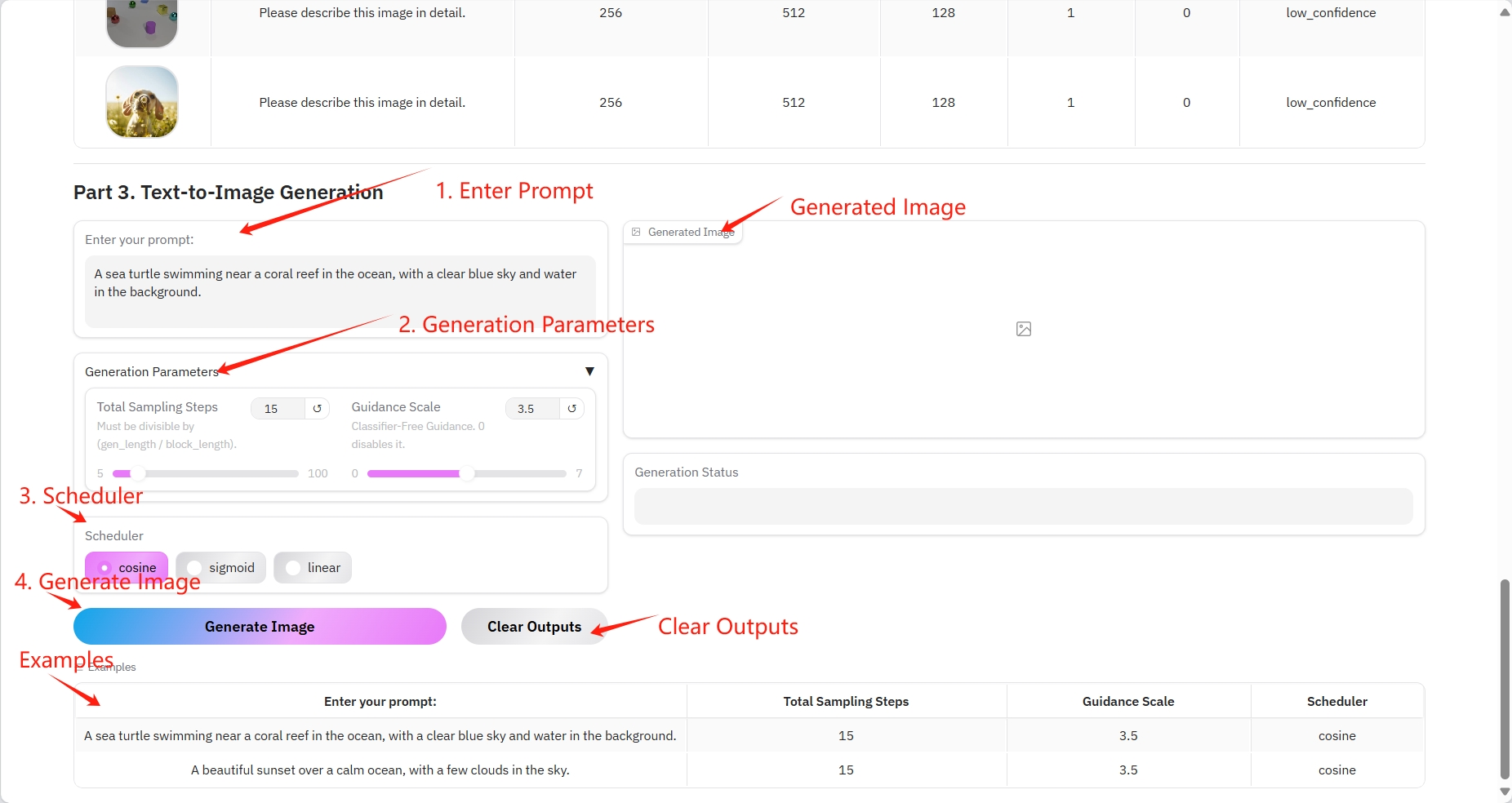

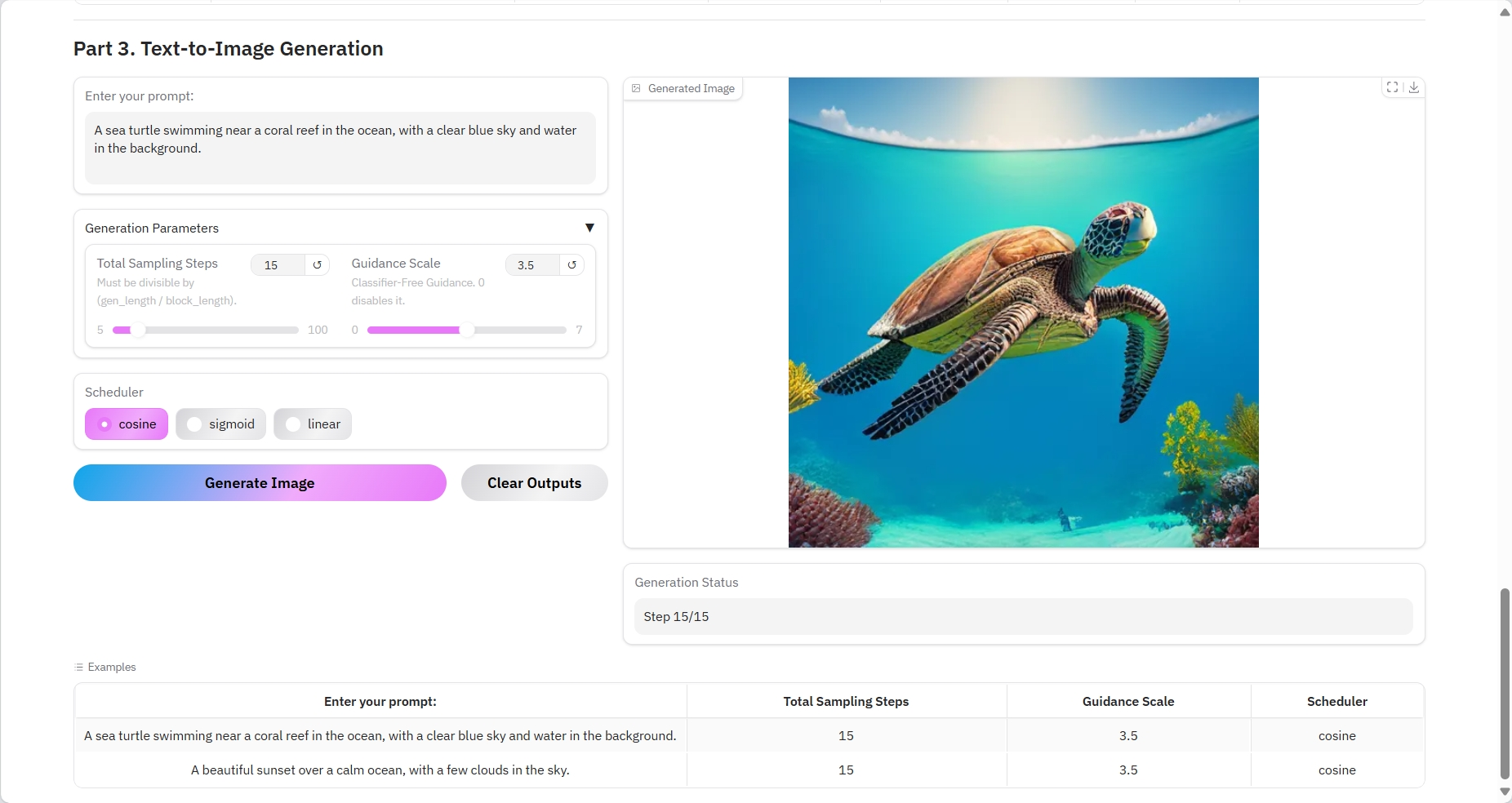

3. Text-zu-Bild-Generierung

Spezifische Parameter:

- Eingabeaufforderung: Hier können Sie Text eingeben.

- Gesamtzahl der Sampling-Schritte: Muss durch (Gen_Länge / Block_Länge) teilbar sein.

- Anleitungsskala: Keine Klassifikatoranleitung. 0 deaktiviert sie.

- Planer:

- Cosinus: Die Cosinus-Ähnlichkeit berechnet die Ähnlichkeit von Satzpaaren und optimiert die Einbettungsvektoren.

- Sigmoid: Multi-Label-Klassifizierung.

- Linear: Die lineare Ebene bildet den Einbettungsvektor des Bildpatches zur Aufmerksamkeitsberechnung auf eine höhere Dimension ab.

Ergebnisausgabe

4. Diskussion

🖌️ Wenn Sie ein hochwertiges Projekt sehen, hinterlassen Sie bitte im Hintergrund eine Nachricht, um es weiterzuempfehlen! Darüber hinaus haben wir auch eine Tutorien-Austauschgruppe ins Leben gerufen. Willkommen, Freunde, scannen Sie den QR-Code und kommentieren Sie [SD-Tutorial], um der Gruppe beizutreten, verschiedene technische Probleme zu besprechen und Anwendungsergebnisse auszutauschen ↓

Zitationsinformationen

Dank an den Github-Benutzer SuperYang Bereitstellung dieses Tutorials. Die Zitationsinformationen für dieses Projekt lauten wie folgt:

@article{yang2025mmada,

title={MMaDA: Multimodal Large Diffusion Language Models},

author={Yang, Ling and Tian, Ye and Li, Bowen and Zhang, Xinchen and Shen, Ke and Tong, Yunhai and Wang, Mengdi},

journal={arXiv preprint arXiv:2505.15809},

year={2025}

}KI mit KI entwickeln

Von der Idee bis zum Launch – beschleunigen Sie Ihre KI-Entwicklung mit kostenlosem KI-Co-Coding, sofort einsatzbereiter Umgebung und bestem GPU-Preis.