Command Palette

Search for a command to run...

Stellen Sie GLM-4-32B Mit vLLM Und Open-WebUI Bereit

1. Einführung in das Tutorial

Das GLM4-Projekt wurde 2025 von der THUDM-Organisation gestartet, und der entsprechende technische Bericht ist „ChatGLM: Eine Familie großer Sprachmodelle von GLM-130B bis GLM-4 – alle Tools“.

Die GLM-Familie begrüßt ein neues Mitglied, das Modell der GLM-4-32B-0414-Serie, das über 32 Milliarden Parameter verfügt, eine vergleichbare Leistung wie die GPT-Serie von OpenAI und die V3/R1-Serie von DeepSeek bietet und sehr benutzerfreundliche lokale Bereitstellungsfunktionen unterstützt. GLM-4-32B-Base-0414 wurde mit 15T hochwertigen Daten vortrainiert, darunter eine große Menge synthetischer Daten zum Schlussfolgern, und legte damit den Grundstein für die anschließende Erweiterung des bestärkenden Lernens. In der Phase nach dem Training führte das Forschungsteam eine Mensch-Maschine-Präferenzanpassung für Dialogszenarien ein. Darüber hinaus verwendete das Forschungsteam Techniken wie Rejection Sampling und Reinforcement Learning, um die Leistung des Modells bei der Anweisungsverfolgung, der Codeentwicklung und dem Funktionsaufruf zu verbessern und so die für Proxy-Aufgaben erforderlichen atomaren Fähigkeiten zu verbessern. GLM-4-32B-0414 erzielte gute Ergebnisse in den Bereichen Code-Engineering, Artefaktgenerierung, Funktionsaufruf, suchbasierte Fragebeantwortung und Berichterstellung. Insbesondere bei mehreren Benchmarks wie der Codegenerierung oder bestimmten Frage-und-Antwort-Aufgaben erreicht GLM-4-32B-Base-0414 eine vergleichbare Leistung wie größere Modelle wie GPT-4o und DeepSeek-V3-0324(671B).

Dieses Tutorial verwendet die Ressourcen für die Dual-SIM A6000.

👉 Dieses Projekt bietet ein Modell für:

- Modell GLM-4-32B-0414

Projektbeispiele

Animationszeichnung

| GLM-Z1-32B-0414 | GLM-4-32B-0414 |

| Schreiben Sie ein Python-Programm, das einen Ball zeigt, der in einem sich drehenden Sechseck hüpft. Der Ball sollte durch Schwerkraft und Reibung beeinflusst werden und er muss realistisch von den rotierenden Wänden abprallen | Verwenden Sie HTML, um einen kleinen Ball zu simulieren, der aus der Mitte eines rotierenden Sechsecks losgelassen wird. Betrachten Sie den Zusammenstoß zwischen dem Ball und der sechseckigen Grenze sowie die Schwerkraft auf dem Ball und gehen Sie davon aus, dass der Zusammenstoß vollkommen elastisch ist. |

Webdesign

| GLM-4-32B-0414 | GLM-4-32B-0414 |

SVG-Generierung

| GLM-4-32B-0414 | GLM-4-32B-0414 |

Analyse, Recherche und Schreiben

Analyse der KI-Entwicklung in chinesischen Städten: Eine vergleichende Studie von Peking und Hangzhou. Gleichzeitig untersuchen wir Fälle, in denen ausländische Städte KI für die Stadtverwaltung einsetzen.

2. Bedienungsschritte

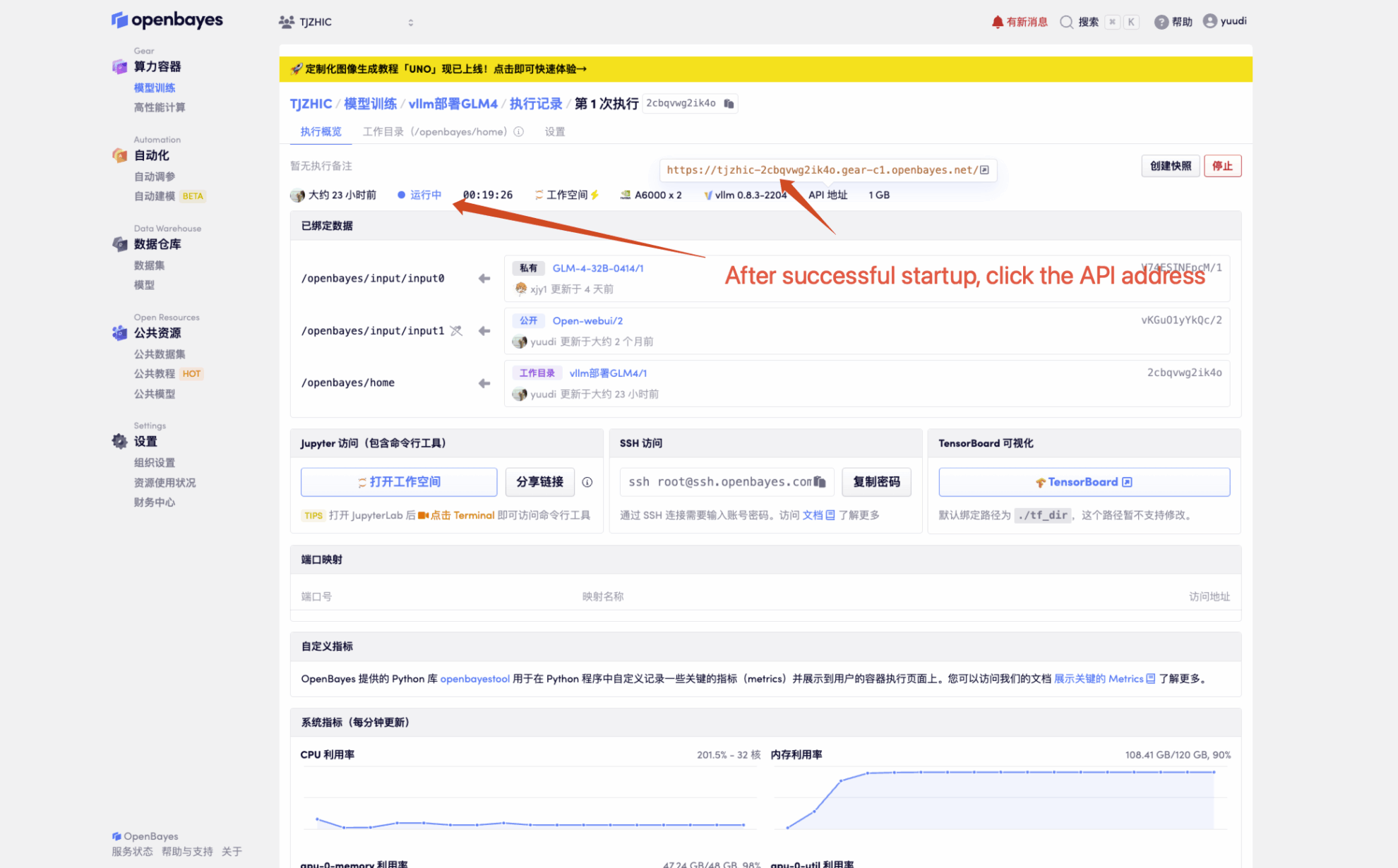

1. Klicken Sie nach dem Starten des Containers auf die API-Adresse, um die Weboberfläche aufzurufen

Wenn „Modell“ nicht angezeigt wird, bedeutet dies, dass das Modell initialisiert wird. Da das Modell groß ist, warten Sie bitte etwa 1–2 Minuten und aktualisieren Sie die Seite.

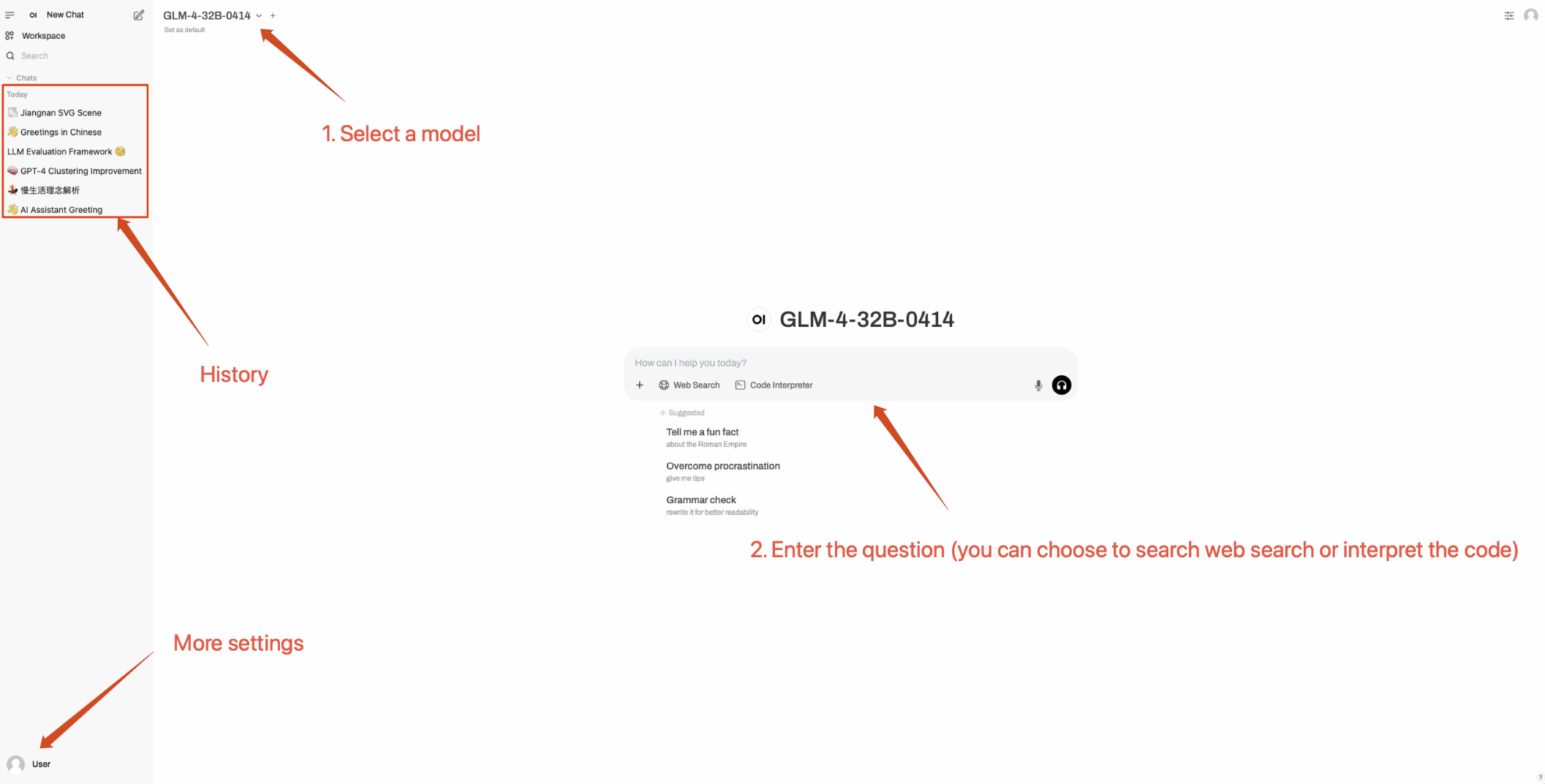

2. Nachdem Sie die Webseite aufgerufen haben, können Sie ein Gespräch mit dem Modell beginnen

Anwendung

Austausch und Diskussion

🖌️ Wenn Sie ein hochwertiges Projekt sehen, hinterlassen Sie bitte im Hintergrund eine Nachricht, um es weiterzuempfehlen! Darüber hinaus haben wir auch eine Tutorien-Austauschgruppe ins Leben gerufen. Willkommen, Freunde, scannen Sie den QR-Code und kommentieren Sie [SD-Tutorial], um der Gruppe beizutreten, verschiedene technische Probleme zu besprechen und Anwendungsergebnisse auszutauschen ↓

Zitationsinformationen

dankbar ZV-Liu Für die Bereitstellung dieses Lernprogramms lauten die Projektreferenzinformationen wie folgt:

@misc{glm2024chatglm,

title={ChatGLM: A Family of Large Language Models from GLM-130B to GLM-4 All Tools},

author={Team GLM and Aohan Zeng and Bin Xu and Bowen Wang and Chenhui Zhang and Da Yin and Diego Rojas and Guanyu Feng and Hanlin Zhao and Hanyu Lai and Hao Yu and Hongning Wang and Jiadai Sun and Jiajie Zhang and Jiale Cheng and Jiayi Gui and Jie Tang and Jing Zhang and Juanzi Li and Lei Zhao and Lindong Wu and Lucen Zhong and Mingdao Liu and Minlie Huang and Peng Zhang and Qinkai Zheng and Rui Lu and Shuaiqi Duan and Shudan Zhang and Shulin Cao and Shuxun Yang and Weng Lam Tam and Wenyi Zhao and Xiao Liu and Xiao Xia and Xiaohan Zhang and Xiaotao Gu and Xin Lv and Xinghan Liu and Xinyi Liu and Xinyue Yang and Xixuan Song and Xunkai Zhang and Yifan An and Yifan Xu and Yilin Niu and Yuantao Yang and Yueyan Li and Yushi Bai and Yuxiao Dong and Zehan Qi and Zhaoyu Wang and Zhen Yang and Zhengxiao Du and Zhenyu Hou and Zihan Wang},

year={2024},

eprint={2406.12793},

archivePrefix={arXiv},

primaryClass={id='cs.CL' full_name='Computation and Language' is_active=True alt_name='cmp-lg' in_archive='cs' is_general=False description='Covers natural language processing. Roughly includes material in ACM Subject Class I.2.7. Note that work on artificial languages (programming languages, logics, formal systems) that does not explicitly address natural-language issues broadly construed (natural-language processing, computational linguistics, speech, text retrieval, etc.) is not appropriate for this area.'}

}KI mit KI entwickeln

Von der Idee bis zum Launch – beschleunigen Sie Ihre KI-Entwicklung mit kostenlosem KI-Co-Coding, sofort einsatzbereiter Umgebung und bestem GPU-Preis.