Command Palette

Search for a command to run...

Die Produktion Der Zeichentrickversion Von „Die Drei Sonnen“ Hat begonnen. Wird Es Wirklich Im Jahr 2021 Erscheinen?

Vor Kurzem wurde auf Bilibili der offizielle Trailer zur Zeichentrickversion von „Die drei Sonnen“ veröffentlicht, der ankündigt, dass der fertige Film 2021 in die Kinos kommt. Das kurze dreiminütige Video erregte die Aufmerksamkeit von Millionen von Menschen. Wie lange müssen wir dieses Mal auf „Die drei Sonnen“ warten?

Diese Woche wurde das erste offizielle PV (Promotion-Video) der animierten Version von „Die drei Sonnen“ auf Bilibili veröffentlicht. Das Video erfreute sich unmittelbar nach seiner Veröffentlichung großer Beliebtheit und zahlreicher Klicks. Bis jetzt wurde dieses Video auf Bilibili fast 10 Millionen Mal abgespielt.

Das erste offizielle PV der Animation „Three Body“

Das äußerst beliebte „Drei-Körper-Problem“ hat Schwierigkeiten, in einen Film oder eine Fernsehserie adaptiert zu werden

Der Roman „Die drei Sonnen“ wurde 2006 erstmals als Fortsetzungsroman in „Science Fiction World“ veröffentlicht. Aufgrund seiner wundervollen Geschichte, seiner erhabenen Ideen und seines großartigen Themas wurde er schnell zu einem Science-Fiction-Meisterwerk, das Tausende von Menschen begehrten.

Seitdem wurde die Trilogie in Einzelbänden veröffentlicht und verkaufte sich im In- und Ausland gut. Sogar Zuckerberg und Obama haben es in den höchsten Tönen gelobt. Im Jahr 2015 gewann es den Hugo Award, die höchste Auszeichnung in der Science-Fiction-Welt, und wurde zu einem der einflussreichsten chinesischen Romane der Neuzeit weltweit.

Der Weg auf die Leinwand scheint für „Die drei Sonnen“ allerdings äußerst schwierig zu sein. Die Dreharbeiten zur Filmversion von „Die drei Sonnen“ begannen 2015, es gibt jedoch noch keine Neuigkeiten zu einer Veröffentlichung.

Die Komplexität der Geschichte, die Hardcore-Science-Fiction-Elemente und die äußerst fantasievollen Szenen stellen allesamt enorme Herausforderungen dar.

In einer Zeit, in der die Filmversion keinen Durchbruch schaffen kann, können durch die Umsetzung in eine Animation möglicherweise viele Einschränkungen vermieden werden. Da Animation selbst auf Vorstellungskraft beruht, kann sie auf wilde und fantasievolle Weise eingesetzt werden und es gibt nicht viele praktische Grenzen für die Bilder und visuellen Ausdrucksformen.

Vielleicht war es dieser Grund, der Bilibili dazu veranlasste, sich mit The Three-Body Universe und Yihua Kaitian zusammenzutun, um gemeinsam eine animierte Version von „Die drei Sonnen“ zu erstellen.

Warum ist es so schwierig, Animationen zu erstellen?

In den letzten Jahren hat es lange gedauert, bis die besten Animationswerke herauskamen.

„The Monkey King: Hero is Back“ förderte die heimische Animation.Acht Jahre dauerte die Politur, und lieferte schließlich eine zufriedenstellende Antwort und spielte an den Kinokassen 956 Millionen ein.

Die Produktion von „Nezha: Das Teufelskind kommt auf die Welt“ dauerte fünf Jahre und umfasste über 1.600 Mitwirkende.und spielte 4,9 Milliarden an den Kinokassen ein und wurde damit zum zweiterfolgreichsten Film in der chinesischen Filmgeschichte.

Hochwertige Animation ist ein riesiges Projekt und eine harte Arbeit: viel Charaktererstellung, Storyboard-Animation und Produktion von Spezialeffekten.Ein kurzes Video von etwas mehr als zehn Sekunden kann die Arbeit mehrerer Teams über mehrere Monate hinweg erfordern.

Glücklicherweise bringt die Entwicklung der KI-Technologie einige Erleichterungen bei der Produktion von Animationen. Vielleicht können einige neue KI-Technologien dabei helfen, effizientere Methoden oder Ideen bereitzustellen, um eine perfektere „Die drei Körper“-Animation zu erstellen.

Schwarze Technologie zur Beschleunigung von Animationen: Lassen Sie Bilder von selbst laufen

Für erfahrene Animatoren ist es nicht schwierig, eine Charakterkonstruktion zu erstellen, die dem Bild der Person entspricht. Um die Figuren jedoch wie gewünscht bewegen zu können, ist möglicherweise viel zusätzliche Arbeit erforderlich.

Beispielsweise das Zeichnen mehrerer Bewegungsaufnahmen bei 2D-Animationen oder die Motion-Capture-Technologie bei 3D-Animationen. Aber jetzt kann KI Fotos automatisch „aufwecken“ und sie bewegen.

Forscher der University of Washington und von Facebook veröffentlichten vor einiger Zeit eine Studie, in der mithilfe von KI Charaktere oder Figuren in statischen Bildern oder Gemälden in 3D-Animationen umgewandelt wurden.

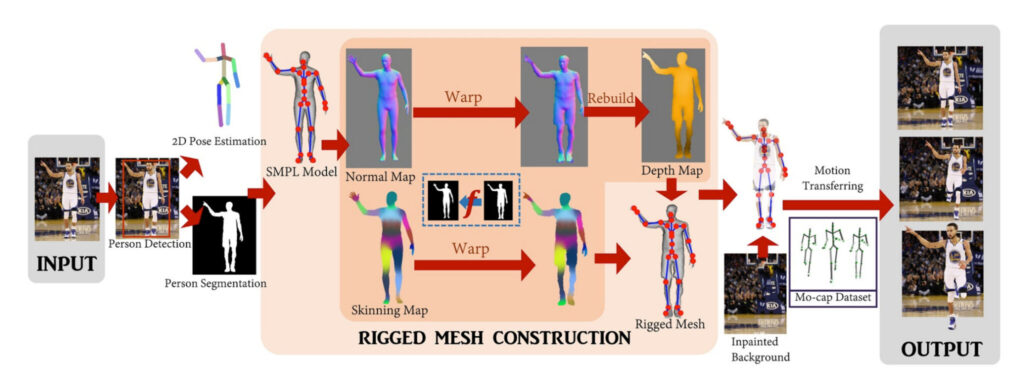

Bei dieser Technologie handelt es sich um ein Deep-Learning-Modell, das auf dem PyTorch-Framework entwickelt wurde. Die Software segmentiert die Person aus dem Bild und legt dann ein 3D-Netz darüber, das dann animiert wird, um das Foto oder Gemälde zum Leben zu erwecken.

Führen Sie mithilfe handelsüblicher Algorithmen Personenerkennung, 2D-Pose-Schätzung und Personensegmentierung auf Bildern durch. Anschließend wird ein SMPL-Vorlagenmodell (Skinned Multi-Person Linear Model, ein 3D-Charaktermodell) an eine 2D-Pose angepasst und als Normal Map und Skin Map in das Bild projiziert.

Der Kern dieses Schritts besteht darin, die Zuordnung zwischen der Silhouette der Person und der SMPL-Silhouette zu finden, die SMPL-Normal-/Hautkarte an die Ausgabe zu übergeben und die Tiefenkarte durch Integration der bewegten Normalkarte zu erstellen.

Wiederholen Sie diesen Vorgang, um die Rückansicht des Modells zu simulieren, indem Sie die Tiefenkarte und die Hautkarte kombinieren, um ein vollständig manipuliertes 3D-Netz zu erstellen. Das Netz wurde mithilfe einer Motion-Capture-Sequenz auf einem wiederhergestellten Hintergrund weiter texturiert und animiert.

Mit anderen Worten: Solange Sie über ein Ganzkörper-Frontalbild der Figur verfügen, können Sie mit dieser Technologie eine bewegte Szene erstellen. Es rekonstruiert den Weg zur Erstellung eines virtuellen Bildes aus einem einzelnen Bild und erkundet gleichzeitig die technischen Möglichkeiten der Modellierung von Charakteren aus Bildern.

Schwarze Technologie zur Beschleunigung von Animationen: Text automatisch in Animation umwandeln

Wenn Sie bei adaptierten Werken dem Originalwerk vollkommen treu bleiben und den Vorgang so weit wie möglich vereinfachen möchten, ist die Verwendung von Text zur direkten Generierung von Animationen möglicherweise die beste Lösung. An diesem Punkt verbessert sich die KI-Technologie ständig.

Im Jahr 2018 entwickelten Forscher der University of Illinois und des Allen Institute for Artificial Intelligence ein KI-Modell namens CRAFT (Composition, Retrieval, and Fusion Network), das anhand von Textbeschreibungen (oder Titeln) entsprechende animierte Szenen aus Filmmaterial von „Familie Feuerstein“ generieren kann.

Das endgültige KI-Modell wurde anhand von mehr als 25.000 Videoclips trainiert. Jedes Video im Filmmaterial ist 3 Sekunden lang und 75 Bilder lang und ist mit den Charakteren in der Szene und dem Inhalt der Szene beschriftet und kommentiert.

Das KI-Modell lernt, das Video mit der Textbeschreibung abzugleichen und legt einen Satz Parameter fest. Letztendlich kann die bereitgestellte Textbeschreibung in eine von Fans erstellte Abwandlung der Zeichentrickserie umgewandelt werden, einschließlich der aus dem Video gelernten Charaktere, Requisiten, Schauplätze usw.

Handelt es sich dabei nur um einfaches Bearbeiten und Zusammenfügen, kann die heutige KI noch viel mehr.

Im April dieses Jahres veröffentlichten Wissenschaftler von Disney und der Rutgers University ein Papier, in dem sie dem KI-Modell 996 Skripte zuführten und der KI schließlich beibrachten, basierend auf Textbeschreibungen automatisch Animationen zu generieren.

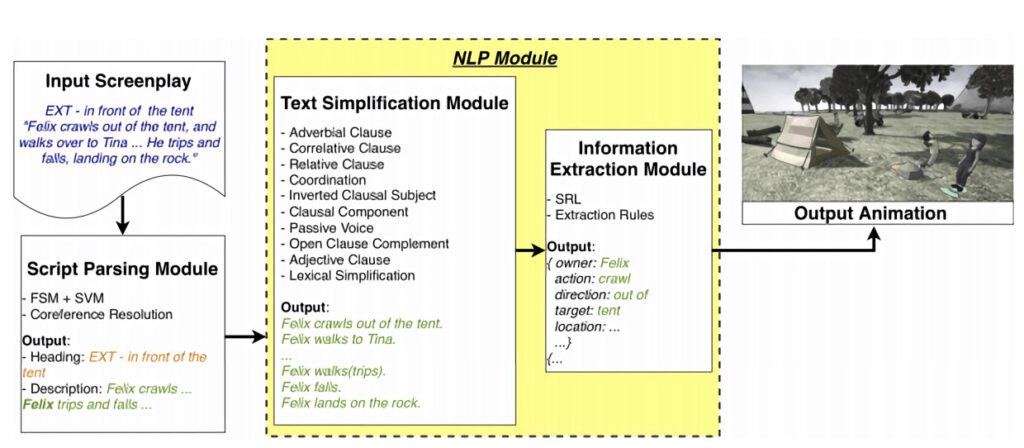

Damit KI aus Text ein Video generieren kann, muss sie den Text „verstehen“ und dann die entsprechende Animation generieren. Dazu verwendeten sie ein neuronales Netzwerk mit mehreren modularen Komponenten.

Das Modell besteht aus drei Teilen: Der erste ist ein Skriptanalysemodul, das die Szenen im Skripttext automatisch analysiert; Das zweite ist ein Modul zur Verarbeitung natürlicher Sprache, das die wichtigsten beschreibenden Sätze extrahieren und die Aktionsdarstellung verfeinern kann. und das letzte ist ein Generierungsmodul, das Aktionsanweisungen in Animationssequenzen umwandelt.

Die Forscher sammelten und ordneten Szenenbeschreibungen aus frei verfügbaren Drehbüchern und stellten ein Korpus zusammen. Es besteht aus 525.708 Beschreibungen mit 1.402.864 Sätzen, von denen 920.817 mindestens eine Aktion enthalten.

Sobald die Zuordnung zwischen der Beschreibungssprache und dem Video hergestellt ist, können durch Eingabe des Skripts einfache Animationsclips generiert werden. Im Testexperiment beträgt die Rationalität der generierten Animation 68%.

Wäre die Technologie ausgereifter, gäbe es die Informationsabweichung, die während des Anpassungsprozesses auftreten würde, nicht mehr.

2021, Animation "Das Drei-Körper-Problem" wir warten auf Sie

Obwohl es noch ein weiter Weg ist, bis diese Technologien bei der Produktion der Animation „Die drei Sonnen“ eingesetzt werden können, werden diese neuen Ideen einige neue Impulse in die Animationsproduktion bringen.

Aus heutiger Sicht dürfte der Tag, an dem KI-Modelle lernen, Animationen zu generieren, nicht mehr fern sein, sofern genügend Daten und Training vorhanden sind.

Zurück zur „Three-Body“-Animation: Mit dem starken Produktionsteam von Three-Body Universe und Yihua Kaitian sowie der starken Unterstützung von Bilibili wurden dieser Animation viele Chips hinzugefügt.

2021, egal ob es regnet oder die Sonne scheint, wir warten auf Sie!

-- über--