Command Palette

Search for a command to run...

AI Paper Weekly | Chai-2 Verbessert Die Effizienz Des Antikörperdesigns Mit Einer 100-fachen Steigerung Der Trefferquote; Ein Kurzer Blick Auf Mehrere in Die Engere Auswahl Gekommene ICML-Artikel

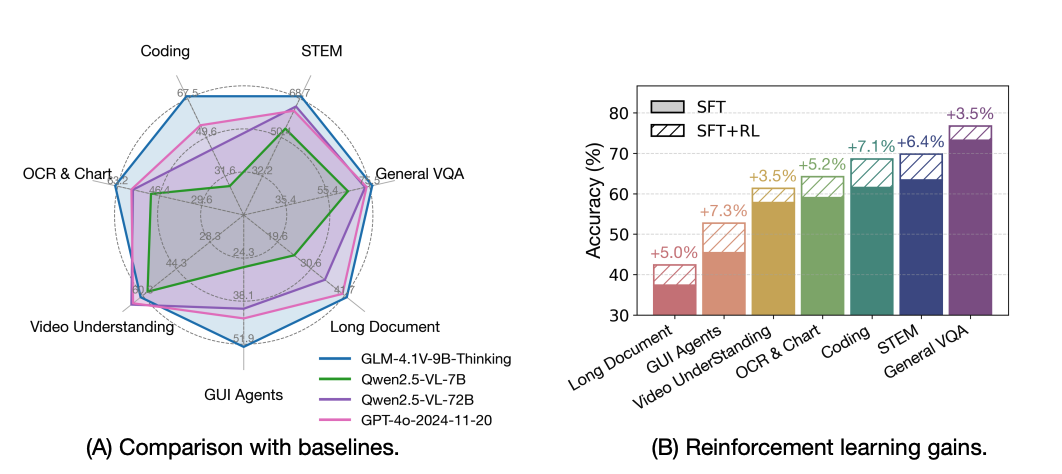

Visuelle Sprachmodelle (VLMs) durchbrechen allmählich die Grenzen des traditionellen Textverständnisses und entwickeln sich hin zu einer tiefen Wahrnehmung und Analyse komplexer visueller Informationen. Sie werden zu einem unverzichtbaren Kernbestandteil heutiger intelligenter Systeme. Mit dem deutlichen Fortschritt der Modellintelligenz erweitern sich ihre Anwendungsszenarien von der grundlegenden visuellen Wahrnehmung hin zur Lösung wissenschaftlicher Probleme und zum Aufbau autonomer intelligenter Agenten, was höhere Anforderungen an die Modellfähigkeiten mit sich bringt. Obwohl relevante Forschungen laufen, beschränken sich diese meist auf spezifische Bereiche, und es fehlt noch immer ein allgemeines multimodales Denkmodell.

In diesem Zusammenhang haben Zhipu AI und die Tsinghua-Universität gemeinsam GLM-4.1V-Thinking vorgeschlagen. Als allgemeines multimodales visuelles Sprachmodell für Verständnis und Schlussfolgerung bietet dieses Modell hervorragende Leistung bei einer Vielzahl von Aufgaben wie MINT-Problemlösung, Videoverständnis, Inhaltserkennung, Programmierung, Referenzauflösung, GUI-basierten Agenten und dem Verstehen langer Dokumente. Unter anderem zeigt es bei Aufgaben wie dem Verstehen langer Dokumente und MINT-Schlussfolgerungen eine vergleichbare oder bessere Leistung als Closed-Source-Modelle wie GPT-4o.

Link zum Artikel:https://go.hyper.ai/fEPb4

Neueste KI-Artikel:https://go.hyper.ai/hzChC

Um mehr Benutzer über die neuesten Entwicklungen im Bereich der künstlichen Intelligenz in der Wissenschaft zu informieren, wurde auf der offiziellen Website von HyperAI (hyper.ai) jetzt der Bereich „Neueste Artikel“ eingerichtet, in dem täglich hochmoderne KI-Forschungsartikel aktualisiert werden.Hier sind 5 beliebte KI-Artikel, die wir empfehlen,Enthält den UniMate Mechanical Metamaterials Benchmark Dataset und den Download-Link. Werfen Sie einen kurzen Blick auf die neuesten KI-Errungenschaften dieser Woche ⬇️

Die Zeitungsempfehlung dieser Woche

1 GLM-4.1V-Denken: Auf dem Weg zu vielseitigem multimodalem Denken mit skalierbarem Verstärkungslernen

Dieses Dokument stellt GLM-4.1V-Thinking vor, ein visuelles Sprachmodell zur Förderung des allgemeinen multimodalen Verständnisses und Denkens. Das Team hat das Modell GLM-4.1V-9B-Thinking als Open Source veröffentlicht, das im Vergleich zu Modellen ähnlicher Größe die höchste Leistung erzielt.

Nach umfassender Evaluierung anhand von 28 öffentlichen Benchmarks übertrifft das Modell Qwen2.5-VL-7B bei fast allen Aufgaben und zeigt bei 18 Benchmarks eine vergleichbare oder bessere Leistung als das deutlich größere Qwen2.5-VL-72B. Bemerkenswert ist auch, dass das Modell bei anspruchsvollen Aufgaben wie dem Verstehen langer Dokumente und MINT-Reaktionen eine vergleichbare oder bessere Leistung als Closed-Source-Modelle wie GPT-4o zeigt, was seine leistungsstarken Fähigkeiten weiter unterstreicht.

Link zum Artikel:https://go.hyper.ai/fEPb4

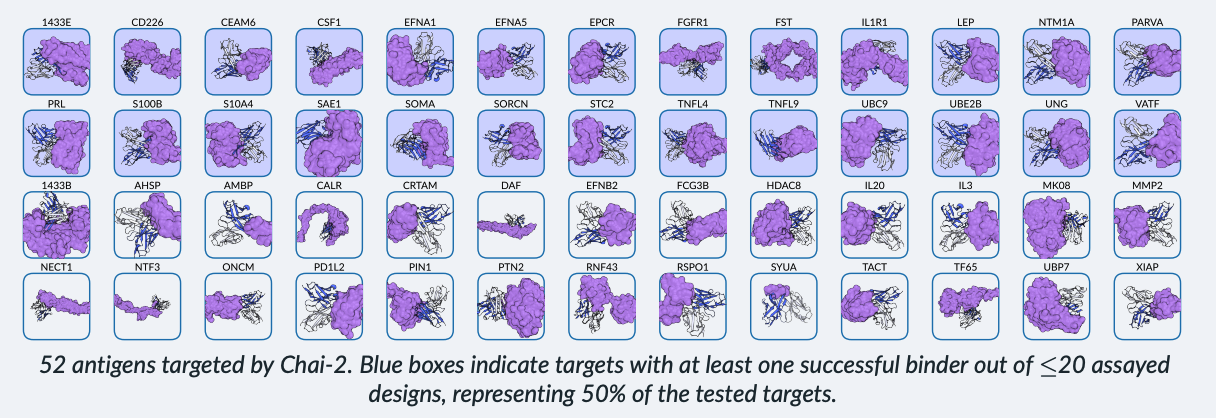

2 Zero-Shot-Antikörperdesign in einer 24-Well-Platte

Diese Arbeit stellt das multimodale generative Modell Chai-2 vor, das eine Trefferquote von 16% im komplett neu entwickelten Antikörperdesign erreicht – eine mehr als hundertfache Verbesserung gegenüber bisherigen Berechnungsmethoden. Neben dem Antikörperdesign weist Chai-2 im Labor eine Erfolgsquote von 68% im Mini-Protein-Design auf und generiert dabei häufig picomolare Binder. Die hohe Erfolgsquote von Chai-2 ermöglicht die schnelle experimentelle Validierung und Charakterisierung neuartiger Antikörper in weniger als zwei Wochen und ebnet damit den Weg für eine neue Ära der schnellen und präzisen molekularen Entwicklung im atomaren Maßstab.

Link zum Artikel:https://go.hyper.ai/rRRML

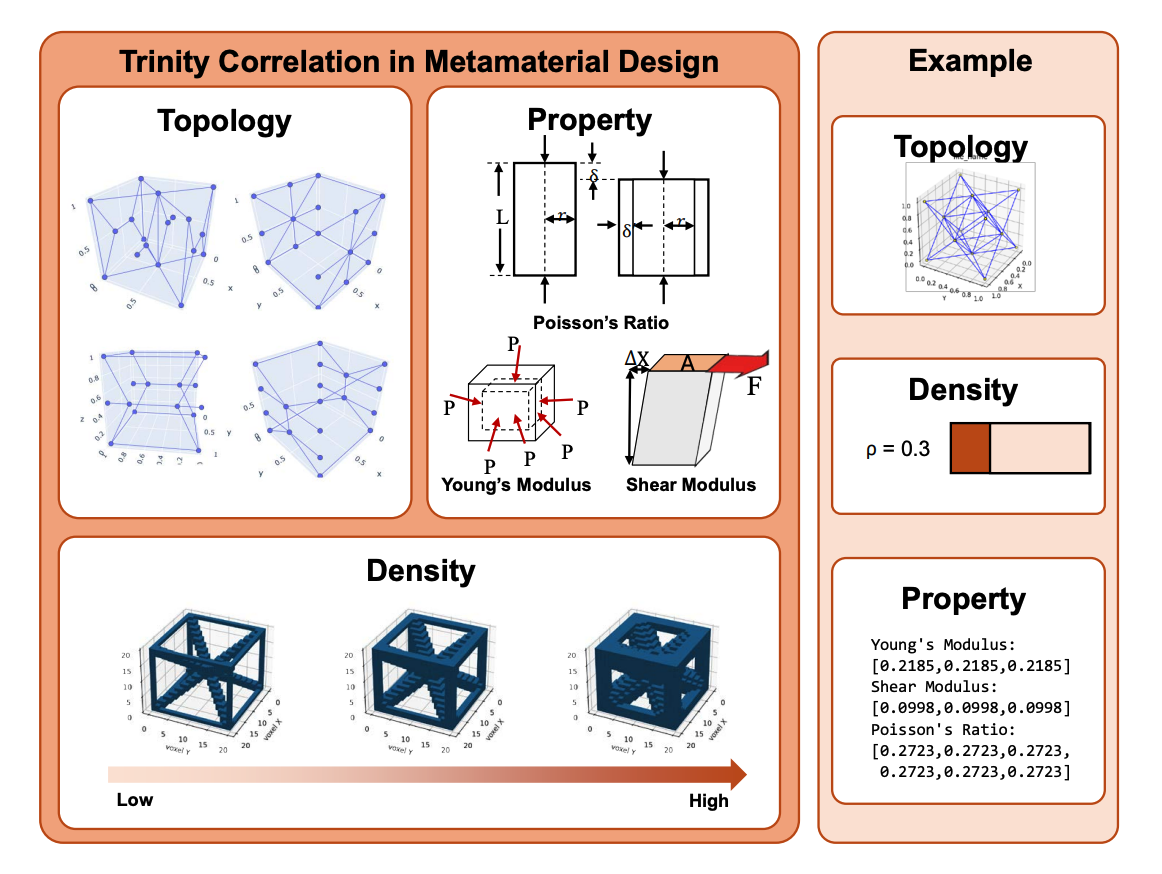

3 UniMate: Ein einheitliches Modell zur Erzeugung mechanischer Metamaterialien, zur Vorhersage von Eigenschaften und zur Zustandsbestätigung

Bei der Entwicklung mechanischer Metamaterialien spielen üblicherweise drei Hauptfaktoren eine Rolle: dreidimensionale topologische Struktur, Dichtebedingungen und mechanische Eigenschaften. Die meisten bestehenden Studien berücksichtigen jedoch nur zwei dieser Faktoren. Diese Arbeit schlägt ein einheitliches Modell, UniMate, vor, das aus einem Modul zur modalen Ausrichtung und einem Modul zur kooperativen Diffusionsgenerierung besteht. Experimentelle Ergebnisse zeigen, dass UniMate andere Basismodelle bei Topologiegenerierungsaufgaben, Leistungsvorhersageaufgaben und Zustandsbestätigungsaufgaben um 80,21 TP3T, 5,11 TP3T bzw. 50,21 TP3T übertrifft.

Link zum Artikel:https://go.hyper.ai/KNcmr

UniMate Mechanical Metamaterials Benchmark-Datensatz:https://go.hyper.ai/p4535

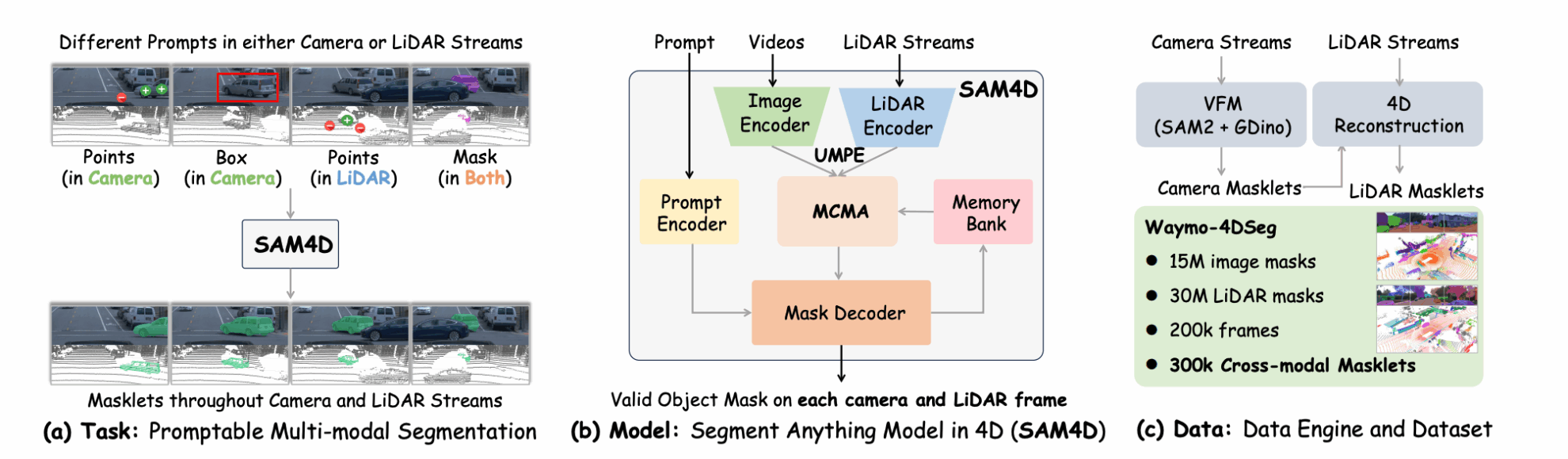

4 SAM4D: Segmentieren Sie alles in Kamera- und LiDAR-Streams

Dieser Artikel stellt das neue Modell SAM4D vor, das multimodale, raumzeitsensitive Segmentierungsaufgaben zwischen Kamera- und Radardatenströmen ermöglicht. Das Modell gleicht Kamera- und Radarfunktionen durch eine einheitliche multimodale Positionskodierung ab und nutzt einen bewegungssensitiven, modalübergreifenden Memory-Attention-Mechanismus, um die zeitliche Konsistenz zu verbessern und so eine robuste Segmentierung in dynamischen Umgebungen zu gewährleisten. Um den Annotationsengpass zu vermeiden, schlägt dieser Artikel außerdem eine automatische Daten-Engine vor, die automatisch hochwertige Pseudolabels basierend auf Videobild-Masklets, 4D-Rekonstruktion und modalübergreifender Masklet-Fusion generiert. Dies verbessert die Annotationseffizienz effektiv und erhält gleichzeitig die aus VFM abgeleitete semantische Genauigkeit.

Link zum Artikel:https://go.hyper.ai/QtQEx

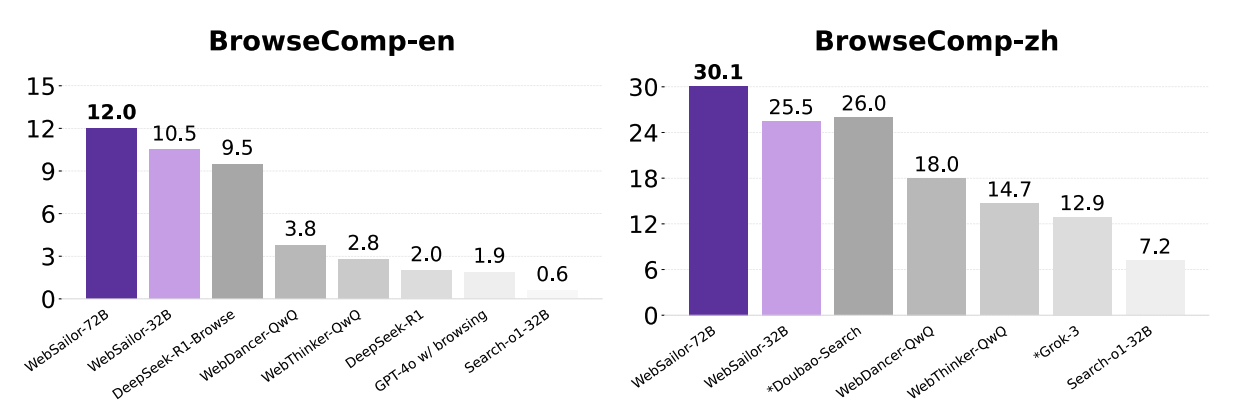

5 WebSailor: Navigieren durch übermenschliches Denken für Web-Agenten

Dieses Papier schlägt eine Methode zum Trainieren großer Sprachmodelle vor, um Denkfähigkeiten zu erreichen, die über die Grenzen der menschlichen Wahrnehmung hinausgehen. Dabei liegt der Schwerpunkt auf der Durchführung komplexer Informationssuchaufgaben. Die Methode basiert auf der Generierung schwer zu analysierender Aufgabendaten, dem Einsatz effektiver Reinforcement-Learning-Strategien und der Implementierung geeigneter Kaltstarttechniken zur Verbesserung der Modellfähigkeiten. Dadurch übertrifft das entwickelte WebSailor-Modell Open-Source-Modelle bei komplexen englischen und chinesischen Informationssuch-Benchmarks wie BrowseComp deutlich und erreicht oder erreicht das Leistungsniveau einiger proprietärer Systeme.

Link zum Artikel:https://go.hyper.ai/qyvf2

Dies ist der gesamte Inhalt der Papierempfehlung dieser Woche. Weitere aktuelle KI-Forschungsarbeiten finden Sie im Bereich „Neueste Arbeiten“ auf der offiziellen Website von hyper.ai.

Wir freuen uns auch über die Einreichung hochwertiger Ergebnisse und Veröffentlichungen durch Forschungsteams. Interessierte können sich im NeuroStar WeChat anmelden (WeChat-ID: Hyperai01).

Bis nächste Woche!