Command Palette

Search for a command to run...

Online-Tutorial: Das Shi Boxin-Team Der Peking-Universität Und Bayesian Computing Schlagen Die Methode VIRES Zum Neuzeichnen Von Videoinstanzen Vor, Mit Der Mehrere Leistungsindikatoren SOTA Erreichen

Können Videos auch mit Photoshop bearbeitet werden?

Wie wir alle wissen, ist die Videobearbeitung extrem schwierig. Wenn Sie das Motiv anpassen oder ersetzen, die Szene oder die Farbe ändern oder ein Objekt entfernen möchten,Dies erfordert häufig manuelle Anmerkungen, Maskenmalerei und sorgfältige Farbkorrektur unzähliger Einzelbilder.Selbst erfahrenen Postproduktionsteams fällt es schwer, bei der Bearbeitung komplexer Szenen die zeitliche Konsistenz zu wahren. Mit der rasanten Entwicklung der generativen KI sind in den letzten Jahren in verschiedenen Bearbeitungsprogrammen nach und nach Funktionen wie die „Ein-Klick-Eliminierung“ aufgetaucht, die das enorme Potenzial der KI in der Videobearbeitung erkennen lassen.

In der Praxis werden neben der universellen Eliminierungsfunktion häufig auch Funktionen zum Ersetzen und Hinzufügen von Motiven verwendet, die eine präzisere Zielerkennung, Segmentierung und Videogenerierung erfordern. Aktuelle KI-Methoden stehen jedoch bei der Bewältigung solcher Video-Neuzeichnungsaufgaben in komplexen Szenen immer noch vor Herausforderungen. Beispielsweise:Viele aktuelle Zero-Shot-Methoden neigen dazu, bei der Verarbeitung kontinuierlicher Videobilder ein Bildschirmflimmern zu verursachen; bei Szenen mit komplexen Hintergründen oder mehreren Zielen kann es zu Fehlausrichtungen, Unschärfe oder semantischen Abweichungen kommen.

Als Reaktion darauf hat sich das Camera Intelligence Laboratory der Peking University (Team von Shi Boxin) mit OpenBayes Bayesian Computing und dem Team von Associate Professor Li Si vom Pattern Recognition Laboratory der School of Artificial Intelligence der Beijing University of Posts and Telecommunications zusammengetan.Gemeinsam schlugen sie ein Videobeispiel für die Neuzeichnungsmethode VIRES vor, die Skizzen- und Textanleitungen kombiniert.Unterstützt mehrere Bearbeitungsvorgänge wie das Neuzeichnen, Ersetzen, Generieren und Entfernen des Videokörpers.

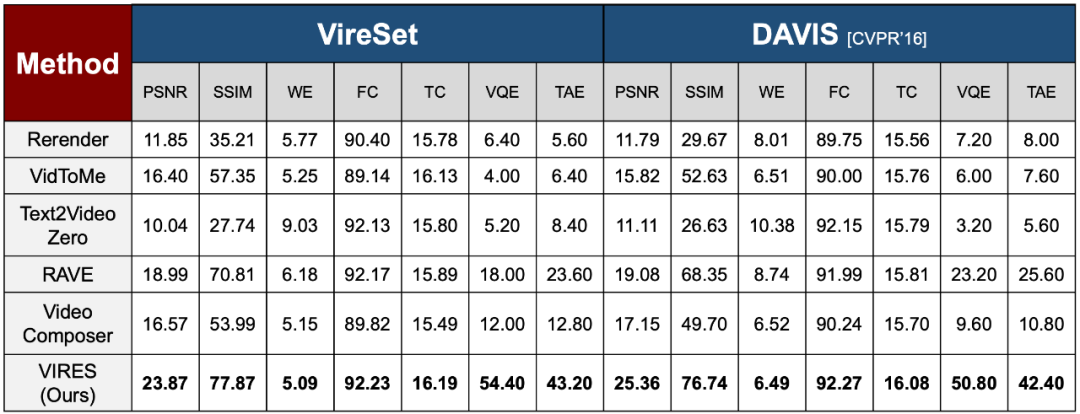

Diese Methode nutzt das Vorwissen des Text-zu-Video-Modells, um zeitliche Konsistenz zu gewährleisten. Darüber hinaus schlägt sie ein sequentielles Kontrollnetz mit einem standardisierten adaptiven Skalierungsmechanismus vor, der das strukturelle Layout effektiv extrahieren und kontrastreiche Skizzendetails adaptiv erfassen kann. Darüber hinaus führte das Forschungsteam einen Skizzenaufmerksamkeitsmechanismus im DiT-Backbone (Diffusion Transformer) ein, um feinkörnige Skizzensemantik zu interpretieren und einzufügen. Experimentelle Ergebnisse zeigen, dassVIRES übertrifft bestehende SOTA-Modelle in vielen Aspekten, darunter Videoqualität, zeitliche Konsistenz, bedingte Ausrichtung und Benutzerbewertungen.

Die zugehörige Forschung trägt den Titel „VIRES: Video Instance Repainting via Sketch and Text Guided Generation“ und wurde für CVPR 2025 ausgewählt.

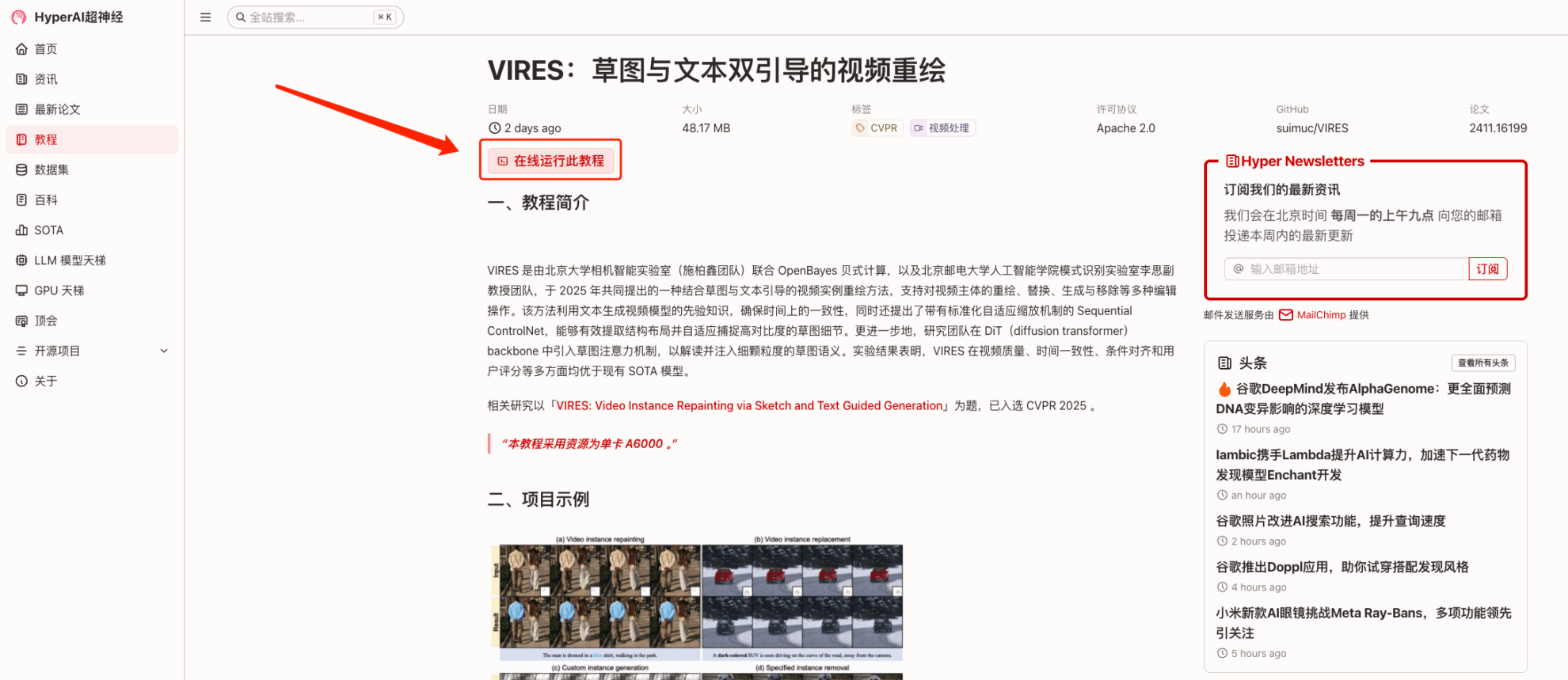

„VIRES: Sketch and Text Dual-Guided Video Redrawing“ ist aktuell im Tutorial-Bereich der offiziellen HyperAI-Website (hyper.ai) verfügbar. Mit nur einem Klick können Sie hochwertige Videobearbeitungsfunktionen online nutzen. Am Beispiel der Generierung benutzerdefinierter Instanzen hat der Autor einen Corgi hinzugefügt, der im Schnee läuft und naturgetreu wirkt und keinerlei Ungehorsam zeigt. ⬇️

Link zum Tutorial:https://go.hyper.ai/49koQ

Für neu registrierte Benutzer haben wir Überraschungsvorteile vorbereitet. Verwenden Sie den Einladungscode „VIRES“, um sich auf der OpenBayes-Plattform zu registrieren.Sie können RTX A6000 4 Stunden lang kostenlos nutzen (die Ressource ist 1 Monat gültig).Begrenzte Menge, wer zuerst kommt, mahlt zuerst!

Demolauf

1. Nachdem Sie die Homepage von hyper.ai aufgerufen haben, wählen Sie die Seite „Tutorials“, wählen Sie „VIRES: Video-Neuzeichnung mit Sketch and Text Dual Guide“ und klicken Sie auf „Dieses Tutorial online ausführen“.

2. Klicken Sie nach dem Seitensprung oben rechts auf „Klonen“, um das Tutorial in Ihren eigenen Container zu klonen.

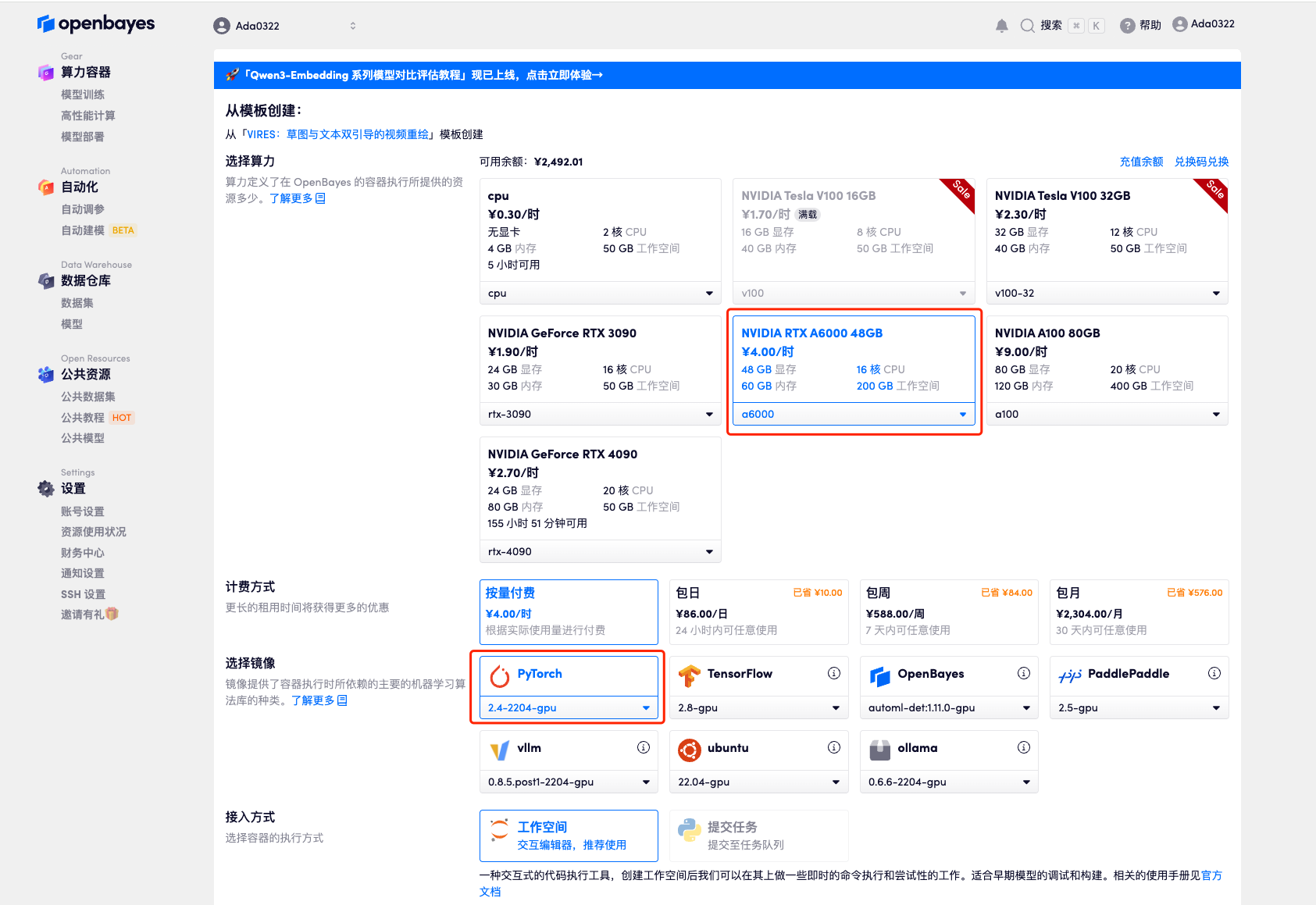

3. Wählen Sie die Bilder „NVIDIA RTX A6000“ und „PyTorch“ aus. Die OpenBayes-Plattform bietet vier Abrechnungsmethoden. Sie können je nach Bedarf zwischen „Pay-as-you-go“ oder „täglich/wöchentlich/monatlich“ wählen. Klicken Sie auf „Weiter“. Neue Benutzer können sich über den unten stehenden Einladungslink registrieren und erhalten 4 Stunden RTX 4090 + 5 Stunden CPU-freie Zeit!

Exklusiver Einladungslink von HyperAI (kopieren und im Browser öffnen):

https://openbayes.com/console/signup?r=Ada0322_NR0n

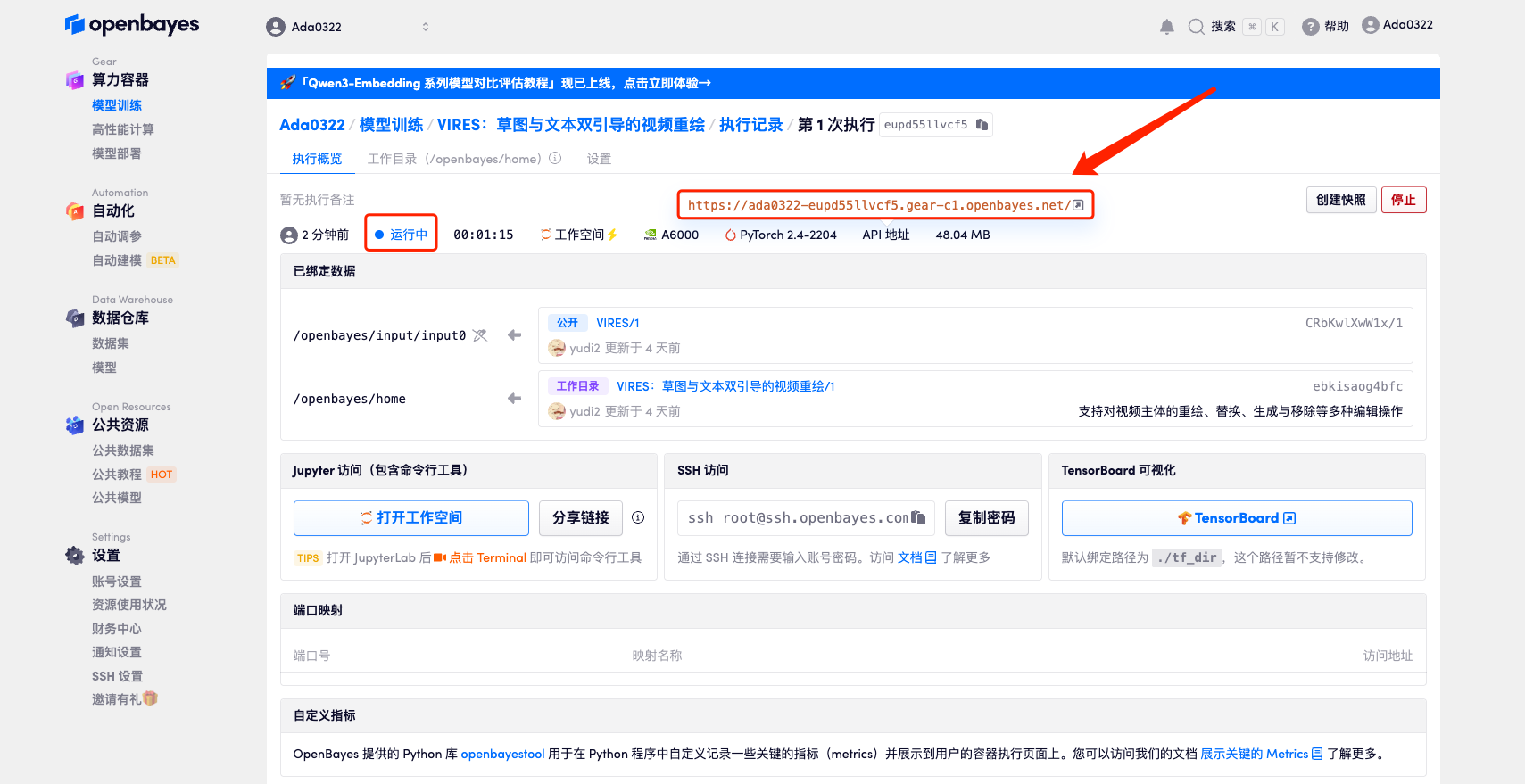

4. Warten Sie, bis die Ressourcen zugewiesen wurden. Der erste Klonvorgang dauert etwa 2 Minuten. Wenn sich der Status in „Läuft“ ändert, klicken Sie auf den Sprungpfeil neben „API-Adresse“, um zur Demoseite zu springen. Da das Modell groß ist, dauert es etwa 3 Minuten, bis die WebUI-Schnittstelle angezeigt wird, andernfalls wird „Bad Gateway“ angezeigt. Bitte beachten Sie, dass Benutzer vor der Verwendung der API-Adresszugriffsfunktion eine Echtnamenauthentifizierung durchführen müssen.

Effektdemonstration

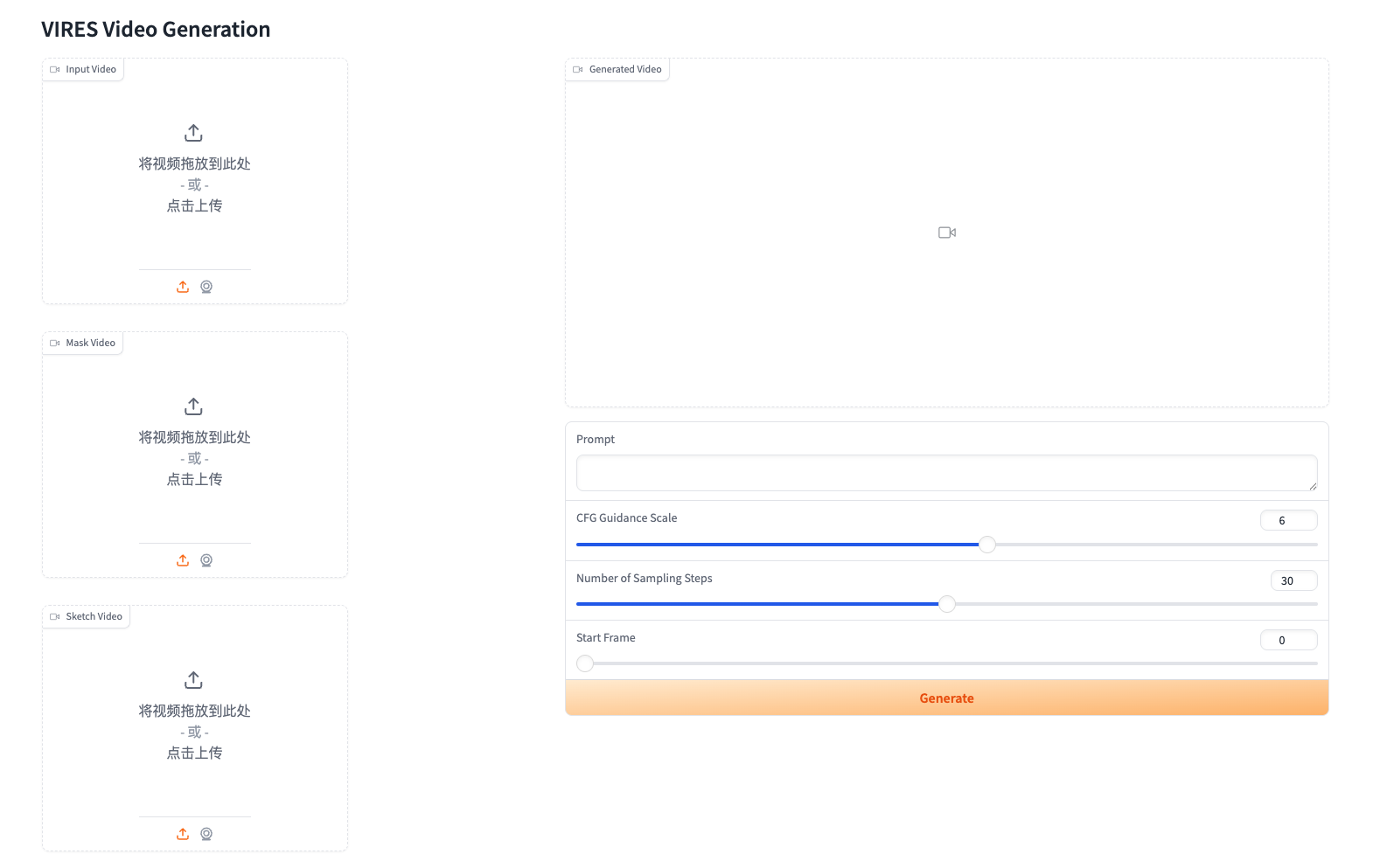

Klicken Sie auf die API-Adresse, um das Modell direkt zu erleben, wie in der folgenden Abbildung gezeigt. Wir haben im Tutorial mehrere Beispiele für Sie vorbereitet. Probieren Sie es aus!

Am Beispiel der „benutzerdefinierten Instanzgenerierung“ hat der Autor einen Corgi hinzugefügt, der im Schnee draußen rennt, lebensecht ist und keinerlei Ungehorsam zeigt!

* Originalvideo:

* Effekt erzeugen:

* Eingabeaufforderung:

Das Video zeigt eine bezaubernde Szene eines Corgis, der fröhlich in einem verschneiten Park hin und her rennt. Der Park ist mit Bäumen und einem Spielplatz im Hintergrund geschmückt und schafft so eine malerische Winteratmosphäre. Der Corgi mit seinem orange-weißen Fell und den ausdrucksstarken Augen rennt immer wieder auf die Kamera zu und wieder weg, wirbelt mit seinen Pfoten Schnee auf und zeigt ein verspieltes, energiegeladenes Wesen. Das Video fängt die Bewegungen des Corgis detailliert ein und konzentriert sich auf seine leuchtenden Augen, seine muskulösen Beine und seine agile Gestalt, während er im Schnee herumtollt. Der Macher wollte wahrscheinlich einen herzerwärmenden und visuell ansprechenden Moment teilen, der die Freude und Lebhaftigkeit eines geliebten Haustieres in einer wunderschönen verschneiten Landschaft zeigt.

Das Obige ist das diesmal von HyperAI empfohlene Tutorial. Jeder ist herzlich eingeladen, vorbeizukommen und es auszuprobieren!

Link zum Tutorial:https://go.hyper.ai/49koQ