Command Palette

Search for a command to run...

Online-Tutorial | Das Show Lab Der National University of Singapore Veröffentlicht Das OmniConsistency-Modell Für Eine Plug-and-Play-Bildstilübertragung

Ziel der Bildstilisierung ist es, ein Bild mithilfe eines stilisierten Modells von einem Stil in einen anderen zu transformieren und dabei den semantischen Inhalt unverändert zu lassen. In den letzten Jahren haben sich mit dem Aufkommen von Diffusionsmodellen die gängigen Bildstilisierungsmethoden von tiefen neuronalen Netzwerken zu Methoden verlagert, die durch Low-Rank-Adaption (LoRA) optimiert wurden. In Kombination mit Bildkonsistenzmodulen konnte die Stilisierungsqualität deutlich verbessert werden.

Obwohl das Bildstilisierungsmodell vom Markt gutes Feedback erhalten hat,Allerdings stehen aktuelle Methoden zur Bildstilisierung noch immer vor drei wesentlichen Herausforderungen:Erstens besteht eine eingeschränkte Konsistenz zwischen der stilisierten Ausgabe und der Eingabe – obwohl vorhandene Module eine allgemeine strukturelle Ausrichtung sicherstellen können, haben sie Schwierigkeiten, Details und semantische Informationen in komplexen Szenen beizubehalten; zweitens gibt es ein Problem der Stilverschlechterung in Bild-zu-Bild-Szenarien – die Stiltreue von LoRA und IPAdapter ist in dieser Umgebung normalerweise geringer als die von textgenerierten Bildern; drittens ist die Layoutsteuerung nicht flexibel genug – Methoden, die auf starren Bedingungen (wie Kanten, Skizzen, Haltungen) beruhen, haben Schwierigkeiten, kreative Strukturänderungen wie Q-Version-Transformationen zu unterstützen.

Um diese Lücke zu schließen,Am 28. Mai 2025 veröffentlichte das Show Lab der National University of Singapore OmniConsistency, ein universelles Konsistenz-Plug-in, das den Massively Diffuse Transformer (DiT) verwendet.Es handelt sich um ein vollständiges Plug-and-Play-Design, das mit jedem LoRA-Stil im Flux-Framework kompatibel ist und auf dem Konsistenzlernmechanismus stilisierter Bildpaare basiert, um eine robuste Generalisierung zu erreichen.

Experimente zeigen, dass OmniConsistency die visuelle Kohärenz und ästhetische Qualität deutlich verbessert.Es erreicht eine mit GPT-4o vergleichbare Leistung und schließt die Leistungslücke zwischen Open-Source-Modellen und kommerziellen Modellen in Bezug auf Stilkonsistenz.Es bietet eine kostengünstige und gut steuerbare Lösung für die KI-Erstellung. Darüber hinaus erleichtern die Kompatibilität und die Plug-and-Play-Funktionen Entwicklern und Kreativen die Nutzung.

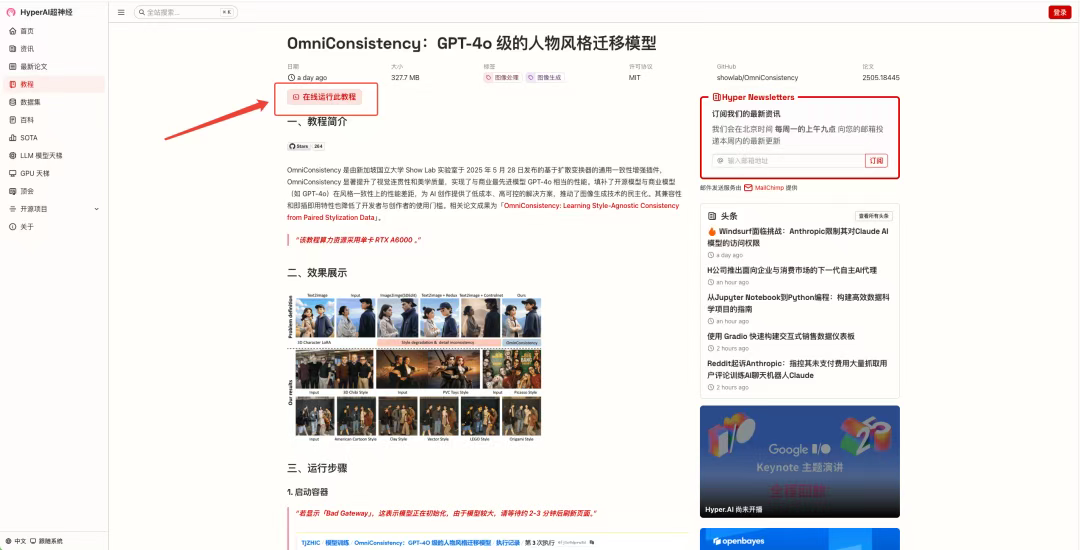

derzeit,„OmniConsistency: Ein Charakterstil-Übertragungsmodell auf GPT-4o-Ebene“ wurde im Abschnitt „Tutorials“ der offiziellen Website von HyperAI veröffentlicht.Klicken Sie auf den Link unten, um das Tutorial zur Bereitstellung mit einem Klick zu erleben ⬇️

* Adresse des Tutorials:https://go.hyper.ai/3mCyv

Wir haben auch Überraschungsvorteile für neu registrierte Benutzer vorbereitet. Registrieren Sie sich mit dem Einladungscode „OmniConsistency“ auf der OpenBayes-Plattform und erhalten Sie 4 Stunden kostenlose Nutzung der RTX A6000 (die Ressource ist einen Monat lang gültig). Die Anzahl ist begrenzt, wer zuerst kommt, mahlt zuerst!

Demolauf

1. Nachdem Sie die Homepage von hyper.ai aufgerufen haben, wählen Sie die Seite „Tutorial“, wählen Sie „OmniConsistency: GPT-4o-Level-Charakterstil-Übertragungsmodell“ und klicken Sie auf „Dieses Tutorial online ausführen“.

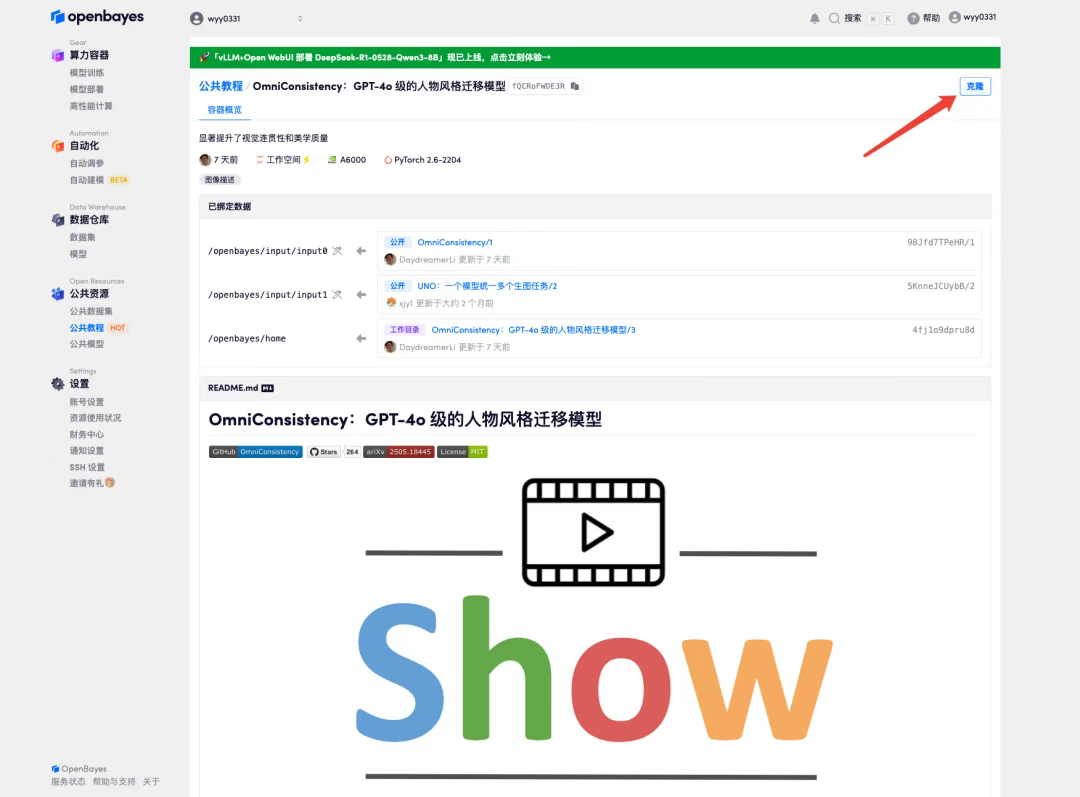

2. Klicken Sie nach dem Seitensprung oben rechts auf „Klonen“, um das Tutorial in Ihren eigenen Container zu klonen.

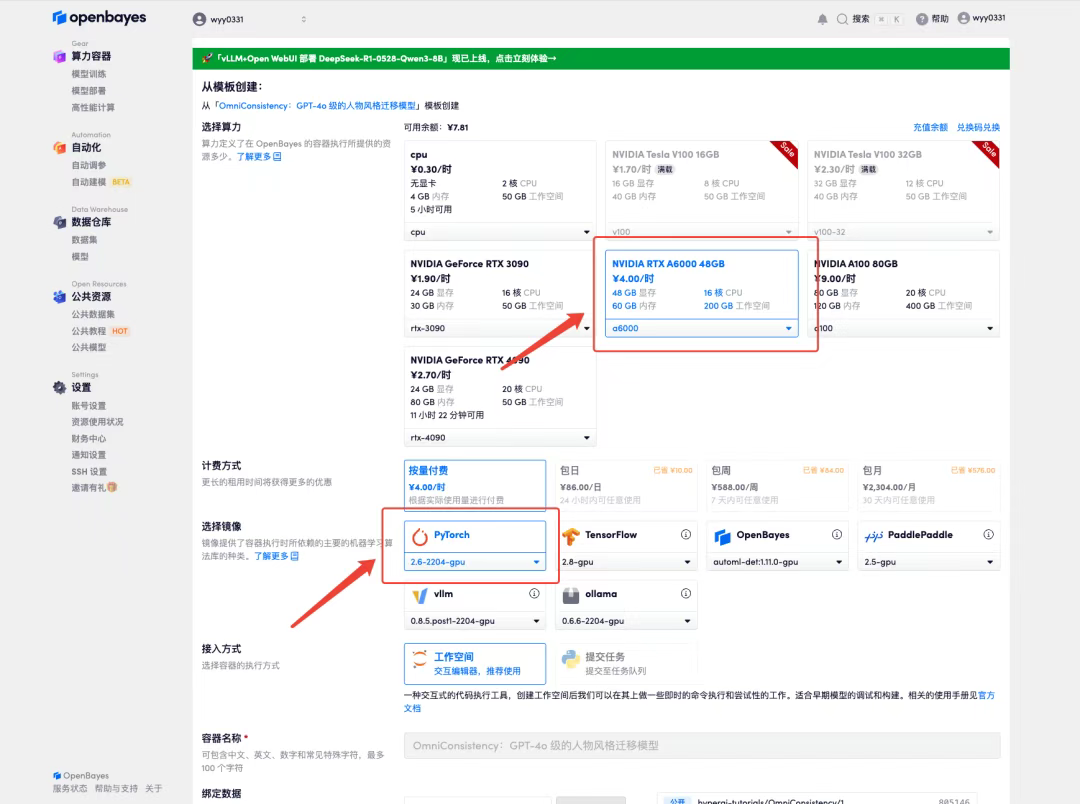

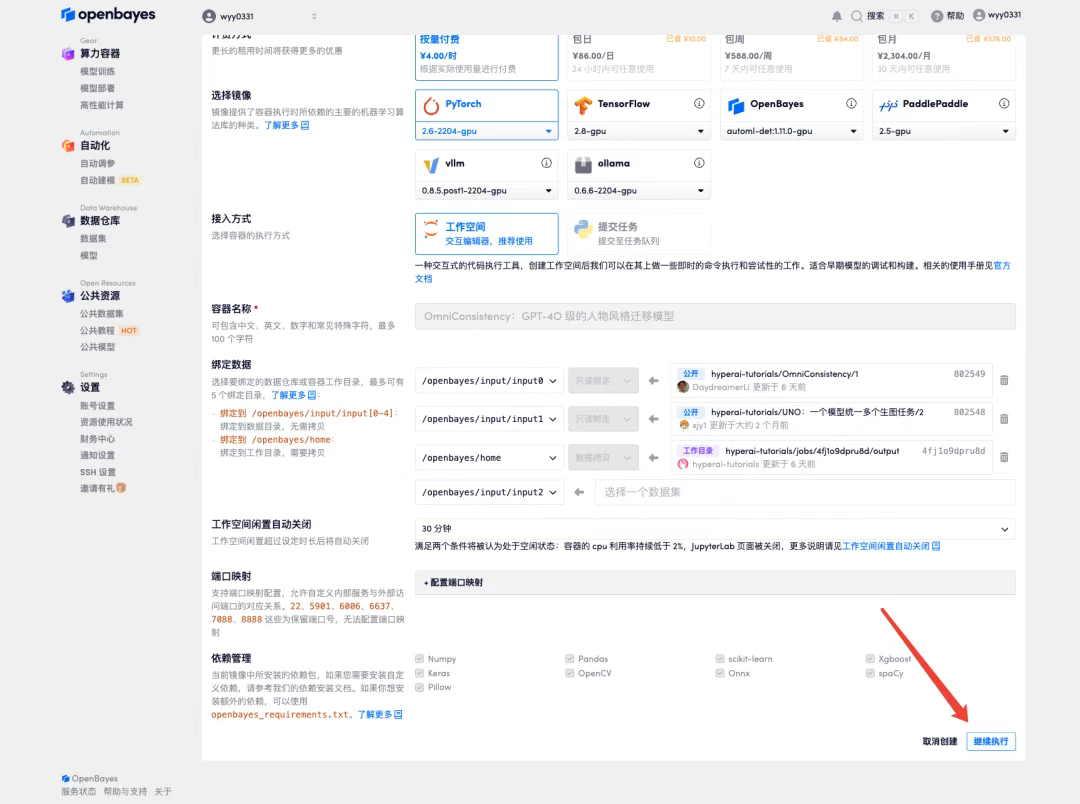

3. Wählen Sie die Bilder „NVIDIA RTX A6000 48 GB“ und „PyTorch“ aus. Die OpenBayes-Plattform bietet vier Abrechnungsmethoden. Sie können je nach Bedarf zwischen „Pay as you go“ oder „Täglich/Wöchentlich/Monatlich“ wählen. Klicken Sie auf „Weiter“. Neue Benutzer können sich über den unten stehenden Einladungslink registrieren und erhalten 4 Stunden RTX 4090 + 5 Stunden CPU-freie Zeit!

Exklusiver Einladungslink von HyperAI (kopieren und im Browser öffnen):

https://openbayes.com/console/signup?r=Ada0322_NR0n

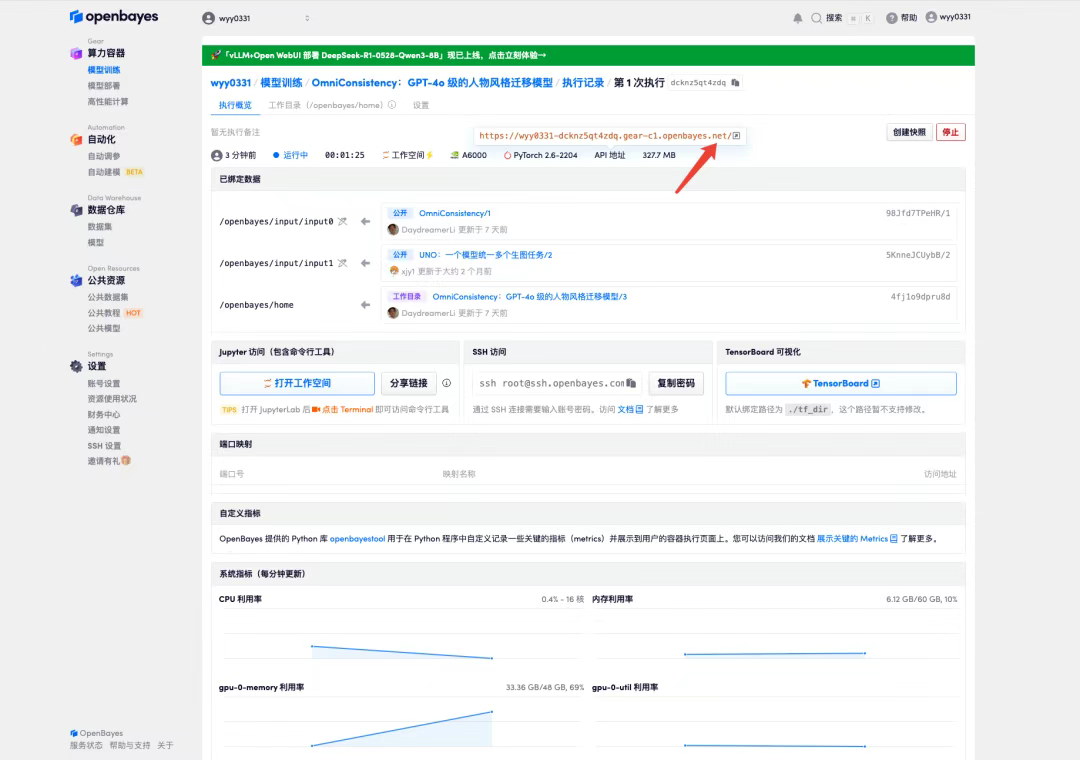

4. Warten Sie, bis die Ressourcen zugewiesen wurden. Der erste Klonvorgang dauert etwa 2 Minuten. Wenn sich der Status in „Läuft“ ändert, klicken Sie auf den Sprungpfeil neben „API-Adresse“, um zur Demoseite zu springen. Da das Modell groß ist, dauert es etwa 3 Minuten, bis die WebUI-Schnittstelle angezeigt wird, andernfalls wird „Bad Gateway“ angezeigt. Bitte beachten Sie, dass Benutzer vor der Verwendung der API-Adresszugriffsfunktion eine Echtnamenauthentifizierung durchführen müssen.

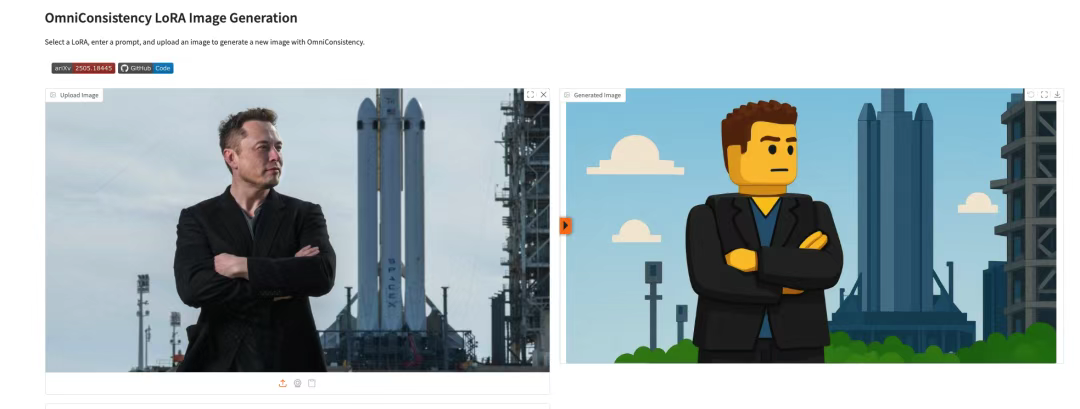

Effektdemonstration

Ich habe ein Porträtfoto hochgeladen und der Parameter „Eingebautes LoRA auswählen“ ist LEGO. Der Effekt ist in der folgenden Abbildung dargestellt.