Command Palette

Search for a command to run...

Die Für AAAI 2025 Ausgewählte Zhejiang-Universität Schlug Ein Viele-zu-Eins-Regressionsmodell M2OST Vor, Das Digitale Pathologiebilder Verwendet, Um Die Genexpression Genau Vorherzusagen

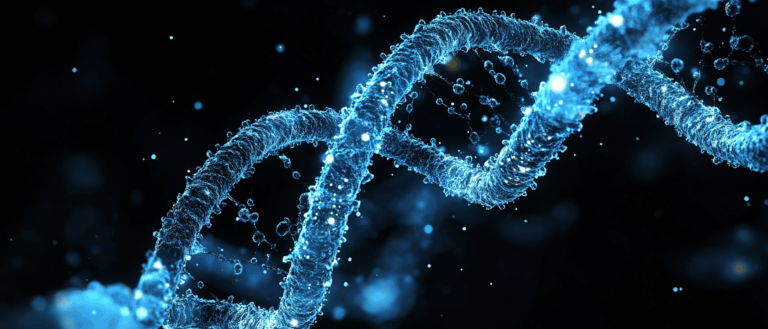

Als Whole Slice Pathology Image (WSI) können digitale Pathologiebilder Gewebeschnitte digital mit hoher Auflösung darstellen und die Zellmorphologie, -struktur und räumlichen Verteilungsmerkmale umfassend anzeigen. Im Vergleich zu herkömmlichen Objektträgern aus Glas sind WSIs nicht nur einfacher zu lagern und zu analysieren, sondern bieten auch intuitivere Gewebeansichten in mehreren Maßstäben. Daher werden sie zunehmend in der pathologischen Diagnostik und der biomedizinischen Forschung eingesetzt. Durch die Analyse dieser Bilder können Forscher den inneren Zusammenhang zwischen der räumlichen Organisation der Zellen und der Genexpression erforschen und so die komplexen Mechanismen der Transkriptionsregulation in mehrzelligen Systemen aufdecken.

In den letzten Jahren hat sich die räumliche Transkriptomik (ST) als räumliche Erweiterungstechnologie der Einzelzell-RNA-Sequenzierung zu einem wichtigen Instrument für die Untersuchung der Verteilung, Interaktion und molekularen Mechanismen von Zellsubtypen entwickelt. Aufgrund der hohen Kosten für Ausrüstung und Reagenzien ist es für die ST-Technologie jedoch immer noch schwierig, sich in der Praxis durchzusetzen. Im Vergleich dazu sind WSIs wirtschaftlicher und für die klinische Anwendung zugänglicher. Daher hat sich die Frage, wie sich ST-Karten mithilfe von Deep Learning kostengünstig aus WSIs rekonstruieren lassen, zu einer Forschungsrichtung entwickelt, die viel Aufmerksamkeit auf sich zieht.

Die meisten bestehenden Methoden betrachten das ST-Vorhersageproblem als ein traditionelles Regressionsproblem und verwenden einstufige Bild-Beschriftungspaare für das Training. Dies beschränkt sie darauf, Genexpressionsbeziehungen nur für Bilder mit maximaler Vergrößerung zu modellieren, wodurch die inhärenten mehrskaligen Informationen von WSIs verschwendet werden.

Basierend auf diesem Problem,Das Forschungsteam von Professor Lin Lanfen von der Zhejiang-Universität in China hat zusammen mit dem Zhejiang Hangzhou Zhijiang Laboratory und der Ritsumeikan-Universität in Japan M2OST vorgeschlagen, ein Viele-zu-Eins-Regressionstransformermodell, das darauf abzielt, die Genexpression mithilfe pathologischer Bilder auf verschiedenen Ebenen gemeinsam vorherzusagen.Durch die Integration der visuellen Informationen von Stichprobenpunkten und mehrskaligen Merkmalen in WSIs kann das Modell genauere ST-Karten erstellen. Darüber hinaus hat das Forschungsteam den Viele-zu-eins-Mehrschicht-Merkmalsextraktionsprozess in eine Intra-Layer-Merkmalsextraktion und eine Cross-Layer-Merkmalsextraktion entkoppelt, wodurch der Rechenaufwand erheblich reduziert und die Rechenleistung optimiert wurde, ohne die Modellleistung zu beeinträchtigen.

Die entsprechenden Ergebnisse wurden für AAAI 2025 unter dem Titel „M2OST: Many-to-one Regression for Predicting Spatial Transcriptomics from Digital Pathology Images“ ausgewählt.

Forschungshighlights:* Konzeptualisieren Sie das ST-Vorhersageproblem als ein Viele-zu-Eins-Modellierungsproblem und sagen Sie die ST-Karte gemeinsam vorher, indem Sie die in den hierarchischen WSIs eingebetteten Multiskaleninformationen und Interpunktmerkmale verwenden. * Schlagen Sie ein Transformer-Modell M2OST vor, das auf Viele-zu-Eins-Regression basiert und gegenüber Eingabesätzen unterschiedlicher Sequenzlängen robust ist.

* Entkoppeln Sie den mehrskaligen Merkmalsextraktionsprozess in M2OST in eine Merkmalsextraktion innerhalb und eine Merkmalsextraktion über mehrere Schichten hinweg, wodurch die Rechenleistung erheblich verbessert wird, ohne die Modellleistung zu beeinträchtigen.

* Es wurden umfassende Experimente mit der vorgeschlagenen M2OST-Methode durchgeführt und ihre Wirksamkeit anhand von drei öffentlichen ST-Datensätzen nachgewiesen.

Papieradresse:

https://hyper.ai/cn/sota/papers/2409.15092

konzentrieren Sie sich auf HyperAlÖffentliches WeChat-Konto. Antworten Sie im Backstage-Bereich mit „M2OST“, um das vollständige PDF zu erhalten.

Das Open-Source-Projekt „awesome-ai4s“ vereint mehr als 200 AI4S-Papierinterpretationen und stellt umfangreiche Datensätze und Tools bereit:

https://github.com/hyperai/awesome-ai4s

Datensatz: Verwenden Sie 3 ST-Datensätze, um die Wirksamkeit zu demonstrieren

Das Forschungsteam verwendete drei öffentliche ST-Datensätze, um die Leistung des vorgeschlagenen M2OST-Modells zu bewerten:

*Datensatz zum menschlichen Brustkrebs (HBC):Es enthält 30.612 Loci in 68 WSIs mit jeweils höchstens 26.949 verschiedenen Genen. Die Punkte in diesem Datensatz haben einen Durchmesser von 100 μm und sind in einem Raster mit einem Mittenabstand von 200 μm angeordnet.

*Datensatz zu positiven Brusttumoren beim Menschen (HER2):Es besteht aus 36 pathologischen Bildern und 13.594 Punkten, von denen jeder 15.045 aufgezeichnete Genexpressionsdaten enthält. Der Mittenabstand zwischen jedem erfassten Punkt der ST-Daten in diesem Datensatz beträgt 200 μm und der Durchmesser jedes Punkts beträgt 100 μm.

*Datensatz zum menschlichen kutanen Plattenepithelkarzinom (cSCC):Enthält 12 WSIs und 8.671 Punkte. An jedem Locus in diesem Datensatz wurden 16.959 Gene analysiert. Alle Punkte haben einen Durchmesser von 110 μm und sind in einem mittelgroßen rechteckigen Array mit einem Mittenabstand von 150 μm angeordnet.

M2OST-Modell: Viele-zu-eins-Regressionsstruktur, mehrstufige pathologische Bilder sagen gemeinsam die Genexpression voraus

In den letzten Jahren hat sich die Vorhersage räumlicher Transkriptomprofile (ST) aus Ganzschicht-Pathologiebildern (WSIs) zu einem Forschungsschwerpunkt im Bereich der digitalen Pathologie entwickelt. Frühe Methoden wie ST-Net und DeepSpaCE führen ST-Vorhersagen auf Bildpatch-Ebene basierend auf Convolutional Neural Networks (CNN) durch. Das kürzlich veröffentlichte bimodale Einbettungsframework BLEEP führt eine kontrastive Lernstrategie ein, um WSI-Bildpatch-Funktionen mit ST-Punkteinbettungen auszurichten, und führt den K-Nearest-Neighbor-Algorithmus ein, um das Batch-Effektproblem in der Inferenzphase zu lindern.

Mit dem Aufkommen von Transformer-basierten Modellen hat ihre Leistung die des traditionellen CNN übertroffen. Das Deep-Learning-Modell HisToGene führte Transformer erstmals in die Vorhersage der Genexpression ein, wodurch eine Modellierung auf Folienebene erreicht und die Effizienz verbessert wurde, allerdings immer noch durch die Rechenressourcen begrenzt war. Das Hist2ST-Modell integriert CNN, Transformer und Graph-Neuralnetzwerke, um auch Fernabhängigkeiten besser zu erfassen.Allerdings führt die komplexe Modellstruktur auch zu einem erhöhten Risiko einer Überanpassung.

Im Gegensatz zur gängigen Idee, sich auf die Korrelation zwischen Stichprobenpunkten zu konzentrieren, betont iStar, eine Methode, die auf der hierarchischen Extraktion von Bildmerkmalen basiert, dass die Genexpression innerhalb des Stichprobenpunkts nur mit dem entsprechenden Bildblockbereich zusammenhängt, verwendet vorab trainiertes HIPT zur Merkmalsextraktion und ordnet es über MLP den Expressionswerten zu, mit hervorragender Leistung.Da die Funktionen jedoch nicht erlernbar sind, besteht noch Raum für weitere Optimierungen.

Davon inspiriert, das ForschungsteamM2OST verwendet auch eine Bildblock-Level-Lösung.Sagen Sie jeweils einen Stichprobenpunkt voraus, um die Unabhängigkeit und Genauigkeit jeder Vorhersage sicherzustellen.Das Forschungsteam hat außerdem die Ideen von iStar weiterentwickelt und eine Reihe lernfähiger Module zur Merkmalsextraktion und -fusion auf mehreren Skalen entwickelt. Durch die detaillierte Modellierung lokaler Bereiche und die maßstabsübergreifende Informationsintegration wurde die Vorhersagefähigkeit des Modells unter komplexen Organisationsstrukturen verbessert.

Wie in der folgenden Abbildung dargestellt, werden drei Bildpatchsequenzen aus verschiedenen Ebenen von Whole-Slice-Pathologiebildern (WSIs) in das Modell eingegeben, um gemeinsam die Genexpression der entsprechenden Stellen vorherzusagen.

Nach dem Empfang der pathologischen Bildblöcke aus 3 verschiedenen Ebenen,Zuerst speist M2OST sie in die Deformable Block Embedding (DPE)-Schicht ein.Um eine adaptive Token-Generierung zu erreichen. DPE extrahiert nicht nur grundlegende Pathologie-Patches aus jedem Bild, sondern fügt auch größere Patches in Pathologie-Bilder auf höherer Ebene ein, um umfassendere Kontextinformationen zu erfassen.

Gleichzeitig generiert DPE feinkörnige Intrapunkt-Token und grobkörnige Umgebungs-Token, um den Fokus des Modells auf die Merkmale des zentralen Bereichs des Abtastpunkts zu stärken. Dadurch werden die Interpunkt-Merkmale im Viele-zu-Eins-Modellierungsprozess hervorgehoben und eine verfeinerte und strukturiertere Merkmalsdarstellung für die nachfolgende Ausdrucksvorhersage bereitgestellt.

M2OST-Modelldiagramm

In M2OST verwendetes DPE

Dann wird jeder Sequenz ein CLS-Token hinzugefügt und, wie im PE in der Abbildung gezeigt, eine lernbare Positionskodierung eingeführt. M2OST verwendet das Inner Token Hybrid Module (ITMM), um Intra-Layer-Funktionen für jede Sequenz zu extrahieren. ITMM basiert auf der Vision Transformer-Architektur und führt den Random Mask Self-Attention-Mechanismus (Rand Mask Self-Attn) ein, um die Generalisierungsfähigkeit des Modells im Bildmodellierungsprozess zu verbessern.

Die Netzwerkstruktur des ITMM

Nachdem die intraschichtige Merkmalsextraktion abgeschlossen ist, führt M2OST ein schichtübergreifendes Token-Mixing-Modul (CTMM) ein, um die schichtübergreifende Informationsinteraktion zwischen mehrschichtigen Sequenzen zu fördern.Aufgrund der unterschiedlichen Längen von Eingabesequenzen mit mehreren Skalen führt CTMM einen vollständig verbundenen schichtübergreifenden Aufmerksamkeitsmechanismus ein, um durch direkte Fusion verursachte Informationsverzerrungen zu vermeiden und gleichzeitig die relative Unabhängigkeit der Parameter jedes Skalenzweigs aufrechtzuerhalten.Um die Fähigkeit zum maßstabsübergreifenden Informationsaustausch auf Kanalebene zu verbessern, führte M2OST anschließend nach CTMM ein schichtübergreifendes Kanalmischmodul (CCMM) ein.

CCMM verwendet ein Strukturdesign, das unempfindlich gegenüber der Sequenzlänge ist.CTMM integriert dynamisch maßstabsübergreifende Kontextinformationen basierend auf der Aufmerksamkeitsähnlichkeit und den lernbaren Gewichten zwischen verschiedenen Ebenen und gibt mehrschichtige Sequenzen derselben Form aus.Zunächst wird ein globales Durchschnittspooling für die Sequenz jeder Schicht durchgeführt, um ihre Sequenzinformationen in eine Token-Darstellung zu komprimieren. Anschließend werden Token verschiedener Ebenen miteinander kombiniert und der ebenenübergreifende Kanal-Aufmerksamkeitswert in Kombination mit dem Squeeze-Anreizmechanismus (Squeeze & Excitation) berechnet. Diese Bewertungen werden dann wieder ihren jeweiligen Eingabesequenzen zugeordnet, wodurch der kanalübergreifende Informationsaustausch abgeschlossen wird.

(a) Netzwerkstruktur von CTMM. (b) Die Netzwerkstruktur von CCMM.

Dieser mehrskalige Merkmalsmodellierungsprozess stellt als Ganzes das Encodermodul von M2OST dar und wird N-mal im gesamten Netzwerk iteriert, um die mehrstufige, ausdrucksstarke Bilddarstellung, die für die räumliche Transkriptomvorhersage erforderlich ist, schrittweise zu erweitern.endlich,Die drei cls-Token werden verbunden und in den linearen Regressionskopf zur ST-Punktvorhersage eingespeist.

Experimentelle Ergebnisse: Mehrdimensionale Evaluation belegt die Wirksamkeit des M2OST-Modells

Das Forschungsteam verglich die Leistung von M2OST umfassend mit einer Vielzahl gängiger Methoden anhand mehrerer Datensätze. Die experimentellen Ergebnisse sind in der folgenden Tabelle dargestellt.M2OST erreicht eine überlegene Leistung mit weniger Parametern und weniger FLOPs.Im Vergleich zu ST-Net ist die Anzahl der Parameter von M2OST um 0,40 M reduziert, die FLOPs sind um 0,63 G reduziert und der Pearson-Korrelationskoeffizient (PCC) von M2OST auf HER2+- und cSCC-Datensätzen ist um 1,16% bzw. 1,13% verbessert.

Vergleichende experimentelle Ergebnisse von M2OST und anderen Methoden

Vergleich von M2OST mit Eins-zu-Eins-Multiskalenmethoden:

Das Forschungsteam verglich M2OST außerdem mit gängigen Eins-zu-eins-Multiskalenmethoden wie CrossViT und HIPT/iStar. Im Vergleich zum Standard-ViT weist CrossViT stärkere ST-Regressionsfähigkeiten auf und bestätigt die erheblichen Vorteile der Integration von Informationen mit mehreren Skalen in diese Aufgabe. CrossViT weist jedoch gewisse Einschränkungen bei der Modellierung von Intrapunktinformationen auf und seine Gesamtleistung ist immer noch schlechter als die von M2OST.

Darüber hinaus weist iStar eine gute ST-Vorhersagegenauigkeit auf und demonstriert damit die Effektivität der HIPT-Architektur bei der Extraktion mehrskaliger Merkmale aus WSI. Um jedoch Rechenkosten zu sparen, verwendet iStar feste HIPT-Gewichte, um WSI-Funktionen für die ST-Vorhersage zu generieren, was seine Fähigkeit zur Merkmalsextraktion einschränkt. Gleichzeitig erhöht der Block-für-Block- und Maßstab-für-Maßstab-Extraktionsprozess von iStar im Hinblick auf die Inferenzeffizienz die Verarbeitungszeit erheblich. Die Forschungsergebnisse zeigen, dass die Inferenzgeschwindigkeit von M2OST bei gleicher GPU-Speicherbeschränkung etwa 100-mal schneller ist als die von iStar und dass die Leistung immer noch besser ist als die von letzterem. Dies verdeutlicht das Potenzial des End-to-End-Trainings bei ST-Regressionsaufgaben und die Wirksamkeit des M2OST-Modells.

Vergleich der ST-Methoden auf Bild-Patch-Ebene und auf Objektträgerebene:

Experimentelle Ergebnisse zeigen, dass die Leistung von Methoden auf Folienebene bei den drei Datensätzen im Allgemeinen schlechter ist als die von Methoden auf Bildblockebene. Obwohl Hist2ST eine bessere Leistung als HisToGene aufweist, ist diese Leistungsverbesserung aufgrund der großen Anzahl von Parametern und hohen FLOPs unbedeutend. Im Vergleich zu grundlegenden Bildblockmethoden wie ST-Net wird der PCC von Hist2ST in den drei Datensätzen um 2,78%, 2,99% bzw. 2,66% reduziert. Dies deutet darauf hin, dass die Genexpression eines Punktes hauptsächlich mit der entsprechenden Geweberegion zusammenhängt und die Einführung einer Interpunktkorrelation die Vorhersagegenauigkeit nicht wesentlich verbessert. Dennoch ist die Slide-Level-Methode bei der Generierung vollständiger ST-Karten immer noch effizienter und es besteht weiterhin Potenzial, durch die Optimierung des Netzwerkdesigns in der Zukunft eine wettbewerbsfähige Regressionsgenauigkeit zu erreichen.

Visuelle Analyse:

(a) Visualisierung des räumlichen Transkriptomprofils (ST) nach Hauptkomponentenanalyse (PCA). (b) Visualisierung der räumlichen Verteilung des DDX5-Gens.

Das Forschungsteam analysierte und verglich die Visualisierungsergebnisse verschiedener Methoden zur ST-Kartenvorhersage. Die Ergebnisse zeigten, dass Methoden auf Objektträgerebene (wie HisToGene und Hist2ST) normalerweise glattere Karten erzeugen können, während Methoden auf Bildblockebene klarere lokale Strukturmerkmale beibehalten.

Es ist bemerkenswert, dass M2OST immer genauere ST-Karten erstellen kann und somit eine höhere Vorhersagegenauigkeit bietet. Das Forschungsteam visualisierte außerdem die Expression des Schlüsselgens DDX5, das durch die Aktivierung des β-Catenin-Signalwegs eine Schlüsselrolle bei der Proliferation und Tumorentstehung nicht-kleinzelliger Krebszellen spielt. Die Ergebnisse zeigten, dass M2OST bei der Vorhersage dieses Gens am besten abschnitt und alle verglichenen Methoden übertraf. Dies bestätigte die Genauigkeit des M2OST-Modells auf der Ebene der Vorhersage der Expression einzelner Gene.

Bahnbrechende Fortschritte und domänenübergreifende Anwendungen der räumlichen Transkriptomik

Die räumliche Transkriptomik kann als Brücke zwischen Zellfunktion und Gewebestruktur die Genexpressionsmuster einzelner Zellen zeitlich und räumlich analysieren und die räumliche Lage sowie die biologischen Eigenschaften von Zellpopulationen aufdecken, was die biomedizinische Forschung auf eine tiefere Ebene bringt.

In diesem Bereich werden bis April 2025Ein Forschungsteam des Institute of Medical Science der Universität Tokio in Japan entwickelte ein Deep-Learning-Framework namens STAIG für die räumliche Transkriptomikanalyse basierend auf bildgestütztem Graphkontrastlernen.Das Framework kann Genexpression, räumliche Daten und histologische Bilder integrieren, ohne dass die Daten ausgerichtet werden müssen. Dadurch werden die Einschränkungen herkömmlicher Methoden bei der Beseitigung von Batch-Effekten und der Identifizierung räumlicher Regionen überwunden. STAIG extrahiert Merkmale aus mit Hämatoxylin und Eosin (H&E) gefärbten Bildern durch selbstüberwachtes Lernen, ohne für das Vortraining auf große Datensätze angewiesen zu sein.

Während des Trainings passt STAIG die Graphstruktur dynamisch an und schließt irrelevante negative Proben durch histologische Bilder selektiv aus, wodurch die Verzerrung reduziert wird. Letztendlich gelang es STAIG, die Batch-Integration durch die Analyse der Gemeinsamkeiten der Genexpression durch lokalen Vergleich zu erreichen, wodurch die Komplexität der manuellen Koordinatenausrichtung vermieden und Batch-Effekte deutlich reduziert wurden. Studien haben gezeigt, dass STAIG bei mehreren Datensätzen gute Ergebnisse liefert, insbesondere bei der Identifizierung räumlicher Regionen, und detaillierte genetische und räumliche Informationen im Tumormikroumfeld aufdecken kann, was sein wichtiges Potenzial für die Analyse der Komplexität der räumlichen Biologie verdeutlicht.

Gleichzeitig hat das Forschungsteam von Wei Wu am Lingang-Labor in Shanghai, China, auch auf dem Gebiet der räumlichen Transkriptomik bedeutende Fortschritte erzielt. Im November 2024 veröffentlichte das Team in der Zeitschrift Briefings in Bioinformatics eine Forschungsarbeit mit dem Titel „MCGAE: Entschlüsselung der Tumorinvasion durch integrierte multimodale räumliche Transkriptomik“. In dieser Studie wurde ein Deep-Learning-Framework MCGAE (Multi-View Contrastive Graph Autoencoder) entwickelt, das speziell für die räumliche Transkriptomdatenanalyse konzipiert wurde.Dieses Framework erstellt multimodale, mehrseitige biologische Darstellungen durch die Kombination von Genexpression, räumlichen Koordinaten und Bildmerkmalen und verbessert so die Genauigkeit der räumlichen Domänenerkennung erheblich.Die Tumordaten belegen eine präzise Identifizierung von Tumorregionen und eine eingehende Analyse der molekularen regulatorischen Eigenschaften und stellen ein leistungsstarkes Instrument für die Erforschung komplexer Gewebe, die Erforschung von Krankheitsmechanismen und die Entdeckung von Wirkstoffzielen dar.

Originalarbeit:

https://academic.oup.com/bib/article-pdf/26/1/bbae608/60786360/bbae608.pdf

Darüber hinaus weist auch die Anwendung der räumlichen Transkriptomik in der Landwirtschaft großes Potenzial auf. Im April 2025 veröffentlichte ein Forschungsteam des Modern Agriculture Research Institute der Peking-Universität in Genome Biology eine wichtige Studie mit dem Titel „Spatiotemporal tranomics reveals key gene regulation for grain yield and quality in wheat“.Mithilfe der räumlichen Transkriptomtechnologie wurde eine hochauflösende Genexpressionskarte von Weizenkörnern zu verschiedenen Zeitpunkten während der frühen Entwicklung erstellt.Enthüllung der Genexpressionsmerkmale während der Entwicklung des Weizenkorns. Diese Forschung liefert nicht nur wichtige theoretische Unterstützung für die molekulare Züchtung und Ertragssteigerung von Weizen, sondern bietet auch eine starke Garantie für die globale Ernährungssicherheit.

Originalarbeit:

https://www.biorxiv.org/content/biorxiv/early/2024/06/03/2024.06.02.596756.full.pdf

In Zukunft wird die tiefe Integration von künstlicher Intelligenz und Omics-Technologien mit der kontinuierlichen Ansammlung räumlicher Transkriptomdaten und der kontinuierlichen Optimierung digitaler Pathologie-Bilderfassungsmethoden die weitverbreitete Anwendung von Deep-Learning-Modellen bei verschiedenen Gewebetypen und Krankheitshintergründen fördern und die Entwicklung der Präzisionsmedizin unterstützen. Der Vorschlag von M2OST hat eine solide Grundlage für den Aufbau eines effizienten, kostengünstigen und hochpräzisen Rahmens zur räumlichen Vorhersage der Genexpression gelegt und kündigt die großen Aussichten der künstlichen Intelligenz und der Multi-Omics-Datenfusionsanalyse im biomedizinischen Bereich an.