Command Palette

Search for a command to run...

Zehn „Beste“! Ein Rückblick Auf Die Wichtigsten KI-Ereignisse Im Jahr 2024, Der Verborgene Trends Und Herausforderungen Für Die Branche Aufzeigt

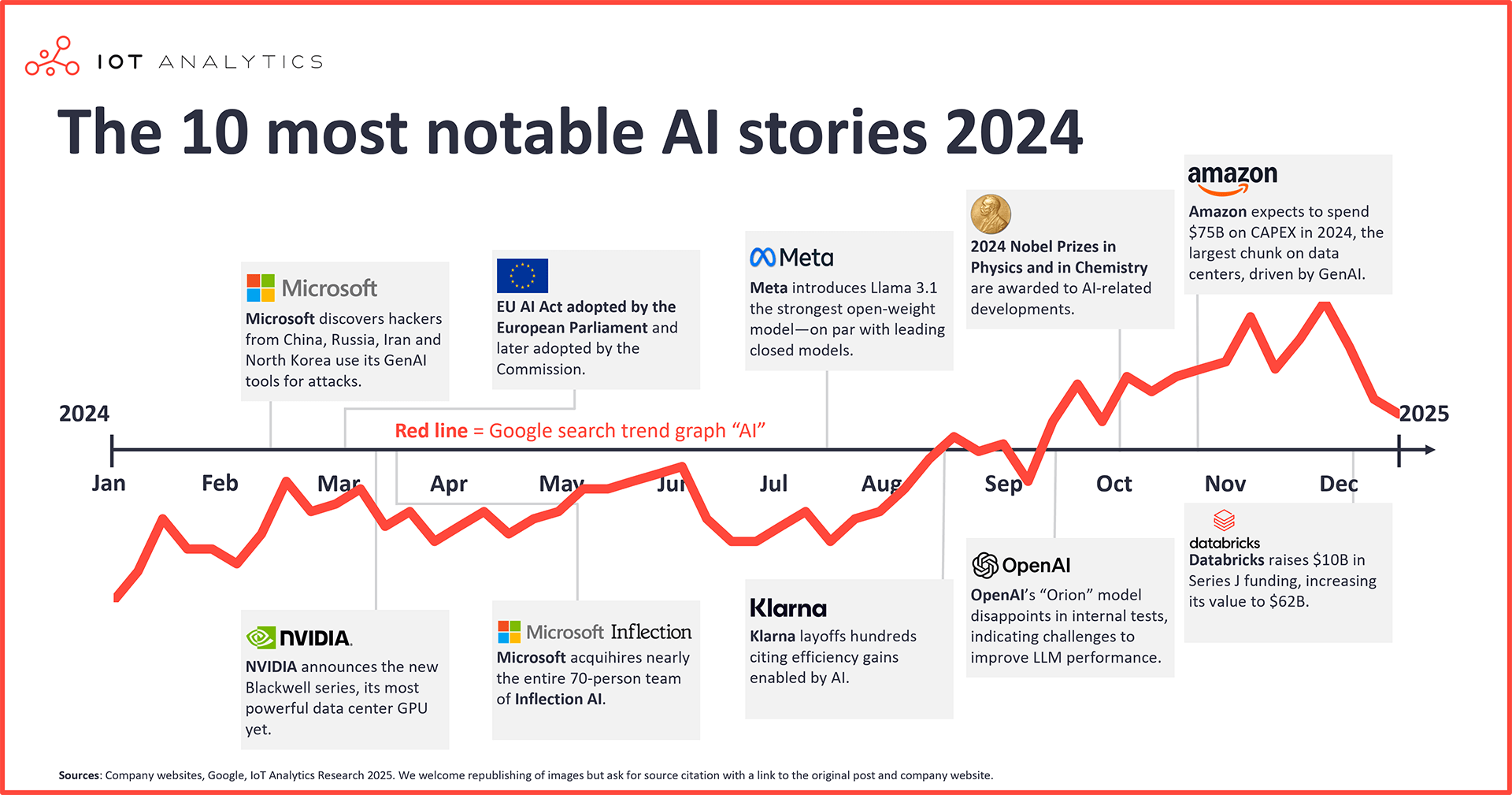

Im Jahr 2024 ist die KI-Welle noch immer mit voller Kraft im Gange, zeigt keine Anzeichen eines Abklingens, verändert still und leise die Konturen der Welt und sorgt für rekordverdächtige Innovationen.

In diesem Jahr haben Infrastrukturanbieter wie NVIDIA und Broadcom sowie Cloud-Service-Anbieter wie Microsoft ein starkes Umsatzwachstum im KI-Geschäft erzielt. In diesem Jahr hat Nvidia Apple und Microsoft mehrfach überholt und ist zum wertvollsten Unternehmen der Welt geworden. Forschungsdaten des Marktforschungsunternehmens IoT Analytics zum GenAI-Markt zeigen, dass der Umsatz von Nvidias GPUs in Rechenzentren im Jahr 2024 um 1421 TP3T steigen wird, wodurch der Marktwert auf über 3,5 Billionen US-Dollar steigen wird.

Es war auch das Jahr, in dem OpenAI und xAI in Finanzierungsrunden jeweils mehr als 6 Milliarden US-Dollar einsammelten und der technologielastige Nasdaq-Index zum ersten Mal die 20.000-Punkte-Marke durchbrach …

Angesichts der zunehmenden Begeisterung für die Entwicklung künstlicher Intelligenz hat das Marktforschungsunternehmen IoT Analytics die zehn wichtigsten Ereignisse in diesem Bereich ausgewählt, die im Jahr 2024 Beachtung verdienen:

01 ,Die bemerkenswertesten KI-Cybersicherheitsereignisse

Staatliche Hacker nutzen LLMs, um ihre Angriffsmöglichkeiten zu verbessern

14. Februar 2024Microsoft gab bekannt, dass staatliche Hacker aus Russland, China, Nordkorea und dem Iran die Tools von OpenAI nutzen, um ihre Angriffsmöglichkeiten zu verbessern.

Microsoft sagte, dass diese Organisationen KI auf unterschiedliche Weise nutzen. Beispielsweise verwendet der russische GRU routinemäßig Large Language Models (LLMs), um „verschiedene Satelliten- und Radartechnologien zu untersuchen, die für konventionelle Militäroperationen in der Ukraine relevant sein könnten“. Mittlerweile gibt es Berichte darüber, dass nordkoreanische Hacker LLMs nutzen, um Inhalte für Spear-Phishing-Kampagnen zu generieren, während iranische Hacker die Modelle nutzten, um überzeugendere E-Mails zu verfassen.

02 ,Die einflussreichsten KI-Vorschriften

EU-KI-Gesetz

Am 13. März 2024 verabschiedete das Europäische Parlament das EU-KI-Gesetz, das am 1. August 2024 in Kraft treten wird.

Als weltweit erste formelle und umfassende KI-Verordnung unterteilt sie KI in vier Risikokategorien, basierend auf dem potenziellen Schaden, den (der Missbrauch) von KI verursachen kann, und legt damit Regeln für den Einsatz von KI innerhalb der EU fest:

1. Inakzeptables Risiko

KI-Systeme werden in Szenarien eingesetzt, die ausdrücklich verboten sind, einschließlich, aber nicht beschränkt auf:

* Unterbewusstes, manipulatives oder irreführendes Verhalten, um das Verhalten zu verzerren oder die Entscheidungsfindung zu beeinträchtigen;

* Ausnutzung von Schwachstellen aufgrund von Alter, Behinderung oder sozioökonomischem Status;

* Biometrische Klassifizierung zur Ableitung sensibler Merkmale (wie Rasse oder politische Ansichten): umfasst nicht die Markierung und Filterung rechtmäßig erlangter biometrischer Daten durch die Strafverfolgungsbehörden;

* Social Scoring, etwa die Bewertung oder Kategorisierung von Personen oder Gruppen auf der Grundlage sozialer oder persönlicher Merkmale, was zu einer unfairen Behandlung dieser Personen führen kann;

* Das Hervorrufen von Emotionen am Arbeitsplatz oder im akademischen Umfeld, außer aus medizinischen oder Sicherheitsgründen.

2. Hohes Risiko

Der größte Teil der KI-Gesetzgebung der EU konzentriert sich auf die Regulierung dieser Systemkategorie, die das höchste zulässige Risikoniveau darstellt. Dazu gehören unter anderem:

* als Sicherheitskomponente oder in Produkten verwendet werden, die unter die in Anhang I der EU-KI-Richtlinie aufgeführten EU-Gesetze fallen und gemäß diesen Gesetzen einer Konformitätsbewertung durch Dritte unterzogen werden müssen;

*Anwendungsszenarien, die in Anhang III der EU-KI-Richtlinie aufgeführt sind, wie etwa zulässige biometrische Operationen und kritische Infrastrukturen.

*Anhang I:

https://artificialintelligenceact.eu/annex/1

*Anhang III:

https://artificialintelligenceact.eu/annex/3

Anbieter von KI mit hohem Risiko müssen betriebliche Anforderungen erfüllen, wie etwa die Einrichtung von Risikomanagementsystemen, die Durchführung einer Datenverwaltung und die Bereitstellung technischer Dokumentation zum Nachweis der Konformität.

3. Begrenztes Risiko

Diese Kategorie nimmt im Gesetzentwurf weniger Platz ein und unterliegt weniger strengen Transparenzanforderungen. Kurz gesagt: Entwickler und Anbieter dieser Systeme müssen sicherstellen, dass die Endbenutzer wissen, dass sie mit KI interagieren.

4. Minimales Risiko

Solche Anwendungen unterliegen keiner Regulierung und umfassen die meisten KI-Anwendungen auf dem EU-Markt, etwa KI-Videospiele und Spamfilter.

Während das KI-Gesetz der EU als das erste seiner Art gefeiert wird, haben andere Länder entweder bereits den Gesetzgebungsprozess zur Regulierung von KI eingeleitet oder Leitlinien bereitgestellt, die mit bestehenden Gesetzen im Einklang stehen, aber nicht so bindend sein sollen wie das KI-Gesetz der EU.

Zum Beispiel,Die japanische Regierung hat im April 2024 die „Business Artificial Intelligence Guidelines 1.0“ veröffentlicht.Dabei handelt es sich um eine freiwillige Richtlinie auf Grundlage bestehender Gesetze, die die verantwortungsvolle Entwicklung und Nutzung von KI fördern soll. gleichzeitig,Der brasilianische Senat hat im Mai 2024 den Gesetzentwurf Nr. 2338/2024 vorgeschlagen.Dies ist der erste Gesetzentwurf des Landes zur Regulierung künstlicher Intelligenz, einschließlich Algorithmendesign und technischer Standards, und wurde im Dezember 2024 verabschiedet.

In den Vereinigten Staaten wurden zwar noch keine Regulierungsgesetze auf Bundesebene eingeführt, doch im Jahr 2024 haben mindestens 24 US-Bundesstaaten, Puerto Rico, die Amerikanischen Jungferninseln und Washington, D.C. Gesetzesentwürfe im Zusammenhang mit KI vorgelegt. Mindestens 31 Staaten, Puerto Rico und die Amerikanischen Jungferninseln haben diese Resolutionen angenommen und umgesetzt.

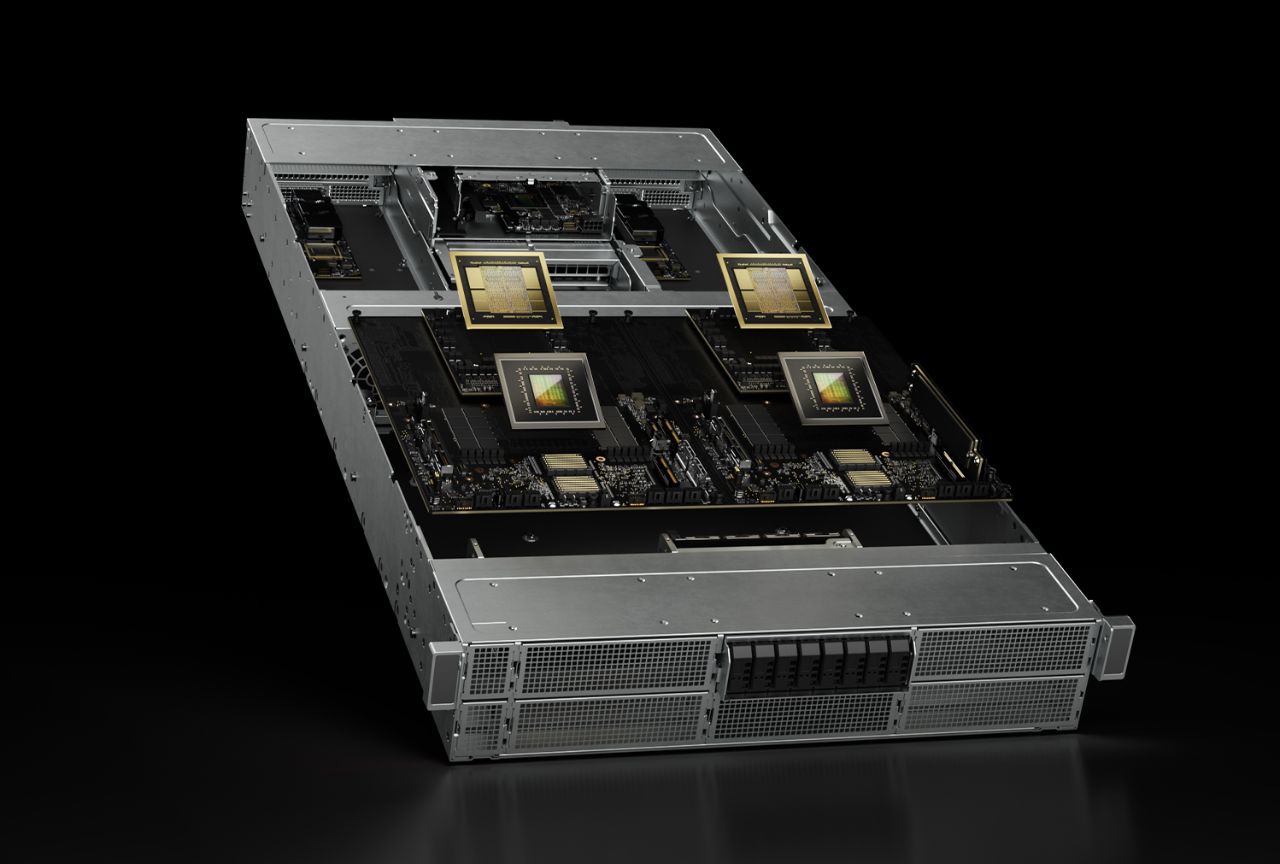

03 ,Die einflussreichste KI-Hardware-Entwicklung

Nvidia Blackwell-Serie und ihre verzögerte Veröffentlichung

Am 18. März 2024 kündigte NVIDIA auf der GTC 2024 seine neue Blackwell-GPU-Architektur an und veröffentlichte 3 GPUs: B100, B200 und GB200 (eine Kombination aus einer Grace-CPU und 2 B200).

Nvidia verspricht, dass die Blackwell-Serie enorme Verbesserungen bei Leistung und Energieeffizienz erreichen wird und dass sie im Vergleich zur H-Serie erhebliche Leistungssteigerungen aufweisen wird, darunter eine 6-fache Steigerung der Anzahl der pro Sekunde verarbeiteten Abfragen und eine 30-fache Steigerung der Anzahl der pro Sekunde und GPU ausgegebenen Token.

Allerdings kam es bei der Veröffentlichung der Blackwell-Reihe zu Verzögerungen. Im August 2024 teilte Nvidia den Cloud-Dienstanbietern mit, dassDie Veröffentlichung des mit Spannung erwarteten KI-Chips B200, dessen Veröffentlichung ursprünglich für das vierte Quartal 2024 geplant war, wird sich auf 2025 verzögern.Grund sei ein Konstruktionsfehler gewesen, der „ungewöhnlich spät im Produktionsprozess“ entdeckt worden sei.

Obwohl Nvidias Finanzvorstand Colette Kress den Investoren während der Telefonkonferenz zu den Quartalsergebnissen im November 2024 versicherte, dass die GPUs in voller Produktion seien und Berichte darauf hindeuten, dass Nvidia auf Kurs sei, den B200 im Dezember 2024 auf den Markt zu bringen, sind bis heute (Stand: 8. Januar 2025) keine Neuigkeiten über die Veröffentlichung eines B200 oder B100 öffentlich geworden.

04 ,Die einflussreichsten Fusionen und Übernahmen

Microsoft und Inflection AI

Am 19. März 2024 gründete Microsoft eine neue Consumer-KI-Abteilung namens Microsoft AI. Als die Abteilung gegründet wurde,Microsoft hat Mustafa Suleyman und Karén Simonyan, Mitbegründer des US-amerikanischen KI-Startups Inflection AI, sowie den Großteil des Inflection AI-Teams eingestellt.Darüber hinaus hat Microsoft eine Reihe kommerzieller Vereinbarungen mit Inflection AI getroffen, darunter (neben anderen Transaktionen) eine nicht exklusive Lizenz zur Nutzung des geistigen Eigentums von Inflection AI.

Im Wesentlichen erwarb Microsoft nach Angaben der britischen Competition and Markets Authority (CMA) den Großteil der Vermögenswerte von Inflection AI. Die CMA war der Ansicht, dass eine derartige Transaktion in ihre Zuständigkeit für die Fusionskontrolle fiel, obwohl Inflection AI als eigenständiges Unternehmen (nur mit neuer Führung und neuen Mitarbeitern) weiterbestand. Die CMA fügte jedoch hinzu, dass der Deal zwar von einigen als „Quasi-Fusion“ bezeichnet worden sei, er jedoch nicht „das Potenzial für eine wesentliche Einschränkung des Wettbewerbs“ mit sich bringe. Gleichzeitig wies sie darauf hin, dass sie eine behördliche Überprüfung durchführen werde, wenn ähnliche Situationen wettbewerbsrechtliche Bedenken aufwerfen würden.

Die Regulierungsbehörden haben die Frage aufgeworfen, ob durch derartige Geschäfte ein unfaires Marktumfeld entstehen würde. Die Übernahme von Inflection AI durch Microsoft ist nur eine davon. Anfang 2024Die Federal Trade Commission (FTC) kündigte an, dass sie milliardenschwere Investitionen von Amazon in Anthropic, Google in Anthropic und Microsoft in OpenAI untersuchen werde (die jeweils dazu führten, dass ein großes Unternehmen einen großen Anteil an einem kleineren Unternehmen erwarb).Ziel ist es festzustellen, ob diese Unternehmen die tatsächliche Kontrolle über Unternehmen erlangt haben, ohne dass es zu einer Fusion oder einer direkten Übernahme gekommen wäre, und so einer behördlichen Kontrolle entgangen sind und eine unfaire Marktwettbewerbssituation geschaffen haben.

Quasi-Fusionen und -Übernahmen sind zwar keine neuen Konzepte, doch scheinen sie im Zuge der zunehmenden Erhitzung des KI-Wettlaufs immer häufiger aufzutauchen. Auch wenn die globalen Regulierungsbehörden diese Deals (bisher) nicht blockieren, scheinen sie dies zu bemerken.

05 ,Die wichtigste große Modellentwicklung

Meta-Open-Source-Modell LLaMA 3.1 schlägt Closed-Source-Modell

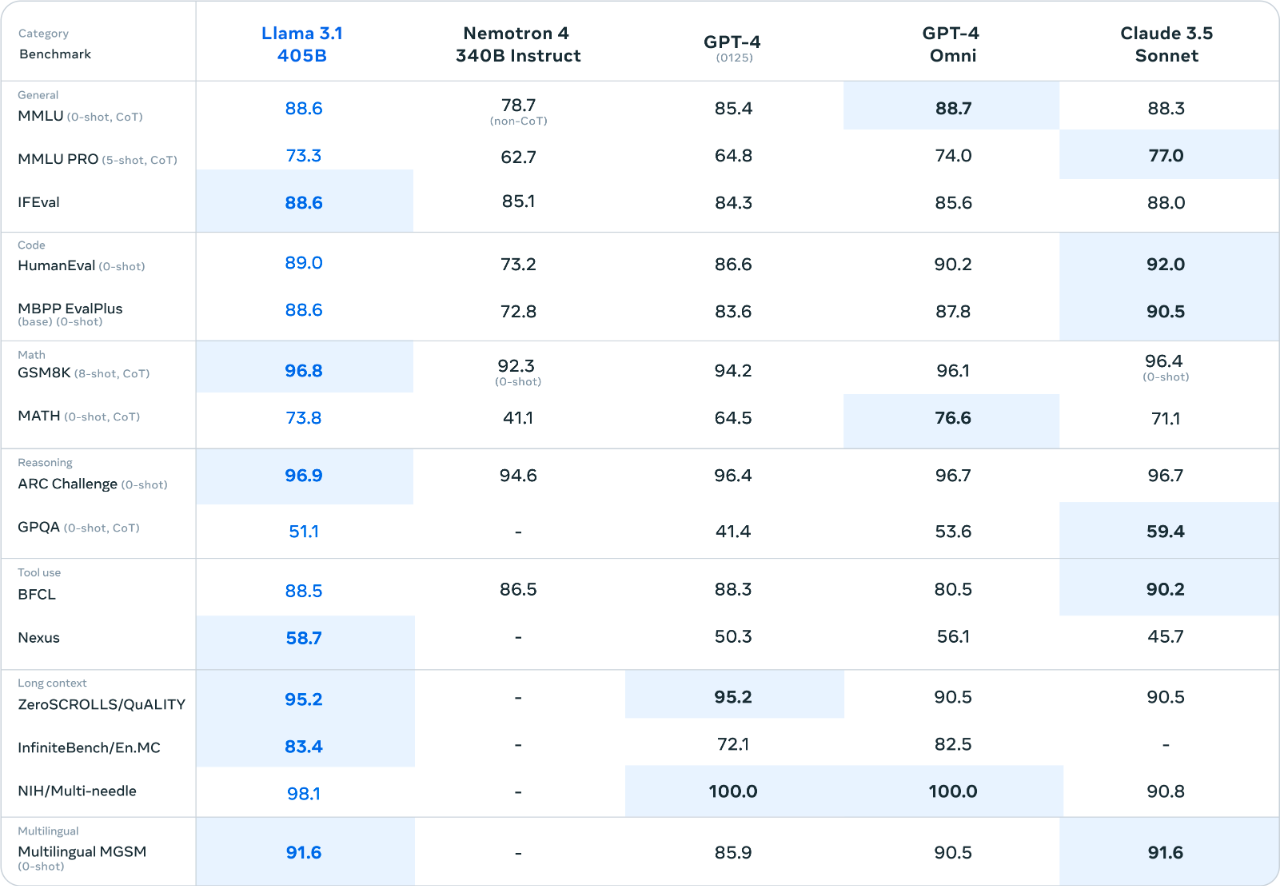

LLaMa 3.1 ist vergleichbar mit oder sogar besser als ChatGPT und Claude. Am 13. Juli 2024 brachte Meta eine aktualisierte Version von LLaMA 3.1 heraus und veröffentlichte Benchmark-Vergleichsergebnisse des Modells mit Mainstream-Modellen von Unternehmen wie OpenAI, Anthropic und Mistral.

Laut Meta übertraf LLaMA 3.1 405B die Sonnet-Modelle GPT-4, GPT-4o von OpenAI und Claude 3.5 Sonnet von Anthropics in sieben von 15 Benchmarks (das Claude-Modell lag im Vergleich dazu in sechs Benchmarks vorne). In den Tests, in denen es nicht die höchsten Punktzahlen erreichte, war die Leistung von LLaMA 3.1 im Allgemeinen mit anderen Topmodellen vergleichbar.

In ähnlichen Benchmarks der 8-Milliarden-Parameter- und 70-Milliarden-Parameter-LLaMA-3.1-Modelle (LLaMA 3.1 8B bzw. LLaMA 3.170B) übertrafen die beiden Modelle in 11 der 12 Tests die Konkurrenzmodelle von Google, Mistral und OpenAI. Es ist erwähnenswert, dass Meta zwar bei den beiden kleineren Modellen dieselben 15 Tests durchgeführt hat wie bei der Version 405B, bei drei dieser Tests jedoch keine Daten der anderen Vergleichsmodelle enthielt.

* Verwenden Sie Open WebUI, um das Llama 3.1 405B-Modell mit einem Klick bereitzustellen:

https://hyper.ai/cn/tutorials/33221

06 ,Die bemerkenswertesten Entlassungen im Zusammenhang mit KI

Klarna

Am 27. August 2024 gab das schwedische Zahlungsunternehmen Klarna bekannt, dass es Hunderte von Stellen abgebaut habe. Da KI das Kundenberatungsgeschäft übernehmen werde, rechne man damit, dass das Ausmaß der Entlassungen in Zukunft noch weiter zunehmen werde. Der Grund, warum dieser Vorfall als der typischste Fall von KI angesehen wird, der menschliche Arbeit ersetzt, liegt hauptsächlich darin, dass das Unternehmen klar zum Ausdruck brachte, dassSein KI-basierter Chatbot kann die Arbeitslast von 700 Mitarbeitern bewältigen und die durchschnittliche Problemlösungszeit von 11 Minuten auf 2 Minuten reduzieren. In diesem Fall hat die KI die menschliche Arbeitskraft vollständig ersetzt.Darüber hinaus kündigte Klarna an, dass die Einstellung von Mitarbeitern für alle Positionen außer Ingenieuren vorübergehend ausgesetzt werde.

Klarna ist jedoch nicht allein.

Juli 2024Das US-Steuersoftwareunternehmen Intuit gab bekannt, dass es 1.800 Mitarbeiter entlassen wird, um sich auf die Entwicklung von KI-Tools wie „Intuit Assist“ zu konzentrieren.Und er machte deutlich, dass es bei diesen Entlassungen nicht um Kosteneinsparungserwägungen ging. Gleichzeitig kündigte Intuit an, mindestens die gleiche Anzahl an Mitarbeitern in den Bereichen Entwicklung, Produktentwicklung und Kundenbetreuung wie Vertrieb und Marketing einzustellen, um seine KI-Initiativen für 2025 zu unterstützen. Während die Entlassungen bei Intuit umfangreicher ausfielen, vollzog das Unternehmen lediglich eine strategische Umstellung auf KI und Klarna hat den KI-Ersatz bereits umgesetzt.

Auch Technologiefachleute ohne KI-Kenntnisse stehen unter dem Druck der Branchentransformation. Die beiden oben genannten Fälle zeigen, dass KI nicht-technische Positionen wie den Kundendienst übernehmen kann. Gleichzeitig haben große Technologieunternehmen im Zuge ihrer Neuausrichtung auf das KI-Geschäft auch erhebliche Stellen im technischen Bereich abgebaut. Die Arbeitslosenquote in der Technologiebranche schwankte auch im Jahr 2024 weiter. Nachdem sie im Juni mit 3,71 TP3B ein Vierjahreshoch erreicht hatte, fiel sie im September wieder und blieb bei etwa 2,51 TP3B.

Zu den größten Stellenstreichungen im Technologiesektor im Jahr 2024 zählen:

* Januar

Der globale Technologieriese Google hat in mehreren Teams, darunter Hardware und Google Assistant, über 1.000 Mitarbeiter entlassen, um sich stärker auf seine KI-Produkte wie Gemini GenAI (ehemals Bard) zu konzentrieren. Google-CEO Sundar Pichai wies darauf hin, dass im Laufe des Jahres 2024 mit weiteren Entlassungen zu rechnen sei, da Google weiterhin Ressourcen in den KI-Bereich umverteile (im Dezember 2024 kündigte Pichai die Streichung von 10%-Führungspositionen an).

* 6 Monate

Microsoft, der globale Software- und Cloud-Service-Riese, gab bekannt, dass er in seinen Mixed-Reality- und Azure-Abteilungen mehr als 1.000 Mitarbeiter entlassen wird. Jason Zander, Executive Vice President für strategische Mission und Technologie bei Microsoft, erklärte in einer E-Mail des Unternehmens, dass man mit diesem Schritt mehr Energie in die Definition der „KI-Welle stecken und seinen Kunden dabei helfen wolle, KI erfolgreich anzuwenden“.

* August

Cisco, ein multinationales Unternehmen für Netzwerk-Hardware und -Software, hat rund 71.000.000 Mitarbeiter entlassen und seine Investitionsrichtung auf KI verlagert, einschließlich des Aufbaus von KI-Netzwerken für Cloud-Anwendungen und KI-Infrastruktur. Dies ist eine weitere Entlassungswelle nach der Entlassung von fast 4.000 Menschen im Februar 2024.

Für 2025 werden weitere Entlassungen aufgrund von KI erwartet. Einer Studie von IoT Analytics aus dem Frühjahr 2024 zufolge sind KI und GenKI bei Arbeitgebern zu den gefragtesten Fähigkeiten geworden. Darüber hinaus ergab eine Umfrage von Staffing Industry Analysts im Jahr 2024 unter mehr als 900 Führungskräften in US-Unternehmen, dass30% der Unternehmen haben einige Mitarbeiter durch KI ersetzt, und von den Unternehmen, die planen, KI im Jahr 2025 einzusetzen, gaben 38% an, dass sie damit rechnen, ihre Mitarbeiter innerhalb des nächsten Jahres durch die Technologie zu ersetzen.

Für manche Unternehmen ist KI jedoch möglicherweise nur ein Sündenbock. Es ist erwähnenswert, dass viele Unternehmen KI als Vorwand für Entlassungen nutzen – diese der KI zuzuschreiben klingt weniger negativ, als einfach zuzugeben, dass die Entlassungen vorgenommen wurden, um Kosten zu senken oder Gewinne zu steigern. Darüber hinaus kann die Zurückführung von Entlassungen auf KI Investoren motivieren, da dies zu einer Steigerung von Effizienz und Produktivität führt.

Im Februar 2024 äußerte Mark Zuckerberg, CEO des US-Technologiegiganten Meta, seine Ansicht, dass Entlassungen ein Spiegelbild der Realität der Zeit nach der Epidemie seien. Während der Epidemie reagierte das Unternehmen aufgrund der Unsicherheit mit einer „Überexpansion“ und versucht nun, das Unternehmen zu rationalisieren, um die Betriebseffizienz zu verbessern.

07 , Die größten Herausforderungen für KI-Unternehmen

Die LLM-Leistung kann nicht verbessert werden

Große LLM-F&E-Projekte haben die Erwartungen nicht erfüllt. Im September 2024 schloss OpenAI die erste Trainingsrunde für ein neues großes Sprachmodell ab, das unternehmensintern Orion genannt wird. OpenAI hofft, dass es ein ähnlicher Fortschritt sein wird wie der im Mai 2024 veröffentlichte GPT-4o gegenüber dem GPT-4 Turbo. Berichten zufolgeDas Modell erfüllt derzeit nicht die Erwartungen und der Leistungsunterschied zu bestehenden Modellen ist nicht so groß wie der zwischen GPT-4o und GPT-4 Turbo oder GPT-4 und GPT-3.5.

OpenAI ist jedoch nicht das einzige Unternehmen, das Rückschläge erlitten hat. Auch Google und Anthropic haben die Markterwartungen hinsichtlich der Aktualisierung ihrer Modelle Gemini und Claude offenbar nicht erfüllt, was zu Verzögerungen bei der Veröffentlichung der neuen Versionen führte.

Neue Datenbeschränkungen führen zu einem Paradigmenwechsel in der LLM-Entwicklung. In den letzten Jahren basieren die Erwartungen großer Sprachmodellunternehmen an große Durchbrüche in ihren Modellen hauptsächlich auf „Skalierungsgesetzen“ –Das heißt, mehr Rechenleistung, größere Datensätze und größere Modelle werden einen Sprung in den KI-Fähigkeiten bewirken.

Jedoch,Im Jahr 2024 tritt ein neues Problem auf:Für die Ausbildung von LLMs stehen nur begrenzte neue (menschliche) Informationen zur Verfügung.Frühe LLMs stützten sich beim Lernen hauptsächlich auf Quellen wie das Internet und schöpften aus jahrzehntelangem menschlichen Wissen. Allerdings sind in den letzten zwei Jahren relativ wenige neue, zuverlässige, von Menschen erstellte Informationen hinzugekommen.

Ein weiteres Problem ist seit der öffentlichen Veröffentlichung von LLM deutlicher geworden: KI-Kannibalismus.Generative KI (GenAI) wird häufig bei der Erstellung von Online-Inhalten eingesetzt und ermöglicht LLM die schrittweise Aufnahme von KI-generierten Inhalten. Diese zirkuläre Aufnahme reduziert und verwässert nicht nur den ursprünglichen menschlichen Inhalt weiter, sondern kann auch die Genauigkeit der vom Modell gelernten Informationen beeinträchtigen.

Einige stellen die Grenzen der KI in Frage, während andere die Bedeutung des Fortschritts überdenken. Angesichts von Problemen wie begrenzten Durchbrüchen im Bereich des LLM und unzureichenden neuen Daten scheinen KI-Forschungseinrichtungen die Tatsache zu akzeptieren, dass „Skalierungsgesetze“ nicht wirklich universell sind. Manche im KI-Bereich sind der Meinung, dass verschiedene Modelle allmählich an die Grenzen ihrer Leistungsfähigkeit stoßen. Es gibt jedoch auch Optimisten, die glauben, dass „Skalierungsgesetze“ als dynamisch betrachtet werden sollten und an neue Entwicklungsparadigmen angepasst werden müssen, sodass im KI-Trainings- und Entwicklungsprozess neue Strategien wie beispielsweise „Testzeitskalierung“ übernommen werden sollten.

Die neue Funktionalität gleicht die begrenzten Fortschritte von LLM aus. Während die LLM-Entwicklung möglicherweise stagniert, arbeiten KI-Unternehmen weiterhin daran, den Wert bestehender Modelle zu steigern. Beispielsweise hat OpenAI im September 2024 eine Vorschau der Modelle o1 und o1-mini veröffentlicht und sie im Dezember desselben Jahres offiziell auf den Markt gebracht, während gleichzeitig das kommende Modell o3 angekündigt wurde. Obwohl die Verarbeitung von Abfragen beim o1-Modell länger dauert, verwendet es einen „Denkketten“-Ansatz, um Antworten zu erstellen und zu korrigieren, bevor diese beantwortet werden (ähnlich der Art und Weise, wie Menschen beim Lösen komplexer Probleme Ideen zerlegen), wodurch die Denkfähigkeit und die Antwortgenauigkeit verbessert werden.

Darüber hinaus veröffentlichte OpenAI im Oktober 2024 ChatGPT Search, das es ChatGPT ermöglicht, Websuchen durchzuführen. Benutzer können über die ChatGPT-Schnittstelle Informationen finden und Ergebnisse mit Quellenangaben erhalten. Schließlich brachten OpenAI und Google im Dezember 2024 Sora (basierend auf DALL-E 3) bzw. Veo2 auf den Markt und erweiterten damit die Möglichkeiten zur Videogenerierung weiter.

08 ,Wichtigste Erfolge der KI-Forschung

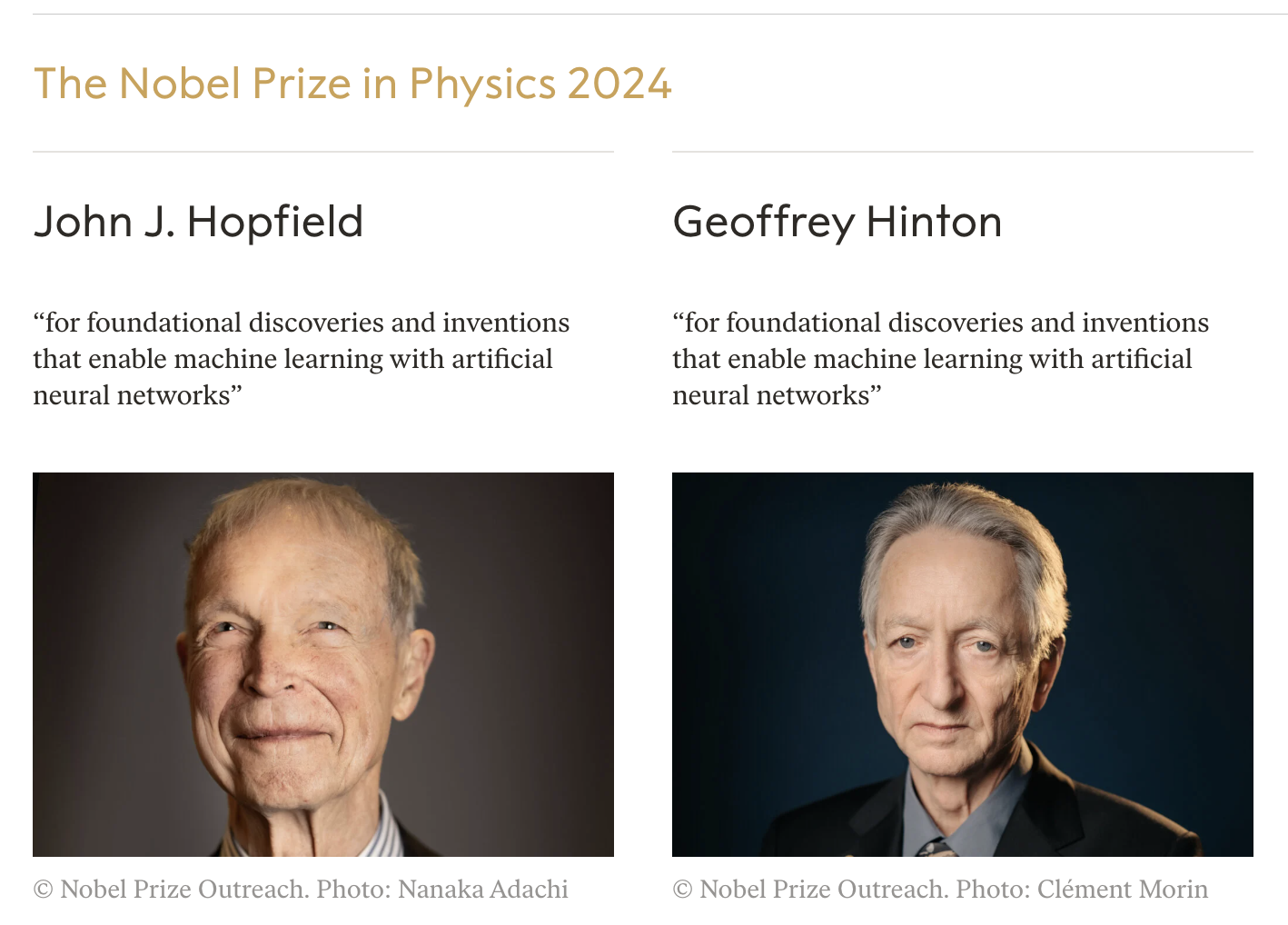

Zwei Nobelpreise

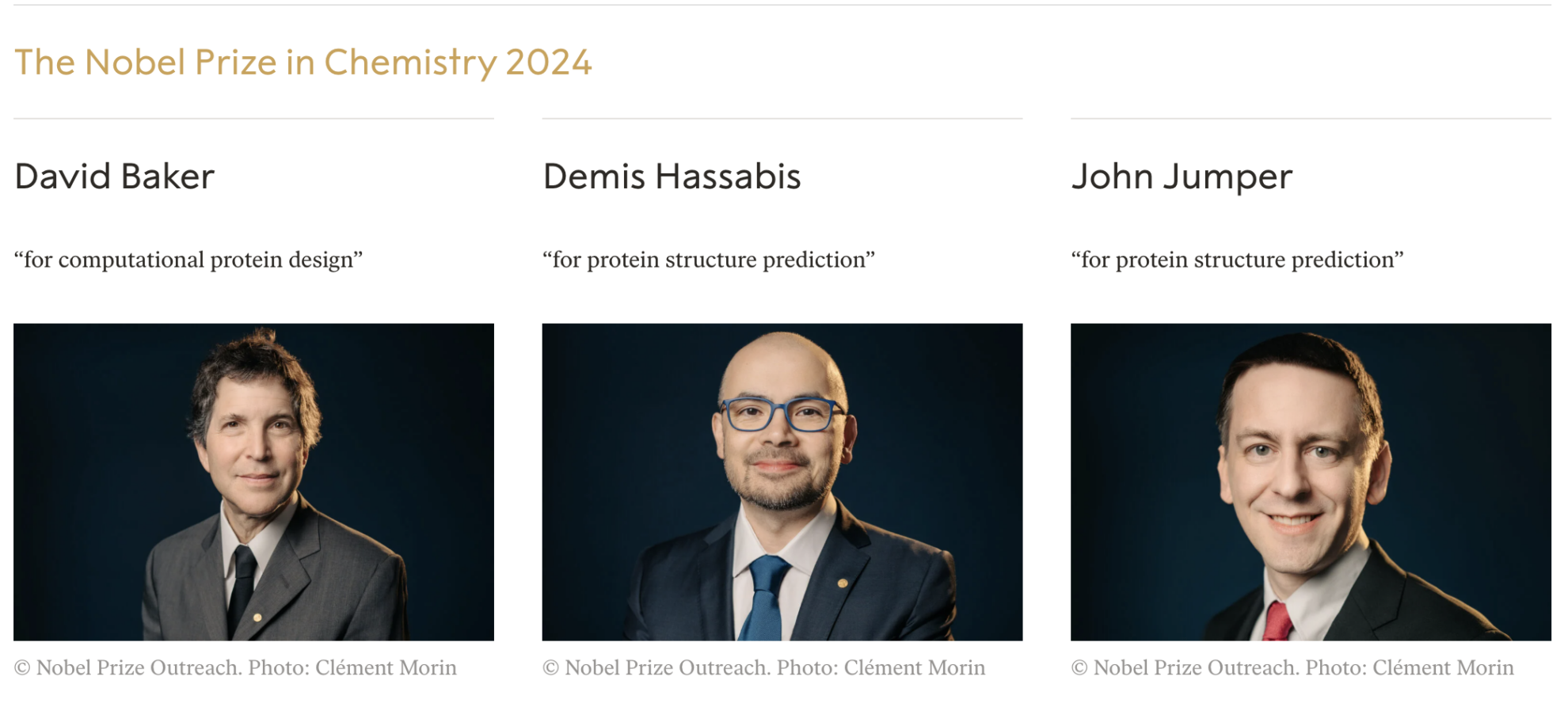

Am 8. und 9. Oktober 2024 wurden erstmals die Nobelpreise für Physik und Chemie für KI-bezogene Forschung verliehen. Der Nobelpreis für Physik 2024 wurde an John J. Hopfield, Physiker und emeritierter Professor der Princeton University, und Geoffrey Hinton, emeritierter Professor der University of Toronto und ehemaliger Google-Forscher, für die Entwicklung von Techniken des maschinellen Lernens unter Verwendung künstlicher neuronaler Netzwerke verliehen.

Gleichzeitig erhielten Sir Demis Hassabis, CEO und Mitbegründer von Google DeepMind, und John M. Jumper, Forschungsleiter bei Google DeepMind und Mitentwickler von AlphaFold, den Nobelpreis für Chemie 2024 für die Entwicklung eines KI-Algorithmus, der Proteinstrukturen präzise vorhersagen kann und damit das Problem der Proteinstrukturvorhersage löst, das die wissenschaftliche Gemeinschaft seit 50 Jahren beschäftigt.

09 ,Die größte KI-Investition auf Unternehmensebene

Amazonas

Amazon investiert massiv in Rechenzentren und KI. In einer Telefonkonferenz am 31. Oktober 2024 erklärte CEO Andy Jassy:Die Investitionsausgaben (CAPEX) des Unternehmens werden im Jahr 2024 75 Milliarden US-Dollar erreichen, wobei AWS und KI den größten Anteil ausmachen.Bislang haben Amazons Ausgaben für die Erweiterung seines Rechenzentrums (einschließlich Eigentum und Ausrüstung) 22,6 Milliarden US-Dollar erreicht, was einem Anstieg von 811 TP3Billionen US-Dollar gegenüber dem Vorjahr entspricht.

Amazon ist nicht der einzige, der in Rechenzentren investiert. Schätzungen zufolge werden die gesamten Investitionsausgaben von Giganten wie Amazon, Microsoft, Alphabet und Meta bis 2024 200 Milliarden US-Dollar übersteigen. Diese großen Technologieunternehmen kündigten außerdem an, dass sie planen, die Investitionsausgaben weiter zu erhöhen.Morgan Stanley, eine große US-Investmentbank, prognostiziert, dass die Investitionsausgaben von Hyperscale-Unternehmen im Jahr 2025 300 Milliarden US-Dollar übersteigen werden.Während die meisten dieser Ausgaben auf High-End-GPUs und die riesigen Rechenzentren entfallen, in denen diese untergebracht werden, fallen auch Nebenkosten an, beispielsweise die Energiekosten für den Betrieb der Server.

Diese KI-bezogenen Technologieunternehmen arbeiten hart daran, die Investoren davon zu überzeugen, dass es sich bei den entsprechenden Ausgaben um Vorabinvestitionen in disruptive Technologien handelt, ähnlich dem Modell „Wenn du es baust, werden die Benutzer kommen“ – das heißt, dass zunächst die Infrastruktur vorhanden sein muss, um den Betrieb zukünftiger profitabler Produkte zu unterstützen (zum Beispiel müssen Züge erst auf die Gleise gelegt werden, bevor sie fahren können). Es bestehen jedoch weiterhin Zweifel, ob die Einnahmen den Kosten entsprechen werden.

Beispielsweise können der Bau eines Rechenzentrums (einschließlich Einrichtungen, Servern usw.) und die laufenden Energiekosten in die Berechnung der Kapitalrendite (ROI) einbezogen werden, Rechenzentren bleiben jedoch nicht immer gleich. GPU-Hersteller werden weiterhin leistungsfähigere Chips entwickeln und Unternehmen müssen ihre Geräte möglicherweise kontinuierlich aufrüsten, um wettbewerbsfähig zu bleiben und den immer anspruchsvolleren Anforderungen an KI-Rechenleistung gerecht zu werden. Darüber hinaus führt die Steigerung der Rechenleistung auch zu einem höheren Energieverbrauch, was die Betriebskosten weiter erhöht.

10 ,Die größte KI-bezogene Finanzierung

Databricks, OpenAI und xAI

17. Dezember 2024Databricks, eine KI-Cloud-Datenplattform mit Hauptsitz in den USA, gab den Abschluss einer Serie-J-Finanzierung in Höhe von 10 Milliarden US-Dollar bekannt.Es wird die größte Risikokapitalinvestition im Jahr 2024 sein. Nach dieser Finanzierungsrunde erreichte die Bewertung von Databricks 62 Milliarden US-Dollar.

Auch OpenAI und xAI erhielten enorme Investitionen. Im Oktober 2024 gab OpenAI den Abschluss seiner Finanzierungsrunde B bekannt, bei der 6,6 Milliarden US-Dollar aufgebracht wurden. Die Bewertung nach der Finanzierung erreichte 157 Milliarden US-Dollar. Dies war die größte Risikokapitalrunde im Jahr 2024, bis Databricks diesen Titel übernahm.

Zuvor hatte Elon Musks xAI im Mai 2024 seine Finanzierungsrunde der Serie B abgeschlossen und dabei 6 Milliarden US-Dollar eingesammelt, was kurzzeitig die größte Finanzierungsrunde des Jahres war. Anschließend gab xAI im November 2024 den Abschluss seiner Finanzierungsrunde C bekannt, bei der 6 Milliarden US-Dollar aufgebracht und die Bewertung des Unternehmens auf 50 Milliarden US-Dollar erhöht wurden.

Quellen:

https://iot-analytics.com/ai-2024-10-most-notable-stories