Command Palette

Search for a command to run...

Online-Tutorial | YOLOv11 in Aktion! Ein Leistungsstarkes Objekterkennungstool Mit Geschwindigkeit Und Genauigkeit

Das YOLO-Modell war schon immer eine klassische Wahl für die Objekterkennung. YOLOv11 ist ein Zielerkennungsmodell der neuen Generation.Es setzt nicht nur die hohe Effizienz und Echtzeitleistung seiner Serie fort, sondern verbessert auch die Erkennungsgenauigkeit und die Fähigkeit zur Anpassung an komplexe Szenarien erheblich und sorgt so für höhere Genauigkeit, höhere Geschwindigkeit und intelligentere Argumentationsleistung.

YOLOv11 kann mehrere visuelle Aufgaben gleichzeitig erledigen: von der grundlegenden Objekterkennung und Objektklassifizierung bis hin zur feinkörnigen Instanzsegmentierung und kann sogar die Bewegungen von Personen oder Objekten durch Haltungsschätzung analysieren. Gleichzeitig schneidet YOLOv11 auch bei der Positionierungsobjekterkennung gut ab. Es kann Ziele in Bildern genau lokalisieren und identifizieren, um den Anforderungen komplexerer Szenarien gerecht zu werden. Beim autonomen Fahren kann es beispielsweise nicht nur Fahrzeuge und Fußgänger vor Ihnen genau identifizieren, sondern auch Fahrbahnmarkierungen und Verkehrszeichen präzise lokalisieren, um die Fahrsicherheit zu gewährleisten.

Der Abschnitt „HyperAI HyperNeural-Tutorial“ ist jetzt mit „One-Click-Bereitstellung von YOLOv11“ online. Das Tutorial hat die Umgebung für alle eingerichtet. Sie müssen keine Befehle eingeben. Klicken Sie einfach auf „Klonen“, um schnell die leistungsstarken Funktionen von YOLOv11 zu erkunden!

Adresse des Tutorials:

https://go.hyper.ai/ycTq1

Demolauf

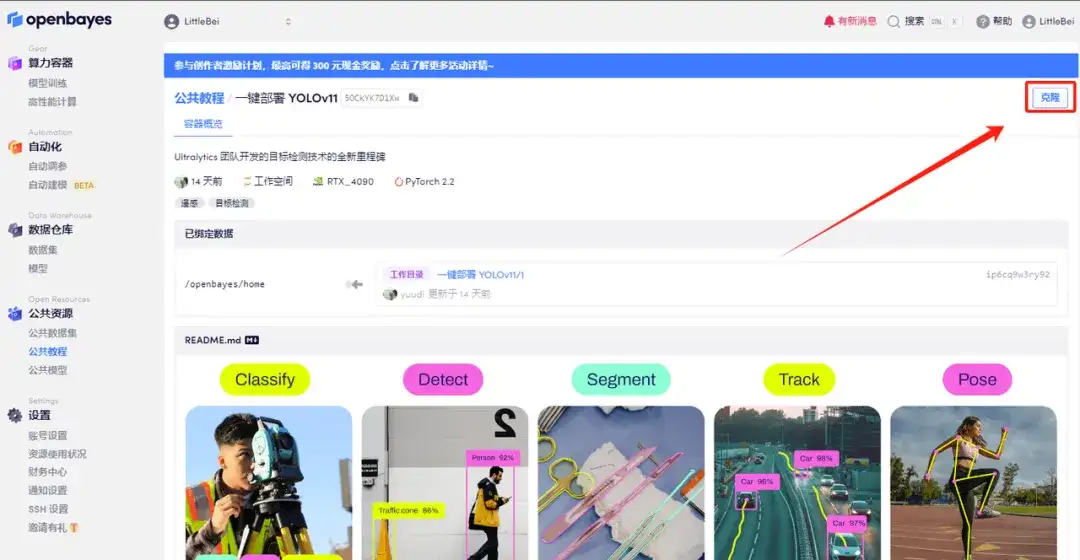

1. Melden Sie sich bei hyper.ai an, wählen Sie auf der Tutorial-Seite „YOLOv11-Bereitstellung mit einem Klick“ und klicken Sie auf „Dieses Tutorial online ausführen“.

2. Klicken Sie nach dem Seitensprung oben rechts auf „Klonen“, um das Tutorial in Ihren eigenen Container zu klonen.

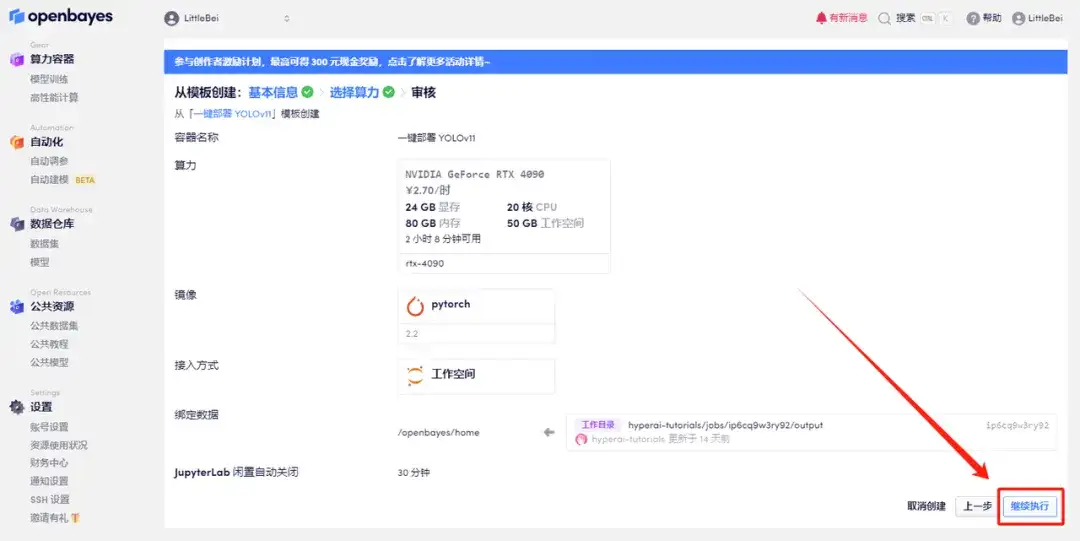

3. Klicken Sie unten rechts auf „Weiter: Hashrate auswählen“.

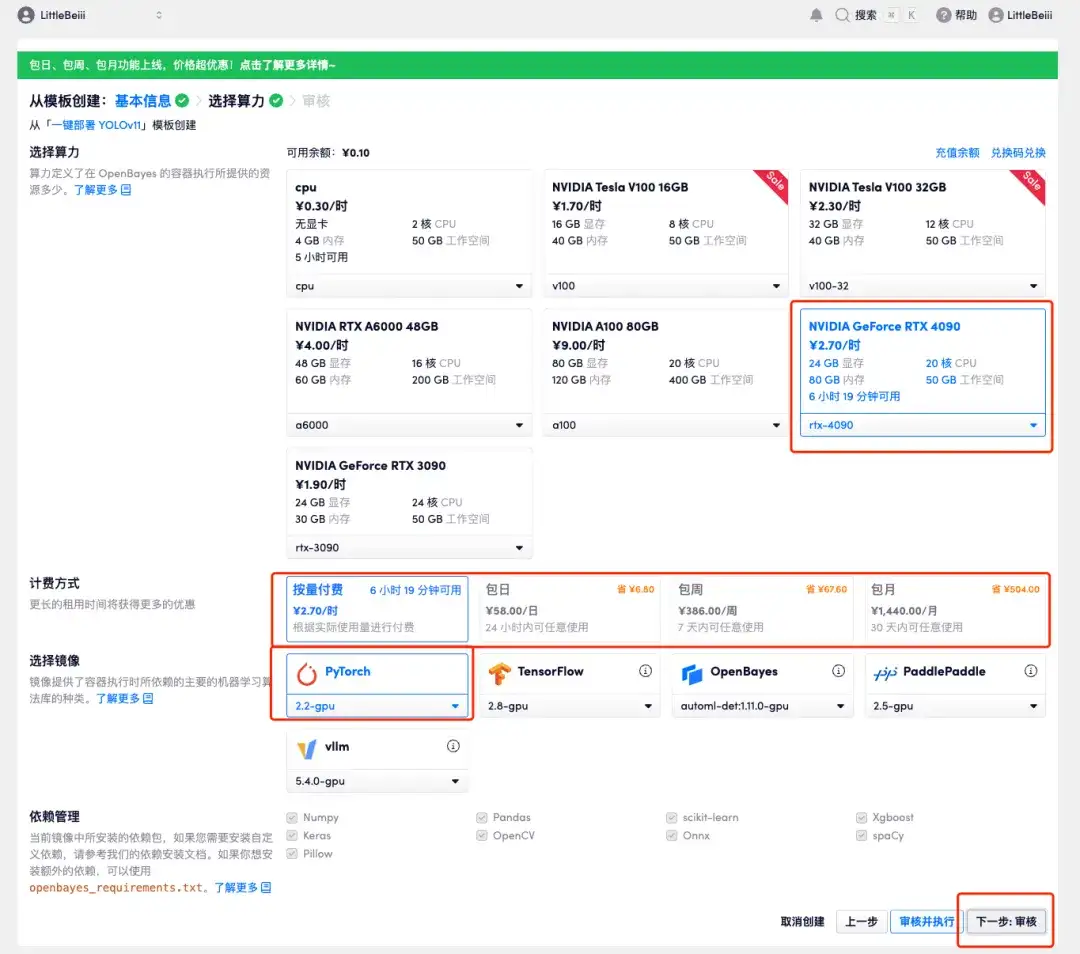

4. Wählen Sie nach dem Seitenwechsel das Bild „NVIDIA RTX 4090“ und „PyTorch“ aus. Benutzer können je nach Bedarf zwischen „Pay as you go“ oder „Pay as you go“ wählen. „Täglich/Wöchentlich/Monatlich“Klicken Sie nach Abschluss Ihrer Auswahl auf „Weiter: Überprüfen“.Neue Benutzer können sich über den unten stehenden Einladungslink registrieren, um 4 Stunden RTX 4090 + 5 Stunden CPU-freie Zeit zu erhalten!

Exklusiver Einladungslink von HyperAI (kopieren und im Browser öffnen):

https://openbayes.com/console/signup?r=Ada0322_QZy7

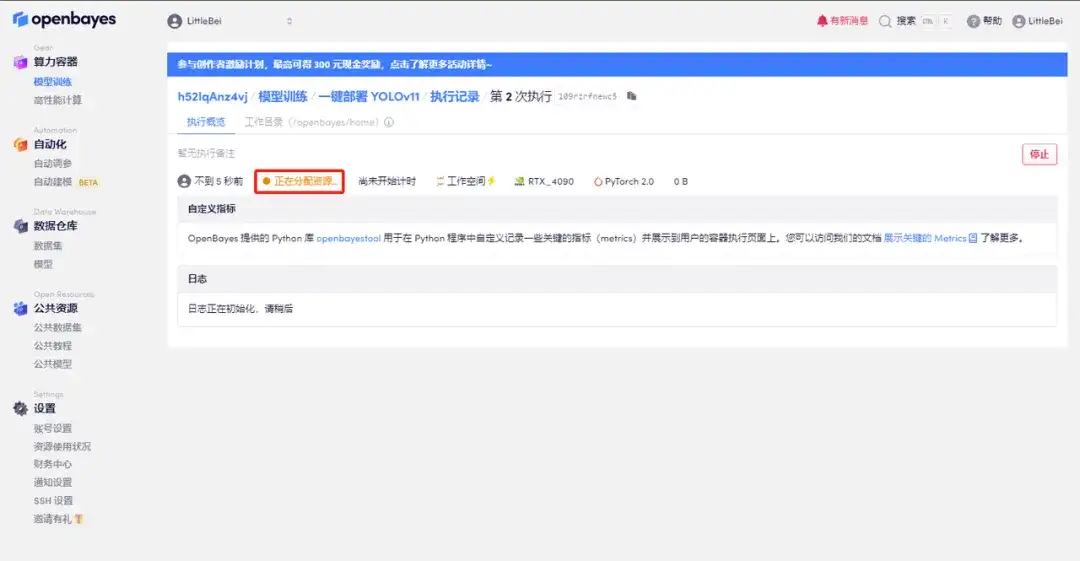

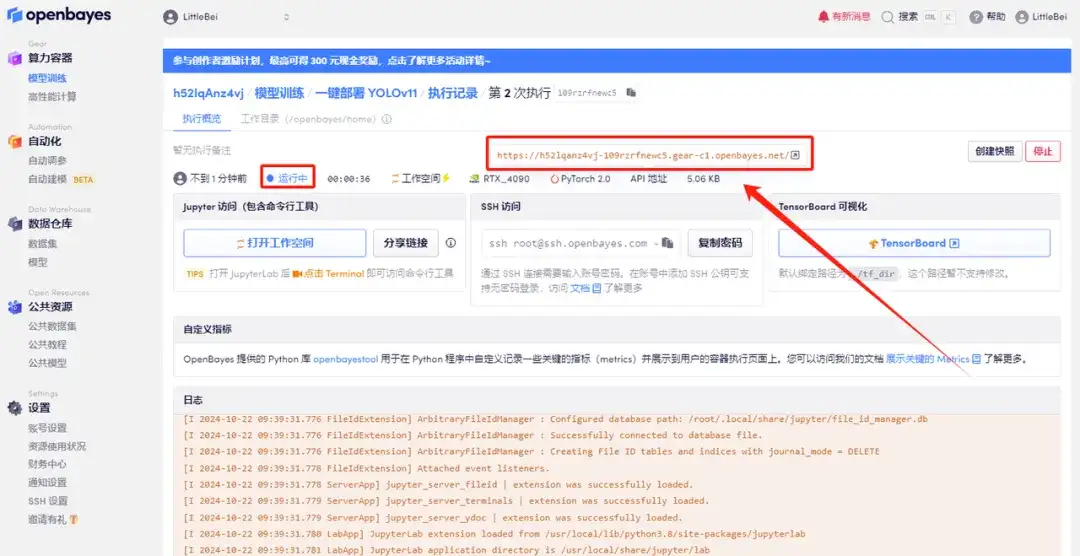

5. Klicken Sie nach der Bestätigung auf „Weiter“ und warten Sie, bis die Ressourcen zugewiesen wurden. Der erste Klonvorgang dauert etwa 2 Minuten. Wenn sich der Status in „Läuft“ ändert, klicken Sie auf den Sprungpfeil neben „API-Adresse“, um zur Demoseite zu springen.Bitte beachten Sie, dass Benutzer vor der Verwendung der API-Adresszugriffsfunktion eine Echtnamenauthentifizierung durchführen müssen.

Effektdemonstration

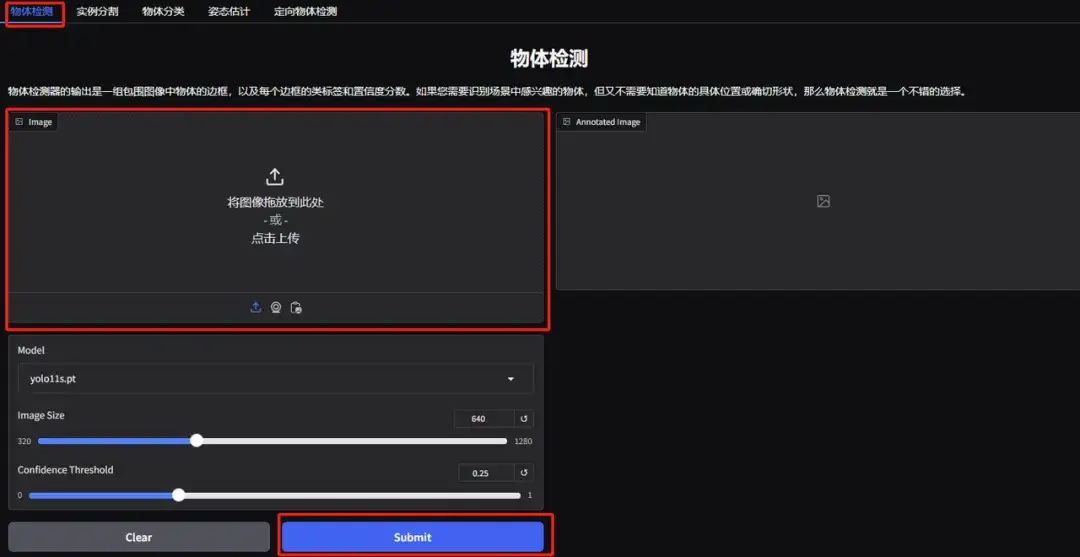

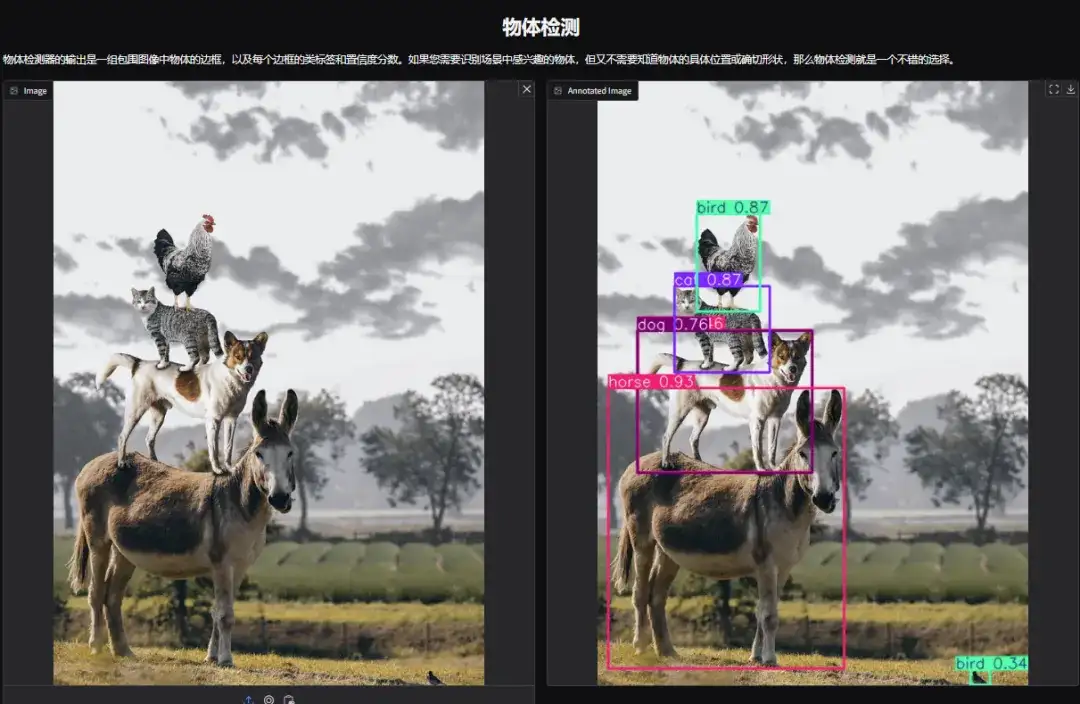

1. Öffnen Sie die Demoseite zur Objekterkennung von YOLOv11. Ich habe ein Bild von gestapelten Tieren hochgeladen, die Parameter angepasst und auf „Senden“ geklickt. Sie können sehen, dass YOLOv11 alle Tiere auf dem Bild genau erkannt hat. Es stellt sich heraus, dass in der unteren rechten Ecke ein kleiner Vogel versteckt ist! Ist Ihnen das aufgefallen?

Die folgenden Parameter stellen dar:

* Modell:Bezieht sich auf die zur Verwendung ausgewählte YOLO-Modellversion.

* Bildgröße:Die Größe des Eingabebildes. Das Modell wird die Bildgröße während der Erkennung auf diese Größe ändern.

* Vertrauensschwelle:Der Vertrauensschwellenwert bedeutet, dass bei der Zielerkennung durch das Modell nur die Erkennungsergebnisse als gültige Ziele betrachtet werden, deren Vertrauen diesen festgelegten Wert überschreitet.

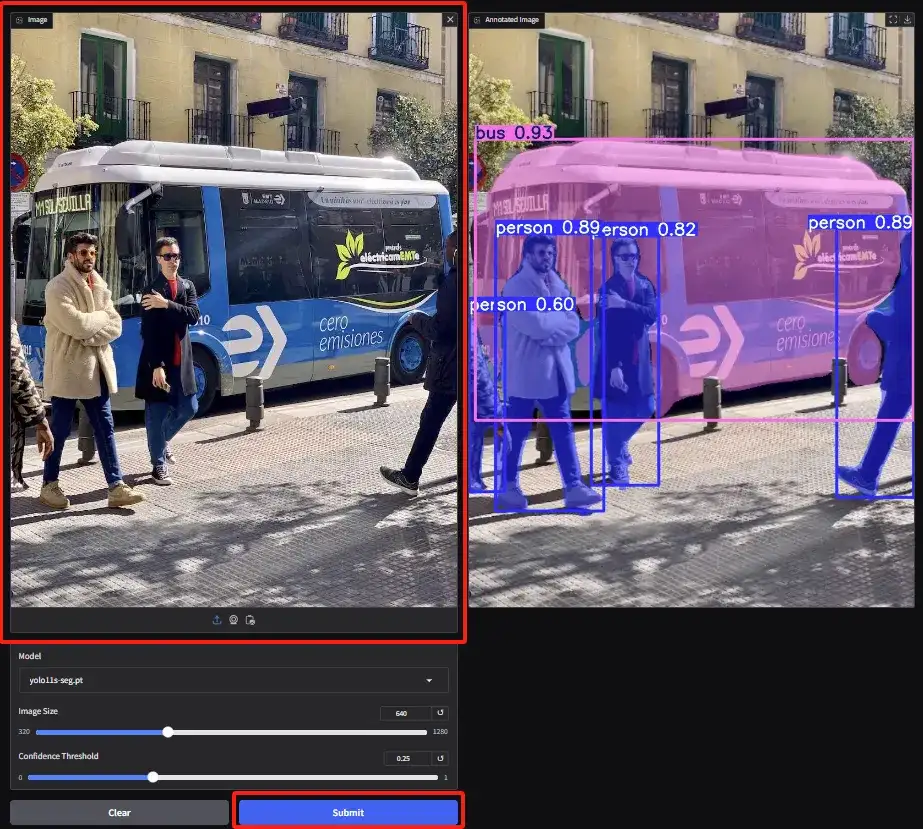

2. Rufen Sie die Demoseite zur Instanzsegmentierung auf, laden Sie das Bild hoch und passen Sie die Parameter an. Klicken Sie dann auf „Senden“, um den Segmentierungsvorgang abzuschließen. Selbst bei Okklusionen leistet YOLOv11 hervorragende Arbeit bei der genauen Segmentierung der Personen und der Umrisse des Busses.

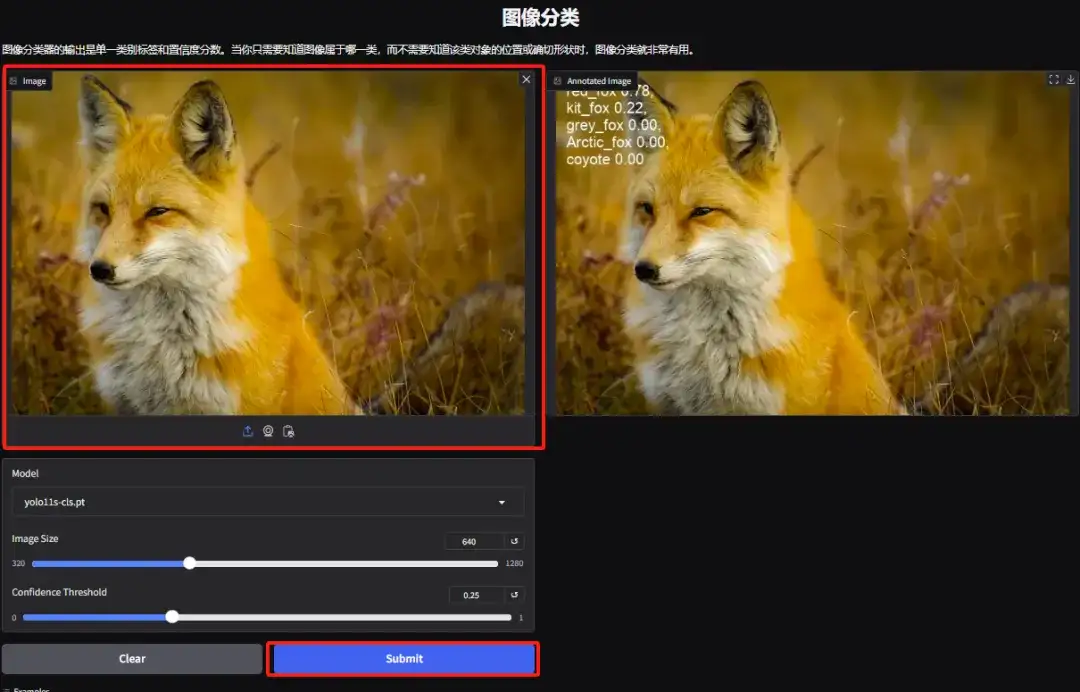

3. Rufen Sie die Demoseite zur Objektklassifizierung auf. Der Redakteur hat ein Bild eines Fuchses hochgeladen. YOLOv11 kann die spezifische Fuchsart auf dem Bild genau als Rotfuchs erkennen.

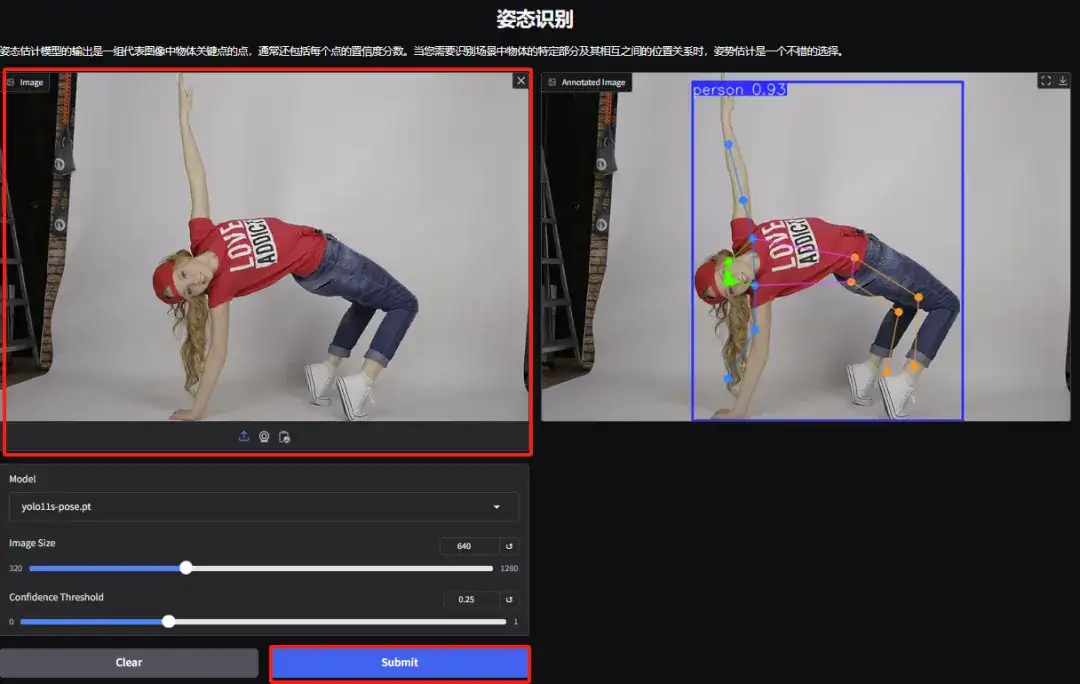

4. Rufen Sie die Demoseite zur Gestenerkennung auf, laden Sie das Bild hoch, passen Sie die Parameter entsprechend dem Bild an und klicken Sie auf „Senden“, um die Gestenbewegungsanalyse abzuschließen. Sie können sehen, dass die übertriebenen Körperbewegungen der Figur genau analysiert werden.

5. Laden Sie auf der Demoseite zur gezielten Objekterkennung ein Bild hoch und passen Sie die Parameter an. Klicken Sie dann auf „Senden“, um den genauen Standort und die Klassifizierung des Objekts zu ermitteln.