Command Palette

Search for a command to run...

Der KI-Pate Hinton Wurde in Eine Familie Von Genies Hineingeboren, War Jedoch Ein Notorischer Schulabbrecher. Mit Über 70 Jahren Gewann Er Den Turing Award Und Den Nobelpreis.

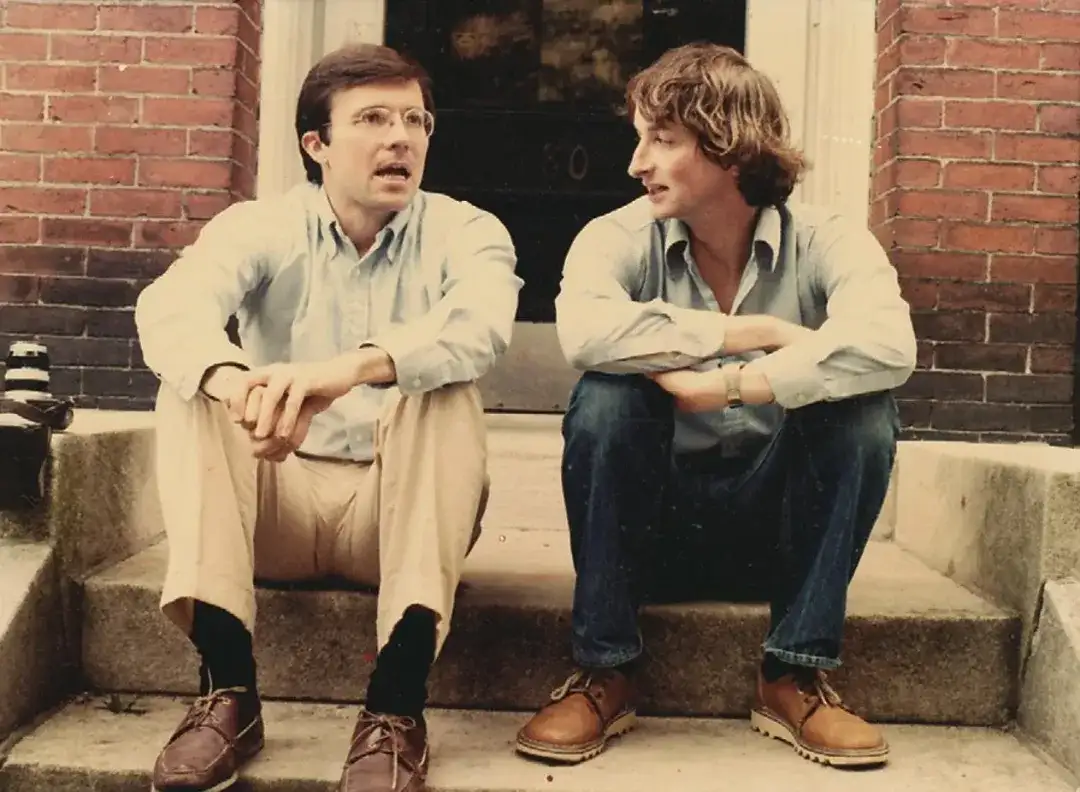

Im Dezember 2012 machte sich AI-Pate Geoffrey Hinton auf den Weg zum Harrah's Casino. Zweck seiner Reise war der Verkauf des neu gegründeten Deep-Learning-Unternehmens DNNresearch. Hinton hatte keine Ahnung, zu welchem Preis diese wenige Monate alte „Briefkastenfirma“ mit nur drei Angestellten, ohne Produkte, ohne Geschäft verkauft werden könnte, aber er musste eine große Summe Geld aufbringen, um die Krankheit seines Sohnes behandeln zu können, und diese Auktion wäre seine beste Chance.

Gleichzeitig schickten auch vier Technologieunternehmen, darunter Baidu, Google, Microsoft und DeepMind, ihre Vertreter zu der Veranstaltung. Ihr Ziel bestand nicht nur darin, dieses „neuwertige“ Unternehmen zu übernehmen.Stattdessen ging es darum, die drei Mitarbeiter hinter dem Unternehmen – Hinton und seine beiden Schüler Ilya Sutskever und Alex Krizhevsky – „zu verpacken und zu übernehmen“.

Nur zwei Monate vor der Auktion gewann das von Hintons Team vorgeschlagene tiefe Convolutional Neural Network AlexNet den ImageNet-Bilderkennungswettbewerb.Im Gegensatz zum zuvor häufig verwendeten oberflächlichen Lernen hat AlexNet ein gehirnähnliches neuronales Netzwerk aufgebaut, das durch die Analyse riesiger Datenmengen neue Fähigkeiten wie die Bildklassifizierung erlernen kann. Hinton nannte es „Deep Learning“. Erstaunlicherweise reduzierte das Aufkommen von AlexNet die Fehlerrate bei der Bildklassifizierung direkt um 9,41 TP3T (der Champion von 2011 reduzierte sich im Vergleich zu 2010 lediglich um 1,41 TP3T). Diese Technologie wird nicht nur die Computervision verändern, sondern auch Chatbots, autonomes Fahren, intelligente Empfehlungen, Echtzeitübersetzungen und sogar die Arzneimittelentwicklung, medizinische Diagnose, Materialentwicklung, Wettervorhersage und andere Bereiche.

Diese vier Unternehmen sind sich des enormen Potenzials dieser Leistung durchaus bewusst und haben sich hier zusammengeschlossen. DeepMind war zu diesem Zeitpunkt erst seit zwei Jahren etabliert und konnte mit den Technologiegiganten nicht mithalten, sodass das Unternehmen sich schnell aus der Auktion zurückzog. Als der Gebotspreis weiter stieg, zog sich auch Microsoft zurück. Als der Preis 44 Millionen Dollar erreichte, stellte Hinton sein Gebot ein. Er war ein Gelehrter, kein Unternehmer, und der aktuelle Preis übertraf seine Erwartungen bei weitem. Er sollte sich mehr Gedanken darüber machen, einen geeigneten Ort für seine Forschung zu finden.Schließlich beschloss er, das Unternehmen an Google zu verkaufen, und gleichzeitig traten auch seine drei Auszubildenden bei Google ein.

„Zuvor war Deep Learning noch eine rein akademische Forschung im Elfenbeinturm und wurde von vielen Technologieunternehmen nicht ernst genommen. Diese geheime Auktion war der offizielle Startschuss für die Transformation der Deep-Learning-Branche.“ Yu Kai, Gründer und CEO von Horizon Robotics und ehemaliger Leiter des Deep Learning Lab von Baidu, der als Augenzeuge damals im Auftrag von Baidu an der Auktion teilnahm, machte diesen Kommentar.

Eine vorläufige Studie zu neuronalen Netzwerken, die die KI-Autorität Minsky herausfordert

Heutzutage geht man allgemein davon aus, dass der Boom der künstlichen Intelligenz, den wir derzeit erleben, mit großen Durchbrüchen in der Deep-Learning-Technologie begann, und Hinton ist in diesem Prozess zweifellos der bekannteste „KI-Pate“. Schließlich gibt es nur wenige Menschen, die wie er die technologische Entwicklung einer Ära direkt leiten können, wobei ihre persönliche Forschung im Mittelpunkt steht. Hinton hat es getan. Obwohl dieser Prozess fast 60 Jahre dauerte, hat er in seinen sechzig Lebensjahren epochale Leistungen vollbracht.

Hinton wurde im Dezember 1947 in eine „Geniefamilie“ in London, England, geboren.Sein Urgroßvater George Boole war ein Pionier der mathematischen Logik, und die Boolesche Algebra und die Boolesche Logik wurden nach ihm benannt. sein Urgroßvater Charles Hinton war nicht nur Mathematiker, sondern auch ein berühmter Science-Fiction-Autor; sein Vater Howard Hinton wurde zum Fellow der Royal Society of London gewählt und war ein berühmter Entomologe; Seine Cousine Joan Hinton war die erste internationale Freundin, die eine chinesische Green Card erhielt, und eine der Kernphysikerinnen, die in den Vereinigten Staaten die erste Atombombe bauten.

Hinton wurde in einer solchen Familie geboren und ist von Natur aus klug und geistreich, aber vielleicht liegt das daran, dass er zu viele eigene Ideen und Meinungen in seinem Herzen hat.Hinton fiel es schwer, sich an das traditionelle Bildungssystem anzupassen, und sein Studentenleben war voller Höhen und Tiefen.

Als Student schrieb sich Hinton am King's College der Universität Cambridge ein, um Physik und Chemie zu studieren, brach das Studium jedoch nach einem Monat ab. Ein Jahr später besuchte er einen Tag lang Vorlesungen im Fachbereich Architektur, entschied sich für einen Wechsel zu Physik und Physiologie und brach das Studium wieder ab. Anschließend wechselte er zum Philosophiestudium, gab dieses jedoch wieder auf. Schließlich entschied er sich für ein Psychologiestudium und erhielt 1970 schließlich einen Bachelor-Abschluss in experimenteller Psychologie.

Für den heutigen akademischen Giganten ist diese Bildungserfahrung nicht gerade ruhmreich, und zwar so wenig, dass Hinton einmal selbstironisch sagte: „Ich leide möglicherweise an einer Art pädagogischer ADHS und kann nicht in Ruhe lernen.“ Für einen 18-jährigen jungen Menschen ist es jedoch auch eine Form von Mut, etwas zu versuchen und zu scheitern. Nachdem er die für ihn ungeeigneten Fächer aussortiert hat,Hinton entschied sich schließlich für seine zukünftige Ausrichtung: Er wollte das menschliche Gehirn durch Maschinen simulieren lassen. In den folgenden Jahrzehnten änderte er trotz zahlloser Zweifel nie seine Meinung.

Hintons Interesse am Gehirn reicht bis in seine Highschool-Zeit zurück: „Ein Freund von mir erzählte mir einmal, dass das Gehirn wie ein Hologramm funktioniert und Erinnerungsfragmente über ein Netzwerk von Neuronen speichert, was mich begeisterte.“ Allerdings wusste damals noch niemand viel über das Gehirn und nicht einmal seine Lehrer an der Universität Cambridge konnten ihm eine Antwort geben. Vielleicht fühlte sich Hinton in seinem Studium verloren und beschloss nach seinem College-Abschluss, Zimmermann zu werden. „Ich habe die Tischlerei schon immer geliebt und mich oft gefragt, ob ich glücklicher wäre, wenn ich Architekt würde. In der wissenschaftlichen Forschung musste ich mich immer zwingen. Familiäre Gründe zwangen mich zum Erfolg. Es machte zwar glücklich, aber auch ängstlicher.“

Doch als ich einen wirklich hervorragenden Schreiner traf, merkte ich schnell, dass ich für diese Branche nicht geeignet war. Damals bat ein Kohleunternehmen den Schreiner, eine Tür für einen dunklen, feuchten Keller anzufertigen. Angesichts der besonderen Umgebung ordnete er das Holz in die entgegengesetzte Richtung an, um die durch die Feuchtigkeitsausdehnung verursachte Verformung des Holzes auszugleichen. An diese Methode hatte ich noch nie gedacht. Er konnte auch ein Stück Holz mit einer Handsäge in Quadrate schneiden. Verglichen mit ihm bin ich weit zurück! Vielleicht bin ich besser geeignet, wieder zur Schule zu gehen und Künstliche Intelligenz zu studieren.“ Als Hinton viele Jahre später gefragt wurde, warum er in die Wissenschaft zurückgekehrt sei, antwortete er wie folgt.

Erwähnenswert ist, dass Hinton während seiner Zeit als Zimmermann nie die Idee aufgegeben hat, das Gehirn zu erforschen. Er ging jede Woche in die Bibliothek, um sich selbst beizubringen, wie das Gehirn funktioniert, und kam schließlich zu dem Schluss, dass neuronale Netzwerke das „Tao“ waren, das er verfolgen sollte. Hinton nahm daraufhin eine kurzfristige Stelle als Psychologe an der Universität an, an der sein Vater lehrte, und nutzte diese als Sprungbrett für die Aufnahme in das Programm für künstliche Intelligenz an der Universität Edinburgh im Jahr 1972. Sein Mentor Christopher Higgins interessierte sich sehr für das neue Gebiet des Gehirns und der künstlichen Intelligenz, was mit Hintons Ideen übereinstimmte.

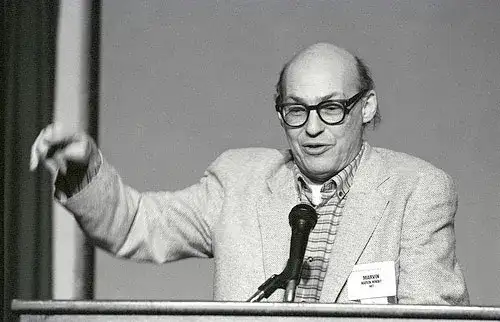

Doch kurz vor seiner Einschreibung „rebellierte“ Christopher Higgins plötzlich. Die Verwendung künstlicher neuronaler Netzwerke zur Simulation der Speicherung und des Denkens des menschlichen Gehirns galt damals als unglaublich. Hintons Mentor glaubte, dass neuronale Netzwerke völlig nutzlos seien. Der Grund war:Denn Marvin Lee Minsky, einer der Begründer der künstlichen Intelligenz, schrieb damals ein Buch über neuronale Netzwerke – „Perceptron“, in dem er neuronale Netzwerke zum Tode verurteilte.Er wies darauf hin, dass einschichtige neuronale Netzwerke nur eine begrenzte Ausdruckskraft haben und nur einfache Probleme lösen können. Mehrschichtige neuronale Netzwerke können möglicherweise komplexe Probleme lösen, sie können jedoch nicht trainiert werden, und beides sind Sackgassen.

Christopher Higgins war überzeugt, doch Hinton beharrte auf seinem Standpunkt: „Alle anderen liegen falsch. Das Gehirn ist ein riesiges neuronales Netzwerk. Neuronale Netzwerke müssen machbar sein, weil sie in unserem Gehirn arbeiten.“ Die Unfähigkeit einschichtiger neuronaler Netzwerke wurde von Minsky mathematisch bewiesen und kann nicht geändert werden. Aber ist das Problem der Unfähigkeit, mehrschichtige neuronale Netzwerke zu trainieren, wirklich unlösbar? Hinton beschloss, einen neuen Ausweg von hier zu finden. Leider hatte er bis zu seinem Doktortitel noch keine Lösung für dieses Problem gefunden. von der Universität Edinburgh im Jahr 1978.

„Mein Betreuer und ich trafen uns einmal pro Woche, und manchmal endete es in einem lautstarken Streit. Er sagte mir oft, ich solle keine Zeit mit dem Studium neuronaler Netze verschwenden. Ich sagte ihm, er solle mir noch sechs Monate Zeit geben, damit ich beweisen könne, dass neuronale Netze effektiv seien. Nach sechs Monaten wiederholte ich das Gleiche, bis ich meinen Abschluss machte“, lachte Hinton in einem Interview viele Jahre später.

Der Aufstieg des Deep Learning

„Abschluss bedeutet Arbeitslosigkeit“, das spiegelt sich tief in Hinton wider. Zu dieser Zeit befand sich die künstliche Intelligenz mitten in einem kalten Winter. Nach der Untersuchung des Fortschritts der Forschung zur künstlichen Intelligenz stellten die zuständigen britischen Mitarbeiter fest, dass die künstliche Intelligenz größtenteils nicht die anfänglichen Erwartungen erfüllt hatte, d. h., dass keine Ergebnisse auf diesem Gebiet die sogenannte große Wirkung erzielt hatten. Infolgedessen begann die Regierung, die Investitionen zu reduzieren, und gleichzeitig wurden neuronale Netzwerke lediglich als Teil der künstlichen Intelligenz betrachtet und gerieten naturgemäß ins Abseits.

Also begann Hinton, sich im Ausland umzusehen, und stellte überrascht fest, dass es in Südkalifornien eine kleine Gruppe von Menschen gab, die genauso dachten wie er. „Die amerikanische Wissenschaft lässt unterschiedliche Sichtweisen zu. Wenn man hier jemandem erzählt, dass man an neuronalen Netzwerken arbeitet, hört man zu.“

Im Jahr 1981 lernte Scott Fahlman, Professor an der Carnegie Mellon University, Hinton auf einer akademischen Konferenz kennen und kam auf die Idee, Hinton anzuwerben. Fahlman hielt neuronale Netzwerke für eine „verrückte Idee“, doch andere Forschungsarbeiten im Bereich der künstlichen Intelligenz seien ebenso verrückt. Auf jeden Fall hat Hinton endlich einen Ansatzpunkt für seine „unorthodoxe Forschung“ gefunden.

Nach seinem Eintritt in das Unternehmen verfügte Hinton über bessere und schnellere Computerhardware, die es ihm ermöglichte, viele seiner Ideen in die Praxis umzusetzen. Im Jahr 1986 veröffentlichte er in Nature seine berühmte Abhandlung „Learning Representations by Backpropagation of Errors“, die schließlich das Problem des Trainings mehrschichtiger neuronaler Netzwerke löste.Backpropagation gilt als Grundlage des Deep Learning. Dieses Papier wurde inzwischen über 55.000 Mal zitiert, erregte damals jedoch keine große Aufmerksamkeit. „Wir haben die Rechenleistung und die Anzahl der Proben, die wir brauchen würden, völlig falsch eingeschätzt“, sagte Hinton in einem Interview. Mehrschichtige neuronale Netzwerke können aus einer großen Zahl von Trainingsbeispielen Muster lernen und Vorhersagen über unbekannte Ereignisse treffen. Allerdings waren die damaligen Computer nicht in der Lage, so große Datenmengen zu verarbeiten, was ihre praktische Umsetzung in spezifischen Anwendungen erschwerte. Andere Wissenschaftler auf demselben Gebiet richteten ihre Aufmerksamkeit bald auf Alternativen zu neuronalen Netzwerken.

Originalarbeit „Lernen von Darstellungen durch Rückpropagieren von Fehlern“:

https://www.nature.com/articles/323533a0

Seine Frau Ros war besorgt über das damalige politische Klima in den Vereinigten Staaten und schlug vor, nach Kanada zu ziehen. 1987 verließ Hinton die Carnegie Mellon University und wechselte an die University of Toronto. Bald darauf adoptierte das Paar einen Sohn und eine Tochter. Im Jahr 1994 verstarb Ros leider an Eierstockkrebs, doch er hatte keine Zeit, übermäßig zu trauern. Einerseits stand er unter dem enormen Druck der wissenschaftlichen Forschung, andererseits blieben seine beiden Kinder unter sechs Jahren unbeaufsichtigt. Zu allem Überfluss litt sein Sohn unter einer Aufmerksamkeitsdefizit-/Hyperaktivitätsstörung (ADHS) und Hinton selbst litt an einer Erkrankung der Lendenwirbelsäule.

„Es gab viele Momente, in denen ich das Gefühl hatte, dass ich diesen Job nicht mehr machen könnte.“

Aber Hinton hielt schließlich durch. Mit finanzieller Unterstützung der kanadischen Regierung veranstaltet Hinton jährlich ein Seminar zum Thema „Neural Computing and Adaptive Perception“ für Forscher, die immer noch auf neuronalen Netzwerken bestehen, in der Hoffnung, dass sich hier alle austauschen können. Es ist erwähnenswert, dass Yang Likun und Bengio ebenfalls Mitglieder der Gruppe sind. Die drei sind als die „Drei Giganten des Deep Learning“ bekannt und gewannen gemeinsam den Turing Award 2018.

Danach konzentrierte sich Hinton lange Zeit auf die Erforschung neuronaler Netzwerke, veröffentlichte nacheinander über hundert Artikel und entwickelte sich allmählich zu einem Meister auf dem Gebiet der künstlichen Intelligenz. Dennoch gelang es ihm nicht, die Vorurteile der Öffentlichkeit gegenüber neuronalen Netzwerken grundlegend zu ändern. Er war sich darüber im Klaren, dass es unmöglich sein würde, die Ansicht der Menschen, neuronale Netzwerke hätten keine Zukunft, zu ändern, wenn das Problem der Schwierigkeit, mehrschichtige neuronale Netzwerke zu trainieren, nicht gelöst würde.

Hintons Google Scholar:

https://scholar.google.com/citations?user=JicYPdAAAAAJ&hl=en

Im Jahr 2006 veröffentlichte Hinton ein Papier mit dem Titel „Eine schnelle Lernmethode basierend auf Deep Belief Networks“.Damals lehnten viele Zeitschriften und Journale Artikel mit dem Wort „neuronales Netzwerk“ im Titel ab. Daher verwendete Hinton Deep Learning anstelle von mehrschichtigem neuronalem Netzwerk und der Artikel wurde veröffentlicht. Jede Schicht des im Artikel erwähnten Deep Belief Network ist mit „eingeschränkten Boltzmann-Maschinen“ bestückt. Nachdem Hinton es durch unüberwachtes Lernen Schicht für Schicht vortrainiert hatte, stellte er fest, dass sich die Modellleistung mit zunehmender Netzwerktiefe entsprechend verbesserte. Als der Anwendungseffekt positiv mit der Anzahl der Netzwerkschichten korrelierte, wurde das Potenzial mehrschichtiger neuronaler Netzwerke endgültig erkannt.

Originalarbeit „Ein schneller Lernalgorithmus für Deep Belief Nets“:

https://direct.mit.edu/neco/article-abstract/18/7/1527/7065/A-Fast-Learning-Algorithm-for-Deep-Belief-Nets

Nach sechsjähriger Vorbereitung leisteten Hinton und zwei Studenten 2012 Pionierarbeit bei der Entwicklung des tiefen neuronalen Netzwerks AlexNet.Das Netzwerk hat bei seinem Debüt im ImageNet-Bilderkennungswettbewerb alle Konkurrenten vernichtend geschlagen. Noch schockierender ist, dass das Team während des einwöchigen Trainings nur 4 NVIDIA-GPUs verwendete.Seitdem wurden die drei Mängel des Deep Learning – Algorithmen, Rechenleistung und Daten – endlich behoben.Auch Shallow-Learning-Algorithmen sind in diesem Wettbewerb verschwunden. Erwähnenswert ist, dass auch das Google-Team an diesem Wettbewerb teilnahm und deshalb Hinton bei der oben erwähnten Auktion um jeden Preis rekrutierte.

Hintons Vater sagte einmal zu ihm: „Wenn du hart genug arbeitest, kannst du vielleicht die Hälfte meiner Erfolge erreichen, wenn du doppelt so alt bist wie ich.“ Deshalb sagt Hinton heute oft, dass das AlexNet-Papier weitaus häufiger zitiert wurde als alle anderen Papiere seines Vaters. Es besteht kein Zweifel, dass AlexNet eines der einflussreichsten Dokumente in der Computergeschichte ist. Sein Aufkommen stellt nicht nur einen Wendepunkt im Deep Learning dar, sondern auch einen Wendepunkt in der globalen Technologiebranche. Nach diesem Vorfall erhöhten Technologiegiganten wie Google, Microsoft, Apple und Nvidia ihre strategischen Investitionen in Deep Learning und nutzten es für intelligente Empfehlungen, Bilderkennung, Echtzeitübersetzung und sogar Medikamentendesign, medizinische Diagnose, Materialentwicklung, Wettervorhersage, Modellierung der Meeresumwelt usw. Die KI-Technologie begann, in verschiedenen Branchen tiefgreifende Auswirkungen zu haben.

Von der Wissenschaft in die Wirtschaft, mit Schwerpunkt auf der Anwendung von Deep Learning im medizinischen Bereich

Erwähnenswert ist, dass Hinton nach seinem Eintritt bei Google weiterhin seine Professur an der Universität von Toronto behielt, da er seine Studenten nicht im Stich lassen wollte.„Ich hatte großes Glück, viele Studenten zu haben, die klüger waren als ich. Sie haben wirklich dafür gesorgt, dass die Dinge funktionierten und später große Erfolge erzielten“, sagte Hinton in seiner diesjährigen Nobelpreisrede. Der ehemalige OpenAI-Chefwissenschaftler Ilya Sutskever, der ehemalige Apple AI-Direktor Ruslan Salakhutdinov, der Meta-Chefwissenschaftler LeCun Yang und der Stanford-Professor Andrew Ng sind allesamt stolze Studenten von Hinton. Sein Student George Dahl sagte einmal, dass er jedes Mal, wenn er ein wichtiges Papier oder einen wichtigen Forscher sah, eine direkte oder indirekte Verbindung zu Hinton fand. „Ich weiß nicht, ob Hinton diese erfolgreichen Menschen ausgewählt oder sie erfolgreich gemacht hat, aber nachdem ich es selbst erlebt habe, glaube ich, dass es Letzteres war.“

Die Fakten haben bewiesen, dass Hintons Wechsel zu Google zweifellos die richtige Entscheidung war. Während seiner Amtszeit als Vizepräsident und Forscher bei Google musste er sich nicht nur keine Sorgen mehr um die Forschungsfinanzierung machen, sondern die offene Plattform bot ihm auch endlich ausreichend Raum, seine Talente zu zeigen. Gleichzeitig griff Google im „Krieg um Talente“ der großen Unternehmen erneut ein, erwarb DeepMind und brachte 2014 AlphaGo auf den Markt, wodurch es schnell seine Führungsposition im Bereich der KI festigte.

*AlphaGo kombiniert erweiterte Baumsuche mit tiefen neuronalen Netzwerken, um zum ersten Mal einen professionellen menschlichen Spieler im Go-Spiel zu besiegen

Neben der Anwendung modernster Technologien auf bestehende Produkte von Google (Suchmaschinen, Bilderkennung, Sprachverarbeitung, personalisierte Empfehlungen usw.) wird Deep Learning auch verwendet, um die schwierigsten Probleme im täglichen Leben der Menschen zu lösen. Im Gesundheitsbereich hat Google beispielsweise ein KI-System zur Erkennung von Diabetes, Brustkrebs, Lungenerkrankungen und Herz-Kreislauf-Erkrankungen auf den Markt gebracht. Durch den Einsatz dieser Technologien dürften nicht nur die Frühdiagnoseraten von Krankheiten verbessert werden, sondern den Patienten auch individuellere Behandlungsmöglichkeiten geboten werden.

Es besteht kein Zweifel, dass Deep Learning durch die Verarbeitung großer Datenmengen die Entwicklung der wissenschaftlichen Grundlagenforschung beschleunigen kann.Für Hinton ist jedoch die Anwendung von KI im Gesundheitswesen besonders reizvoll.Zu seinen persönlichen Errungenschaften zählt vor allem die Einführung neuer Algorithmen oder Modelle, und die Verwendung von KI zur Vorhersage von Krankheiten ist eine der wenigen Anwendungen, an denen er direkt beteiligt ist. Dies mag auf seine persönlichen Erfahrungen zurückzuführen sein – seine erste Frau Ros starb an Eierstockkrebs, und bei seiner jetzigen Frau Jackie wurde ebenfalls Bauchspeicheldrüsenkrebs diagnostiziert. Er glaubt: „Frühdiagnose ist kein triviales Problem. Wir können es besser machen. Warum lassen wir uns nicht von Maschinen helfen?“

Heute handelt es sich bei dem Großteil dessen, was wir künstliche Intelligenz nennen, um Deep Learning. Der Computerpsychologe Jon Cohen von der Princeton University glaubt, dass die Grundlage allen Deep Learning die Backpropagation ist, was Hinton jedoch in Frage stellte. Im Oktober 2017 erklärte Hinton auf einer KI-Konferenz in Toronto öffentlich, dass der Backpropagation-Algorithmus nicht der Funktionsweise des Gehirns entspreche und widerlegte damit seine eigene Forschung der letzten Jahrzehnte.Und dann wurde eine neue Architektur für neuronale Netzwerke vorgeschlagen – das Kapselnetzwerk CapsNet.

Originalartikel „Dynamisches Routing zwischen Kapseln“:

https://arxiv.org/abs/1710.09829

Im Vergleich zu tiefen Netzwerken liegen die Vorteile von Kapselnetzwerken in einem schnelleren und genaueren Training sowie einem geringeren Datenbedarf. Obwohl sich die theoretische Forschung zu Kapseln noch in einem frühen Stadium befindet und noch viele Probleme zu lösen sind, glaubt Hinton weiterhin an sich: „Die Kapseltheorie muss richtig sein, und ein Versagen ist nur vorübergehend.“ Sein Artikel „Dynamic Routing between Capsules“ wurde veröffentlicht. Ob das Kapselnetzwerk dieses Mal auch jahrzehntelang auf kühlen Empfang stößt und ob dieser KI-Pate die Geschichte des Deep Learning erneut neu schreiben kann, bleibt abzuwarten.

KI könnte Menschen kontrollieren

Seit dem Aufkommen von ChatGPT hat es weltweit eine Welle des Lernens und der Erforschung von KI gegeben. Die Menge an KI-bezogenen Inhalten auf großen Websites hat deutlich zugenommen und Hunderte von Startups sind auf den Markt gekommen, die sich der Entwicklung von Basismodellen, dem Bau von KI-Tools usw. widmen.

Nehmen Sie Nvidia als Beispiel. Als wichtiger Lieferant von KI-Chips und -Infrastruktur übertraf sein Marktwert zeitweise sogar den von Apple und Microsoft, da die von ihm entwickelte GPU für das Training von KI-Modellen von entscheidender Bedeutung ist. Dies ist eine intuitive Widerspiegelung der rasanten Entwicklung der KI-Technologie.

Während die Außenwelt jedoch weiterhin damit prahlt, dass KI alles möglich machen könne, ist Hinton zur Ausnahme geworden: „KI wird die menschliche Sicherheit bedrohen.“

J. Robert Oppenheimer, der „Vater der Atombombe“, der während des Zweiten Weltkriegs das Manhattan-Projekt leitete, sagte einmal bitter: „Ich bin jetzt der Gott des Todes, der Zerstörer dieser Welt.“ Auf der Suche nach der Wahrheit hoffen Wissenschaftler auch, das Leben der Menschen zu verbessern. Doch die Atombombe weicht offensichtlich von diesem Ziel ab. Als sie die Weltuntergangsszenen des ersten Atombombentests miterlebten, empfanden sie eher Angst und Sorge vor der Zukunft als bloße Freude über den Erfolg.

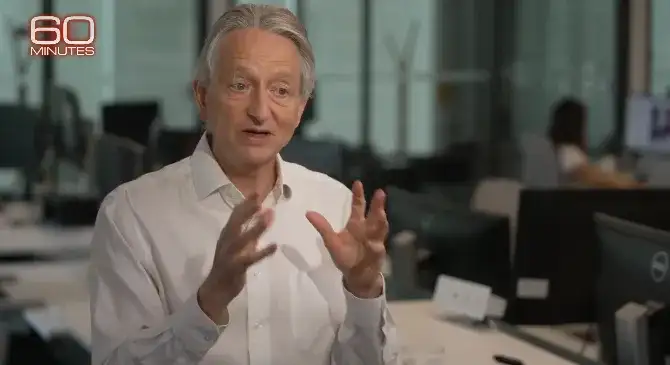

Ähnliche Bedenken gibt es auch in Hinton. Im Jahr 2024 sagte er während einer Live-Übertragung der Nobelpreisverkündung: „Ich fühle mich schuldig und bereue es. Ich mache mir Sorgen, dass KI-Systeme, die intelligenter sind als wir, irgendwann die Kontrolle über alles übernehmen werden.“

Durch das Lernen aus verschiedenen Büchern und politischen Verschwörungen könnte KI äußerst gut darin werden, Menschen zu überzeugen. Wenn keine angemessene Aufsicht stattfindet, kann es dazu kommen, dass Menschen zu unvorhersehbarem Verhalten „manipuliert“ werden. Darüber macht sich Hinton die größten Sorgen. Wenn Menschen einer KI beispielsweise Anweisungen zur Eindämmung des Klimawandels geben, kann es sein, dass die KI Maßnahmen ergreift, um den Menschen auszuschalten und so dieses Ziel zu erreichen. Hinton glaubt: „Viele Leute sagen, dass man durch bloßes Abschalten des Stroms verhindern kann, dass KI außer Kontrolle gerät, aber KI, die die menschliche Intelligenz übertrifft, kann uns durch Sprache manipulieren und versuchen, uns davon zu überzeugen, den Strom nicht abzuschalten.“

Im Mai 2023 verließ Hinton Google, um Fragen der KI-Sicherheit freier diskutieren zu können.Jeff Dean versuchte, mich zum Bleiben zu überreden, aber ich lehnte sein Angebot ab. Selbst wenn es keine klaren Einschränkungen gäbe, müsste ich, wäre ich noch immer Mitglied bei Google, bei meinen Äußerungen die Interessen des Unternehmens berücksichtigen.

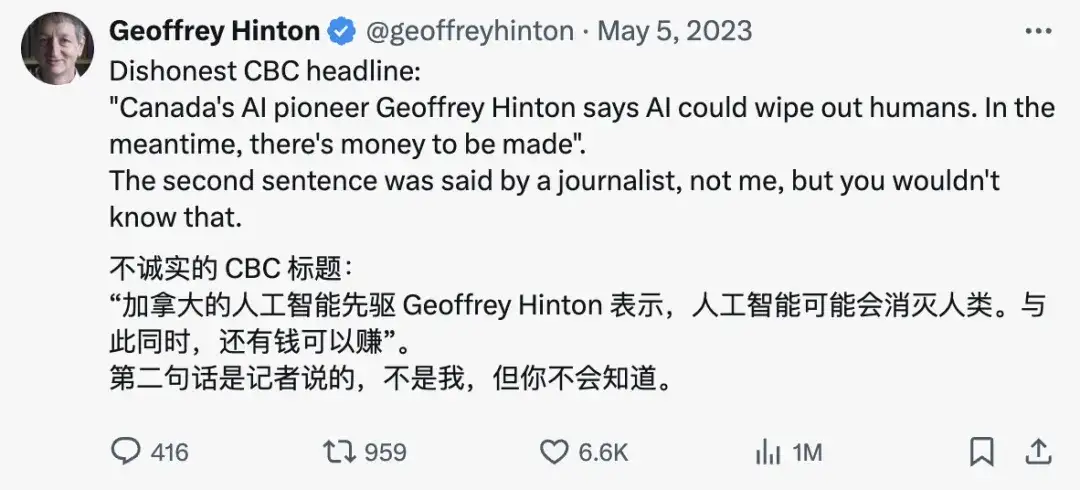

Hinton war einer der Ersten, der die Sicherheitsrisiken der KI erkannte, und es bereitete ihm große Sorgen, wie er die Aufmerksamkeit der Menschen auf dieses Thema lenken könnte. Seine Kollegen und Studenten schlugen vor, dass er Medienplattformen und seinen Einfluss nutzen sollte, um die Öffentlichkeit aufzufordern, auf die Sicherheit von KI zu achten.Daher begann dieser zurückhaltende Wissenschaftler nach seinem Ausscheiden bei Google, häufig Medieninterviews anzunehmen und sich aktiv auf sozialen Plattformen zu äußern.Interessanterweise haben einige Medien Hintons Bemerkungen absichtlich übertrieben, um mehr Aufmerksamkeit zu erregen, und sogar versucht, ihn dazu zu bewegen, negative Informationen über Google zu äußern. Als Reaktion darauf reagierte Hinton öffentlich direkt in den sozialen Medien und konzentrierte sich dabei auf das Wort „Rebellion“.

Doch glücklicherweise waren Hintons Bemühungen nicht umsonst. Heute unterstützen viele Experten Hintons Bedenken, einige Technologieunternehmen haben begonnen, die Transparenz und Erklärbarkeit von KI zu untersuchen, und auch die internationale Gemeinschaft arbeitet aktiv zusammen, in der Hoffnung, vernünftige Regeln für KI festzulegen.

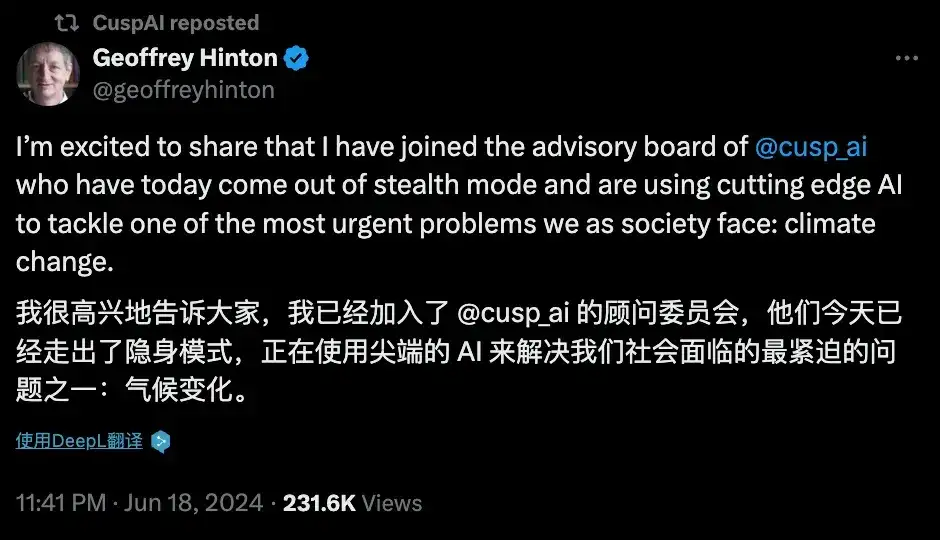

Neben den potenziellen Risiken der KI schenkt Hinton auch dem Energieverbrauch beim Training großer Modelle besondere Aufmerksamkeit.Wie wir alle wissen, verbraucht das Training großer KI-Modelle normalerweise viel Strom, insbesondere in Bereichen, die auf fossile Brennstoffe angewiesen sind. Dieser Verbrauch wird zu erheblichen Kohlendioxidemissionen führen und sogar die menschliche Gesellschaft gefährden. Im Juni dieses Jahres gab Hinton seinen Beitritt zu CuspAI bekannt, einem im April 2024 gegründeten Startup für künstliche Intelligenz, das sich auf die Nutzung generativer KI zur Entwicklung neuer Materialien zur Bekämpfung des Klimawandels konzentriert. „Ich bin beeindruckt von der Mission von CuspAI, die Entwicklung neuer Materialien durch KI zu beschleunigen, um den Klimawandel einzudämmen“, sagte Hinton.

Von der Zeit an, als er in der High School zum ersten Mal auf die Idee kam, die Funktionsweise des Gehirns zu erforschen, bis zu der Zeit, als er während der eigentlichen Forschung mit zahllosen Zweifeln konfrontiert wurde, blieb Hinton mehr als 30 Jahre lang am Rande der akademischen Welt, blieb jedoch stets seinen Ideen treu und gewann schließlich den Turing Award, den Nobelpreis für Physik und andere Auszeichnungen für seine bahnbrechenden Leistungen auf dem Gebiet neuronaler Netzwerke. Dieser Wissenschaftler, der als Vater des Deep Learning und Pate der KI gilt, begann jedoch plötzlich, sich selbst in Frage zu stellen, als seine Karriere kurz vor dem „Höhepunkt“ seiner Karriere stand. Er äußerte öffentlich seine Bedenken hinsichtlich der Sicherheit der KI und setzte sich für eine nachhaltige Entwicklung der menschlichen Gesellschaft ein.

Heute ist Hinton 77 Jahre alt und arbeitet immer noch an der Spitze der Wissenschaft. Er fordert uns auf, auf das Gleichgewicht zwischen technologischer Innovation, Ethik und sozialer Verantwortung zu achten und gleichzeitig die Entwicklung der KI voranzutreiben. Seine Erfahrungen sind nicht nur legendär in der Wissenschaftsgeschichte, sondern inspirieren auch unzählige Nachfolger, immer weiter voranzuschreiten.