Command Palette

Search for a command to run...

Die Erste Vollständige Chinesische Triton-Dokumentation Ist Online! Beginn Einer Neuen Ära Der GPU-Inferenzbeschleunigung

Drei Jahre nach seiner Veröffentlichung führt Triton die neue Welle der KI-Compiler an

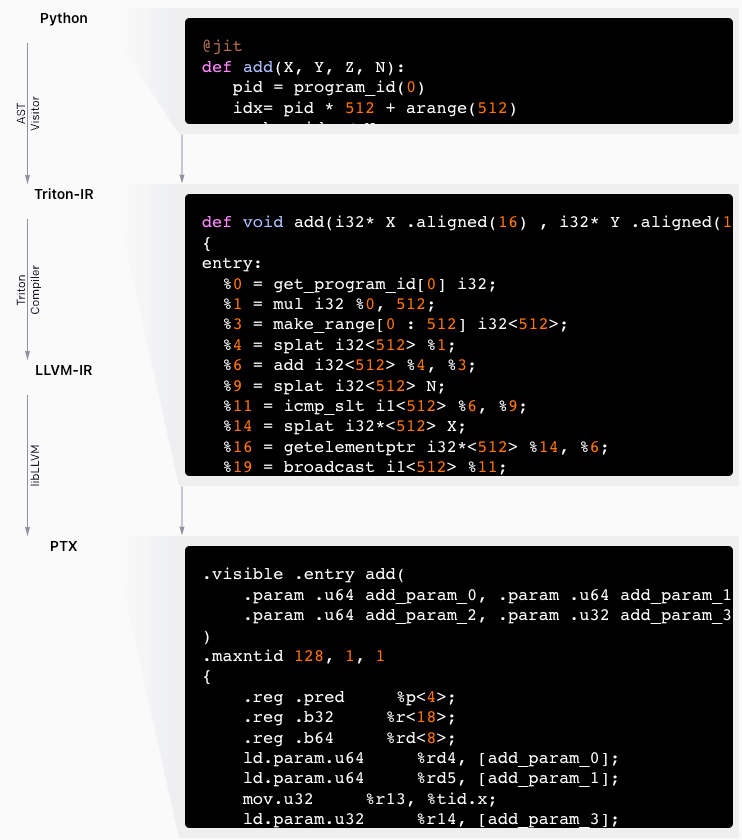

Im Jahr 2019 haben Philippe Tillet et al. Triton wurde erstmals in der Arbeit „Triton: An Intermediate Language and Compiler for Tiled Neural Network Computations“ vorgeschlagen. Im Jahr 2020 kam Philippe Tillet zu OpenAI und leitete weiterhin die Entwicklung des Triton-Projekts. Im Jahr 2021 wurde der Triton-Compiler erstmals öffentlich veröffentlicht.

Papieradresse:https://dl.acm.org/doi/10.1145/3315508.3329973

Der Triton-Compiler wurde entwickelt, um Forschern und Entwicklern zu ermöglichen, mit weniger Code eine CUDA-Leistung auf Expertenniveau zu erreichen.Es hat im Rahmen der Entwicklung des Deep Learning sowohl im Ausland als auch im Inland viel Aufmerksamkeit erregt.

Wird verwendet, um ein Blockprogramm anzugeben und es in effizienten GPU-Code zu kompilieren

Seit seiner Open-Source-Veröffentlichung im Jahr 2021Triton ist für seine herausragende Leistung und Flexibilität bekannt.Es hat schnell große Aufmerksamkeit und Anwendung auf der ganzen Welt gefunden. Es wird nicht nur in zahlreichen Open-Source-Projekten wie PyTorch, Unsloth, FlagGems usw. verwendet, sondern hat auch starke Unterstützung von Chip-Giganten wie NVIDIA, AMD, Intel und Qualcomm erhalten.

Darüber hinaus haben führende KI-Unternehmen wie Google, Microsoft, OpenAI, AWS und Meta Triton als Schlüsseltechnologie für den Aufbau offener KI-Software-Stacks verwendet. Triton wird allmählich zu einer neuen Option für KI-Compiler mit niedrigeren Einstiegshürden und höherer Verfügbarkeit.

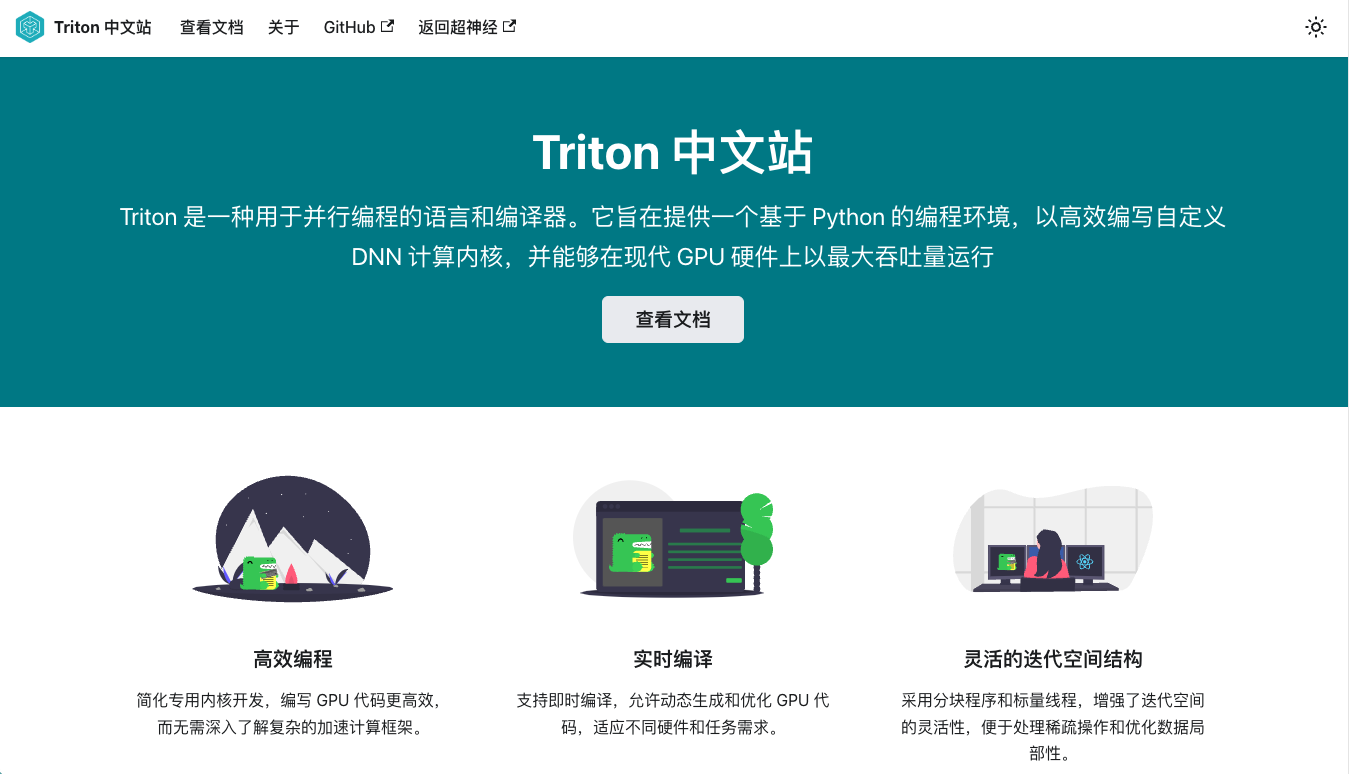

Die erste vollständige Version der chinesischen Triton-Dokumentation ist online

Obwohl Tritons Einfluss im globalen KI-Bereich schnell zunimmt,Allerdings sind Informationen und Ressourcen zu Triton im chinesischen Bereich relativ rar.Die Breite und Tiefe seiner Anwendung und Forschung muss erweitert werden. Auf dieser GrundlageFreiwillige der HyperAI-Community haben im Rahmen einer Open-Source-Kooperation drei Monate damit verbracht, die erste Übersetzung und das zweite Korrekturlesen einer strengen Prüfung zu unterziehen, um die Lokalisierung aller Triton-Dokumente abzuschließen. Es ist jetzt vollständig online. https://triton.hyper.ai/.

Die chinesische Dokumentation von Triton basiert auf der englischen Dokumentation und wurde an eine lokalisierte Struktur angepasst.Es entspricht eher den Lesegewohnheiten chinesischer Entwickler und bietet eine Reihe detaillierter und praktischer Anleitungen von der Triton-Installation bis zur Anwendungsentwicklung.

Triton | Mit diesem Dokument können Sie:

* Beginnen Sie mit Triton von Grund auf und verstehen Sie leicht die Kernkonzepte und Anwendungen

* Verschaffen Sie sich ein tiefes Verständnis der erweiterten Funktionen von Triton und erkunden Sie innovative Wege

* Praktische Probleme schnell erkennen und Lösungen zur Verbesserung der Effizienz finden

* Verfolgen Sie die neuesten Technologietrends von Triton und bleiben Sie über Technologie-Updates auf dem Laufenden

* Nehmen Sie an Community-Diskussionen zu chinesischen Dokumenten teil und arbeiten Sie mit, um ein technisches Ökosystem zu schaffen

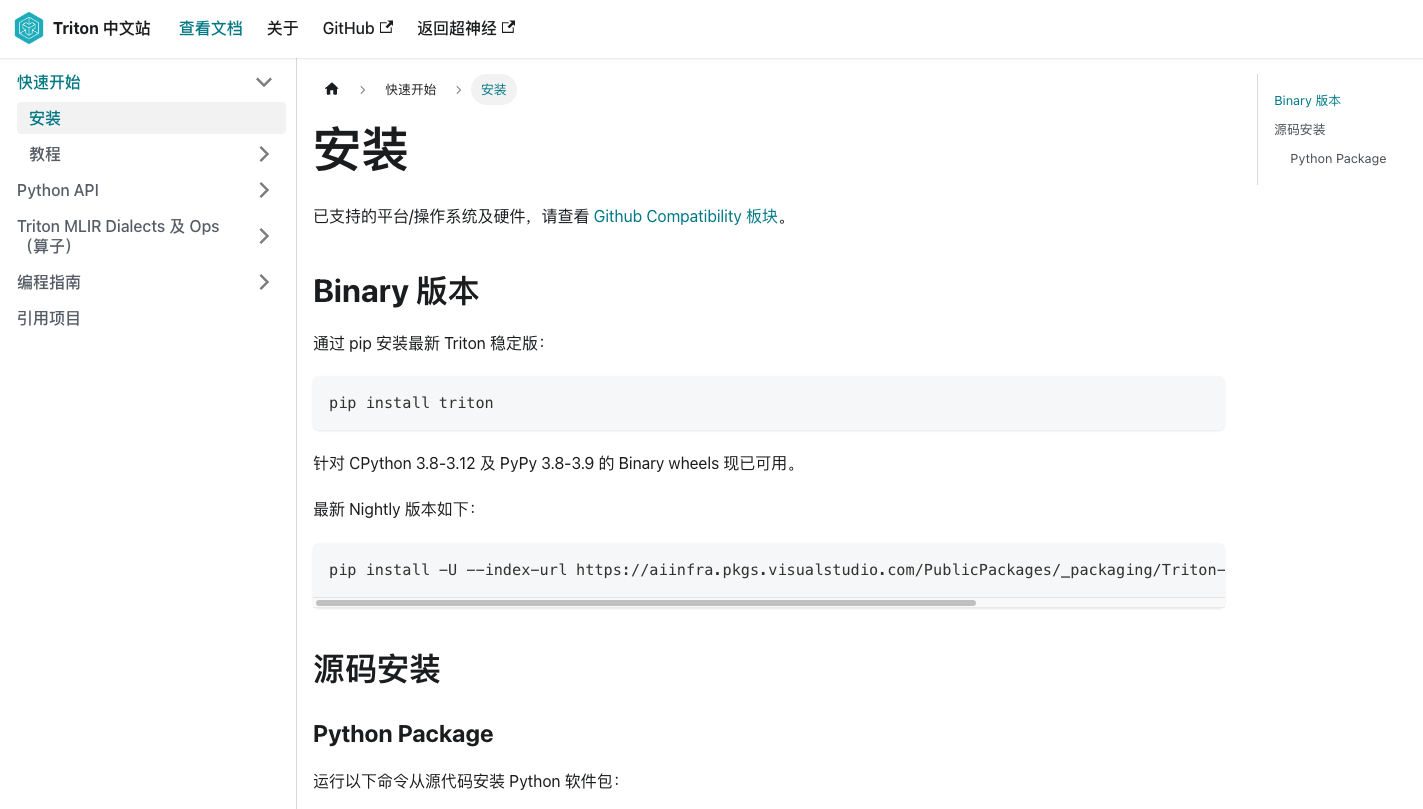

Installation über Pip und Quellcode

Der Abschnitt „Referenzprojekte“ des Dokuments sammelt einige Open-Source- und Closed-Source-Starprojekte, die Triton verwenden. Durch diese realen Fälle können Entwickler ein tieferes Verständnis für die Anwendung von Triton in tatsächlichen Projekten erlangen und seine Optimierungs- und Integrationstechniken beherrschen.

Von TVM zu Triton:

Aufbau einer vielfältigen und integrativen KI-Compiler-Community

Im Jahr 2022 veröffentlichte HyperAI die erste chinesische Dokumentation von Apache TVM in China (Klicken Sie hier, um den Originaltext anzuzeigen: Die chinesische TVM-Website ist offiziell gestartet! Das umfassendste „Nachschlagewerk“ zur Bereitstellung von Machine-Learning-Modellen finden Sie hier), da sich inländische Chips schnell weiterentwickeln, stellen wir inländischen Compiler-Ingenieuren die Infrastruktur zur Verfügung, um TVM zu verstehen und zu erlernen.Gleichzeitig haben wir uns mit Apache TVM PMC Dr. Feng Siyuan und anderen zusammengeschlossen, um die aktivste chinesische TVM-Community in China zu bilden.Durch Online- und Offline-Aktivitäten konnten wir die Teilnahme und Unterstützung der wichtigsten inländischen Chiphersteller gewinnen, darunter mehr als tausend Chipentwickler und Compiler-Ingenieure.

Adresse der chinesischen TVM-Dokumentation:

Zwei Jahre später hoffen wir, die technischen Grenzen und den inhaltlichen Umfang der Community weiter auszubauen und eine offenere, vielfältigere und integrativere KI-Compiler-Community aufzubauen.Zusätzlich zu Apache TVM nutzen wir aktiv alte Compilertechnologien wie LLVM und MLIR sowie verwandte Ingenieure und Projekte. Der Start der chinesischen Triton-Website zeigt auch unsere Entschlossenheit, den „Freundeskreis“ der KI-Compiler-Community zu erweitern.

Die chinesische Dokumentation für TVM und Triton wird noch aktualisiert. Als Infrastruktur ist die chinesische Dokumentation nur der erste Schritt beim Aufbau eines Ökosystems. Im Upstream des Ökosystems können wir auf die Entwicklungstools und Betriebssysteme rund um den KI-Compiler nicht verzichten. Im Downstream des Ökosystems kommen wir ohne Hardwarehersteller und Serviceprovider nicht aus. Nur durch den Aufbau einer Partnerschaft entlang der gesamten Lieferkette, bei der jedes Glied und die tatsächlichen Bedürfnisse jedes Partners miteinander verknüpft werden, Hürden abgebaut und ein Mehrwert für die Partner geschaffen wird, können wir mehr Möglichkeiten für einen gemeinsamen Fortschritt schaffen.

Wir freuen uns darauf, dass sich uns weitere Unternehmenspartner anschließen, um eine offenere, vielfältigere und integrativere KI-Compiler-Community aufzubauen!

Sehen Sie sich die vollständige chinesische Triton-Dokumentation an:https://triton.hyper.ai/

Auf GitHub 🌟 Triron Chinesisch:https://github.com/hyperai/triton-cn