Command Palette

Search for a command to run...

Online-Tutorial | LivePortrait Ermöglicht Eine Ultrarealistische Ausdrucksmigration Und Erweckt Virtuelle Idole Zum Leben!

In der Vergangenheit waren zum Erstellen dynamischer Videoeffekte mit einem einzigen Bild komplexe Animationstechniken und viel Handarbeit erforderlich.Insbesondere wenn es um die Steuerung von Details wie Augen und Lippen geht, ist es zeitaufwändig und schwierig, realistische Synchronisationseffekte zu erzielen.

In der neuesten Version vereinfacht LivePortrait diesen Vorgang erheblich durch Funktionen wie präzise Porträtbearbeitung und Videobearbeitung. Kreative können selbst subtile Bewegungen in Bildern präzise steuern und so hochwertige, detailreiche dynamische Videos erstellen. Dies bietet ihnen große Flexibilität und Komfort für Kreativität und Inhaltsproduktion.

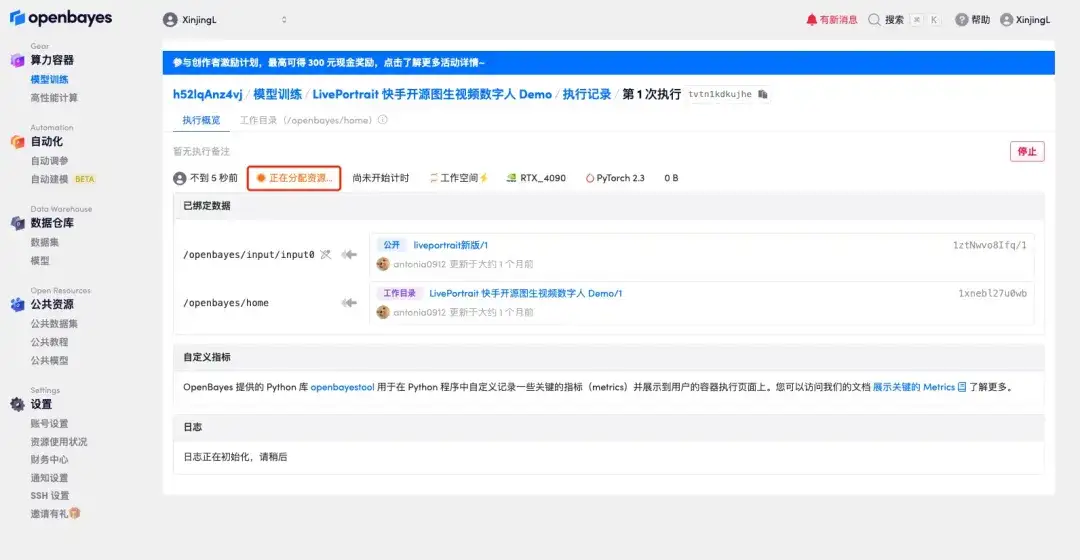

Der hyperneuronale Tutorialbereich von HyperAI ist jetzt mit „LivePortrait Kuaishou Open Source-bildgeneriertes Video Digital Human Demo“ online. Das Tutorial hat die Umgebung für alle eingerichtet. Es ist nicht erforderlich, Befehle einzugeben. Mit dem Ein-Klick-Klonen können Sie sofort loslegen!

Adresse des Tutorials:

Demolauf

Verwenden von LivePortrait zur Ausdrucksmigration

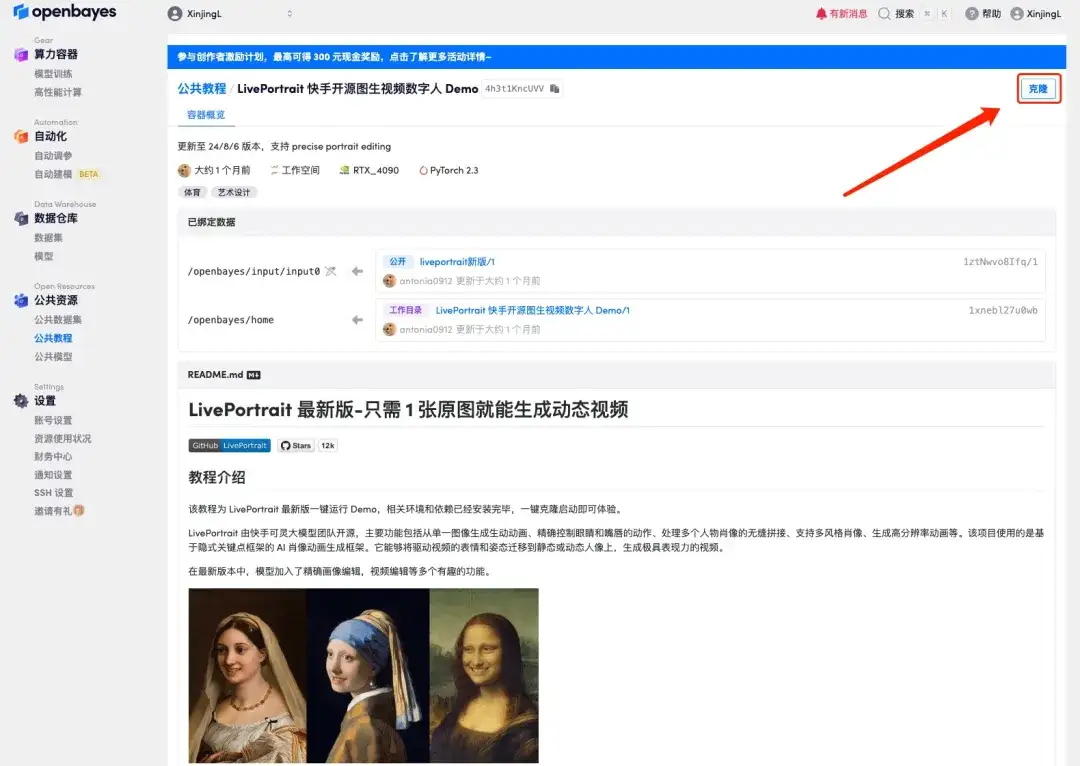

1. Melden Sie sich bei hyper.ai an, wählen Sie auf der Tutorial-Seite „LivePortrait Kuaishou Open Source Image-Based Video Digital Human Demo“ aus und klicken Sie auf „Dieses Tutorial online ausführen“.

2. Klicken Sie nach dem Seitensprung oben rechts auf „Klonen“, um das Tutorial in Ihren eigenen Container zu klonen.

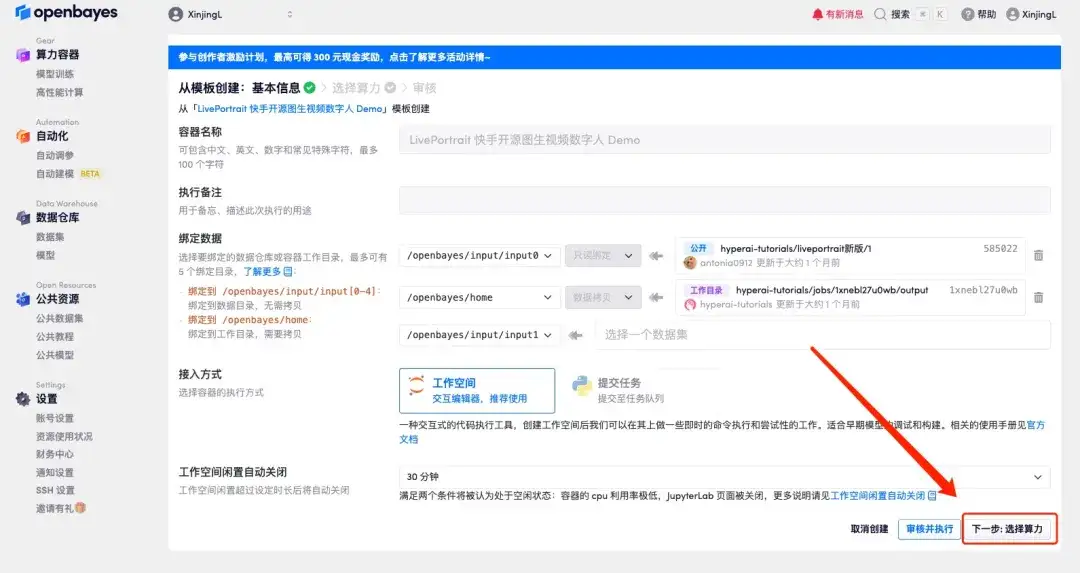

3. Klicken Sie unten rechts auf „Weiter: Hashrate auswählen“.

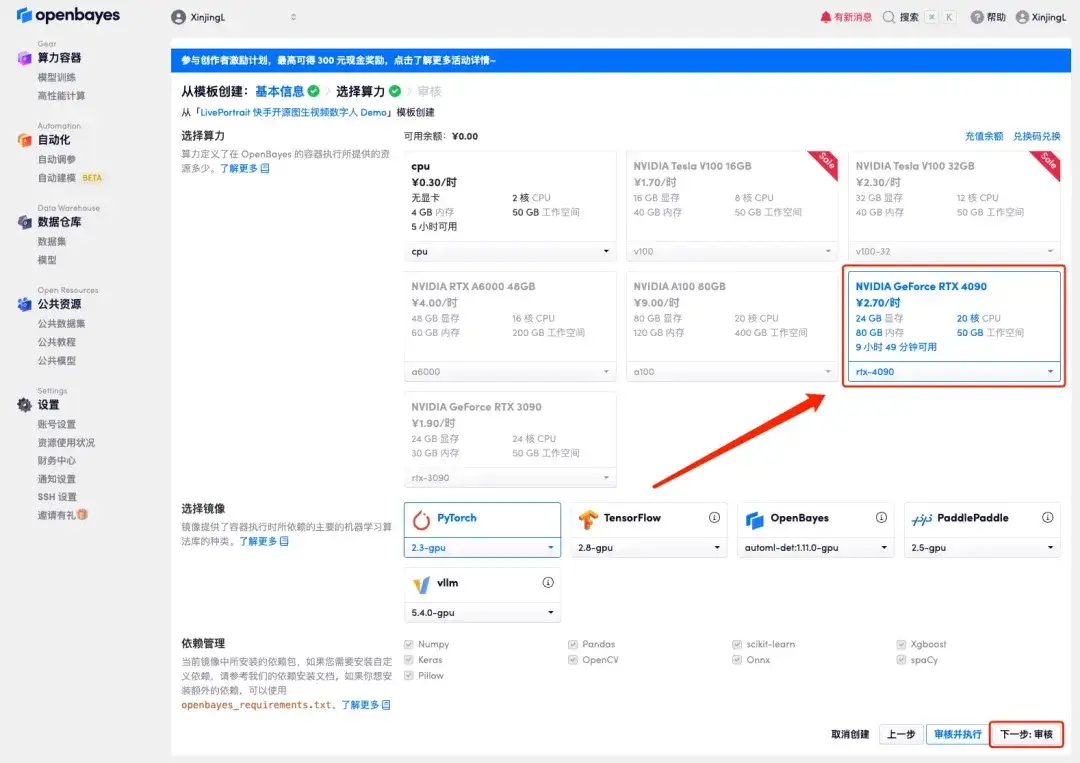

4. Wählen Sie nach dem Seitenwechsel das Bild „NVIDIA RTX 4090“ und „PyTorch“ aus und klicken Sie auf „Weiter: Überprüfen“.Neue Benutzer können sich über den unten stehenden Einladungslink registrieren, um 4 Stunden RTX 4090 + 5 Stunden CPU-freie Zeit zu erhalten!

Exklusiver Einladungslink von HyperAI (kopieren und im Browser öffnen):

https://openbayes.com/console/signup?r=Ada0322_QZy7

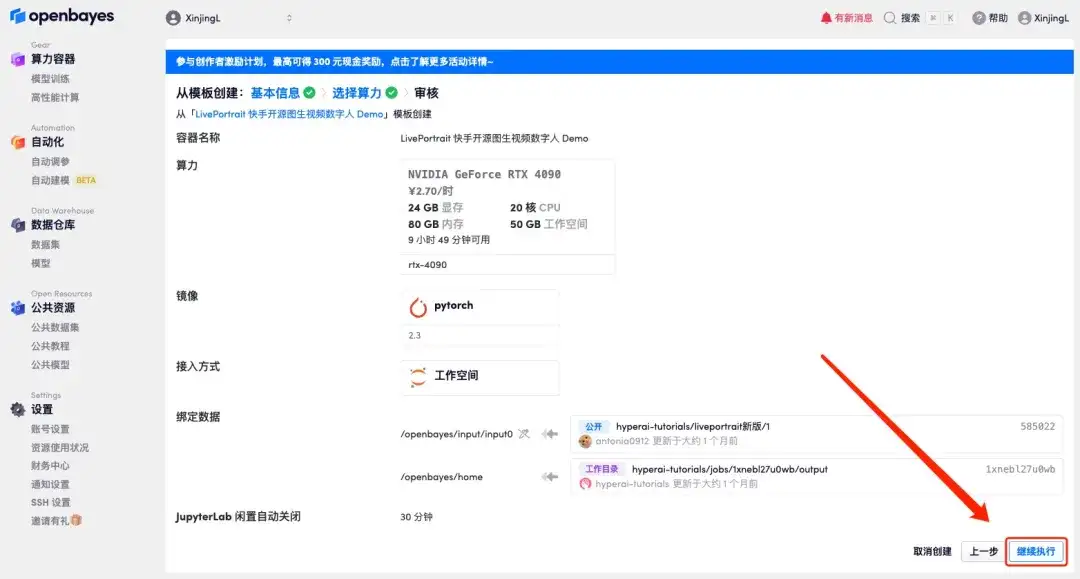

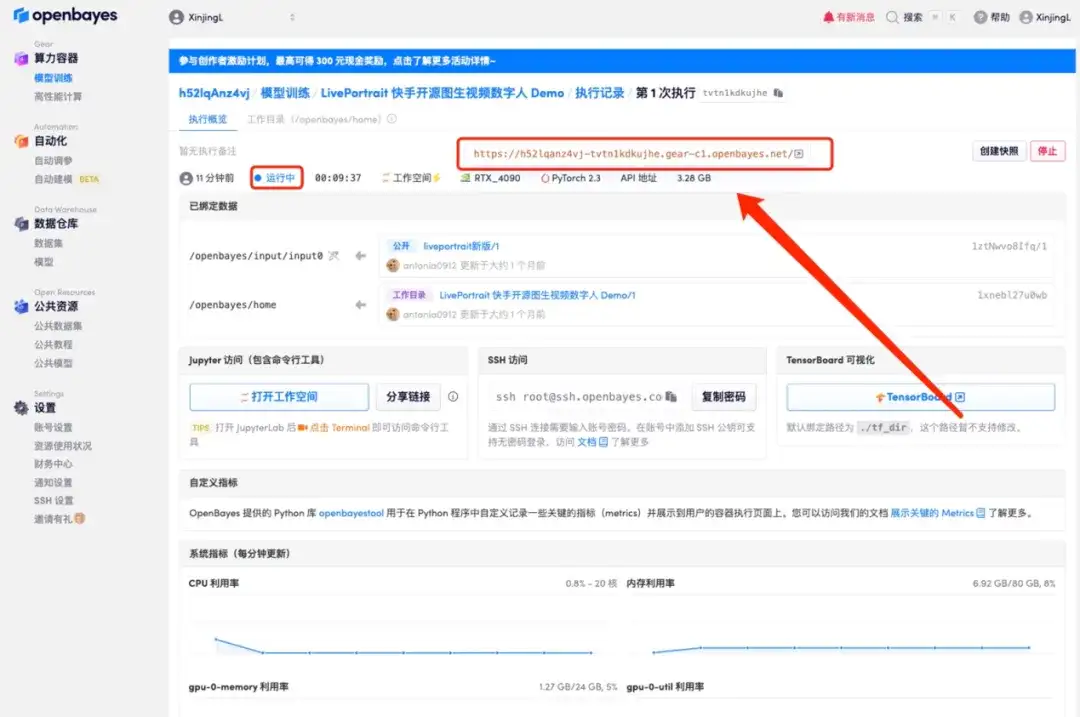

5. Klicken Sie nach der Bestätigung auf „Weiter“ und warten Sie, bis die Ressourcen zugewiesen wurden. Der erste Klonvorgang dauert etwa 1 Minute. Wenn sich der Status in „Läuft“ ändert, klicken Sie auf den Sprungpfeil neben „API-Adresse“, um zur Demoseite zu springen.Bitte beachten Sie, dass Benutzer vor der Verwendung der API-Adresszugriffsfunktion eine Echtnamenauthentifizierung durchführen müssen.

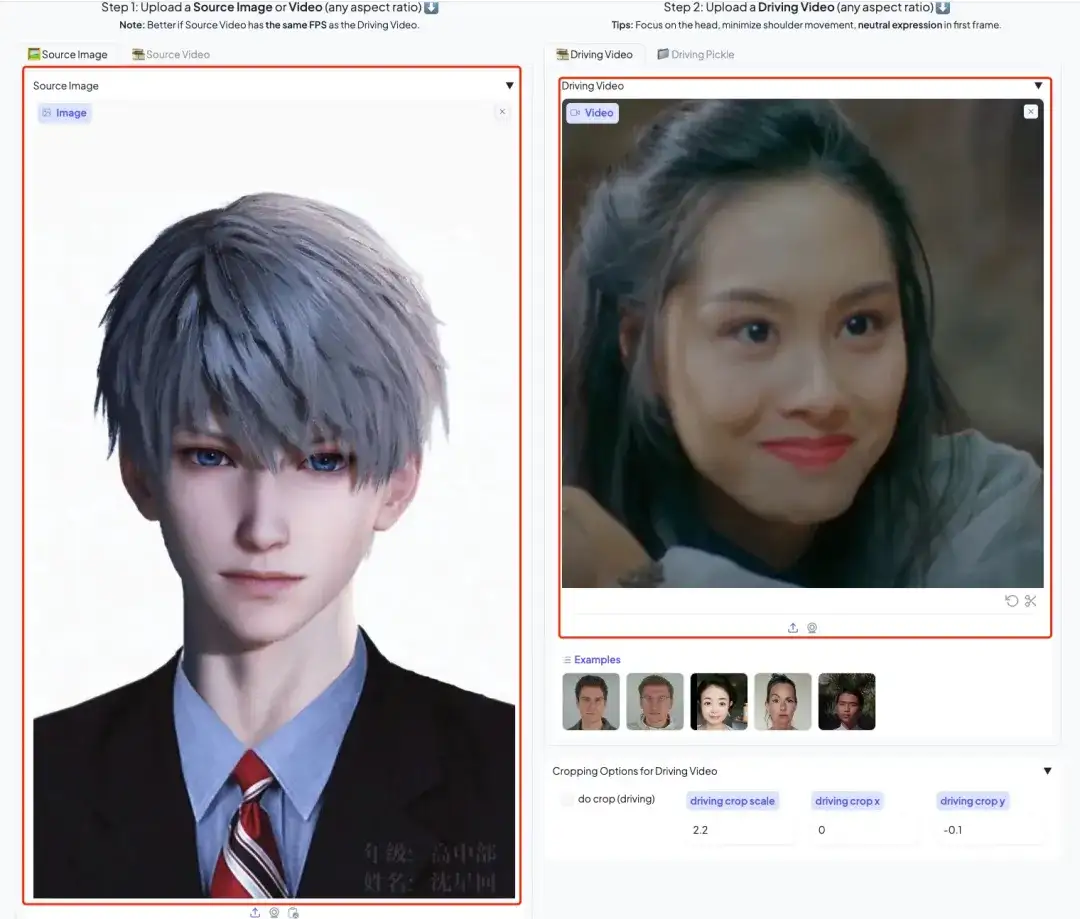

6. Laden Sie nach dem Öffnen der Demo das Bild und das Ausdrucksreferenzvideo hoch, klicken Sie auf „Animieren“ und warten Sie einen Moment, bis das Videoergebnis generiert wird. Dadurch wird ein Zwinkern erzeugt. Shen Xing antwortete ~

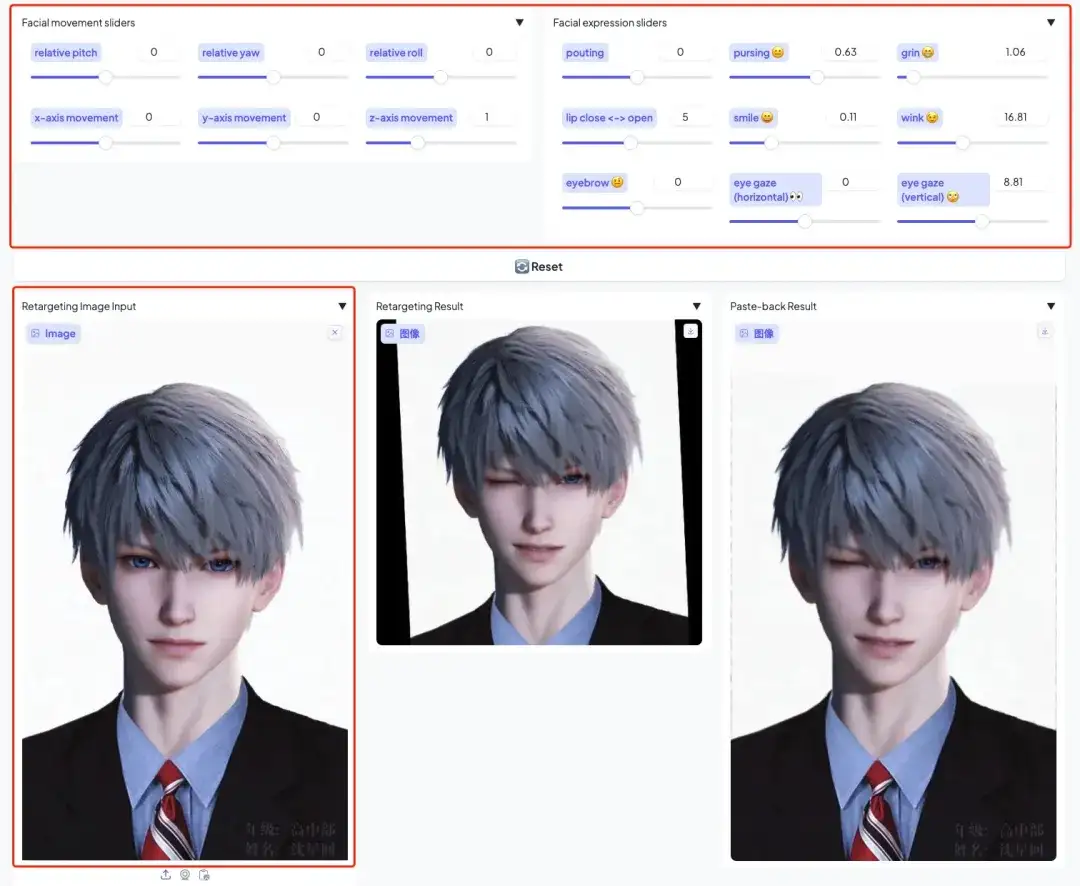

Benutzerdefinierte Ausdrucksverfeinerung

1. Laden Sie ein Bild im Modus „Präzise Porträtbearbeitung“ hoch und passen Sie Parameter wie Augen, Lächelgrad, Mundgröße usw. an. Sie können es entsprechend den hochgeladenen Bildern anpassen.

Wir haben eine „Stable Diffusion Tutorial Exchange Group“ eingerichtet. Willkommen, Freunde, treten Sie der Gruppe bei, um verschiedene technische Probleme zu diskutieren und Anwendungsergebnisse auszutauschen ~

Scannen Sie den unten stehenden QR-Code, um HyperaiXingXing zu WeChat hinzuzufügen (WeChat-ID: Hyperai01), und notieren Sie „SD Tutorial Exchange Group“, um dem Gruppenchat beizutreten.