Command Palette

Search for a command to run...

Großer Durchbruch Bei Optischen Chips Für Den Heimgebrauch! Das Tsinghua-Team Nutzt Ein Neuronales Netzwerk, Um Die Erste Vollständig Intelligente Optische Computer-Trainingsarchitektur Zu Erstellen

Seit 2012 hat sich die für das Training von KI-Modellen erforderliche Rechenleistung alle 3–4 Monate verdoppelt, und die für das Training von KI-Modellen erforderliche Rechenleistung hat sich jedes Jahr um das Zehnfache erhöht. Dies stellt eine Herausforderung dar:Wie machen wir KI schneller und effizienter? Die Antwort könnte in der Welt des Lichts liegen.

Optisches Rechnen,Ein Bereich voller Potenzial, der die Geschwindigkeit und Eigenschaften des Lichts nutzen will, um Anwendungen des maschinellen Lernens ein neues Maß an Geschwindigkeit und Energieeffizienz zu verleihen. Um dieses Ziel zu erreichen, müssen wir jedoch ein schwieriges Problem lösen: Wie können wir diese optischen Modelle effizient trainieren? In der Vergangenheit verließ man sich bei der Simulation und dem Training optischer Systeme auf digitale Computer. Die Möglichkeiten optischer Systeme waren jedoch aufgrund der präzisen Modelle und der großen Mengen an Trainingsdaten, die für die optischen Systeme erforderlich waren, stark eingeschränkt. Darüber hinaus wird es mit zunehmender Komplexität des Systems immer schwieriger, diese Modelle zu erstellen und zu warten.

Kürzlich,Das Forschungsteam unter der Leitung von Akademiemitglied Dai Qionghai und Professor Fang Lu von der Tsinghua-Universität nutzte die Symmetrie der Photonenausbreitung, indem es die Vorwärts- und Rückwärtsausbreitung beim Training neuronaler Netzwerke mit der Vorwärtsausbreitung von Licht gleichsetzte und eine Lernmethode im vollständigen Vorwärtsmodus (FFM) entwickelte.Durch FFM-Lernen können Forscher nicht nur tiefe optische neuronale Netzwerke (ONNs) mit Millionen von Parametern trainieren, sondern auch eine hochempfindliche Wahrnehmung und effiziente rein optische Verarbeitung erreichen und so die Einschränkungen der KI bei der Modellierung optischer Systeme verringern.

Die Forschungsarbeit mit dem Titel „Fully forward mode training for optical neural networks“ wurde erfolgreich im Top-Journal Nature veröffentlicht.

Forschungshighlights:

* Ermöglicht eine effiziente Parallelisierung von Machine-Learning-Operationen im Feld und lindert so die Einschränkungen der numerischen Modellierung

* Einführung modernster optischer Systeme für eine gegebene Netzwerkgröße. Das FFM-Lernen zeigte auch, dass das Training der tiefsten optischen neuronalen Netzwerke mit Millionen von Parametern eine mit idealen Modellen vergleichbare Genauigkeit erreichen kann.

* FFM-Lernen ermöglicht nicht nur einen um Größenordnungen schnelleren Lernprozess, sondern kann auch die Entwicklung von Deep-Learning-Neuralnetzen, supersensitiver Wahrnehmung und topologischer Photonik vorantreiben.

Papieradresse:

https://doi.org/10.1038/s41586-024-07687-4

Das Open-Source-Projekt „awesome-ai4s“ vereint mehr als 100 AI4S-Papierinterpretationen und stellt umfangreiche Datensätze und Tools bereit:

https://github.com/hyperai/awesome-ai4s

7 Aggregation großer Datensätze zur Erstellung komplexer Eingabefelder mit auf Null gesetzter Phase in mehrschichtigen Klassifizierungsexperimenten

In dieser Studie wurden insgesamt 7 Datensätze verwendet. In den mehrschichtigen Klassifizierungsexperimenten wurde jede Probe verwendet, um ein komplexes Eingabefeld mit der Phase Null zu erstellen:

* Der MNIST-Datensatz.Der Datensatz ist eine Sammlung handgeschriebener Ziffern in 10 Kategorien, bestehend aus 60.000 Trainingsbeispielen und 10.000 Testbeispielen.

* Fashion-MNIST-Datensatz.Der Datensatz enthält 10 verschiedene Kategorien von Modeprodukten und besteht außerdem aus einem Trainingssatz mit 60.000 Beispielen und einem Testsatz mit 10.000 Beispielen.

* CIFAR-10-Datensatz.Dieser Datensatz ist eine Teilmenge des Datensatzes mit 80 Millionen kleinen Bildern und enthält 50.000 Trainingsbilder und 10.000 Testbilder.

* ImageNet-Datensatz.Der Datensatz ist eine Bilddatenbank, die aus einer WordNet-Hierarchie besteht, in der jeder Knoten durch Hunderte bis Tausende von Bildern dargestellt wird, mit insgesamt 120 Millionen Bildern für das Training und 50.000 für Tests.

* MWD-Datensatz.Der Datensatz enthält Bilder von 4 verschiedenen Wetterbedingungen im Freien (Sonnenaufgang, sonnig, regnerisch und bewölkt). Es enthält insgesamt 1.125 Beispiele, von denen 800 zum Trainieren und 325 zum Testen verwendet werden.

* Datensatz zu IrisblütenDer Datensatz besteht aus 3 Irisarten mit jeweils 50 Proben. Jedes Originalbeispiel im Datensatz enthält vier Einträge, die die Form einer Irisblüte beschreiben. Im PIC-Experiment wurde jeder Eintrag repliziert, um vier identische Datenpunkte zu erstellen, was insgesamt 16 Kanäle mit Eingabedaten ergab.

* Chromium-Zieldatensatz.Der Datensatz besteht aus Glaschromplatten mit unterschiedlichen Bereichen (reflektierend und halbtransparent). Die Reflexbereiche stellten die physischen Szenen selbst dar (Buchstabenziele T, H und U), und während des Trainings wurde ein einzelner Reflexbereich verwendet und in derselben Ebene bewegt, um 9 verschiedene Trainingsszenen zu erzeugen.

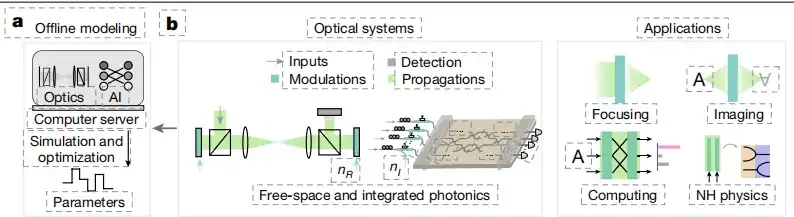

Reparametrisieren Sie das optische System und bauen Sie ein differenzierbares eingebettetes photonisches neuronales Netzwerk FFM auf

Traditionell wird künstliche Intelligenz im Bereich der Optik durch Offline-Modellierung und -Optimierung entwickelt, wie in Abbildung a unten dargestellt, was zu einer eingeschränkten Designeffizienz und Systemleistung führt. Darüber hinaus nutzen allgemeine optische Systeme zur Realisierung verschiedener Funktionen die Abstimmbarkeit des Brechungsindex.Das optische System ist in zwei verschiedene Bereiche unterteilt: Modulationsbereiche (dunkelgrün) und Ausbreitungsbereiche (hellgrün).Wie in Abbildung b unten gezeigt.

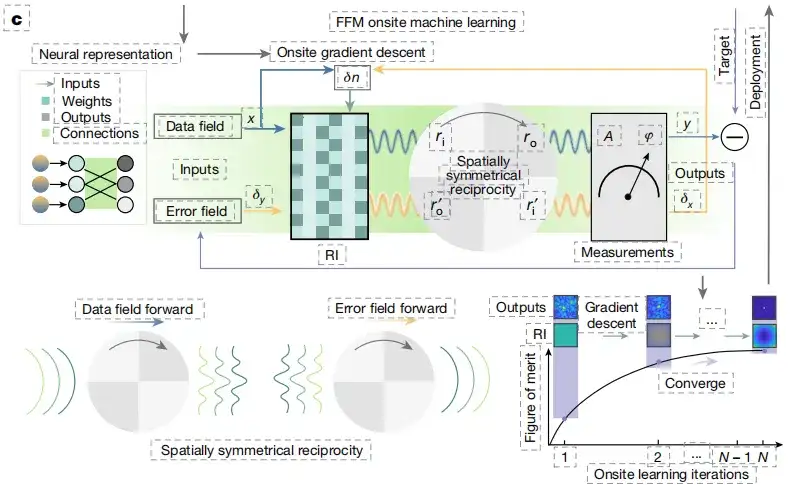

Die Studie ergab, dass optische Systeme, die durch die Maxwell-Gleichungen gesteuert werden, in differenzierbare eingebettete photonische neuronale Netzwerke umparametrisiert werden können und dass das Gradientenabstiegstraining neuronaler Netzwerke ein Schlüsselfaktor für ihre Entwicklung war. daher,Das maschinelle Lernprinzip von FFM in dieser Studie ist in Abbildung c unten dargestellt.Da Teile des optischen Systems in ein neuronales Netzwerk abgebildet und mit Neuronen verbunden werden können, kann vor Ort ein differenzierbares neuronales Netzwerk zwischen Eingabe und Ausgabe aufgebaut werden.

Als nächstes nutzte die Studie die räumliche Symmetriereziprozität, die gemeinsame physikalische Vorwärtsausbreitung und die Messung von Daten und Fehlerberechnungen und berechnete Gradienten vor Ort, um den Brechungsindex im Entwurfsbereich (oberer rechter und unterer linker Bereich in Abbildung c) zu aktualisieren. Durch Gradientenabstieg vor Ort konvergiert das optische System allmählich (unterer rechter Bereich in Abbildung c).

Durch das Training eines einschichtigen optischen neuronalen Netzwerks zur Objektklassifizierung erreicht FFM-Lernen eine vergleichbare Genauigkeit wie das ideale Modell

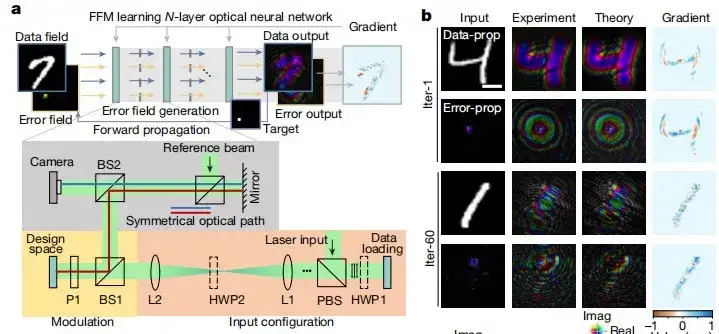

Um die Wirksamkeit des FFM-Lernens zu demonstrieren, trainierte die Studie zunächst ein einschichtiges optisches neuronales Netzwerk für die Objektklassifizierung mithilfe eines Benchmark-Datensatzes. Anschließend wurde in Abbildung 1a der Selbsttrainingsprozess des optischen neuronalen Netzwerks im tiefen freien Raum mithilfe von FFM-Lernen gezeigt und in Abbildung 1b wurden die Trainingsergebnisse auf dem MNIST-Datensatz visualisiert.

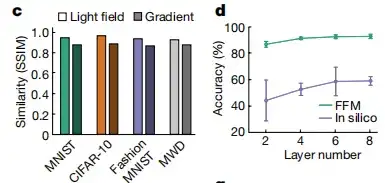

Wie in Abbildung c unten gezeigt,Der Strukturähnlichkeitsindex (SSIM) zwischen den experimentellen und theoretischen Lichtfeldern liegt über 0,97.Dies deutet auf eine hohe Ähnlichkeit hin. In Abbildung d unten analysierte die Studie weiter die Verwendung mehrschichtiger optischer neuronaler Netzwerke für die Klassifizierung des Fashion-MNIST-Datensatzes. Durch die schrittweise Erhöhung der Anzahl der Schichten von 2 auf 8 stellte die Studie fest, dass durch FFM-LernenDie Leistung des neuronalen Netzwerks kann auf 86,5%, 91,0%, 92,3% und 92,5% verbessert werden, was der Genauigkeit der theoretischen Computersimulation nahe kommt.

Basierend auf den obigen Ergebnissen schlug diese Studie außerdem nichtlineares FFM-Lernen vor, wie in Abbildung f unten dargestellt. Während der Datenausbreitung werden die Ausgänge vor dem Eintritt in die nächste Schicht nichtlinear aktiviert, sodass die Eingänge der nichtlinearen Aktivierung aufgezeichnet und die relevanten Gradienten berechnet werden können. Da nur eine Vorwärtsausbreitung erforderlich ist, ist das von FFM vorgeschlagene nichtlineare Trainingsparadigma auf allgemein messbare nichtlineare Funktionen anwendbar und daher auf optoelektronische und rein optische nichtlineare optische neuronale Netzwerke anwendbar. Nicht nur das,Die Klassifizierungsgenauigkeit des nichtlinearen optischen neuronalen Netzwerks stieg von 90,4% auf 93,0%.Wie in Abbildung g unten gezeigt.

FFM-Lernen vereinfacht den Entwurf komplexer photonischer Systeme und ermöglicht die rein optische Szenenrekonstruktion und Analyse dynamisch verborgener Objekte

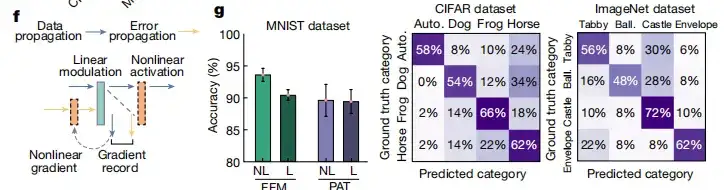

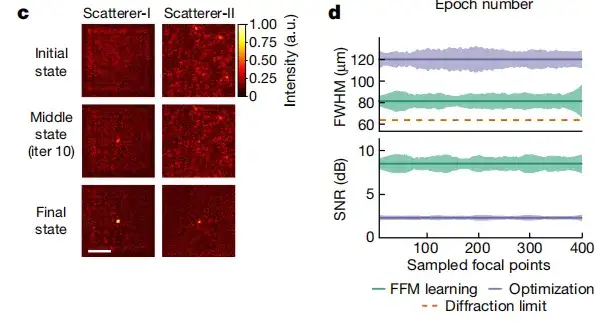

Die Studie ergab auch, dassFFM-Lernen überwindet die durch die Offline-numerische Modellierung bedingten Einschränkungen und vereinfacht den Entwurf komplexer photonischer Systeme.Beispielsweise zeigt die Studie in den Abbildungen a und b unten ein Punktscan-Streubildgebungssystem und analysiert verschiedene fortgeschrittene Optimierungsmethoden mithilfe der Partikelschwarmoptimierung (PSO). Die Ergebnisse zeigen, dass das gradientenbasierte FFM-Lernen eine höhere Effizienz aufweist und nach 25 Designiterationen in beiden Experimenten mit Konvergenzverlustwerten von 1,84 bzw. 2,07 bei den beiden Streutypen konvergiert. Im Gegensatz dazu erfordert die PSO-Methode mindestens 400 Designiterationen, um zu konvergieren, mit endgültigen Verlustwerten von 2,01 und 2,15.

Wie in Abbildung c unten dargestellt, analysierte die Studie die Entwicklung des FFM-Selbstdesigns und zeigte, dass das anfänglich zufällig verteilte Intensitätsprofil allmählich zu einem engen Punkt konvergiert. In Abbildung d unten wurden in der Studie außerdem die Messwerte für die Halbwertsbreite (FWHM) und das maximale Signal-Rausch-Verhältnis (PSNR) der Fokusoptimierung mithilfe von FFM und PSO verglichen. Bei Verwendung von FFM beträgt die durchschnittliche FWHM 81,2 μm und das durchschnittliche PSNR 8,46 dB.

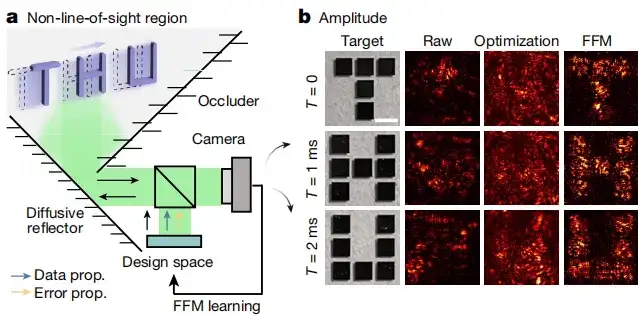

Die Studie ergab auch, dassIn-situ-FFM-Lernen ist ein wertvolles Werkzeug für die Entwicklung unkonventioneller Bildgebungsverfahren, insbesondere in Situationen, in denen eine genaue Modellierung nicht möglich ist.Wie etwa Non-Line-of-Sight-Missionen (NLOS) und andere Szenarien. Wie in Abbildung a unten dargestellt, ermöglicht FFM-Lernen eine rein optische Szenenrekonstruktion und Analyse dynamischer verborgener Objekte. Abbildung b unten zeigt die NLOS-Bildgebung. Die von FFM entworfene Wellenfront stellte die Formen aller drei Buchstaben wieder her und der strukturelle Ähnlichkeitsindex jedes Ziels erreichte 1,0.

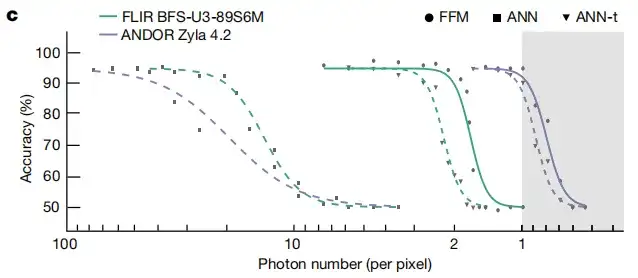

Zusätzlich zur dynamischen Bildgebungsfunktion ermöglicht der FFM-Lernansatz eine vollständige optische Klassifizierung verborgener Objekte in NLOS-Regionen. In dieser Studie wurde die Klassifizierungsleistung von FFM mit der eines künstlichen neuronalen Netzwerks (KNN) verglichen. Das Ergebnis ist in Abbildung c unten dargestellt.Bei ausreichend Photonen weisen FFM und ANN eine ähnliche Leistung auf, aber FFM benötigt weniger Photonen für eine genaue Klassifizierung.

Das FFM-Lernen kann auf den Selbstentwurf integrierter photonischer Systeme erweitert werden. Die Konvergenz der Simulation dauert etwa 100 Zyklen.

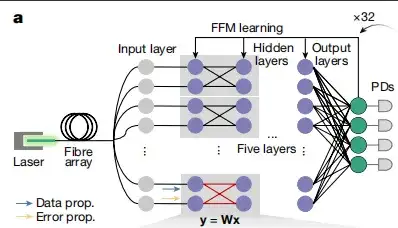

Die Studie ergab, dass die FFM-Lernmethode auf den Selbstentwurf integrierter photonischer Systeme erweitert werden kann. Wie in Abbildung a unten dargestellt, verwendet diese Studie ein integriertes neuronales Netzwerk, das aus symmetrischen photonischen Kernen besteht, die in Reihe und parallel geschaltet sind, um FFM-Lernen zu erreichen. Es wird gezeigt, dass die Symmetrie der Matrizen es ermöglicht, dass die Fehlerausbreitungsmatrix und die Datenausbreitungsmatrix gleichwertig sind.

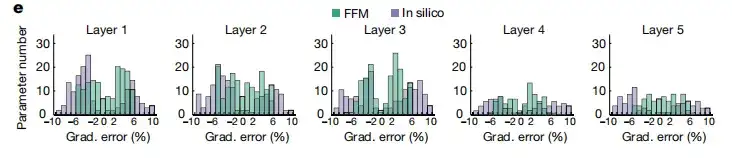

Abbildung e unten visualisiert den Fehler des gesamten neuronalen Netzwerks. Die Ergebnisse zeigen, dass bei der 80. IterationBeim FFM-Lernen treten geringere Gradientenfehler auf als beim Computersimulationstraining.

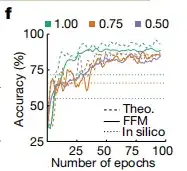

Bei der Entwicklung der Designgenauigkeit, wie in Abbildung f unten dargestellt,Sowohl die ideale Simulation als auch das FFM-Experiment benötigen etwa 100 Zyklen zum Konvergieren, aber die FFM-Methode weist die höchste Genauigkeit auf.

Die Industriekette für intelligente optische Computer ist allmählich gereift und steht möglicherweise an der Schwelle zu einer neuen Ära

Es ist erwähnenswert, dass basierend auf den Forschungsergebnissen dieses Papiers,Das Forschungsteam brachte den optischen Trainingschip „Tai Chi-II“ auf den Markt.Die Entwicklung von „Tai Chi-II“ dauerte nur 4 Monate nach der vorherigen Generation von „Tai Chi“ und die entsprechenden Ergebnisse wurden auch in Science veröffentlicht. Die experimentellen Ergebnisse der Arbeit zeigen, dassTai Chi ist 1.000-mal energieeffizienter als Nvidias H100.Diese leistungsstarke Rechenleistung basiert auf der verteilten, breit angelegten intelligenten optischen Rechenarchitektur, die vom Forschungsteam entwickelt wurde.

Link zum Artikel:

https://www.science.org/doi/10.1126/science.adl1203

Mit der Einführung neuer Produkte der Taichi-Serie sorgt intelligente optische Computertechnik erneut für Furore in der Branche.Doch aus praktischer Sicht – sei es bei der physischen Hardware, der Softwareentwicklung oder der Anwendung – muss die intelligente optische Datenverarbeitung noch weiter optimiert und erforscht werden. Tatsächlich ist das Forschungssystem des intelligenten optischen Rechnens immer ausgereifter geworden. Zahlreiche Institutionen und Universitäten wie die Peking-Universität, die Zhejiang-Universität und die Huazhong-Universität für Wissenschaft und Technologie waren daran beteiligt und der damit verbundene akademische Austausch hat immer häufiger stattgefunden. Hinsichtlich der konkreten Anwendungsrichtungen setzen die von Spitzenpersönlichkeiten verschiedener Universitäten repräsentierten Forschungsteams jedoch unterschiedliche Schwerpunkte. Zum Beispiel:

* Team des Akademikers Dai Qionghai von der Tsinghua-Universität:Dieses Team ist der Autor dieses Dokuments. Der von ihnen entwickelte optoelektronische KI-Fusionschip der nächsten Generation hat Experimente in Anwendungsszenarien wie intelligenter Bilderkennung, Verkehrsszenen und Gesichtserkennung abgeschlossen. Es wird berichtet, dass die Forschungsergebnisse des Teams bei gleicher Genauigkeit die Rechenleistung bestehender GPUs um das 3.000-fache und die Energieeffizienz um das 4-Millionen-fache gesteigert haben und voraussichtlich traditionelle Computerkonzepte in Bereichen wie autonomes Fahren, Robotersehen und mobile Geräte auf den Kopf stellen werden.

* Dong Jianjis Team von der Huazhong University of Science and Technology:Der vom Team entwickelte optoelektronische Hybridchip hat die Anwendung der menschlichen Ausdruckserkennung vervollständigt.

* Xu Shaofus Team von der Shanghai Jiao Tong University:Die vom Team entwickelte Reihe optoelektronischer Fusionschips wurde in der künstlichen Intelligenz, der Signalverarbeitung und anderen Bereichen eingesetzt und hat Computerexperimente in der medizinischen Bildrekonstruktion und anderen Bereichen abgeschlossen.

Die gute Nachricht ist, dass die Entwicklung intelligenter optischer Computerchips in meinem Land dank der unermüdlichen Anstrengungen der Forscher im Wesentlichen mit der anderer Länder vergleichbar ist. In den letzten fünf Jahren ist die Zahl der im Bereich der optischen Datenverarbeitung tätigen Unternehmen weltweit rasant von einigen wenigen auf Dutzende gestiegen. Im Ausland sind Luminous Computing, das sich dem Bau des weltweit führenden Supercomputers für künstliche Intelligenz verschrieben hat, und Lightmatter, das photonische Technologie nutzt, um die Leistung und Energieeinsparung von KI- und Hochleistungsrechner-Workloads zu verbessern. Beide Unternehmen haben Finanzierungen in Höhe von mehr als 100 Millionen US-Dollar erhalten.

In China haben sich die von Xizhi Technology und Photonic Arithmetic vertretenen Unternehmen ebenfalls dem internationalen Wettbewerb der optischen Computerindustrie angeschlossen.Diese Start-ups konzentrieren sich alle auf optisches Computing, insbesondere auf optische Rechenbeschleuniger auf Basis optischer Chips, und betreiben außerdem unterstützende Forschung und Entwicklung von Software, Systemen und Hauptmaschinen. Kurz gesagt, die optische Computerindustriekette meines Landes ist allmählich ausgereift und das entsprechende Industrie-Universitäts-Forschungssystem funktioniert effektiv und effizient. Wir erwarten außerdem, dass intelligente optische Computer in diesem neuen Zeitalter der Entwicklung der digitalen Wirtschaft und neuer Produktivität einen starken Impuls verleihen können.