Command Palette

Search for a command to run...

Das Ministerium Für Wissenschaft Und Technologie Ergreift Maßnahmen! Das AIGC-Benutzerhandbuch Für Forscher Ist Da, Und Die Akademische Gemeinschaft Beginnt, Sich Vor KI-Bewaffneten Zu Schützen

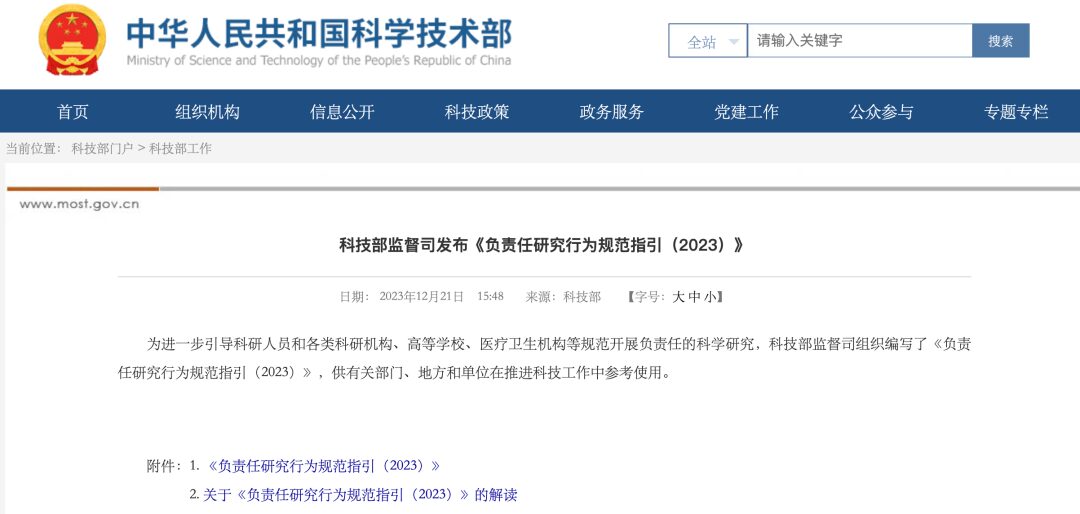

Die Aufsichtsabteilung des Ministeriums für Wissenschaft und Technologie hat die „Richtlinien für verantwortungsvolles Forschungsverhalten (2023)“ herausgegeben, die klare rote Linien für brisante Themen von Belang für die Gesellschaft ziehen, wie etwa künstliche Intelligenz und die Veröffentlichung wichtiger Ergebnisse.

Fälschung von Versuchsdaten, Fälschung von Versuchsbildern, unzulässige Unterschriften auf Arbeiten, Plagiat beim Verfassen von Lehrbüchern ... Am Nachmittag des 16. Januar reichten 11 Studenten der Huazhong Agricultural University mit einem 125-seitigen Bericht Beschwerde ein, in dem sie Professor Huang von der Universität angaben, sich akademischen Fehlverhaltens schuldig gemacht zu haben. Eine Zeit lang gärte die öffentliche Meinung schnell, und entsprechende Inhalte wie „auf die eigene Zukunft setzen, um die akademische Unschuld zu verteidigen“ und „Jeder ist ein Opfer von akademischem Betrug“ lösten auf den großen Plattformen hitzige Diskussionen aus.

Einige Internetnutzer brachten dies mit der vorherigen betrügerischen Abhandlung über die Alzheimer-Krankheit in Verbindung. Dieser über 2.300 Mal zitierte Nature-Artikel hat die weltweite Alzheimerforschung 16 Jahre lang in die Irre geführt.

Wenn Sie sich auf die Suche nach der Wahrheit konzentrieren, wird Ihre Kunst nicht perfekt sein. In den vergangenen hundert Jahren waren der Geist akademischer Integrität und der erhabene Glaube, der Menschheit zu nützen, für die Studenten das richtungsweisende Licht, um auf dem Weg der wissenschaftlichen Forschung weiter voranzukommen. Allerdings mischen sich damit zunehmend die Verlockungen von Ruhm und Reichtum, und es kommt zu akademischem Betrug, der trotz wiederholter Verbote nicht gestoppt werden kann. Insbesondere mit der rasanten Entwicklung von Technologien wie KI und großen Modellen sind neue Technologien zu „Komplizen“ des Betrugs in der wissenschaftlichen Forschung geworden. Dies ist nicht nur unfair gegenüber den Forschern, die auf ihren Studien bestehen, sondern falsche Forschungsdaten können auch schwerwiegende Folgen haben.

Daher ist es neben der strengen Untersuchung von akademischem Betrug auch sehr wichtig, die Anwendung von Technologien wie KI in der wissenschaftlichen Forschung zu regulieren.

Setzen Sie klare Grenzen und nutzen Sie generative künstliche Intelligenz sinnvoll und regelkonform.

Der Betrug an wissenschaftlichen Arbeiten hat eine lange Geschichte. Neben herkömmlichen Methoden wie Plagiaten und der Fälschung von Daten ist es auch üblich, Autoren zu bezahlen, „Papierfabriken“ mit dem Schreiben zu beauftragen und Aufsätze zu fälschen.

Heutzutage ist die generative künstliche Intelligenz-Technologie, vertreten durch ChatGPT (AIGC) kam aus dem Nichts und bot den Menschen neue Helfer beim Schreiben von Arbeiten. Von der Themenauswahl bis zur Manuskriptoptimierung, von der statistischen Analyse bis zur Diagrammerstellung – seine leistungsstarken Funktionen decken nahezu jeden Aspekt des wissenschaftlichen Verfassens von Arbeiten ab und können wissenschaftlichen Forschern tatsächlich dabei helfen, Literaturrecherche, Datenverarbeitung, Übersetzungsoptimierung und andere Aufgaben schnell abzuschließen.

Aber alles hat zwei Seiten. Wenn Forscher die vom AIGC erstellten Texte als ihre eigenen Schöpfungen betrachten, entsteht weitgehend eine wertlose „akademische Blase“. Darüber hinaus wird die Glaubwürdigkeit der wissenschaftlichen Forschung erheblich beeinträchtigt, wenn man sich zu sehr darauf verlässt, dass die Forschungsergebnisse des AIGC unzuverlässig sind.

21. Dezember 2023Die Aufsichtsabteilung des Ministeriums für Wissenschaft und Technologie hat die „Richtlinien für verantwortungsvolles Forschungsverhalten (2023)“ herausgegeben (im Folgenden „Richtlinien》),Für brisante Themen von öffentlichem Interesse wie künstliche Intelligenz und die Veröffentlichung großer Errungenschaften wurden klare rote Linien gezogen.

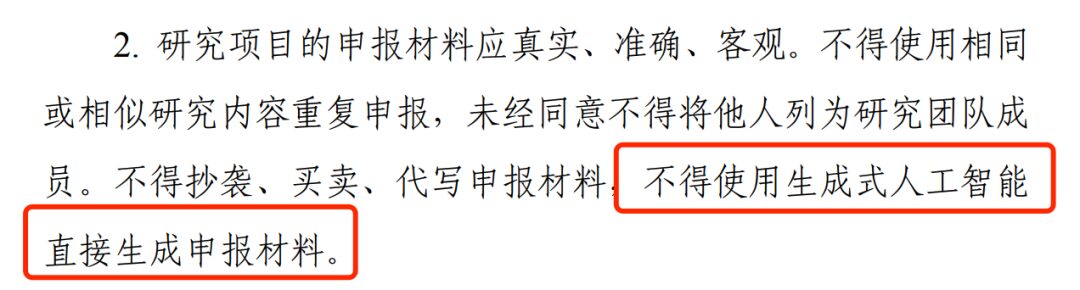

Im Abschnitt zur Auswahl und Durchführung von Forschungsthemen weisen die „Richtlinien“ darauf hin, dass die von wissenschaftlichen Forschern eingereichten Bewerbungsunterlagen für Forschungsprojekte wahrheitsgemäß, genau und objektiv sein sollten. Die wiederholte Einreichung gleicher oder ähnlicher Forschungsinhalte ist nicht gestattet und es dürfen keine anderen Personen ohne deren Zustimmung als Mitglieder des Forschungsteams aufgeführt werden. Es ist Ihnen nicht gestattet, Bewerbungsunterlagen zu plagiieren, zu kaufen oder zu verkaufen oder im Auftrag anderer zu verfassen.Generative Künstliche Intelligenz darf nicht zur direkten Erstellung von Bewerbungsunterlagen eingesetzt werden.

Wir sollten die relevanten Gesetze, Vorschriften und akademischen Normen einhalten und generative künstliche Intelligenz sinnvoll einsetzen, um Texte, Daten oder akademische Bilder gemäß den Vorschriften zu verarbeiten und so Risiken wie Fälschung und Manipulation von Daten vorzubeugen.

Auch hinsichtlich der Literaturzitate schreiben die „Guidelines“ klar vor, dass mittels generativer künstlicher Intelligenz erstellte Inhalte, insbesondere solche mit zentralen Inhalten wie Fakten und Meinungen, deutlich gekennzeichnet und der Generierungsprozess erläutert werden müssen, um Authentizität und Genauigkeit sowie die Achtung der geistigen Eigentumsrechte Dritter zu gewährleisten. Inhalte, die von anderen Autoren als KI-generiert gekennzeichnet sind, sollten grundsätzlich nicht als Originaldokumente zitiert werden. Wenn sie zitiert werden müssen, sollte dies angegeben werden.Ungeprüfte, durch generative KI erzeugte Referenzen dürfen nicht direkt verwendet werden.

Die „Guidelines“ klären die Grenzen des sinnvollen Einsatzes generativer KI hinsichtlich Forschungsdurchführung, Datenmanagement, Autorenschaft und Veröffentlichung von Ergebnissen sowie Literaturzitaten. Sie sind von großer Bedeutung für den Schutz der Glaubwürdigkeit und der ethischen Grundsätze der wissenschaftlichen Forschung und tragen dazu bei, den verantwortungslosen Einsatz generativer KI und verwandter Technologien zu verhindern.

Namhafte in- und ausländische Zeitschriften regulieren KI-generierte Artikel

Der Betrug bei wissenschaftlichen Arbeiten ist ein weltweites Problem. Das Aufkommen generativer KI hat die Betrugsschwelle bis zu einem gewissen Grad gesenkt. Die Fähigkeit von Chatbots wie ChatGPT, „ernsthaft Lügen zu erzählen und sich zu rechtfertigen“, hat diesen Menschen Komfort geboten. Da jedoch die Grenzen der Nutzung von AIGC immer deutlicher werden und die gesetzlichen Regelungen klarer werden, haben immer mehr akademische Einrichtungen im In- und Ausland einen Konsens erzielt und begonnen, sich mit der Nutzung von KI auseinanderzusetzen und diese zu regulieren.

Viele inländische Zeitschriften haben Erklärungen abgegeben, in denen sie die verschiedenen Möglichkeiten einschränken, wie Autoren beim Schreiben ihrer Artikel KI einsetzen können. Zeitschriften wie „Journal of Jinan University“, „Journal of Documentation and Data“, „China Science and Technology Journal Research“, „Think Tank Theory and Practice“ und „Library and Information Work“ haben allesamt Erklärungen veröffentlicht, in denen es heißt:Wenn der Hauptinhalt der Arbeit mithilfe von KI-Tools erstellt wurde, wird dies, sobald es entdeckt wird, als akademisches Fehlverhalten behandelt.

Auch ausländische wissenschaftliche Zeitschriften haben begonnen, die Anwendung von KI beim Verfassen von Artikeln zu regulieren. Laut unvollständigen Statistiken berichten Nature, Cell, The Lancet, JAMATop-Zeitschriften wie das Journal of the American Medical Association haben Erklärungen veröffentlicht, in denen es heißt:Künstliche Intelligenz berechtigt nicht zur Urheberschaft und Forscher, die KI verwenden, sollten dies in ihren Manuskripten angeben.

Mit KI KI besiegen und die „Bewaffneten“ der Zeitung entlarven

Um die gute Entwicklung der KI zu fördern, müssen wir wirksame technische Mittel einsetzen. Es ist anzumerken, dass KI-generierte Dokumente beim aktuellen Stand der Technik in ihrer Form den Originaldokumenten ähneln und herkömmliche Tools zum Vergleichen von Textähnlichkeiten diese möglicherweise nicht genau erkennen können. Daher erforschen sowohl inländische als auch ausländische Forscher die Entwicklung von Erkennungstools speziell für AIGC.

„Die Kernidee des KI-generierten Inhaltsidentifizierers besteht darin, zunächst einen Trainingsdatensatz zu erstellen, der echte Inhalte und KI-generierte Inhalte enthält, und dann einen Klassifikator zu trainieren, um zwischen diesen beiden Inhaltstypen zu unterscheiden“, erklärte Tang Jian, ein bekannter chinesischer Wissenschaftler am MILA Research Institute, in einem Interview mit den Medien.

Konkret funktionieren KI-Sprachmodelle, indem sie jeweils ein Wort vorhersagen und generieren. Nach der Generierung eines Wortes unterteilt der Wasserzeichenalgorithmus das Vokabular des Sprachmodells zufällig in eine „grüne Liste“ und eine „rote Liste“ und fordert das Modell dann auf, Wörter auf der „grünen Liste“ auszuwählen. Je mehr grün gelistete Wörter ein Artikel enthält, desto wahrscheinlicher ist es, dass der Text maschinell erstellt wurde. Von Menschen geschriebene Texte enthalten tendenziell mehr zufällige Wortkombinationen.

Einfach ausgedrückt:Die AIGC-Erkennungstechnologie nutzt KI, um KI zu besiegen.Auf der Grundlage riesiger Mengen an Text- und Datenproben können wir die Unterschiede zwischen Menschen und AIGC-Tools hinsichtlich der durchschnittlichen Satzlänge, der Wortschatzvielfalt und der Textlänge ermitteln und so die „Schützen“ der KI-Dokumente identifizieren.

Dahinter stecken allerdings einige technische Schwierigkeiten. Beispielsweise wird das Sprachmodell mit von Menschen erstelltem Text trainiert. Je größer die Anzahl der Parameter, desto näher kommt es der menschlichen Schöpfung und desto schwieriger ist die Unterscheidung. Darüber hinaus wird die Erkennung auch durch die Länge des Textes eingeschränkt. Die Genauigkeit der Erkennung kann nur gewährleistet werden, wenn der Text lang genug ist.

Sinnvoller Einsatz von KI in der wissenschaftlichen Forschung, das Kind nicht mit dem Bade ausschütten

KI für die Wissenschaft Die erfolgreiche Anwendung von hat wissenschaftliche Forscher bis zu einem gewissen Grad von der Arbeit der Text- und Datenverarbeitung „erlöst“, sodass sie sich stärker auf die Forschung selbst konzentrieren können, was die Effizienz verbessern und den Fortschritt der wissenschaftlichen Forschung bis zu einem gewissen Grad beschleunigen kann. Darüber hinaus steht die künstliche Intelligenz auch der Erforschung einiger tiefgründiger und komplexer wissenschaftlicher Forschungsinhalte in nichts nach.

So haben beispielsweise die Vorhersagemodelle, die in den letzten Jahren in der medizinischen Forschung große Beachtung gefunden haben, bei manchen neuen Forschern für Verwirrung gesorgt. KI kann schrittweise Ideen und Methoden entwickeln, die Forschern helfen, schnell ein qualifiziertes Modell zu erstellen.

Beispielsweise kann KI im Hinblick auf die Versuchsplanung und -optimierung detaillierte Versuchspläne erstellen, indem sie einfach Informationen wie Zweck, Methoden und Materialien des Versuchs bereitstellt. Dies hilft wissenschaftlichen Forschern dabei, bestehende Pläne auszuwerten und zu optimieren und die Versuchskosten zu senken.

Abschließend,Wir sollten keine Angst vor generativer künstlicher Intelligenz haben, sondern sie regulieren und lenken, damit sie der wissenschaftlichen Forschung in die richtigen Bahnen lenken kann.Für wissenschaftliche Forscher ist es notwendig, die KI-Technologie sinnvoll einzusetzen und ihre Vorteile auszunutzen, um wissenschaftliche Forschungen und das Verfassen von Artikeln effizient und präzise durchzuführen. Allerdings müssen alle Meinungen und Daten vom Autor überprüft werden, um falsche und erfundene Schlussfolgerungen zur generativen KI zu vermeiden und die Würde der Wissenschaft zu wahren.

Tatsächlich ist dies genau die ursprüngliche Absicht von „AI for Science“, nämlich die Nutzung von KI zur Umgestaltung und Erneuerung traditioneller wissenschaftlicher Forschungsparadigmen.Heute hat AI for Science in vielen Bereichen wie Biomedizin, Materialchemie, Mathematik, Physik usw. Fortschritte erzielt und eine Reihe wichtiger Ergebnisse mit praktischem Anwendungswert hervorgebracht. Viele Forscher nehmen jedoch noch eine abwartende Haltung ein. Einerseits mangelt es möglicherweise an niedrigschwelligen KI-Tools in ihren Bereichen; Andererseits haben sie möglicherweise noch nicht die Schnittstelle zwischen KI und ihren Forschungsfeldern gefunden.

Die Erkundungsreise der KI für die Wissenschaft hat gerade erst begonnen. Nur wenn wissenschaftliche Forschung und KI Hand in Hand gehen, können wir universellere Werkzeuge und Methoden schaffen.