Command Palette

Search for a command to run...

Veranstaltungsvorschau | Für 2023 Ist Das Treffen Mit TVM · Shenzhen Station geplant. Wir Laden Sie Ein, Uns Auf Eine Reise Mit Modernster KI-Compiler-Technologie Zu Begleiten!

Inhalte im Überblick:Der dritte Stopp des Offline-Treffens Meet TVM 2023 findet am 16. September im Tencent Building in Shenzhen statt! Dieses Meetup umfasst 5 wunderbare Vorträge über KI-Compiler. Wir freuen uns darauf, Sie alle in Shenzhen zu treffen!

Schlüsselwörter:Compiler Offline-Event 2023MeetTVM

Dieser Artikel wurde zuerst auf der öffentlichen HyperAI WeChat-Plattform veröffentlicht~

Im März und Juni dieses Jahres fand die Veranstaltungsreihe Meet TVM 2023 erfolgreich in Shanghai bzw. Peking statt.Mehr als 300 Partner namhafter Hersteller und Forschungsinstitute kamen online und offline zu einem ausführlichen Austausch und Gespräch zusammen.

Lesen Sie vorherige Artikel:

Mitte September findet das 3. Offline-TVM-Meetup in Shenzhen statt.Dieses Mal haben wir fünf erfahrene KI-Compiler-Experten eingeladen, die den anwesenden Freunden im Tencent Building in Shenzhen wunderbare Präsentationen halten werden.

Diese Veranstaltung wird von MLC.AI und HyperAI veranstaltet und von OpenBayes und Tencent AI Lab gesponsert. Außerdem haben wir für alle vor Ort erlesene Peripheriegeschenke und Teepausen vorbereitet. Jeder ist herzlich eingeladen, vorbeizukommen und Spaß zu haben!

Informationen zur Veranstaltung „Meet TVM Shenzhen 2023“

⏰ Zeit:16. September (Samstag) 13:30-17:30

📍 Ort:Multifunktionshalle, 2. Stock, Tencent Building, 10000 Shennan Road, Nanshan District, Shenzhen

👬 Anzahl der Personen:200 (Die Plätze vor Ort sind begrenzt, bitte melden Sie sich so früh wie möglich an)

🙌🏻 Melden Sie sich an:Scannen Sie den QR-Code unten, um sich zu registrieren

Herzliche Erinnerung: Zum Betreten des Tencent Building sind Besucherinformationen erforderlich. Bitte achten Sie darauf, Ihre persönlichen Daten korrekt einzugeben, damit Ihr Eintrag nicht beeinträchtigt wird. Vielen Dank für Ihre Mitarbeit.

Scannen Sie den QR-Code und notieren Sie „TVM Shenzhen“, um der Eventgruppe beizutreten:

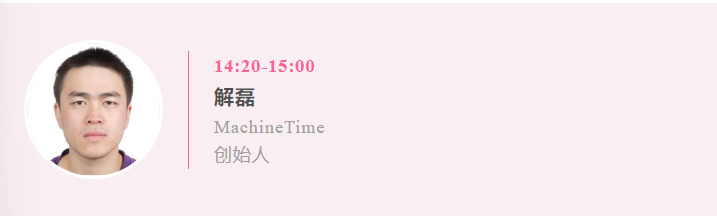

📝 Zeitplan:

Kurze Vorstellung der Gäste und Inhalte

Thema teilen:Dynamische Formkompilierungsoptimierung basierend auf TVM

Inhalt:Herkömmlichen Deep-Learning-Compilern (einschließlich TVM) fehlt die Unterstützung für dynamische Formen und sie sind weniger gut in der Lage, große Sprachmodelle (dynamische Sequenzlänge) und Erkennungsmodelle (dynamische Breite/Höhe) zu verarbeiten. Ausgehend von dieser Situation haben wir eine CPU-seitige, dynamische Formoperator-Optimierungslösung auf Basis von TVM entworfen und implementiert, die die vorhandene statische Formlösung übertrifft und nahezu keine Suchzeit erfordert.

Sehen Sie sich diese Sharing-Sitzung an und erfahren Sie:

1. Herausforderungen der dynamischen Formoptimierung

2. Dlight-bezogene Arbeit der TVM-Community

3. Schwierigkeiten und Lösungen für die dynamische Formoptimierung auf der CPU-Seite

Thema teilen:Entwerfen Sie einen KI-Prozessor: Der Compiler ist dominant

Inhalt:Mit der Entwicklung und Popularisierung von AIGC, dargestellt durch große Sprachmodelle, wächst der Bedarf an Rechenleistung exponentiell. Daher sind das Design von KI-Prozessorchips und die entsprechende Programmierung komplizierter geworden.

Wie kann man beides einfacher und effizienter gestalten? Eine mögliche Lösung ist der automatisierte gemeinsame Entwurf einer Compiler-Computerarchitektur.

Sehen Sie sich diese Sharing-Sitzung an und erfahren Sie:

1. Produktlandschaft der KI-Prozessoren

2. Aktueller Forschungsstand zum automatisierten KI-Prozessordesign

3. Grundlegendes Kompilierungsframework für den automatisierten Entwurf von KI-Prozessoren

Thema teilen:MLIR und seine Praxis der KI-Graphkompilierung

Inhalt:Mit der rasanten Entwicklung von KI-Chips und KI-Frameworks wurden auch KI-Compiler wie XLA, TVM usw. entwickelt. Als allgemeines und wiederverwendbares Compiler-Framework wird MLIR derzeit häufig in KI-Kompilierungssystemen verwendet, da es Hardwareherstellern dabei helfen kann, schnell DS-KI-Compiler zu erstellen.

Dieser Austausch stellt hauptsächlich einige grundlegende Wissenselemente von MLIR, den Codegen-Prozess von MLIR und die praktischen Schritte zum Erstellen eines KI-Compilers vor. Darüber hinaus diskutieren wir mit Ihnen auch die Ideen von MLIR zur Lösung der Hauptprobleme von KI-Compilern.

Sehen Sie sich diese Sharing-Sitzung an und erfahren Sie:

1. Bausteine eines KI-Compilers

2. Grundkenntnisse und Anwendung von MLIR

3. Grundlegende Schritte zum Erstellen eines KI-Compilers mit MLIR

Thema teilen:Entwurf und Implementierung eines KI-Compilers basierend auf MLIR

Inhalt:Im Bereich KI und maschinelles Lernen gibt es viele verschiedene Software-Frameworks (wie TensorFlow, PyTorch usw.), und die Hardwaregeräte werden immer vielfältiger (CPU, GPU, TPU usw.). Als Brücke zwischen beiden stehen KI-Compiler vor vielen Herausforderungen.

Als Compiler-Infrastruktur bietet MLIR eine Reihe wiederverwendbarer und leicht erweiterbarer Basiskomponenten zum Erstellen domänenspezifischer Compiler. Tencent hat einen End-to-End-KI-Compiler auf Basis von MLIR entwickelt, um eine Kompilierungsoptimierung für die KI-Modelle der Benutzer bereitzustellen und so die Bereitstellung von Modellen auf einer Vielzahl von KI-Chips zu vereinfachen und maximale Leistung zu erzielen.

Sehen Sie sich diese Sharing-Sitzung an und erfahren Sie:

1. Der Gesamtprozess des Tencent AI-Compilers

2. Einführung in die MLIR-Infrastruktur und den damit verbundenen Komfort

3. Einführung in Kacheln und Fusion basierend auf dem Linalg-Dialekt

Thema teilen:Chancen und Herausforderungen maschineller Lernsysteme im Zeitalter großer Modelle

Inhalt:Im Bereich der generativen KI und der großen Sprachmodelle (LLMs) wurden erhebliche Fortschritte erzielt. Diese verfügen über bemerkenswerte Fähigkeiten und das Potenzial, viele Bereiche grundlegend zu verändern. Gleichzeitig bringt es neue Chancen und Herausforderungen für maschinelle Lernsysteme mit sich. Einerseits hat der enorme Bedarf an Rechenleistung zu einem erhöhten Bedarf an Systemoptimierung geführt; Andererseits haben die einheitliche Modellstruktur und die Anforderungen an die Hochleistungshardware dazu geführt, dass das ursprünglich offene Ökosystem des maschinellen Lernens zu konvergieren beginnt.

Sehen Sie sich diese Sharing-Sitzung an und erfahren Sie:

1. Der aktuelle Status von maschinellen Lernsystemen im Zeitalter großer Modelle

2. Aktuelle Fortschritte und Aktualisierungen des MLC-LLM

3. Ausblick auf maschinelle Lernsysteme in der Post-Large-Model-Ära

Vorstellung der Organisatoren und Partner

Als Organisator dieser Veranstaltung wurde im Juni 2022 die MLC.AI-Community gegründet. Unter der Leitung von Chen Tianqi, dem Haupterfinder von Apache TVM und einem bekannten jungen Wissenschaftler auf dem Gebiet des maschinellen Lernens, startete das Team den MLC-Onlinekurs, der systematisch die Schlüsselelemente und Kernkonzepte der Kompilierung maschinellen Lernens vorstellte.

Im November 2022 werden wir mit den gemeinsamen Anstrengungen der Freiwilligen der MLC.AI-CommunityDas erste vollständige chinesische TVM-Dokument wurde veröffentlicht und erfolgreich auf der offiziellen HyperAI-Website gehostet.Darüber hinaus bietet es inländischen Entwicklern, die an der Kompilierung von maschinellem Lernen interessiert sind, die grundlegenden Einstellungen – Dokumentation –, um auf eine neue Technologie zuzugreifen und sie zu erlernen.

Im vierten Quartal 2023 findet in Hangzhou die Veranstaltungsreihe „2023 Meet TVM“ statt, und Unternehmen und Community-Partner sind herzlich eingeladen, an der gemeinsamen Gestaltung teilzunehmen.

MLC-Onlinekurse:https://mlc.ai/

Chinesische TVM-Dokumentation:https://tvm.hyper.ai/

Chinas führende Community für künstliche Intelligenz und Hochleistungsrechnen,Wir setzen uns dafür ein, inländischen Entwicklern hochwertige öffentliche Ressourcen im Bereich der Datenwissenschaft zur Verfügung zu stellen.Bisher wurden inländische Downloadknoten für mehr als 1.200 öffentliche Datensätze bereitgestellt, mehr als 300 Abfragen zu Begriffen aus den Bereichen künstliche Intelligenz und Hochleistungsrechnen unterstützt, die komplette chinesische TVM-Dokumentation gehostet und in Kürze werden mehrere grundlegende und beliebte Tutorials veröffentlicht.

Besuchen Sie die offizielle Website:https://orion.hyper.ai/

OpenBayes ist ein führender Anbieter von Hochleistungsrechnerdiensten in China.Durch die Integration klassischer Software-Ökosysteme und Modelle des maschinellen Lernens in die neue Generation heterogener Chips werden Industrieunternehmen und der wissenschaftlichen Forschung an Universitäten schnellere und benutzerfreundlichere Produkte für die Datenwissenschaft bereitgestellt. Seine Produkte werden von Dutzenden großer Industrieszenarien oder führenden wissenschaftlichen Forschungsinstituten übernommen.

Besuchen Sie die offizielle Website:https://openbayes.com/

Tencent AI Lab ist das KI-Labor auf Unternehmensebene von Tencent. Es wurde im April 2016 in Shenzhen gegründet und beschäftigt derzeit mehr als 100 Spitzenforscher und über 300 Anwendungsingenieure. Mithilfe der langfristigen Ansammlung von umfangreichen Anwendungsszenarien, Big Data, Rechenleistung und erstklassigen Talenten durch TencentAI Lab engagiert sich für die Zukunft, ist offen für Zusammenarbeit und verbessert kontinuierlich die Wahrnehmung, Entscheidungsfindung und Kreativität von KI, um die Vision „KI überall einsetzen“ zu verwirklichen.

Tencent AI Lab legt Wert auf die Entwicklung sowohl der Forschung als auch der Anwendung.Die Grundlagenforschung konzentriert sich auf vier Hauptrichtungen: maschinelles Lernen, Computer Vision, Sprachtechnologie und Verarbeitung natürlicher Sprache; Die Technologieanwendungen konzentrieren sich auf vier Hauptbereiche: Spiele, digitale Menschen, Inhalte und soziale Interaktion und erkunden zunächst die Forschung und Anwendung von KI in der Industrie, Landwirtschaft, im Gesundheitswesen, in der Medizin, den Biowissenschaften und anderen Bereichen.

Aktive Zeile:Scannen Sie den QR-Code, um zur Veranstaltungsregistrierung zu gelangen

Scan-Code-Notizen TVM ShenzhenTreten Sie der Aktivitätsgruppe bei

In Anbetracht der Größe des Veranstaltungsortes dieser Veranstaltung,Wir haben nur 200 Plätze für die Teilnahme freigegeben.Um sich einen Platz zu sichern, empfiehlt es sich, sich möglichst frühzeitig anzumelden.

Die Veranstaltungsreihe „Meet TVM“ 2023 ist jetzt eröffnet.Ich freue mich darauf, Sie alle am 16. September von 13:30 bis 17:30 Uhr in Shenzhen zu treffen!

Dieser Artikel wurde zuerst auf der öffentlichen HyperAI WeChat-Plattform veröffentlicht~