Command Palette

Search for a command to run...

Online-Livestream | HyperAI Veranstaltet "2023 Meet TVM·Beijing", Eine Zusammenkunft Von Branchenführern Zum Austausch Von Ideen Und Erkenntnissen.

Inhalte im Überblick:Das Treffen „TVM·Beijing Station 2023“ fand am 17. Juni im Garage Cafe in Zhongguancun statt und lockte über 150 Teilnehmer aus Unternehmen und Universitäten an. HyperAI übertrug die gesamte Veranstaltung live auf Bilibili. Die Aufzeichnung finden Sie unten.

Live-Übertragungszeit:17. Juni 2023

Schlüsselwörter:Machine Learning Compilation 2023 Lernen Sie TVM kennen

Dieser Artikel wurde zuerst auf der öffentlichen HyperAI WeChat-Plattform veröffentlicht~

Am 17. Juni fand das zweite Offline-Treffen von „Meet TVM 2023“, veranstaltet von MLC.AI und HyperAI in Zusammenarbeit mit OpenBayes, erfolgreich statt. Über 150 Teilnehmer aus Unternehmen und Universitäten nahmen an der Veranstaltung teil. HyperAI übertrug das gesamte Event live auf Bilibili. Die Atmosphäre vor Ort war lebhaft, und auch die Online-Teilnehmer beteiligten sich rege an den Diskussionen in den Kommentaren.

Diese Veranstaltung,Es ist uns eine Ehre, sieben technische Experten der Shanghai Jiao Tong University, von ARM China, Horizon Robotics und NIO eingeladen zu haben.Durch die Kombination der Anwendungsfälle des KI-Compilers in seinen eigenen Geschäftsszenarien konnte er den Freunden vor Ort wunderbaren Austausch ermöglichen.

Neben den einheimischen Freunden aus Peking nahmen auch viele Freunde aus Tianjin, Nanjing, Hangzhou, Shanghai und anderen Orten teil. Jeder brachte seine eigenen geschäftlichen Fragen und Herausforderungen mit und neben dem Zuhören beim technischen Austausch gab es auch einen aktiven Austausch und Diskussionen mit den Kollegen.

Holen Sie sich die PPT-Präsentation und das Live-Video

Es folgt eine kurze Einführung in die Veranstaltung und ein Videorückblick auf die Veranstaltung.

Folgen Sie dem öffentlichen WeChat-Konto „HyperAI 超神经元“, antworten Sie im Hintergrund mit dem Schlüsselwort TVM 北京 und erhalten Sie die vollständige PPT des Gastes.

Thema teilen:Stellen Sie Sprachmodelle mit MLC-LLM auf jedem Gerät bereit

Inhalt:Im Bereich der generativen KI und der Large Language Models (LLMs) wurden erhebliche Fortschritte erzielt. Diese verfügen über bemerkenswerte Fähigkeiten und das Potenzial, viele Bereiche grundlegend zu verändern. Derzeit erfordern die meisten dieser Modelle eine hohe Rechenleistung und einen hohen Speicherbedarf und können nicht auf PCs, Mobiltelefonen und kleineren Endgeräten eingesetzt werden. MLC-LLM optimiert Ausführungsgeschwindigkeit und Speicherbedarf durch Kompilierungstechnologie, ermöglicht die Bereitstellung von LLMs auf der Clientseite und bietet eine neue Infrastruktur für die anschließende Entwicklung von Sprachmodellen.

Live-Video:

https://www.bilibili.com/video/BV1rm4y1Y7Si/?spm_id_from=333.999.0.0

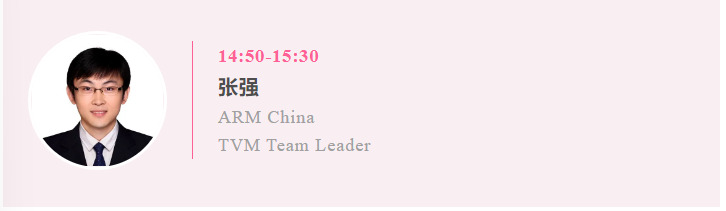

Thema teilen:TVM bei ARM China

Inhalt:Mit der rasanten Entwicklung von KI-Anwendungen werden auf Edge-Geräten verschiedene NPU-Chips verwendet, um KI-Anwendungen zu beschleunigen. Die schnelle Anpassung an verschiedene Frameworks und Betriebssysteme für maschinelles Lernen ist zu einem schwierigen Problem geworden. Durch die Integration seiner eigenen Toolchain mit TVM hat ARM China mehrere praktische Funktionen wie Graph-Splitting und automatische heterogene Ausführung realisiert und hilft Kunden so, KI-Anwendungen schnell auf dem ARM China Zhouyi NPU-Chip bereitzustellen.

Live-Video:

https://www.bilibili.com/video/BV1GW4y1X7tL/?spm_id_from=333.337.search-card.all.click

Thema teilen:Heterogene KI-Programmierung und Kompilierungspraxis

Inhalt:KI-Chips entwickeln sich ständig in Richtung eng gekoppelter Heterogenität. Chip-Programmierbarkeit und Leistungsoptimierung sind zentrale Probleme, die die Branche zu lösen versucht. In diesem Beitrag werden hauptsächlich einige der Praktiken von Horizon in den Bereichen KI-Kompilierungsoptimierung, Programmierbarkeit usw. vorgestellt und einige Schlüsselthemen eingehend erörtert.

Live-Video:

https://www.bilibili.com/video/BV1js4y117NT/?spm_id_from=333.337.search-card.all.click

Thema teilen:TVM bei NIO

Inhalt:Der Bereich des autonomen Fahrens ist ein Bereich, in dem Herausforderungen und Chancen nebeneinander bestehen. Angesichts der ständigen Produktneuheiten und der immer höheren Anforderungen der Benutzer an das Fahrerlebnis sind herkömmliche KI-Engines nicht in der Lage, komplexe Produktproduktionslinien effizient und sicher zu unterstützen. Wir haben NIOs eigenen KI-Compiler auf Basis von TVM entwickelt, der einige häufige Probleme im Bereich des autonomen Fahrens löste und eine systematische Lösung und technische Architektur bildete.

Drei Ingenieure von NIO, Meng Tong, Chen Xi (Zhihu aaronxic) und Wang Lulu, gaben detaillierte Erklärungen zu den beteiligten Technologien und Architekturen.

Live-Video:

https://www.bilibili.com/video/BV1fV4y117g7/?spm_id_from=333.337.search-card.all.click

Thema teilen:Optimierung der Kompilierung dynamischer neuronaler Netzwerke

Inhalt: Dynamische neuronale Netzwerke weisen gegenüber statischen neuronalen Netzwerken wichtige Vorteile hinsichtlich Genauigkeit, Rechenleistung und Anpassungsfähigkeit auf. Allerdings konzentrieren sich vorhandene Deep-Learning-Frameworks und -Compiler hauptsächlich auf die Optimierung statischer Netzwerke mit deterministischer Ausführung und verpassen so Optimierungsmöglichkeiten in dynamischen Netzwerken. Der Schlüssel zur Optimierung eines dynamischen Netzwerks liegt in der Verfolgung der durch das Netzwerk fließenden Daten. In diesem Beitrag werden Einzelheiten zu unserer Arbeit an der Kompilierung dynamischer neuronaler Netzwerke beschrieben.

Live-Video:

https://www.bilibili.com/video/BV1Mz4y1v7se/?spm_id_from=333.337.search-card.all.click

Treten Sie der chinesischen TVM-Community bei, um weitere Städte freizuschalten

Nach dem Treffen in Shanghai im März und dem Treffen in Peking im Juni freuen wir uns sehr, Ingenieure, die an KI-Compilern interessiert sind, in verschiedenen Städten zusammenzubringen, um eine Plattform für die Kommunikation auf Augenhöhe und den Wissensaustausch bereitzustellen. Wir planen, das dritte Offline-Treffen des Jahres im September in Shenzhen abzuhalten. Wir heißen alle Unternehmen und Community-Partner willkommen, sich an der gemeinsamen Entwicklung zu beteiligen und den Einfluss der chinesischen TVM-Community kontinuierlich auszubauen!

Auch,Wir sind auch aktiv auf der Suche nach Mitwirkenden für die chinesische TVM-Community.Wenn Sie Mitglied bei uns werden möchten, fügen Sie WeChat antonia0912 gerne hinzu. Wir freuen uns auf Ihre begeisterte Mitarbeit!

Wir stellen derzeit ein:

* Freiwillige Übersetzer der chinesischen TVM-Dokumentation sorgen dafür, dass die chinesische Dokumentation mit der englischen Dokumentation synchron gehalten wird, und bieten eine Infrastruktur für mehr Ingenieure, die TVM lernen und verstehen möchten (besuchen Sie die offizielle Website: tvm.hyper.ai)!

* Freiwillige Helfer, die für die Organisation, Planung und Durchführung von Aktivitäten an verschiedenen Orten und für den Aufbau unserer Basis in mehreren Internetzentren im ganzen Land verantwortlich sind.

* Q&A-Freiwillige, die mit TVM vertraut sind und bereit sind, Freunden in der Community, die auf Probleme stoßen, Erkenntnisse und Ideen weiterzugeben, um allen bei der Lösung technischer Probleme zu helfen.

Im Jahr 2023 werden weitere Städte freigeschaltet. Werden Sie Teil unserer Initiative und gründen Sie die aktivste KI-Compiler-Community in China!

Zum Schluss noch ein Gruppenfoto vor Ort ❤️

Vorstellung der Organisatoren und Partner

Als Organisator dieser Veranstaltung, MLC.AI Community (https://mlc.ai/) wurde im Juni 2022 gegründet. Unter der Leitung von Chen Tianqi, dem Haupterfinder von Apache TVM und einem bekannten jungen Wissenschaftler auf dem Gebiet des maschinellen Lernens, startete das Team den MLC-Onlinekurs, der systematisch die Schlüsselelemente und Kernkonzepte der Kompilierung maschinellen Lernens vorstellte.

Im November 2022 werden wir mit den gemeinsamen Anstrengungen der Freiwilligen der MLC.AI-CommunityDas erste vollständige chinesische TVM-Dokument wurde veröffentlicht und erfolgreich auf der offiziellen HyperAI-Website gehostet.Darüber hinaus bietet es inländischen Entwicklern, die an der Kompilierung von maschinellem Lernen interessiert sind, die Infrastruktur (Dokumentation), um auf eine neue Technologie zuzugreifen und sie zu erlernen.

Im Jahr 2023 wird die Community in vielen Städten des Landes die Aktivitätsreihe „2023 Meet TVM“ starten und Unternehmen und Community-Partner zur Teilnahme an der gemeinsamen Gestaltung einladen.

MLC-Onlinekurse:https://mlc.ai/

Chinesische TVM-Dokumentation:https://tvm.hyper.ai/

HyperAI ist Chinas führende Community für künstliche Intelligenz und Hochleistungsrechnen.Wir setzen uns dafür ein, inländischen Entwicklern hochwertige öffentliche Ressourcen im Bereich der Datenwissenschaft zur Verfügung zu stellen.Bisher wurden inländische Downloadknoten für mehr als 1.200 öffentliche Datensätze bereitgestellt, mehr als 300 Abfragen zu Begriffen aus den Bereichen künstliche Intelligenz und Hochleistungsrechnen unterstützt, die komplette chinesische TVM-Dokumentation gehostet und in Kürze werden mehrere grundlegende und beliebte Tutorials veröffentlicht.

Besuchen Sie die offizielle Website:https://orion.hyper.ai/

OpenBayes Bayesian Computing ist ein führender inländischer Anbieter von Hochleistungsrechnerdiensten. Durch die Integration klassischer Software-Ökosysteme und Modelle des maschinellen Lernens in heterogene Chips der neuen Generation bietet es schnellere und benutzerfreundlichere Data-Science-Computing-Produkte für Industrieunternehmen und die wissenschaftliche Forschung an Universitäten. Seine Produkte werden von Dutzenden großer Industrieszenarien oder führenden wissenschaftlichen Forschungsinstituten übernommen.

Besuchen Sie die offizielle Website:https://openbayes.com/

Garage Coffee ist eine Plattform, die Unternehmer zusammenbringt. Basierend auf einem Café bietet es Start-ups eine umfassende Investitions- und Finanzierungslösung aus einer Hand und hilft Projektbeteiligten dabei, schnell Geld aufzutreiben und eine schnelle Entwicklung zu fördern. Gleichzeitig bietet es hochwertige Mehrwertdienste wie Unternehmensberatung, Ressourcenvermittlung, Werbung und Berichterstattung und hilft Investoren dabei, schnell gute Projekte zu entdecken, bietet eine Grundlage für ihre Erstinvestitionen, Folgeinvestitionen, Ressourcenausbeute, Erfahrungsausbeute usw. und fördert die kollaborative Entwicklung zwischen mehrstufigen Investorengruppen.

Dieser Artikel wurde zuerst auf der öffentlichen HyperAI WeChat-Plattform veröffentlicht~