Command Palette

Search for a command to run...

Die Chinesische TVM-Website Ist Offiziell Gestartet! Das Umfassendste „Nachschlagewerk“ Zur Bereitstellung Von Machine-Learning-Modellen Finden Sie Hier

Inhalte im Überblick: Vor Kurzem wurde das chinesische TVM-Dokument, das von Freiwilligen der MLC-Community übersetzt und Korrektur gelesen wurde, offiziell veröffentlicht und ist jetzt auf der offiziellen Website von Hyper.AI gehostet.

Schlüsselwörter: TVM Open-Source-Compiler für maschinelles Lernen

Dieser Artikel wurde zuerst auf dem offiziellen WeChat-Konto HyperAI veröffentlicht.

Fünf Jahre nach seiner Einführung hat sich TVM zu einem beliebten Deep-Learning-Kompilierungsstapel entwickelt

Im August 2017 veröffentlichten Chen Tianqi, damals Doktorand an der University of Washington, und seine Teammitglieder TVM offiziell.

Dies ist ein Open-Source-Framework zur Modellkompilierung, dessen vollständiger Name Tensor Virtual Machine lautet, was Tensor-Virtual Machine bedeutet.Ziel ist es, Algorithmen des maschinellen Lernens automatisch in eine Maschinensprache zu kompilieren, die von der zugrunde liegenden Hardware ausgeführt werden kann, wodurch mehrere Arten von Rechenleistung genutzt werden.

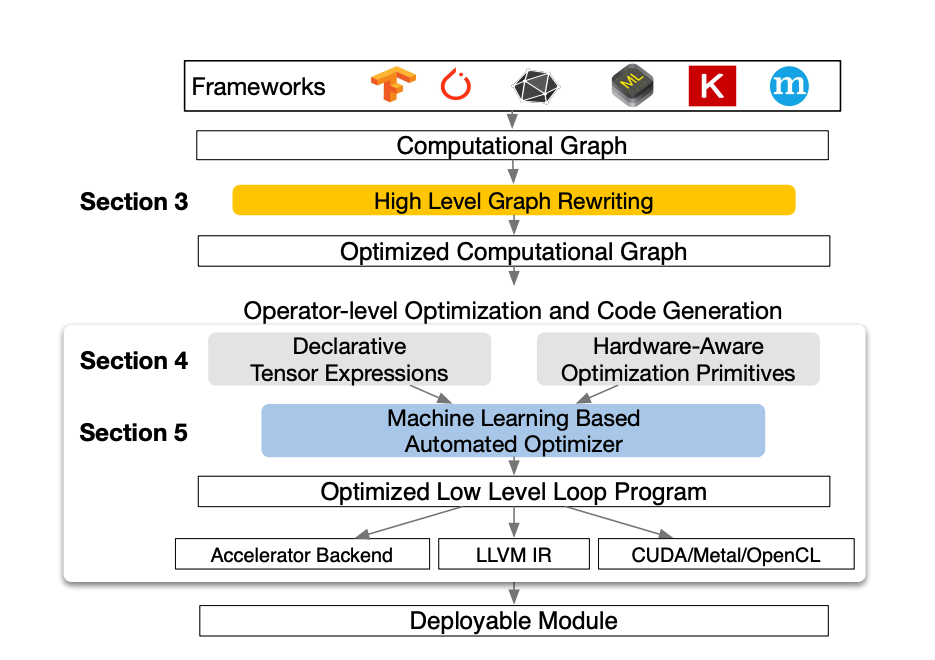

TVM-Systemübersicht: Anwendbar auf CPU, GPU und verschiedene Beschleunigungschips für maschinelles Lernen

Papier:

TVM: Ein automatisierter End-to-End-Optimierungscompiler für Deep Learning

Auf die Zhihu-Frage „Wie bewerten Sie das neue Open-Source-TVM von Chen Tianqis Team?“ erklärte Chen Tianqi es persönlich und sagte:

TVM versucht, die manuelle Optimierungserfahrung von Deep-Learning-Operationen auf einer höheren Abstraktionsebene zusammenzufassen, sodass Benutzer schnell und automatisch oder halbautomatisch einen effizienten Implementierungsbereich für Operationen erkunden können.

Diese Frage wurde auf Zhihu fast 260.000 Mal aufgerufen.

Seit seiner Eröffnung vor fast 5 JahrenTVM bietet die Vorteile von Flexibilität, hoher Leistung und Anpassungsfähigkeit an jede Hardware. Es wird von vielen großen Herstellern wie NVIDIA, AMD, ARM, AWS, Facebook usw. bevorzugt, die alle TVM verwenden, einen Open-Source-End-to-End-Deep-Learning-Hardware-Kompilierungsstapel, um die Unterstützung für beliebige Hardware zu verbessern.

Es dauerte 3 Monate, bis die chinesische Dokumentation für v0.10.0 veröffentlicht wurde

Derzeit sind die chinesischen Lernmaterialien zum Thema TVM im Internet relativ verstreut. Die wenigen verfügbaren chinesischen Materialien werden größtenteils von Praktikern oder Enthusiasten in verwandten Branchen auf der Grundlage ihrer eigenen Studien- oder Arbeitsanforderungen zusammengestellt und herausgegeben.

Um inländischen Entwicklern dabei zu helfen, TVM systematisch zu erlernen und die Entwicklung der maschinellen Lernkompilierung in China zu fördern,Freiwillige der MLC-Community (Machine Learning Compilation) begannen mit der Dokumentation und lokalisierten die offizielle TVM-Dokumentation v0.10.0 im Rahmen einer Open-Source-Kooperation.

Die chinesische TVM-Dokumentation wird von Hyper.AI gehostet

Portal →https://tvm.hyper.ai/

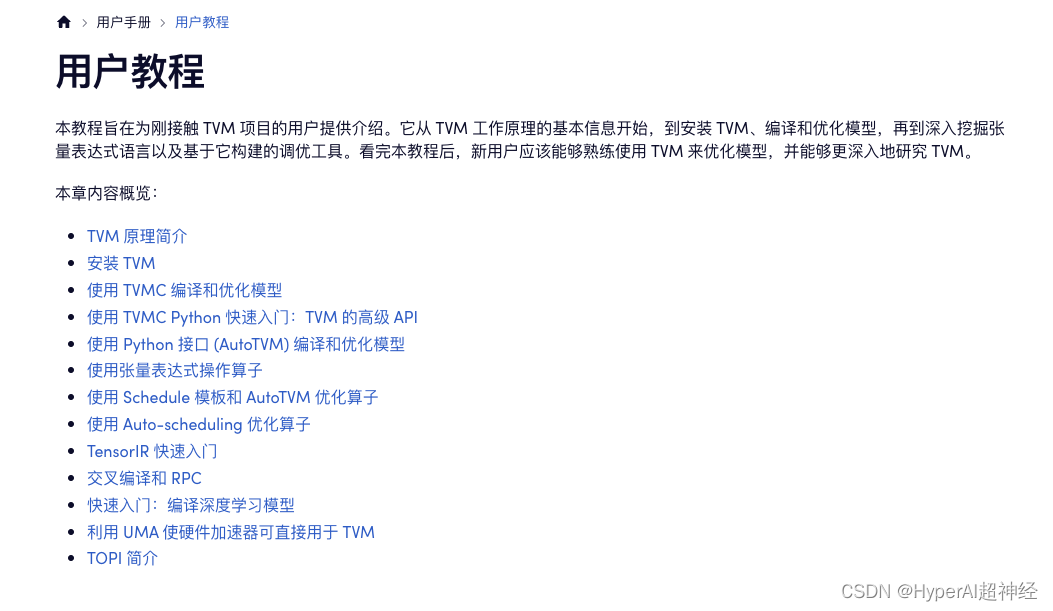

Die chinesische Dokumentation basiert auf der Struktur der englischen Dokumentation auf der offiziellen TVM-Website.Es wurden Anpassungen vorgenommen, um den Lesegewohnheiten der Chinesen besser gerecht zu werden. Es wird eine Reihe praktischer Dokumente als Referenz bereitgestellt, von der Installation von TVM bis hin zu dessen Verwendung für die Entwicklung.

Es gibt drei Möglichkeiten, TVM zu installieren: Quellcode-Installation, Docker-Image-Installation und NNPACK Contrib-Installation

Im Abschnitt „Benutzer-Tutorials“ stehen Entwicklern außerdem über zehn Tutorials zur Verfügung, die sie zum Lernen schnell suchen und finden können.

Derzeit wird die chinesische TVM-Dokumentation noch aktualisiert. , Wir hoffen, dass sich mehr Entwickler, denen die Kompilierung von maschinellem Lernen am Herzen liegt und die sich darauf konzentrieren, anschließen, von der Community profitieren und einen Mehrwert für die Community schaffen.

Wir freuen uns über alle Formen von Beiträgen, einschließlich, aber nicht beschränkt auf:

- Fordern Sie die Übersetzung und Überprüfung englischer TVM-Dokumente an

- Senden Sie ein Problem oder eine PR, um chinesische Dokumente standardisierter zu gestalten

- Fördern Sie Projekt-Tutorials und Blog-Beiträge und beteiligen Sie sich aktiv an Community-Aktivitäten.

- Mehr

Open-Source-Community. Alles kommt von der Community und alles kommt der Community zugute. Besuchen Sie jetzt das GitHub-Repo der chinesischen TVM-Dokumentation. Wir hoffen, dass Sie Mitglied bei uns werden und zur Entwicklung von Compilern für maschinelles Lernen im chinesischen Bereich beitragen!

⭐️ TVM in GitHub:

⭐️ TVM Chinese auf GitHub:

https://github.com/hyperai/tvm-cn

Danksagung:

Der erfolgreiche Start der chinesischen TVM-Site ist untrennbar mit der starken Unterstützung der MLC.AI-Community verbunden. Wir danken allen Community-Mitgliedern herzlich für ihre aktive Teilnahme und Unterstützung:

-- über--