Command Palette

Search for a command to run...

Anime-Stil-Transfer AnimeGANv2, Online Veröffentlichte Laufende Demo

AnimeGANv2 hat vor Kurzem ein von Community-Mitwirkenden entwickeltes Update veröffentlicht.Eine online lauffähige Demo wird über Gradio implementiert und auf huggingface veröffentlicht..

Zugang https://huggingface.co/spaces/akhaliq/AnimeGANv2

Sie können den Verarbeitungseffekt von AnimeGANv2 problemlos online erzielen (unterstützt nur die statische Bildverarbeitung).

AnimeGAN: Alle dreidimensionalen Objekte werden zweidimensional

AnimeGAN ist eine auf CartoonGAN basierende Verbesserung und bietet eine leichtere Generatorarchitektur. Im Jahr 2019 wurde AnimeGAN erstmals als Open Source veröffentlicht und sorgte mit seinen außergewöhnlichen Ergebnissen für hitzige Diskussionen.

Papiere zum Zeitpunkt der Erstveröffentlichung „AnimeGAN: ein neuartiges leichtes GAN für Fotoanimationen“In diesem Artikel werden außerdem drei neue Verlustfunktionen vorgeschlagen, um die stilisierten visuellen Effekte von Anime zu verbessern.

Die drei Verlustfunktionen sind:Verlust des Graustufenstils, Verlust des Graustufen-Antagonisten, Verlust der Farbrekonstruktion.

AnimeGANv2, das letzten September veröffentlicht wurde, optimierte das Modell und löste einige Probleme in der ersten Version von AnimeGAN.

In v2 wurden neue Trainingsdatensätze mit Comic-Stilen von drei Cartoonisten, Makoto Shinkai, Hayao Miyazaki und Satoshi Kon, hinzugefügt.

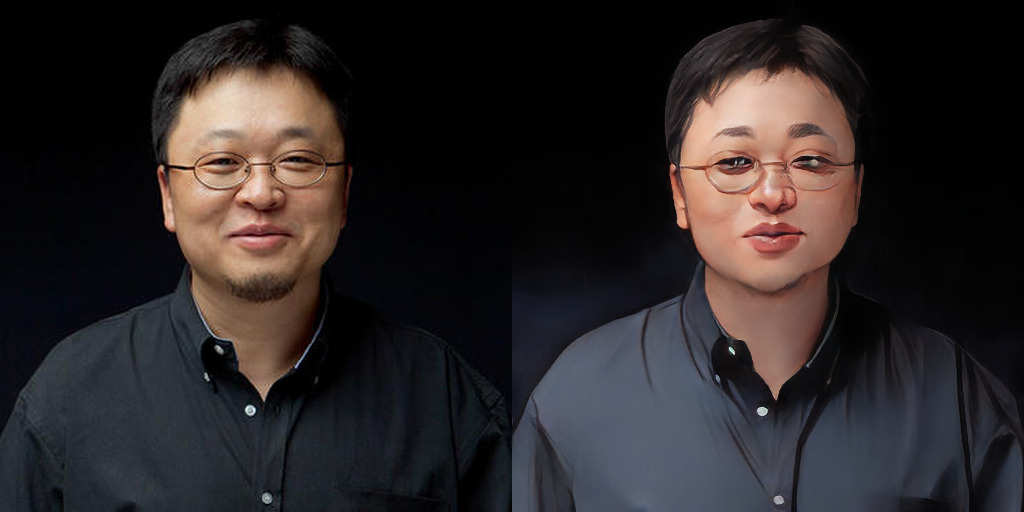

Nehmen wir Musk als Beispiel: Die Wirkung der ersten Generation von AnimeGAN war bereits erstaunlich, aber er war zu hellhäutig und kränklich, wie ein Mitglied einer koreanischen Boyband. Im Vergleich dazu ist v2 natürlicher und entspricht eher dem tatsächlichen Temperament.

Highlights des AnimeGANv2-Updates:

– Das Problem der hochfrequenten Artefakte in den generierten Bildern wurde gelöst;

– v2 ist einfacher zu trainieren und kann die im Dokument beschriebenen Ergebnisse direkt erzielen;

– Reduzieren Sie die Anzahl der Parameter des Generatornetzwerks weiter. (Generatorgröße 8,17 MB);

– Fügen Sie weitere hochwertige Bilddaten hinzu.

Projektinformationen

Konfigurationsanforderungen für die TensorFlow-Versionsumgebung

- Python 3.6

- Tensorflow-GPU

- tensorflow-gpu 1.8.0 (Ubuntu, GPU 1080Ti oder Titan XP, cuda 9.0, cudnn 7.1.3)

- tensorflow-gpu 1.15.0 (Ubuntu, GPU 2080Ti, cuda 10.0.130, cudnn 7.6.0)

- opencv

- tqdm

- numpy

- Globus

- Argparse

PyTorch-Implementierung

Gewichtsumrechnung

git clone https://github.com/TachibanaYoshino/AnimeGANv2

python convert_weights.pyArgumentation

python test.py --input_dir [image_folder_path] --device [cpu/cuda]Colab innerhalb der Wand

Projekt GitHub

https://github.com/TachibanaYoshino/AnimeGANv2

Online-Demo

https://huggingface.co/spaces/akhaliq/AnimeGANv2

Colab innerhalb der Wand

https://openbayes.com/console/open-tutorials/containers/pROHrRgKItf