Command Palette

Search for a command to run...

Wie Wird Das Kind Von Yui Aragaki Und Ihrem Mann Aussehen? Verwenden Wir BabyGAN Zur Vorhersage

„Meine Frau heiratet“, „Der Schmerz darüber, dass General Hoshino seine Frau genommen wurde“, „Meine Jugend ist vorbei“ … Nachdem General Hoshino und Yui Aragaki ihre Hochzeit offiziell bekannt gegeben hatten, äußerten viele Internetnutzer die oben genannten Gefühle.

Eine andere Gruppe von Internetnutzern nahm die aktuelle Situation der „zerbrochenen Liebe“ ruhig hin und kümmerte sich nun um die Kinder von Yui Aragaki und Gen Hoshino.Angst, dass das Kind nicht wie die Mutter aussieht.

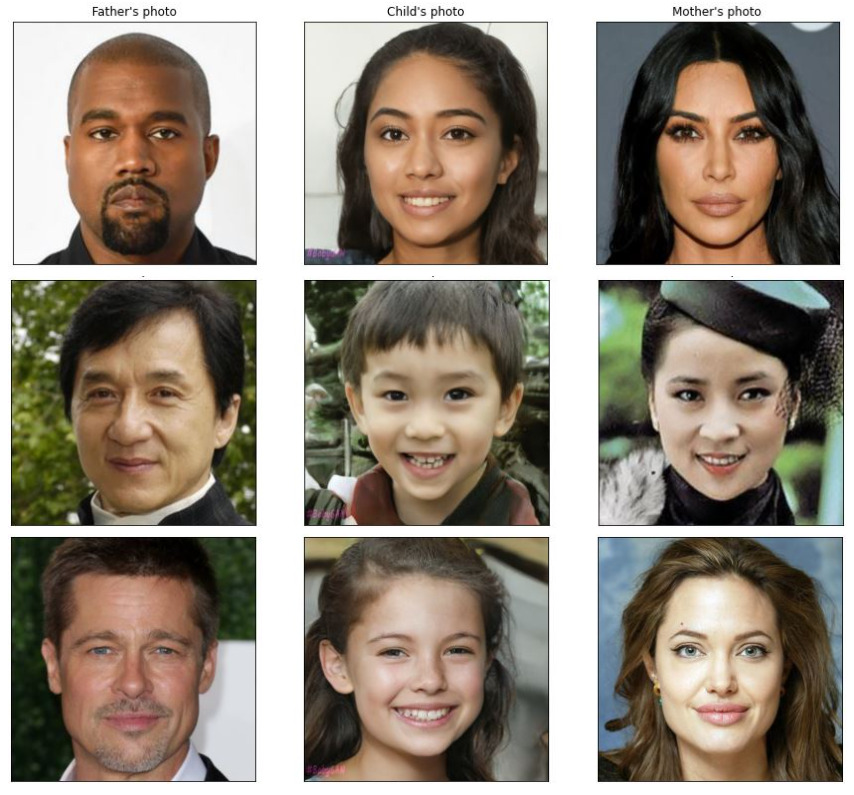

Mithilfe des Open-Source-Modells BabyGAN haben wir vorhergesagt, wie die zukünftigen Kinder von Yui Aragaki und Gen Hoshino aussehen werden.

„Dahe“ ist der Name des Kindes des Paares im Drama „Ich bin nicht schuld, dass ich beliebt bin!“.Laut BabyGANs VorhersageWenn das Kind von Yui Aragaki und Gen Hoshino ein Mädchen ist,Dann können die Flüsse unterschiedlichen Alters wie folgt aussehen:

Was ist BabyGAN?

BabyGAN ist ein auf StyleGAN basierender Prädiktor für das Aussehen von Kindern.Basierend auf dem Encoder und Generator können Sie Bilder von Vater und Mutter eingeben und nach der Verarbeitung durch das neuronale Netzwerk das Aussehen des zukünftigen Kindes generieren oder vorhersagen.

Vorhersagemethode: Mithilfe eines neuronalen Netzwerkmodells, das auf der GAN-Architektur basiert, wird die latente Darstellung aus dem eingegebenen übergeordneten Bild extrahiert und anschließend mithilfe des Algorithmus in einem bestimmten Verhältnis gemischt, um das untergeordnete Bild zu erzeugen.

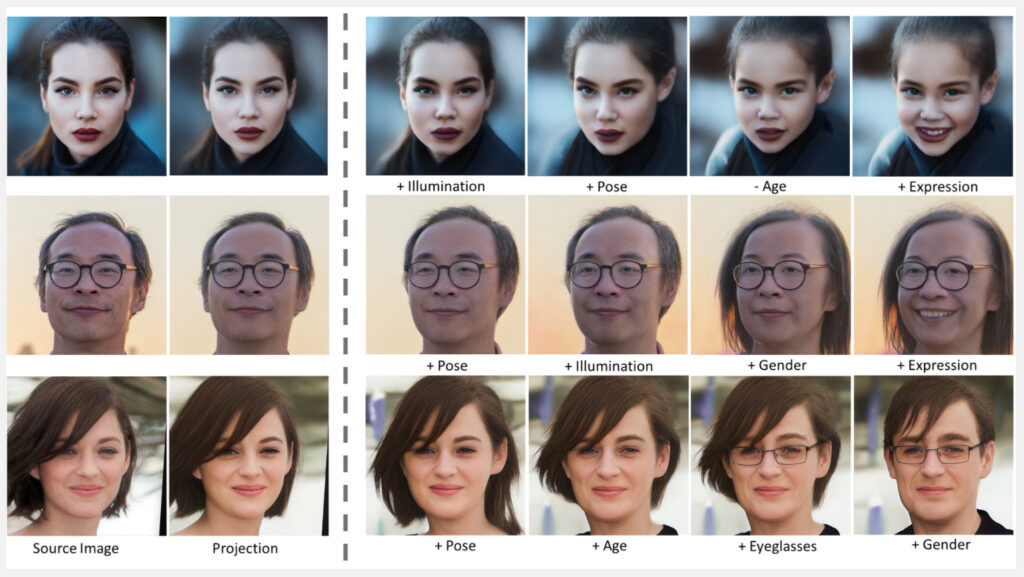

Mithilfe der Latenzrichtung können Sie Parameter wie Alter, Gesichtsausrichtung, Emotionen und Geschlecht ändern.

Projektadresse: [Hier]

Encoder: Hier

Dieses Tutorial demonstriert hauptsächlich:

1. Laden Sie das trainierte BabyGAN-Modell vom lokalen

2. Bereiten Sie Bilder beider Eltern vor und erhalten Sie ihre latenten Darstellungen

3. Generieren Sie das Gesicht des Kindes mithilfe des Modells

4. Passen Sie das Geschlecht, das Alter und andere Parameter des Kindes an, um ein Kinderbild zu erstellen, das Ihren Anforderungen entspricht

Installationsumgebung:Python: 3.6; TensorFlow: 1,15

Notiz:Es wird empfohlen, dieses Tutorial mit GPU auszuführen

Adresse des Tutorials:Hier

Detaillierte Erklärung des Modelltrainingsprozesses

1. Vorbereitung

2. Bereiten Sie das übergeordnete Bild vor

3. Generieren Sie untergeordnete Bilder

4. Generieren Sie untergeordnete Bilder mit bestimmten Merkmalen

Sehen Sie sich das vollständige Tutorial an:Hier

StyleGAN-bezogene hoch bewertete Open-Source-Projekte

Das BabyGAN-Modell basiert auf StyleGAN. Darüber hinaus basiert es auf StyleGAN und StyleGAN2.Darüber hinaus sind auch viele hochwertige Open-Source-Projekte entstanden.

StilALAE

StyleALAE ist ein impliziter Autoencoder auf Basis des StyleGAN-Generators.Es kann nicht nur 1024 x 1024 Gesichtsbilder mit einer mit StyleGAN vergleichbaren Bildqualität generieren, sondern auch Gesichtsrekonstruktionen und Attributänderungen basierend auf realen Bildern mit derselben Auflösung durchführen.

Der StyleALAE-Encoder verwendet eine Instance-Normalization-Schicht (IN), um mehrskalige Stilinformationen zu extrahieren.Diese Informationen werden durch eine lernbare multilineare Abbildung zu einem impliziten Code w kombiniert.

Verwandte Artikel:Hier

Projektadresse:Hier

StyleFlow

Während es mit StyleGAN einfach ist, qualitativ hochwertige, vielfältige und realistische Bilder zu generieren, ist es nicht einfach, den Generierungsprozess mithilfe (semantischer) Attribute zu steuern und gleichzeitig eine qualitativ hochwertige Ausgabe aufrechtzuerhalten.Darüber hinaus aufgrund der verschränkten Natur des latenten GAN-Raums,Das Bearbeiten einer Eigenschaft kann leicht zu Änderungen an anderen Eigenschaften führen.

Um die bedingte Exploration des verschränkten latenten Raums zu lösen,Probleme mit attributbedingter Stichprobennahme und attributbedingter Bearbeitung,Forscher schlugen StyleFlow vor.

Verwenden Sie StyleFlow, um eine nicht-sequenzielle Bearbeitung realer Bilder durchzuführen.Für extreme Bilder wie ältere Menschen und asymmetrische Bilder,Die Wirkung ist besser als bei der gleichzeitigen Methode.

Verwandte Artikel:Hier

Projektadresse:Hier

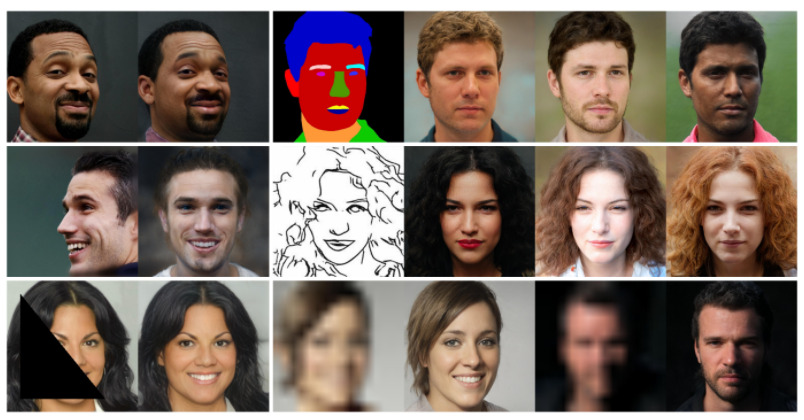

Pixel2style2pixel (pSp)

pSp ist ein StyleGAN-Encoder für die Bild-zu-Bild-Übersetzung. Es basiert auf einem neuartigen Kodierungsnetzwerk, das direkt eine Reihe von Stilvektoren generieren kann.Diese Stilvektoren werden in den vortrainierten StyleGAN-Generator eingespeist, um den erweiterten latenten w+-Raum zu bilden.

In pSp kann der Encoder das reale Bild ohne zusätzliche Optimierung direkt in w+ einbetten.Und der Encoder kann die Bild-zu-Bild-Konvertierungsaufgabe direkt lösen und sie als Kodierungsproblem vom Eingabebereich zum latenten Bereich definieren.

pSp kann ohne Änderung der Struktur verwendet werden.Bewältigen Sie eine Vielzahl von Bildkonvertierungsaufgaben,Wie etwa das Generieren von Gesichtsbildern aus Segmentierungskarten, Frontalansichten von Gesichtern, Superauflösung usw.

Verwandte Artikel:Hier

Projektadresse:Hier

GenForce

GenForce ist eine effiziente PyTorch-Bibliothek für tiefe generative Modelle wie StyleGAN, StyleGAN2 und PGGAN.Es verfügt über die folgenden Funktionen:

1. Verteiltes Trainingsframework

2. Schnelle Trainingsgeschwindigkeit

3. Modulares Design, geeignet für das Prototyping neuer Modelle

4. Im Vergleich zur offiziellen TF-Version ist das Training von StyleGAN stark reproduziert

5. Enthält viele vortrainierte GAN-Modelle mit Colab-Demos

Verwandte Artikel:Hier

Projektadresse:Hier

Über OpenBayes

OpenBayes ist eine führende Forschungseinrichtung für maschinelle Intelligenz in China.Bietet eine Reihe grundlegender Dienste im Zusammenhang mit der KI-Entwicklung, darunter Rechenleistungscontainer, automatische Modellierung und automatische Parameteranpassung.

Gleichzeitig hat OpenBayes auch viele gängige öffentliche Ressourcen wie Datensätze, Tutorials und Modelle veröffentlicht.Damit Entwickler schnell lernen und ideale Modelle für maschinelles Lernen erstellen können.

Besuchen Sie openbayes.com und registrieren Sie sich jetzt

Jetzt genießen

600 Minuten/Woche vGPU

Und 300 Minuten/Woche kostenlose CPU-Rechenzeit

Handeln Sie jetzt und verwenden Sie BabyGAN, um vorherzusagen, wie Ihre zukünftigen Kinder aussehen werden!

Komplettes Tutorial-Portal:Hier

Colab-Portal:Hier