Command Palette

Search for a command to run...

Ich Dachte, Deepfake Würde Die US-Wahl Beeinflussen, Aber Es Stellte Sich Heraus, Dass Sich Die Internetnutzer Zu Viele Sorgen Machten

Vor der US-Wahl 2020 herrschte große Sorge, dass Fake News und Fake-Videos das Wahlergebnis beeinflussen könnten. Mit der Veröffentlichung der vorläufigen Wahlergebnisse scheinen sich alle vorherigen Befürchtungen nicht bewahrheitet zu haben.

Die weltweit beachtete US-Wahl erreichte am 7. November, Ortszeit in den Vereinigten Staaten, endlich ein Zwischenergebnis. Nach vier Tagen intensiver Stimmenauszählung hat Biden mehr als 270 Wahlmännerstimmen erhalten und mehrere etablierte amerikanische Medien haben ihn zum Sieger erklärt.

Schon lange vor der Wahl sagten viele Menschen voraus, dass Deepfake-Videos bei der US-Wahl 2020 eine tragende Rolle spielen und die Wahl beeinflussen würden. Viele soziale Plattformen und sogar das US-Repräsentantenhaus suchen nach Strategien, um Deepfakes im Vorfeld entgegenzuwirken.

Hatte Deepfake nun, da die Wahlen 2020 vorbei sind, im Rückblick auf den gesamten Wahlprozess wirklich den Einfluss auf die US-Wahl, den alle befürchtet hatten?

Sich selbst schönreden und den Gegner verunglimpfen? Trump liebt Deepfakes

Die Deepfake-Technologie scheint seit ihrer Einführung zum Missbrauch bestimmt zu sein, insbesondere im politischen Bereich.

Einem im September veröffentlichten Bericht des US-amerikanischen Business-Intelligence-Unternehmens Creopoint zufolge, kurz vor den US-Wahlen,Posten im InternetDie Zahl der gefälschten Videos hat sich im vergangenen Jahr um das Zwanzigfache erhöht.

Die Hauptziele der gefälschten Videos sind Prominente und Führungskräfte. Creopoint sagte:60 % der auf der Plattform gefundenen gefälschten Videos richteten sich gegen Politiker.

Diese gefälschten Videos, die sich gegen die amerikanische Politik richten, verherrlichen im Allgemeinen eine Partei und verunglimpfen die andere. Darüber hinaus hinterlässt diese Art von Video bei den Menschen am ehesten einen tiefen Eindruck und lässt sich leicht verbreiten, sodass es letztlich die Beurteilung der Kandidaten durch die Wähler beeinflussen kann.

Trump wird glorifiziert

Im Mai dieses Jahres postete der Twitter-Nutzer @mad_liberals ein Deepfake-Video. In dem Video wurde Trump per Photoshop in eine Szene aus dem Science-Fiction-Film „Independence Day“ eingefügt. Im Stück „verwandelte“ sich Trump in Präsident Thomas Whitmore und hielt eine Rede mit den Worten „Wir müssen um unser Überleben kämpfen“, wobei er wie ein Held aussah. Auch das Publikum wurde durch das Trump unterstützende Team des Weißen Hauses „ersetzt“.

Trump retweetete dieses gefälschte Video damals freudig und das Video wurde in dieser Nacht mehr als 10 Millionen Mal abgespielt.

Biden wird verteufelt

Trump ist außerdem sehr daran interessiert, einige Deepfake-Videos weiterzuleiten, die seinen Rivalen Biden verunglimpfen.

Im April dieses Jahres retweetete Trump auf Twitter ein gefälschtes Video, in dem Biden die Zunge herausstreckt, mit der Überschrift „Sloppy Joe“, um Bidens Image zu schädigen.

Allerdings hatte Trumps Weiterleitung solcher gefälschter Videos oder Bilder, die seine Gegner diffamieren, nicht immer einen positiven Einfluss auf ihn selbst. Einige Wähler kommentierten enttäuscht: „Ein echter Präsident würde solche seltsamen Inhalte nicht weiterleiten.“

Tatsächlich wird niemand mit einem gewissen Maß an Urteilsvermögen diesen gefälschten Videoinhalten Glauben schenken. Es lässt sich jedoch kaum vermeiden, dass eine bestimmte Gruppe von Menschen dennoch verwirrt und in die Irre geführt wird, was sich letztlich auf ihre Wahlentscheidung bei den Parlamentswahlen auswirken kann.

Medien veröffentlichen Deepfake-Video und warnen Internetnutzer vor schwerwiegenden Konsequenzen

Im April 2018 arbeitete der amerikanische Schauspieler Jordan Peele mit dem amerikanischen Online-Nachrichtenmedienunternehmen BuzzFeed zusammen, um mithilfe von KI-Technologie ein gefälschtes Video von Obamas Rede zu erstellen.

Das Video verwendet Peeles Rede als Quellvideo und überträgt dann dessen Bewegungen auf das Bild von Obama.

Obamas Gesichtsausdruck und Verhalten wirken im Video sehr natürlich, ohne Anzeichen einer Gesichtsveränderung. Hätten der Produzent Jordan Peele und BuzzFeed die Wahrheit nicht persönlich enthüllt, wären wahrscheinlich viele Menschen getäuscht worden.

Das Produktionsteam sagte, dass sie für die Erstellung des Videos mit Adobe After Effects und dem KI-basierten Gesichtsveränderungstool FakeApp insgesamt nur 60 Stunden benötigt hätten.

Sie sagten, sie hätten dieses Video gemacht und veröffentlicht.Es soll ein Appell an alle sein und sie daran erinnern, dem, was sie im Internet sehen oder hören, nicht zu trauen, insbesondere solchen Deepfake-Videos.

Mithilfe von KI-Technologie und verschiedenen kostenlosen Programmen zur Gesichtsveränderung und Synchronisierung ist die Hemmschwelle für die Fälschung von Videos gesunken und einige technische Experten haben Angst vor den möglichen Folgen dieser Technologien.

„Wenn jemand diese Technologie nutzt, um realistische Fake-Videos zu erstellen und damit falsche Informationen zu verbreiten, oder wenn sogar Medien und Parteiteams sie nutzen, um falsche Propaganda zu betreiben, werden die Folgen verheerend sein.“

Diese Sorge ist nicht unbegründet.

Im Februar dieses Jahres nutzte Manoj Tiwari, einer der Kandidaten der Bharatiya Janata Party (BJP), bei den Parlamentswahlen im indischen Bundesstaat Delhi eine Videobetrugstechnologie, um eine ihm unbekannte Sprache zu „sprechen“ und so Stimmen zu sammeln und Wähler mit Minderheitssprachen für sich zu gewinnen.

Dieses Video hat gute Ergebnisse erzielt. Die meisten Leute konnten darin keine Mängel erkennen, sodass es nicht nur zunächst keinen Verdacht gab, sondern auch die Reaktion sehr enthusiastisch war, was dem Kandidaten weitere Stimmen einbrachte.

Am Ende zweifelten vorsichtige Internetnutzer immer noch an der Echtheit des Videos. Später bestätigte das Technologiemedium Vice, dass es sich tatsächlich um ein Deepfake-Video handelte und dass es von der Indischen Volkspartei selbst und in Zusammenarbeit mit einer PR-Firma produziert worden war (siehe Details).„Bei den indischen Parlamentswahlen nutzen Kandidaten DeepFake, um Dialektvideos zu fälschen und so Stimmen zu gewinnen.“).

Aus diesem Grund äußerte Jean-Claude Goldenstein, CEO des oben erwähnten amerikanischen Business-Intelligence-Unternehmens Creopoint, einst seine tiefe Besorgnis über diese US-Wahl.

Er sagte:„Es gibt viel mehr gefälschte Videos, als Sie sich vorstellen können, und was noch beängstigender ist: Die Technologie und die Werkzeuge zur Erstellung dieser Videos entwickeln sich schneller, als sie geknackt werden können.“ Goldenstein sagte sogar, dass „die Präsidentschaftswahlen als gefälschte Videowahlen bezeichnet werden sollten“.

So beseitigen Sie die Folgen von Deepfake: Stärkung der Erkennung und Gesetzgebung

Glücklicherweise hat Deepfake bei den diesjährigen US-Wahlen jedoch nicht nur keine Probleme verursacht, sondern spielte nicht einmal eine Nebenrolle. Nach Ansicht einiger Fachleute kann dies auf die folgenden zwei Hauptgründe zurückgeführt werden.

Soziale Plattformen bereiten sich auf schlechte Zeiten vor: Präzisionsschläge

In den Monaten vor der Wahl haben die großen sozialen Medienplattformen verstärkt öffentliche Schritte unternommen, um Inhalte zu überprüfen und zu identifizieren und falsche Inhalte, wie etwa gefälschte Videos, umgehend zu löschen.

Facebook:

Im vergangenen September startete Facebook eine Herausforderung zur Erkennung von Deepfake,Ziel ist es, mit den entwickelten Tools gefälschte Videos von Regierungen, Medien, Unternehmen usw. zu erkennen.

Im Januar dieses Jahres veröffentlichte Facebook einen Blogbeitrag, in dem es ankündigte, Deepfake-Videos und Inhalte mit irreführenden Informationen vor der Wahl zu löschen.

Twitter:

Im Februar dieses Jahres kündigte Twitter eine neue Richtlinie zu synthetischen und manipulierten Medien an. Das Unternehmen kündigte an, gegen Medieninhalte vorzugehen, die erheblich verändert oder verfälscht wurden, beispielsweise durch Bearbeitung, Zuschneiden, Synchronisation oder fiktive Bilder realer Personen. Twitter versieht derartige Inhalte mit einem Warnhinweis.

Zum Beispiel,Zuvor hatte ein Benutzer, der Trump unterstützt, ein Video gepostet, in dem er mithilfe der Deepfake-Technologie Biden ein wenig verrückt aussehen ließ.Er sagte: „Können Sie sich vorstellen, dass Biden Präsident der Vereinigten Staaten wird? Er kann nicht einmal eine einfache Frage beantworten oder eine einfache Aussage machen?“ und wurde daraufhin von Twitter mit einem Warnhinweis versehen.

Wissenschaftliche Forschungseinrichtungen arbeiten aktiv an der Verbesserung der Erkennungsalgorithmen

Um zu verhindern, dass die Wahl durch Deepfakes manipuliert wird, entwickeln große Forschungseinrichtungen und Technologiegiganten aktiv Algorithmen zur Bekämpfung von Deepfake-Inhalten.

Google:

Im vergangenen September veröffentlichte Google eine Open-Source-Datenbank mit 3.000 KI-generierten Videos, die mithilfe verschiedener öffentlich verfügbarer Algorithmen erstellt wurden. Google hat diesen Datensatz mit dem Ziel erstellt, eine große Anzahl von Beispielen zu erstellen, um das Trainieren und Testen automatischer Deepfake-Erkennungstools zu unterstützen.

Intel und Binghamton University:

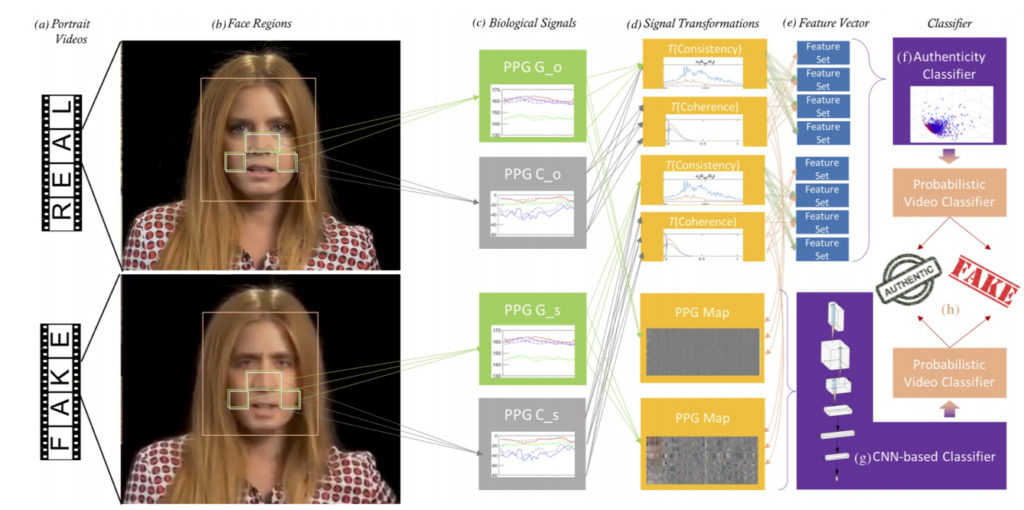

Im September dieses Jahres entwickelten Forscher der Binghamton University und Intel einen Algorithmus, derEs wird behauptet, dass es anhand des Herzschlagsignals im Video erkennen kann, ob das Video gefälscht ist, und zwar mit einer Genauigkeit von bis zu 90%.Darüber hinaus kann der Algorithmus auch die spezifischen Generierungsmodelle hinter Deepfake-Videos (wie Face2Face, FaceSwap usw.) erkennen.

Microsoft:

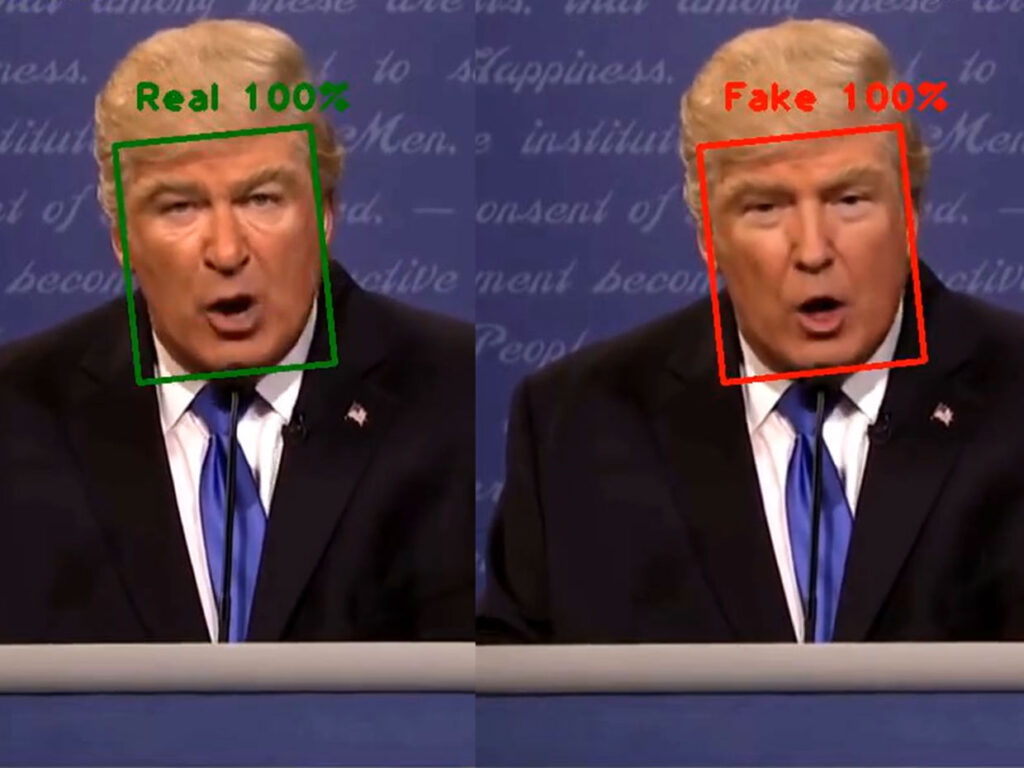

Im September dieses Jahres, am Vorabend der Wahl, veröffentlichte Microsoft ein Deepfake-Erkennungstool namens „Video Authenticator“, das durch die Anzeige eines Vertrauenswerts oder des „Prozentsatzes“ der Manipulation und Änderung angibt, ob es sich bei einem Video um Deepfake-Inhalte handelt.

Da soziale und mediale Plattformen immer besser in der Lage sind, gefälschte Inhalte zu erkennen, werden solche Videos letztendlich im Keim erstickt.

Gleichzeitig werden die bisherigen Gesetzeslücken sukzessive verbessert und auch die Verantwortlichkeit der Videofälscher für die nachteiligen Folgen soll für Klarheit sorgen.

So heißt es beispielsweise im Zivilgesetzbuch meines Landes, das im Mai dieses Jahres verabschiedet wurde, eindeutig, dass der Einsatz von Technologie zur Manipulation von Videos eine Verletzung des Rechts am eigenen Bild darstellt, und zwar in Artikel 1019 des Gesetzes (siehe„Gesichtsveränderung durch KI, Stimmmanipulation usw. sind in der neuen Fassung des Bürgerlichen Gesetzbuches klar verankert.“).

Artikel 1019 [Negative Macht der Bildrechte] Keine Organisation oder Einzelperson darf diffamieren, verunstalten, Oder die Verwendung von Informationstechnologie zur Fälschung oder Verletzung der Bildrechte anderer.Niemand darf das Porträt eines Porträtrechtsinhabers ohne die Zustimmung des Porträtrechtsinhabers herstellen, verwenden oder offenlegen, sofern gesetzlich nichts anderes bestimmt ist.

Unter der doppelten Aufsicht von Technologie und Recht könnten die Produzenten und Verbreiter gefälschter Videos einen höheren Preis für ihre Taten zahlen. Wenn sie sich politisch engagieren möchten, ist das möglicherweise nicht so einfach.

An dieser Stelle sind die zu Beginn unseres Artikels aufgeworfenen Fragen beantwortet. Deepfake hat bei der diesjährigen US-Wahl weder für Aufsehen gesorgt, noch die Wahl beeinflusst, sodass die vorherigen Bedenken der Internetnutzer völlig übertrieben waren. Allerdings dürfen die entsprechenden Kontrollen auch in Zukunft nicht nachlassen und wir müssen stets verhindern, dass die Technologie Böses anrichtet.

-- über--