Command Palette

Search for a command to run...

Worüber Wurde Beim TF Dev Summit in Der Ersten Online-Liveübertragung Gesprochen?

Der jährliche TensorFlow Dev Summit fand vor Kurzem statt. Aufgrund der Auswirkungen der neuen Coronavirus-Pandemie fand der Gipfel zum ersten Mal vollständig online statt.

Die Live-Übertragung fand am 12. März von 0:30 bis 8:00 Uhr Pekinger Zeit statt. Dieses jährliche Event für Entwickler von maschinellem Lernen ließ zahllose chinesische Zuschauer lange aufbleiben, um die Live-Übertragung zu sehen. Welche großen Tricks hat TensorFlow (kurz TF) also veröffentlicht?

Wir werden einige dieser Aspekte herausgreifen und einen kurzen Überblick über die Highlights geben.

TensorFlow: Das beliebteste ML-Framework

Die Konferenz wurde mit einer Grundsatzrede von Megan Kacholia eröffnet.

Megan Kacholia ist technische Leiterin von TensorFlow und Google Brain mit Schwerpunkt auf TensorFlow. Sie arbeitet seit vielen Jahren bei Google und ihr Arbeitsschwerpunkt besteht darin, große verteilte Systeme zu untersuchen und Wege zu finden, die Leistung zu verbessern und zu steigern.

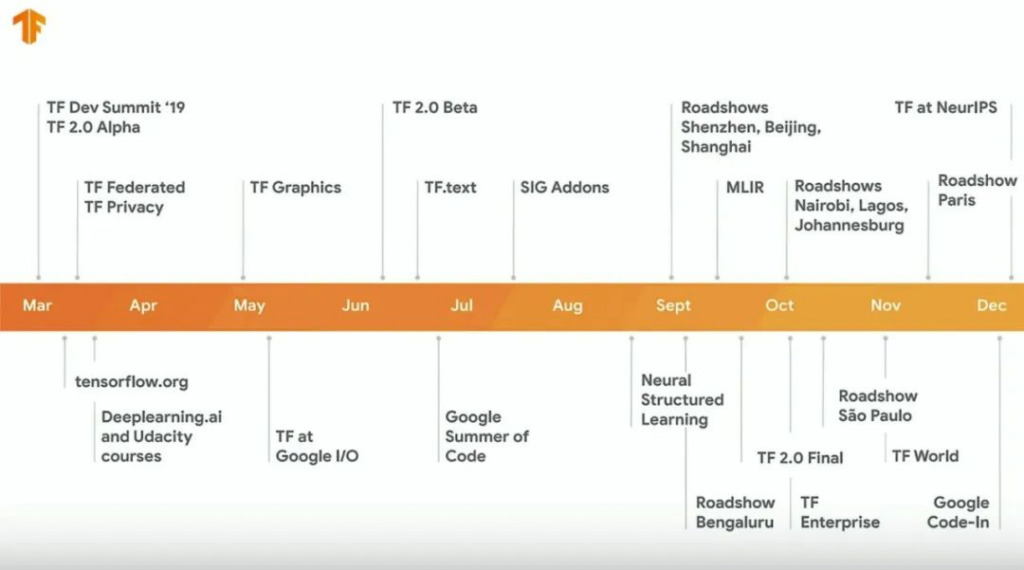

In der Keynote-Session wurden wie üblich einige Erfolge von TF im letzten Jahr vorgestellt, darunter Großveranstaltungen, Nutzung durch die Öffentlichkeit usw.

Die aktuelle Nutzung von TF hat 76 Millionen Downloads, mehr als 80.000 Einsendungen, über 13.000 Pull Requests und mehr als 2.400 Mitwirkende erreicht, was deutlich zeigt, dass TF das beliebteste Framework für maschinelles Lernen ist.

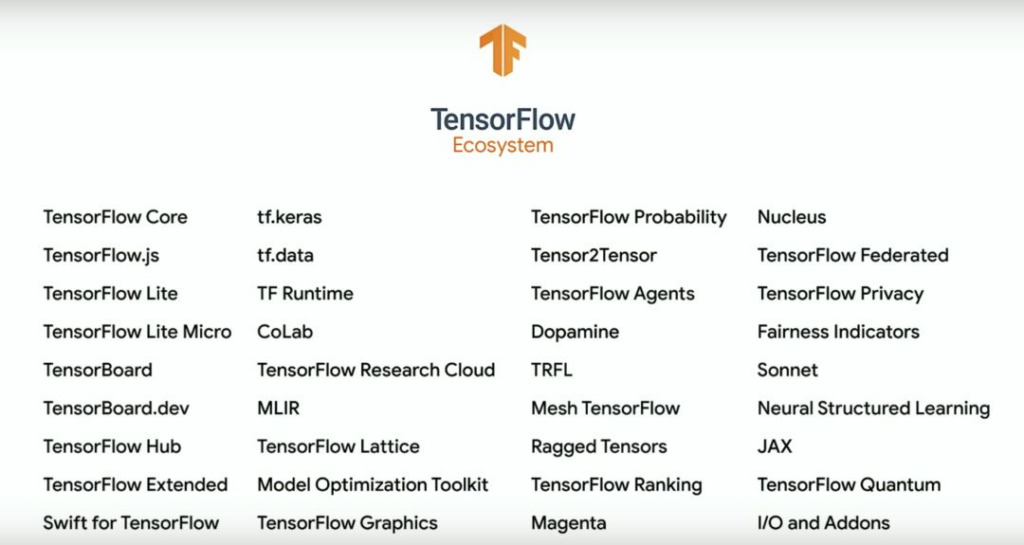

Der Schwerpunkt der Keynote-Sitzung lag auf den drei großen Jungs, die das TensorFlow-Ökosystem vorstellten.

Mit der Entwicklung von TF im Laufe der Jahre haben die zugehörigen Tools nach und nach ein leistungsstarkes Ökosystem gebildet, das viele nutzbare Bibliotheken und Erweiterungskomponenten sowie verschiedene Anwendungen für verschiedene Aufgaben umfasst.

Megan Kacholia konzentrierte sich zunächst auf die Einführung in die Verwendung von TF und gab eine detaillierte Einführung aus drei Blickwinkeln: Forschung im Zusammenhang mit TF, tatsächliche Fälle in der Realität sowie Entwicklung und Bereitstellung für jeden Benutzer.

Anschließend stellte Manasi Joshi die ethischen Standards von TF für KI vor und beschrieb, wie Geschlechterdiskriminierung vermieden und Fairness, Erklärbarkeit, Datenschutz, Sicherheit und andere Probleme beim Einsatz von KI sichergestellt werden können. Außerdem listete er eine Reihe von Tools auf, die TF zur Lösung dieser Probleme einsetzt.

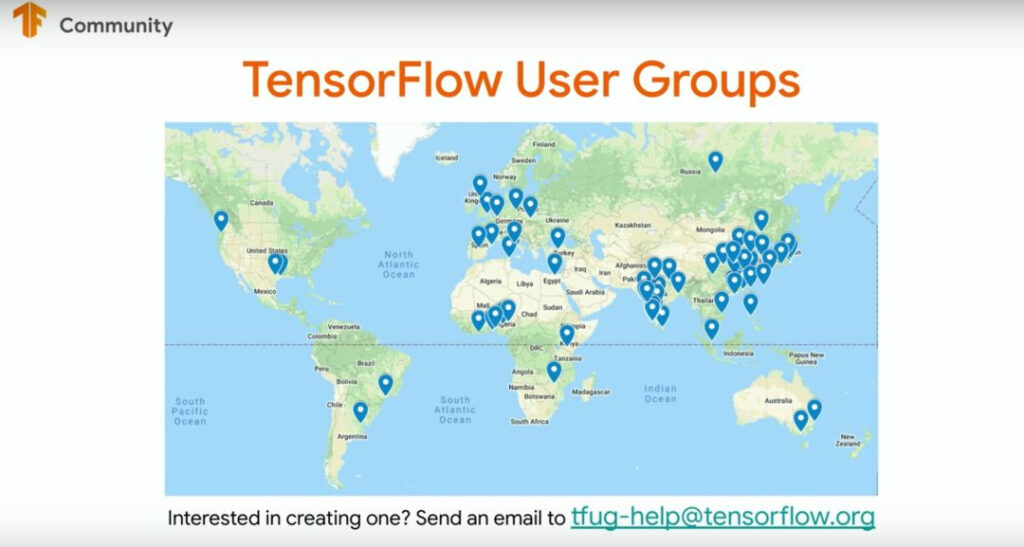

Abschließend stellte Kemal El Moujahid die TF-Community und die weltweite Verteilung der Community-Mitglieder vor, demonstrierte eine Reihe von Aktivitäten der Community und aktualisierte Ressourceninhalte wie den Crashkurs zum maschinellen Lernen.

Eine neue Version kommt! TF 2.2 wird still und leise veröffentlicht

Im Vergleich zum TF-Ökosystem, das in der Keynote so ausführlich besprochen wurde, scheint die neueste Version TF 2.2, die dieses Mal veröffentlicht wurde, viel unauffälliger zu sein.

Als neue Version bringt sie aber auch einige wichtige Updates mit sich. Bei TF 2.2 wurden hauptsächlich in drei Bereichen Anpassungen vorgenommen: mehr Wert auf die Leistung gelegt, in das TF-Ökosystem integriert und die Kernbibliothek stabilisiert.

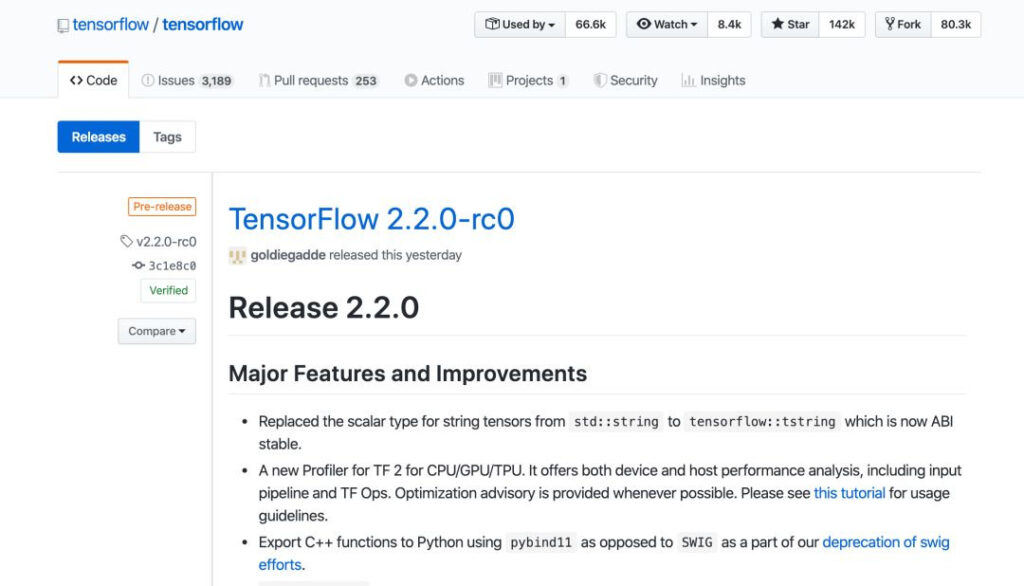

Diese Version ist jetzt auf Github verfügbar:

https://github.com/tensorflow/tensorflow/releases

Die wichtigsten Funktionen und Verbesserungen sind:

1) Skalartyp des String-Tensors von std::string durch tensorflow::tstring ersetzt, jetzt ist ABI stabiler.

2) Neuer Profiler für CPU/GPU/TPU. Es bietet eine Geräte- und Host-Leistungsanalyse, einschließlich Eingabepipeline und TF Ops. Geben Sie nach Möglichkeit Optimierungsvorschläge.

3) Swig verwerfen und pybind11 verwenden, um C++-Funktionen nach Python zu exportieren, anstatt SWIG zu verwenden.

Weitere Updates finden Sie in tf.keras, tf.lite und XLA, die auf GitHub angezeigt werden können.

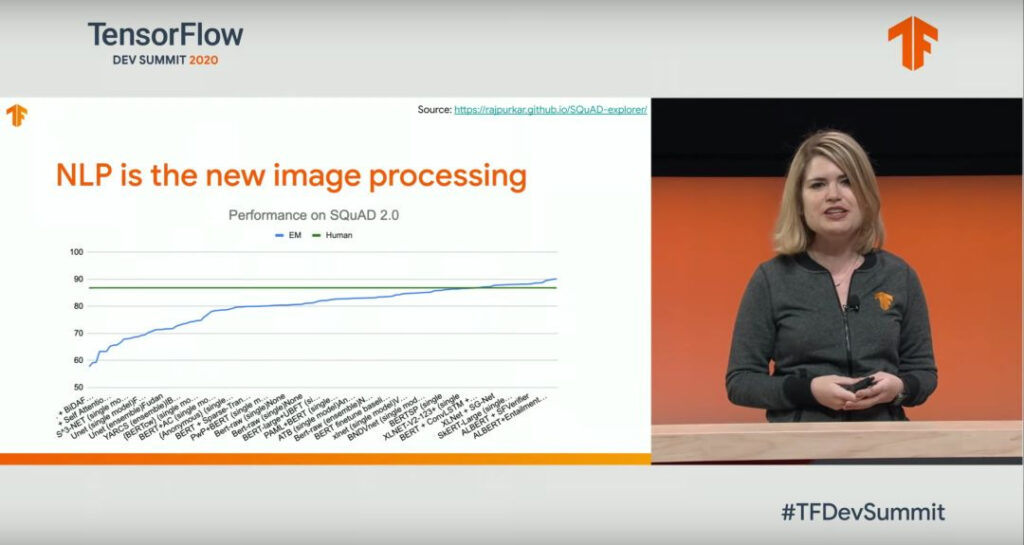

Eine Revolution im NLP? Bildverarbeitung hinzufügen

Unmittelbar nach der Keynote-Sitzung wurde der Fortschritt von TensorFlow in NLP vorgestellt und der Sprecher hielt eine Keynote-Rede zum Thema „Lesen lernen mit TensorFlow und Keras“.

Der Bericht stellt fest, dass die Verarbeitung natürlicher Sprache (NLP) einen Wendepunkt erreicht hat. Daher konzentriert sich die aktuelle Forschung darauf, wie sich TF und Keras nutzen lassen, um die Vorverarbeitung, das Training und die Hypertuning-Optimierung von Textmodellen zu vereinfachen.

Ein Punkt wird hervorgehoben: NLP ist eine neue Art der Bildverarbeitung.

Der Sprecher führte das Beispiel eines Kindes an, das durch Betrachten von Dingen das Schreiben lernt, und sagte, dass TF begonnen habe, seine NLP-Leistung aus der Perspektive der Bildverarbeitung zu verbessern.

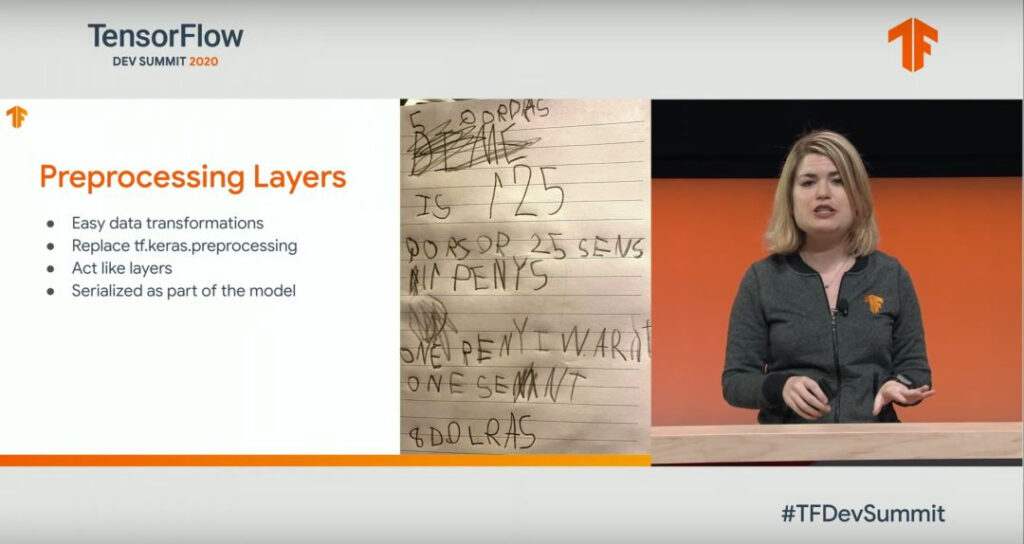

Tatsächlich hat TF seit Version 2.X Proprocessing Layers eingeführt. Diese Verbesserung umfasst die folgenden Funktionen:

Es ist einfacher, Daten zu konvertieren, indem das Programm tf.keras ersetzt wird, das als Verarbeitungsschicht durch eine Abfolge von Modellen fungiert.

Um zu beweisen, dass NLP eine neue Bildverarbeitung ist, verglich der Dozent auch die Proprocessing-Ebenen im Bildbereich und im NLP-Bereich und wies auf einige ihrer Gemeinsamkeiten hin.

TF Lite-Upgrade: mehr Wert auf das Handy-Erlebnis

Da Mobiltelefone im täglichen Leben immer wichtiger werden, legt TF mehr Wert auf das Benutzererlebnis bei Edge-Geräten. Dieses Mal haben wir auch einen Keynote-Bericht verwendet, um einige Updates zu TensorFlow Lite mitzuteilen.

Der Inhalt umfasst, wie ML durch neue Technologien von TF schneller und sicherer auf Mobiltelefonen, eingebetteten Geräten oder anderen Terminals bereitgestellt werden kann.

Derzeit ist TF auf Milliarden von Edge-Geräten im Einsatz und wird von mehr als 1.000 mobilen Apps verwendet. Es ist das beliebteste plattformübergreifende ML-Framework im Bereich mobiler Geräte und Mikrocontroller.

Zu den Inhalten, die dieses Mal im Vordergrund standen, zählen die Anpassung an verschiedene Geräte, die Entwicklung einer Reihe von Toolkits für eine optimale Leistungsverarbeitung, eine kontinuierliche Verbesserung der Unterstützung für Edge-Leistung, die Möglichkeit zur Verwendung in Offline-Situationen und eine stärkere Betonung von Datenschutz- und Sicherheitsfunktionen.

In Bezug auf die neu hinzugefügte TF Lite-Erweiterungsbibliothek wurden weitere Bild- und Sprach-APIs hinzugefügt, die Android Studio-Integration hinzugefügt und Funktionen wie die Codegenerierung verbessert.

Der Bericht veröffentlichte auch Core ML Delegation, das die Gleitkomma-Rechengeschwindigkeit auf Apples Endgeräten durch den Core ML-Agenten des neuronalen Chips von Apple beschleunigen kann.

Abschließend gaben wir auch einen Ausblick auf die Folgeentwicklungen. Es wird weitere Methoden zur CPU-Optimierung geben, wie beispielsweise in TensorFlow Lite 2.3, die größere Leistungsverbesserungen bringen, und ein neuer Modellkonverter wird standardmäßig in TF 2.2 enthalten sein.

Nuke: TF Quantum veröffentlicht

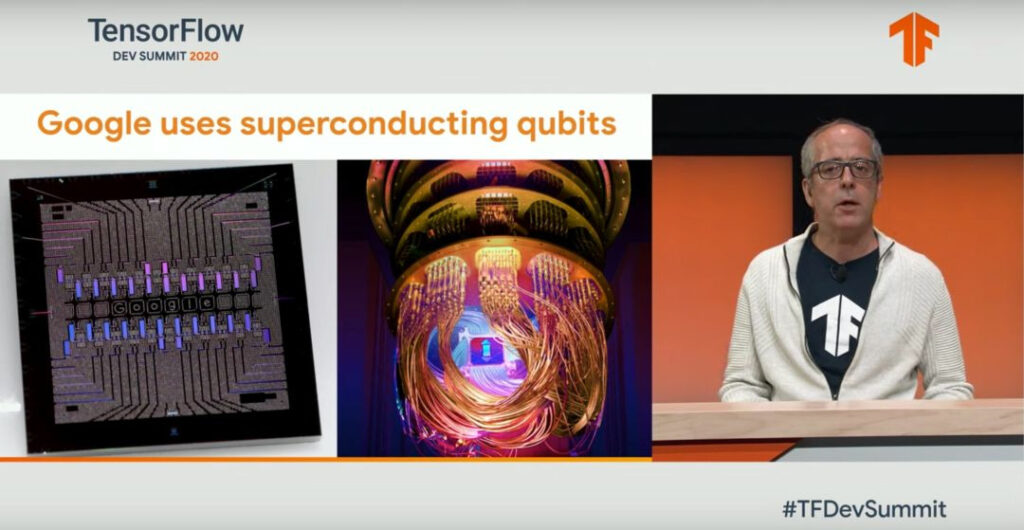

Gegen Ende des Gipfels erschien Masoud Mohseni und stellte noch einmal das kürzlich angekündigte Open Source TensorFlow Quantum vor, eine Bibliothek für maschinelles Lernen zum Trainieren von Quantenmodellen.

Die Grundsatzrede war sehr lang und dauerte fast eine halbe Stunde. Sie erläuterte die Prinzipien des Quantencomputings und die Probleme, die TF Quantum lösen möchte.

TFQ bietet die notwendigen Werkzeuge, um die Forschung im Bereich Quantencomputing und maschinelles Lernen zusammenzuführen, um natürliche oder künstliche Quantensysteme zu steuern und zu modellieren.

Insbesondere konzentriert sich TFQ auf die Quantendatenverarbeitung und erstellt ein hybrides quantenklassisches Modell, das in Cirq entwickelte Quantencomputeralgorithmen und -logik integriert und eine mit der vorhandenen TensorFlow-API kompatible Quantencomputereinheit sowie einen leistungsstarken Quantenschaltkreissimulator bereitstellt.

In der Rede wurde darauf hingewiesen, dass Google TFQ auf hybride quantenklassische Convolutional Neural Networks, quantengesteuertes maschinelles Lernen, hierarchisches Lernen von quantenneuronalen Netzwerken, quantendynamisches Lernen, generative Modellierung hybrider Quantenzustände und Lernen von quantenneuronalen Netzwerken durch klassische rekursive neuronale Netzwerke angewendet hat.

Dieses Tool wird auch zum Erlernen von Quantenneuronalen Netzwerken und anderen Anwendungen durch klassische rekurrierende neuronale Netzwerke verwendet. Dies wird dem Bereich des Quantencomputings erhebliche Impulse verleihen.

Obwohl die Erklärung der Prinzipien in der Rede viel Aufwand erfordert, ist die konkrete Anwendung nicht schwierig:

Sie können es verwenden, indem Sie relevante Bibliotheken und Definitionen einführen, das Modell definieren, das Modell trainieren und das Modell schließlich zur Vorhersage verwenden.

Diese Live-Übertragung ist sehenswert

Zusätzlich zu den oben genannten Inhalten fanden auf dem TensorFlow Dev Summit auch viele andere Sharing-Sitzungen statt.

Einschließlich der Verwendung von TF für wissenschaftliche Forschung, einer Einführung in TF Hub, Forschung zu kollaborativem ML, der Verwendung von TF in Google Cloud, Diskussionen über fairen Datenschutz bei der Verwendung von KI und mehr.

Während der fast 8-stündigen Live-Übertragung wurden alle Aspekte von TensorFlow demonstriert. Obwohl es sich dabei um die erste umfassende Online-Liveübertragung handelte, enthielt sie viele nützliche Inhalte, für die es sich lohnte, lange aufzubleiben.

Wenn Sie weitere Informationen wünschen, können Sie sich die aufgezeichnete Sendung dieser Veranstaltung noch einmal ansehen:

https://space.bilibili.com/64169458

-- über--