Von Super Neuro

In den letzten Tagen wurde in China ein schwerwiegender Fall aufgedeckt, bei dem es um den Verdacht eines Datenlecks ging. Bis zu elf Unternehmen waren daran beteiligt und es wurden 4.000 GB und mehrere zehn Milliarden Bürgerdaten beschlagnahmt. Betroffen waren darunter auch namhafte inländische Big-Data-Unternehmen.

Bei den in diesem Fall betroffenen Daten handelt es sich um höchst private Daten. Die in dem Fall betroffenen Internet-URL-Daten umfassen mehr als 40 Informationselemente wie Mobiltelefonnummern und Internet-Basisstationscodes, die das spezifische Internetverhalten von Mobiltelefonnutzern aufzeichnen. Einige der Daten können sogar direkt auf die Homepage der persönlichen Konten der Bürger gelangen.

Wenn Sie KI entwickeln möchten, ist die Nutzung von Daten unvermeidlich?

Für Forschungs- und Entwicklungsingenieure in allen KI-Unternehmen der Welt ist die Möglichkeit, große Mengen realer Daten zu erhalten, für die Entwicklung von KI-Modellen äußerst hilfreich. Noch besser wäre es, wenn die Daten eine hohe Reinheit aufweisen würden. Sie können Daten bequemer verarbeiten und Modelle effizienter vergleichen und bewerten und so zu richtigen Lösungen für reale Probleme gelangen.

Aus Gründen der Datenvertraulichkeit können diese Giganten jedoch nur sehr begrenzte Daten austauschen. Daher ist der Kauf von Daten großer Unternehmen in der Branche tatsächlich eine gängige Praxis.

Nicht nur in China, sondern weltweit haben Benutzer kein besonders klares Verständnis für den Datenschutz und die Vertraulichkeit von Daten. Bei der Nutzung verschiedener Internetprodukte müssen Sie in der „Nutzungsvereinbarung“ „Ja“ auswählen.

Die Großen kaufen die Daten, und was dann?

Die Großen haben viel Geld für den Kauf der Daten ausgegeben, also werden sie diese Daten natürlich effizient nutzen.

Sie kaufen Daten, sammeln Daten mithilfe ihrer eigenen Produkte und entwickeln sicherere Verschlüsselungsmethoden zum Schutz ihrer Daten.

Es ist wahr, dass die Schwachen immer schwach sein werden und die Starken immer stark sein werden

Lassen Sie uns als Ingenieure über mehrere häufig verwendete Datenverschlüsselungsmethoden sprechen und darüber, wie man ihre Eigenschaften und Prinzipien versteht.

Inhärent unzureichender Schutzmechanismus für anonymisierte Daten

Der derzeit am häufigsten verwendete Mechanismus zur Gewährleistung der Vertraulichkeit bei der Datenfreigabe besteht in der Anonymisierung des Datensatzes. In den meisten Fällen ist dies jedoch immer noch keine gute Lösung.

Durch die Anonymisierung von Daten kann die Vertraulichkeit bis zu einem gewissen Grad gewahrt werden, indem einige sensible Daten maskiert werden. Allerdings kann dies nicht verhindern, dass Datenexperten Schlussfolgerungen ziehen. In der Praxis können durch Rückschluss relevanter Informationen die verborgenen sensiblen Daten erschlossen werden.

Zuvor veröffentlichte ein deutscher Forscher eine Arbeit mit dem Titel Bauen Sie Ihre eigene NSAIn der Forschungsarbeit wird darüber gesprochen, wie die Anonymisierung von Daten rückgängig gemacht und die ursprünglichen Informationen gefunden werden können.

Der Forscher erhielt über ein fiktives Unternehmen kostenlosen Zugriff auf Web-Clickstream-Informationen von rund drei Millionen Deutschen im Umfang eines Monats. Diese Informationen werden anonymisiert, beispielsweise durch die Verwendung einer Zeichenfolge aus zufälligen Zeichen. „4vdp0qoi2kjaqgb“KommenErsetzen Sie den echten Namen des Benutzers.

Dem Forscher gelang es, den echten Namen des Benutzers auf der Website anhand seines Browserverlaufs und anderer damit verbundener Informationen abzuleiten. Es ist ersichtlich, dass durch die Anonymisierung von Daten keine vollständige Vertraulichkeit gewährleistet werden kann.

Veranstalter des Chaos Communication Congress ist der Chaos Computer Club Deutschland, die größte Hacker-Allianz Europas. Es untersucht hauptsächlich Fragen der Computer- und Netzwerksicherheit mit dem Ziel, die Computer- und Netzwerksicherheit zu fördern.

So entstand die homomorphe Verschlüsselung

Dies ist einer der Durchbrüche auf dem Gebiet der Kryptographie. Der Entschlüsseler kann nur das Endergebnis kennen, kann aber nicht die spezifischen Informationen zu jedem Geheimtext erhalten.

Homomorphe Verschlüsselung kann die Sicherheit von Informationen wirksam verbessern und könnte sich in Zukunft zu einer Schlüsseltechnologie im Bereich der KI entwickeln, derzeit sind ihre Anwendungsszenarien jedoch begrenzt.

Vereinfacht ausgedrückt bedeutet homomorphe Verschlüsselung, dass meine Daten von Ihnen nach Ihren Bedürfnissen verwendet werden können, Sie jedoch nicht sehen können, um welche Daten es sich konkret handelt.

Obwohl diese Verschlüsselungsmethode effektiv ist, ist der Rechenaufwand zu hoch.

Mithilfe der grundlegenden homomorphen Verschlüsselungstechnologie können 1 MB Daten in 16 GB umgewandelt werden, was in KI-Szenarien sehr kostspielig ist. Darüber hinaus ist die homomorphe Verschlüsselungstechnologie (wie die meisten Verschlüsselungsalgorithmen) normalerweise nicht differenzierbar, was sie für gängige KI-Algorithmen wie den stochastischen Gradientenabstieg (SGD) eher ungeeignet macht.

Derzeit befindet sich die homomorphe Verschlüsselungstechnologie im Wesentlichen noch auf der konzeptionellen Ebene und lässt sich nur schwer in die Praxis umsetzen, aber es gibt Hoffnung für die Zukunft.

Erfahren Sie mehr über die GAN-Verschlüsselungstechnologie

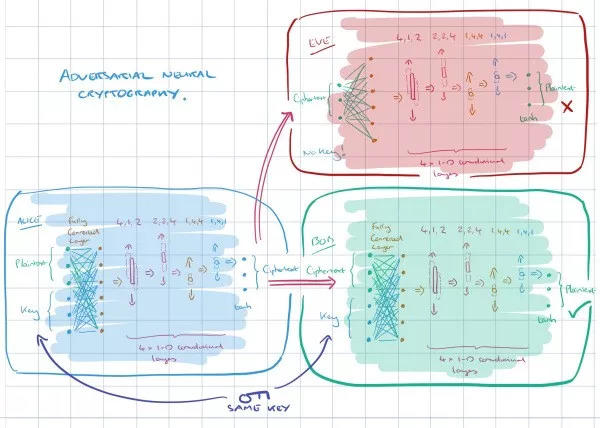

Google veröffentlichte 2016 ein Papier mit dem Titel „Lernen, die Kommunikation mit Adversarial Neural Cryptography zu schützen“Dieser Artikel stellt ausführlich eine GAN-basierte Verschlüsselungstechnologie vor, die das Datenschutzproblem beim Datenfreigabeprozess effektiv lösen kann.

Dabei handelt es sich um eine Verschlüsselungstechnik, die auf neuronalen Netzwerken basiert, die im Allgemeinen als schwierig für die Verschlüsselung zu verwenden gelten, da sie Schwierigkeiten bei der Durchführung von XOR-Operationen haben.

Es stellt sich jedoch heraus, dass neuronale Netzwerke lernen können, Daten vor anderen neuronalen Netzwerken geheim zu halten: Sie können alle Verschlüsselungs- und Entschlüsselungsmethoden entdecken, ohne Algorithmen für die Verschlüsselung oder Entschlüsselung zu generieren.

Wie GAN-Verschlüsselung Daten schützt

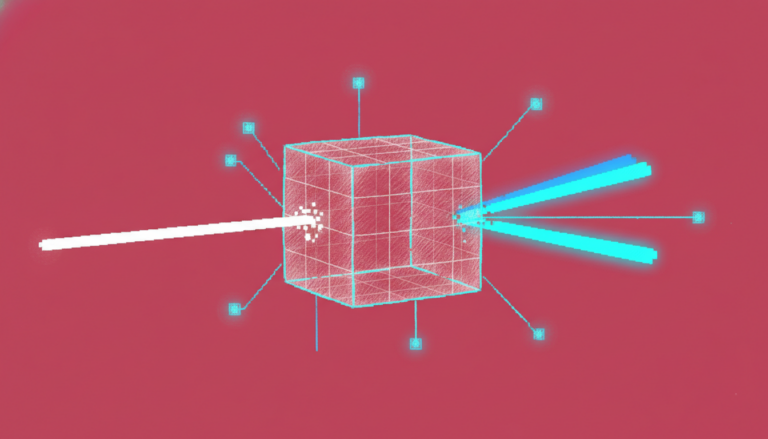

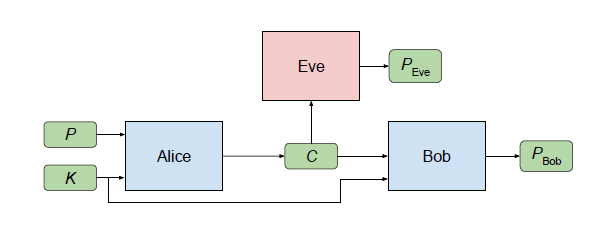

Die Verschlüsselungstechnologie von GAN umfasst drei Aspekte, die wir anhand von Alice, Bob und Eve demonstrieren können. Normalerweise sind Alice und Bob die beiden Enden einer sicheren Kommunikation, und Eve überwacht ihre Kommunikation und versucht, die ursprünglichen Dateninformationen rückwärts zu finden.

Alice sendet Bob eine geheime Nachricht P, die von Alice eingegeben wurde. Wenn Alice diese Eingabe verarbeitet, erzeugt sie eine Ausgabe C („P“ steht für „Klartext“ und „C“ steht für „Chiffretext“).

Bob und Eve erhalten beide C und versuchen, P aus C wiederherzustellen (wir bezeichnen diese Berechnungen mit PBob bzw. PEve).

Bob hat gegenüber Eve einen Vorteil: Er und Alice teilen sich einen geheimen Schlüssel K.

Das Ziel von Eve ist einfach: P exakt zu rekonstruieren (mit anderen Worten, den Fehler zwischen P und PEve zu minimieren).

Alice und Bob möchten klar kommunizieren (um den Fehler zwischen P und PBob zu minimieren), möchten ihre Kommunikation aber auch vor Eve verbergen.

Mithilfe der GAN-Technologie werden Alice und Bob gemeinsam trainiert und können erfolgreich Informationen übertragen, während sie lernen, der Überwachung durch Eve zu entgehen. Der gesamte Prozess verwendet keinen voreingestellten Algorithmus. Nach dem GAN-Prinzip werden Alice und Bob darauf trainiert, die beste Eve zu schlagen, und nicht eine feste Eve.

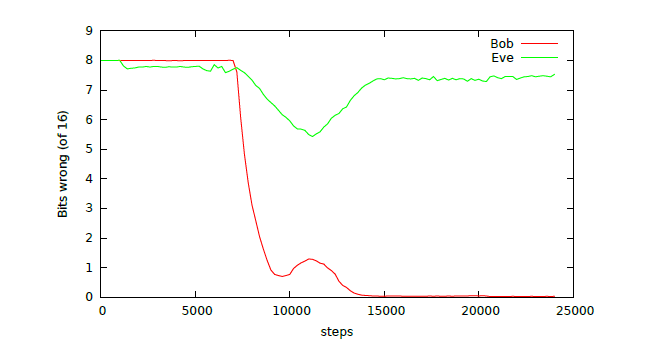

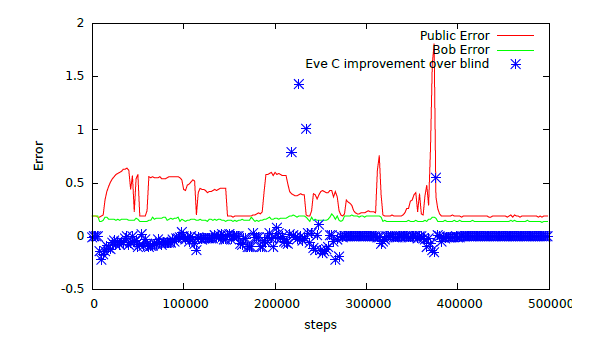

Wie in der Abbildung unten gezeigt, können sowohl Bob als auch Eve nach etwa 8.000 Trainingsschritten mit der Rekonstruktion der ursprünglichen Nachricht beginnen. Nach etwa 10.000 Trainingsschritten scheinen die Netzwerke von Alice und Bob Eve zu entdecken und beginnen, sich in sie einzumischen, wodurch Eves Fehlerrate steigt. Das heißt, Bob kann aus Eves Verhalten lernen und die Kommunikation schützen, wodurch er eine genaue Nachrichtenrekonstruktion erreicht und gleichzeitig Angriffe vermeidet.

Um auf KI-Anwendungen zurückzukommen: Mithilfe der GAN-Verschlüsselungstechnologie können Informationen zwischen Unternehmen und neuronalen Netzwerken ausgetauscht werden, ohne dass ein hohes Maß an Privatsphäre gewahrt werden muss. Es handelt sich um eine praktische Datenschutzlösung für KI-Anwendungen.

Denn das Modell kann lernen, Informationen selektiv zu schützen, indem es einige Elemente des Datensatzes unverschlüsselt lässt, aber jegliche Form von Schlussfolgerungen durch das Auffinden dieser sensiblen Daten verhindert und so die Mängel der Datenanonymisierung effektiv umgeht.

Das Google-Team hat die GAN-Verschlüsselungsarchitektur in einem Modell angepasst, bei dem Alice und Bob immer noch einen Schlüssel gemeinsam nutzen, Alice hier jedoch A, B, C erhält und aus dem Geheimtext D-public generiert.

Sowohl Bob als auch Eve haben Zugriff auf Alices Ausgabe D-public. Bob verwendet sie, um eine verbesserte Schätzung von D zu generieren, und lässt Eve rückwärts arbeiten, um C aus dieser Näherung wiederherzustellen. Ziel ist es zu zeigen, dass inverses Training eine Annäherung an D ermöglicht, ohne C preiszugeben, und dass diese Annäherung mit verschlüsselten Informationen und einem Schlüssel kombiniert werden kann, um Eve besser zu verwirren.

Um zu überprüfen, ob das System Informationen korrekt verbergen kann, haben die Forscher einen Evaluator namens „Blind Eve“ erstellt. Es kennt C, aber nicht D-public und Key, was Eve tut.

Wenn der Rekonstruktionsfehler von Eve dem Rekonstruktionsfehler von Blind Eve entspricht, bedeutet dies, dass Eve keine gültigen Informationen extrahiert hat. Nach einigen Sitzungen hatte Eve keinen Vorteil mehr gegenüber Blind Eve. Dies zeigt, dass Eve allein durch die Kenntnis der Verteilung der C-Werte keine Informationen über C rekonstruieren kann.

Derzeit ist die GAN-Kryptografie eine relativ neue Technologie in gängigen KI-Anwendungen. Konzeptionell könnte die GAN-Verschlüsselungstechnologie es Unternehmen jedoch ermöglichen, Datensätze mit Datenwissenschaftlern zu teilen, ohne die darin enthaltenen sensiblen Daten preiszugeben.

Wenn Sie das Vertrauen der Benutzer gewinnen und Rechtskonflikte vermeiden möchten, ist die Verschlüsselungstechnologie auf lange Sicht zweitrangig. Das Wichtigste ist, dass Internetunternehmen die Privatsphäre der Benutzer respektieren und angemessen nutzen.

Super Neuropedia

Wort

Diskriminator

[dɪ'skrɪməˌneɪtə] n. Diskriminator

Sigmoid

['sɪgmɔɪd]N. Sigmoidfunktion

Phrase

Generatives kontradiktorisches NetzwerkGenerative Adversarial Networks

Historische Artikel (zum Lesen auf das Bild klicken)

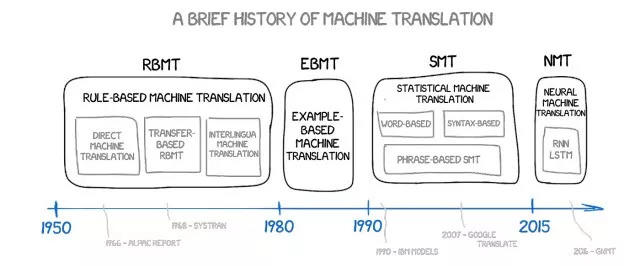

„Maschinelle Übersetzung wird seit 60 Jahren entwickelt, aber sie scheint immer noch mittelmäßig zu sein? 》

《Frankreich war nur noch einen Katzensprung davon entfernt, die weltweit führende Technologiemacht zu werden.》

《Hey! Alles Gute zum Geburtstag, Turing》

《Wenn Turing der Vater der KI ist,

Also sollte Shannon der Onkel der KI sein?》