Command Palette

Search for a command to run...

PE3R:高效感知三维重建框架

An error occurred in the Server Components render. The specific message is omitted in production builds to avoid leaking sensitive details. A digest property is included on this error instance which may provide additional details about the nature of the error.

Failed to load notebook details一、教程简介

PE3R(Perception-Efficient 3D Reconstruction)是由新加坡国立大学(NUS)的 xML Lab 于 2025 年 3 月 10 日发布的一个创新的开源 3D 重建框架,通过融合多模态感知技术实现高效、智能的场景建模。该项目基于多项前沿计算机视觉研究成果开发,仅需输入 2D 图像即可快速完成 3D 场景重建,在 RTX 3090 显卡上单场景平均重建时间仅需 2.3 分钟,较传统方法效率提升 65% 以上。

在技术实现上,PE3R 采用了模块化设计架构:

- 其核心重建引擎基于 DUSt3R/MASt3R 技术,实现从 2D 图像到 3D 点云的高效转换。

- 视觉感知模块集成了 SAM/SAM2 系列分割模型,确保对场景物体的精准识别与分割,同时通过 MobileSAM 优化版本支持移动端高效部署。

- 语义理解层则采用 SigLIP 视觉语言模型,赋予系统零样本跨场景理解能力,用户可通过自然语言指令直接查询特定物体。

该项目最具突破性的创新在于其两级优化算法:

- 第一阶段采用 MST(最小生成树)算法进行快速粗对齐。

- 第二阶段通过引入语义约束的 Bundle Adjustment 实现精细化重建。

这种设计不仅保证了重建质量,还将显存占用控制在 6.2 GB 以内,使系统可在消费级 GPU 上流畅运行。相关论文成果为 PE3R: Perception-Efficient 3D Reconstruction 。

该教程算力资源采用 RTX 4090 。

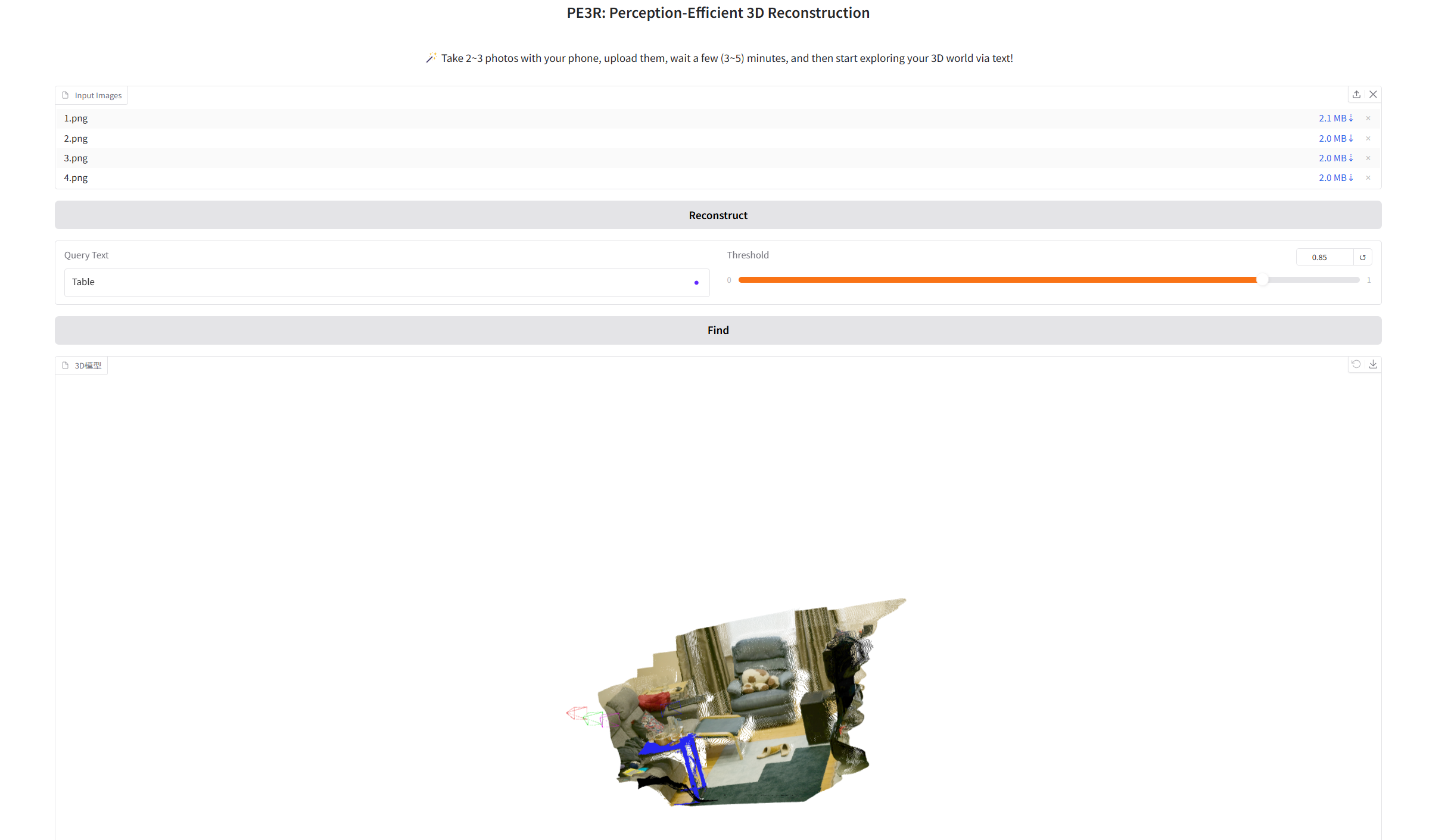

二、项目示例

三、运行步骤

1. 启动容器后点击 API 地址即可进入 Web 页面

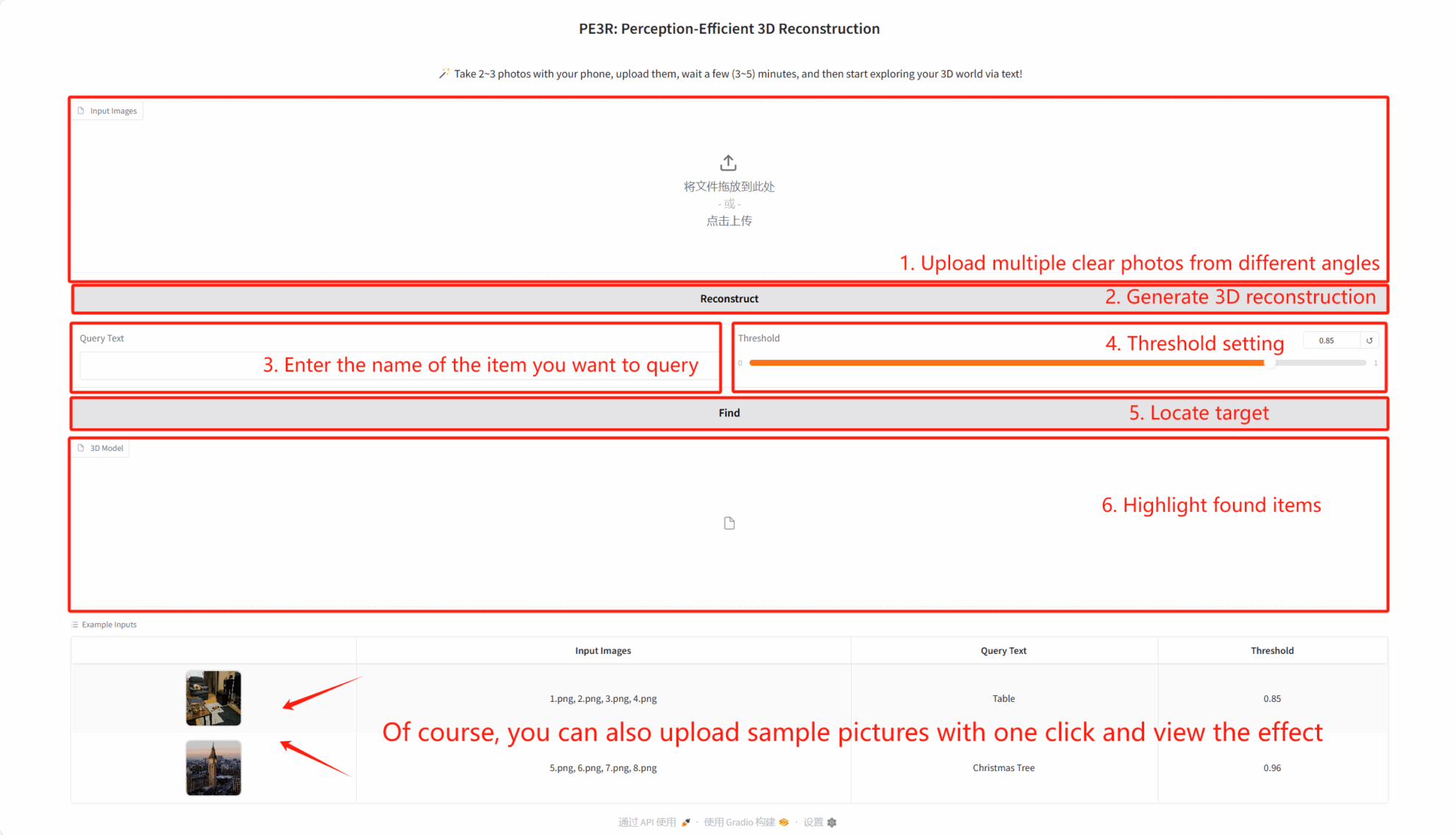

2. 使用步骤

进入网页后,即可开始使用

若显示「Bad Gateway」,这表示模型正在初始化,由于模型较大,请等待约 1-2 分钟后刷新页面。

注意事项:

- 图片上传:

- 图片的上传尽可能多方位且清晰,2 ~ 8 张。

- 如果效果不符请增加上传图片数量或提高图片质量。

- 阈值:合理设置阈值至关重要——过高易漏检,过低易误检,所以需要根据实际情况调整。

四、交流探讨

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【SD 教程】入群探讨各类技术问题、分享应用效果↓

引用信息

本项目的引用信息如下:

@article{hu2025pe3r,

title={PE3R: Perception-Efficient 3D Reconstruction},

author={Hu, Jie and Wang, Shizun and Wang, Xinchao},

journal={arXiv preprint arXiv:2503.07507},

year={2025}

}