Command Palette

Search for a command to run...

EX-4D:实现单目视频到自由视角生成

一、教程简介

EX-4D 是由字节跳动(ByteDance)旗下 Pico 团队于 2025 年 7 月 3 日推出新型 4D 视频生成框架。能从单目视频输入生成极端视角下的高质量 4D 视频。框架基于独特的深度防水网格(DW-Mesh)表示,显式建模可见和被遮挡区域,确保在极端相机姿态下保持几何一致性。框架用模拟遮挡掩码策略,基于单目视频生成有效的训练数据,用轻量级的 LoRA 基视频扩散适配器合成物理一致且时间连贯的视频。 EX-4D 在极端视角下的性能显著优于现有方法,为 4D 视频生成提供新的解决方案。相关论文成果为 EX-4D: EXtreme Viewpoint 4D Video Synthesis via Depth Watertight Mesh 。

本教程采用资源为单卡 RTX A6000 。

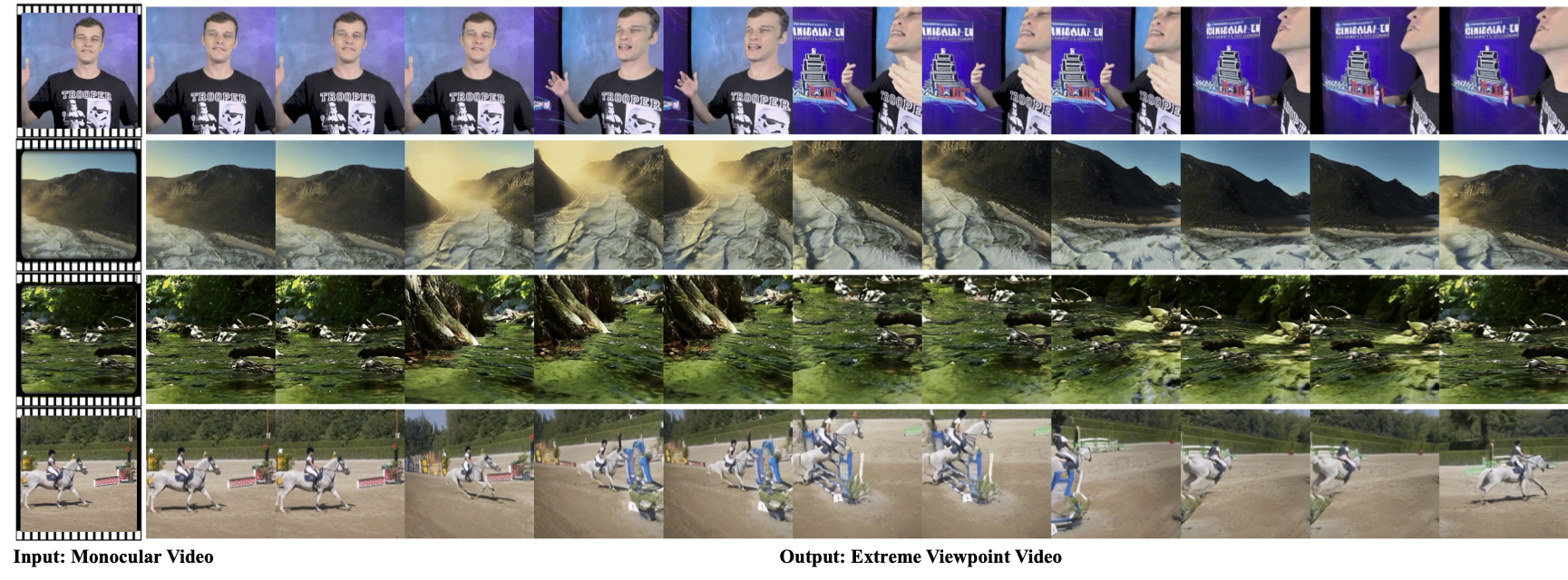

二、项目示例

三、运行步骤

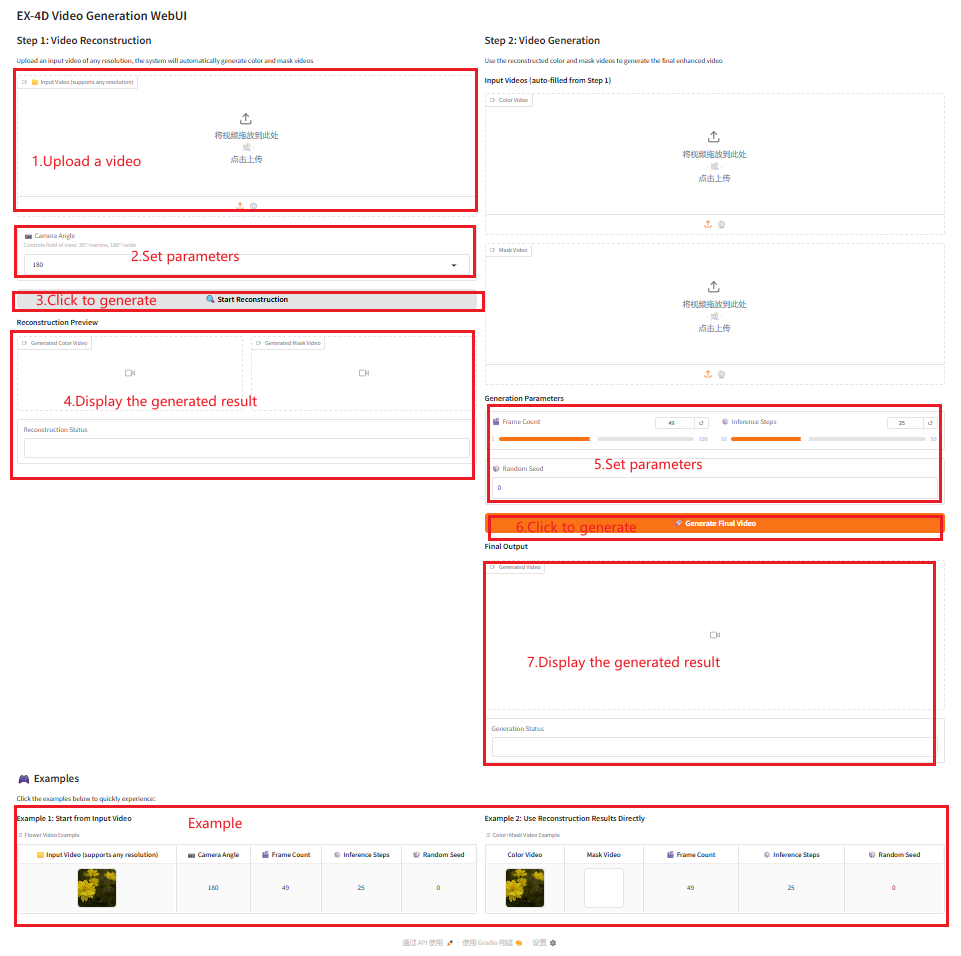

1. 启动容器后点击 API 地址即可进入 Web 界面

2. 使用步骤

若显示「Bad Gateway」,这表示模型正在初始化,由于模型较大,请等待约 2-3 分钟后刷新页面。

参数说明

- Camera Angle:相机角度,30°-180°,角度越大视野越广。

- Frame Count:视频帧数。

- Inference Steps:推理步骤。

- Random Seed:随机种子。

四、交流探讨

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【SD 教程】入群探讨各类技术问题、分享应用效果↓

引用信息

本项目引用信息如下:

@misc{hu2025ex4dextremeviewpoint4d,

title={EX-4D: EXtreme Viewpoint 4D Video Synthesis via Depth Watertight Mesh},

author={Tao Hu and Haoyang Peng and Xiao Liu and Yuewen Ma},

year={2025},

eprint={2506.05554},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2506.05554},

}