Command Palette

Search for a command to run...

谛韵 DiffRhythm:1 分钟即可生成完整音乐 Demo

一键部署 DiffRhythm-full

一、教程简介

DiffRhythm 是由西北工业大学音频语音与语言处理实验室 (ASLP@NPU) 和香港中文大学(深圳)联合开发的一款基于潜扩散模型 (Latent Diffusion) 的端到端音乐生成工具。它能够在短时间内生成长达 4 分 45 秒的完整歌曲,包含人声和伴奏。用户只需提供歌词和风格提示,DiffRhythm 就能自动生成与歌词匹配的旋律和伴奏,支持多语言输入。

DiffRhythm(中文:谛韵,Dì Yùn)是第一个能够创作完整歌曲的基于扩散的歌曲生成模型。该名称结合了「Diff」(参考其扩散架构)和「Rhythm」(强调其对音乐和歌曲创作的关注)。中文名称谛韵(Dì Yùn)在发音上与「DiffRhythm」相似,其中「谛」(专心聆听)象征着听觉感知,「韵」(旋律魅力)代表音乐性。

二、运行步骤

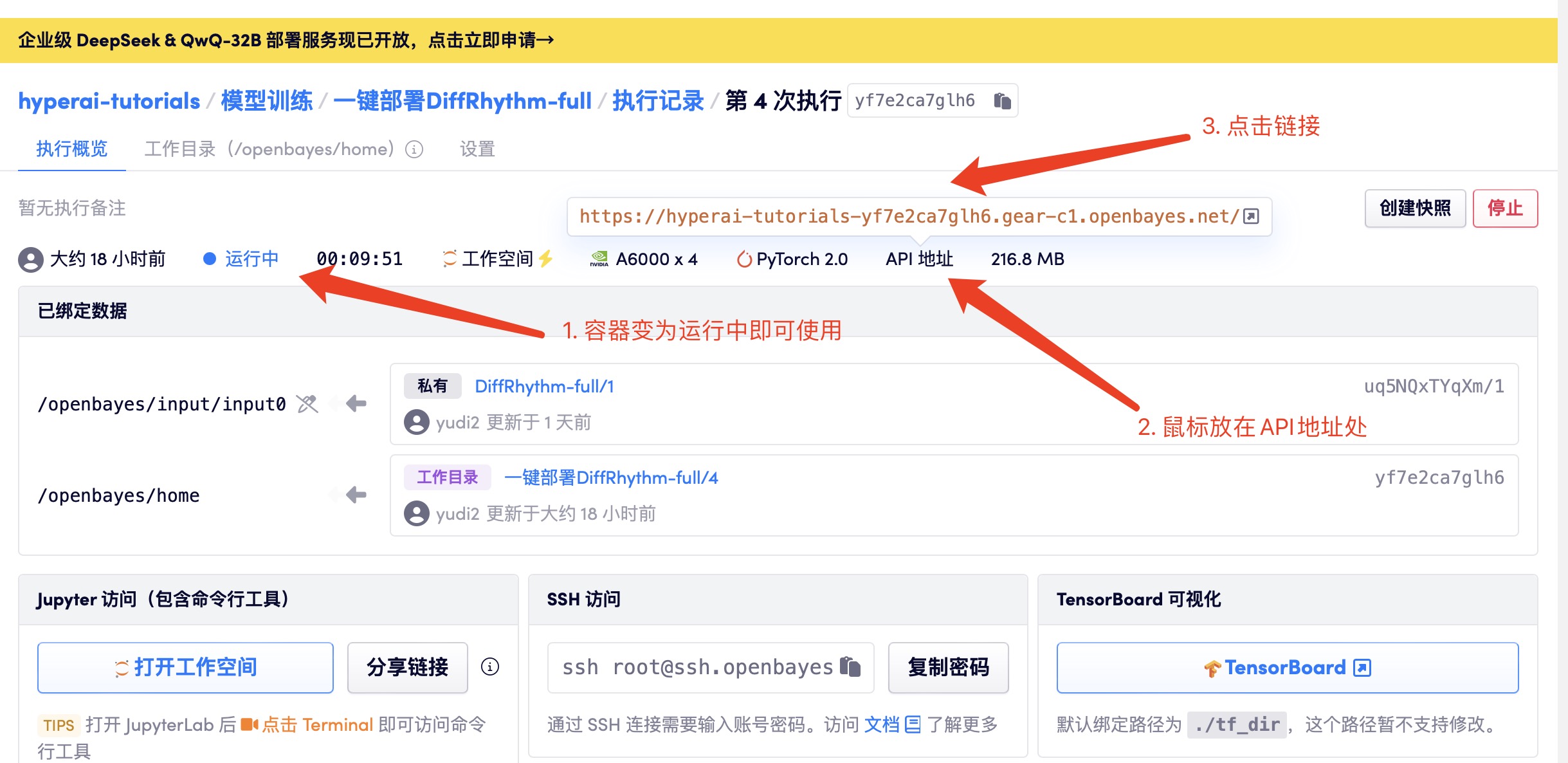

1. 启动容器

启动容器后点击 API 地址即可进入 Web 界面,由于模型较大,需等待约 3 分钟显示 WebUI 界面,否则将显示「Bad Gateway」

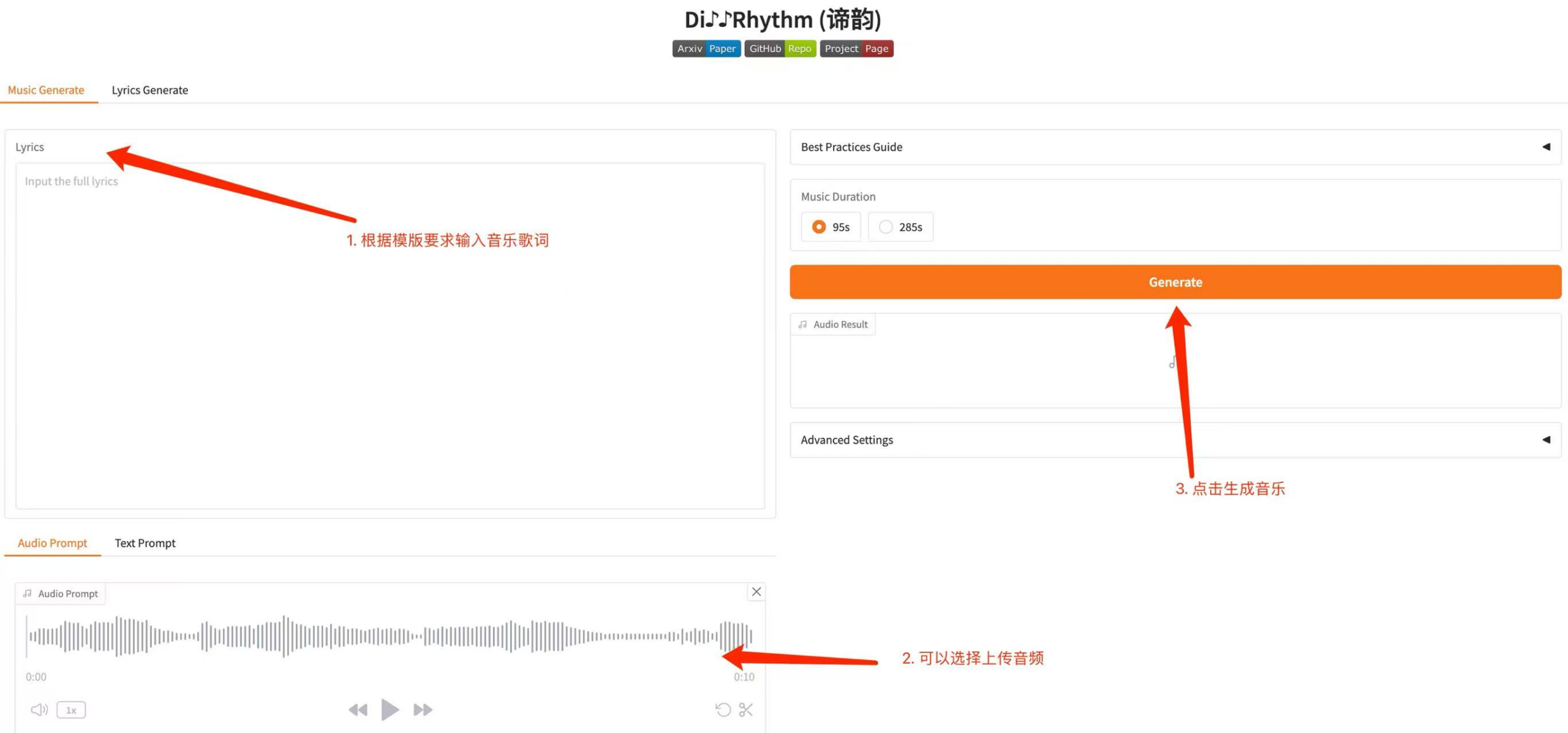

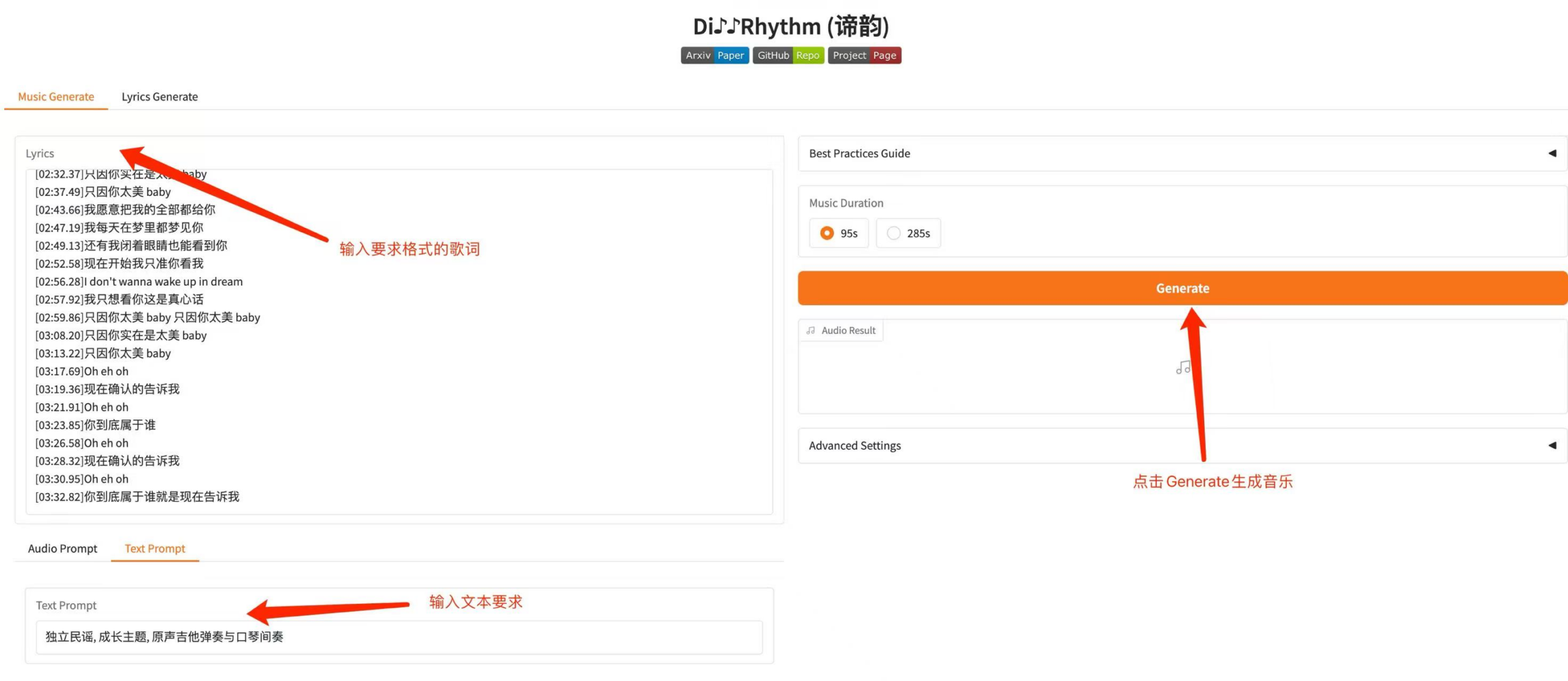

2. 音乐生成

2.1 选择根据歌词、音频生成音乐

2.2 可以选择根据歌词、文本生成音乐

三、交流探讨

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【SD 教程】入群探讨各类技术问题、分享应用效果↓