Command Palette

Search for a command to run...

使用 vLLM 部署 Gemma-3-27B-IT

一、教程简介

Gemma-3-27B-IT 是 Google 于 2025 年开源的第三代 Gemma 大模型,具有 270 亿参数的指令优化版本。

Gemma 系列是 Google 开源的系列大模型,基于与 Gemini 模型相同的研究和技术构建。 Gemma 3 是一款多模态大模型,能够处理文本和图像输入并生成文本输出,其预训练变体和指令调优变体均提供开放的权重。模型拥有一个 128K 上下文窗口,支持超过 140 种语言,并且提供了比之前版本更多的模型尺寸。 Gemma 3 模型适用于各种文本生成和图像理解任务,包括问答、摘要和推理。其相对较小的尺寸使得它们能够在资源有限的环境中部署,例如笔记本电脑、台式机或云基础设施。

本教程使用 gemma-3-27b-it 作为演示,算力资源采用单卡 A6000 。

二、运行步骤

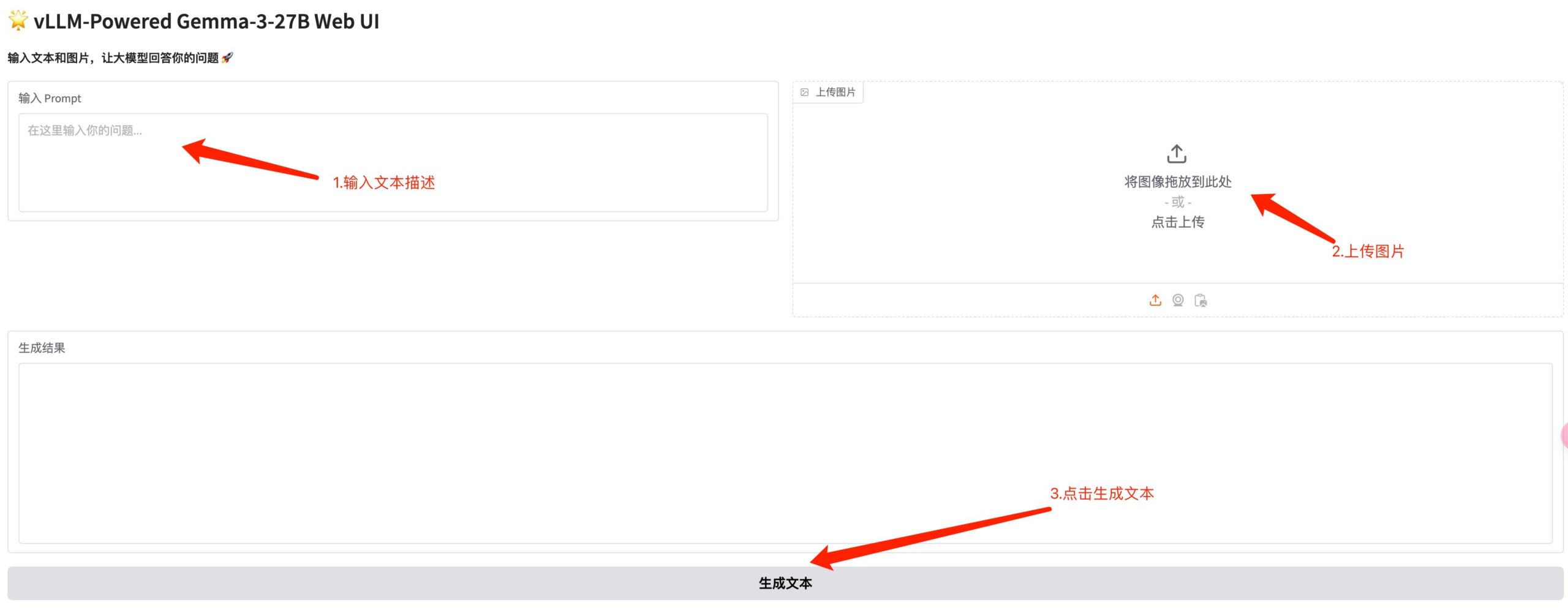

1. 启动容器后点击 API 地址即可进入 Web 界面,由于模型较大,需等待约 3 分钟显示 WebUI 界面,否则将显示「Bad Gateway」

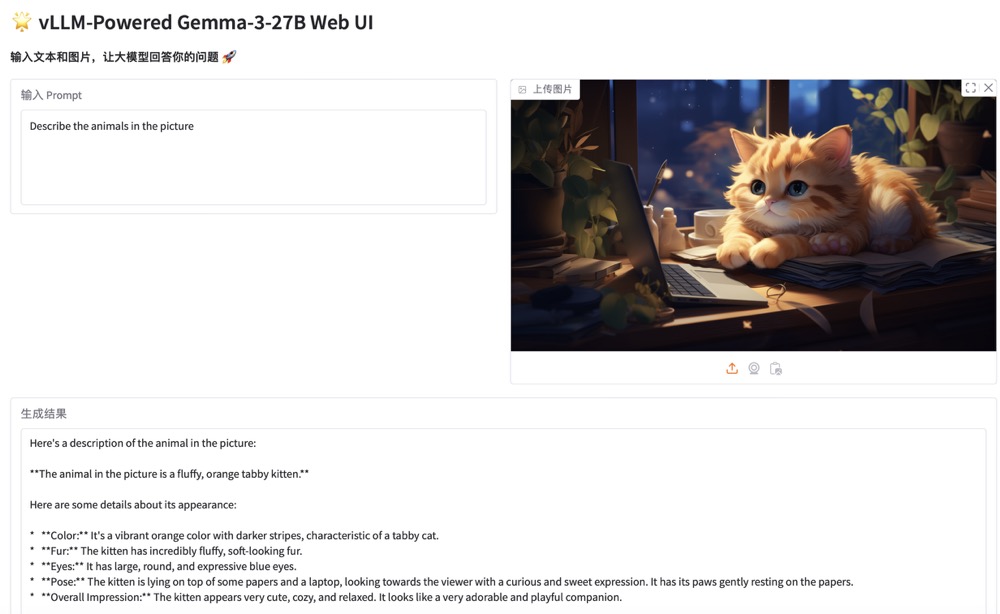

2. 进入网页后,即可进行模型推理

- 文字对话:直接输入文本,无需上传照片即可进行文本对话

- 图像理解:输入文本和图像即可生成对应的模型理解

*运行示例

交流探讨

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【SD 教程】入群探讨各类技术问题、分享应用效果↓