Command Palette

Search for a command to run...

Paints-Undo 一张图生成绘画全过程 Demo

教程简介

该教程为 PaintsUndo 一键运行 Demo,相关环境和依赖已经安装完毕,一键克隆启动即可体验。

PaintsUndo 是一个可以模拟人类绘画行为的基本模型,旨在为人类提供绘画行为的基础模型,同时希望未来的 AI 模型能够更好地符合人类艺术家的现实需求。该项目提供了一系列模型,这些模型将图像作为输入,然后输出该图像的绘制序列。该模型模拟了人类在绘图过程中的行为,包括但不限于草图、墨迹、着色、阴影、变换、左右翻转、颜色曲线调整、改变图层的可见性,甚至在绘图过程中改变整体构思。「Paints-Undo」这个名字的灵感来自于模型的输出看起来像在 AI 绘画软件中多次按下「撤消」按钮(通常是 Ctrl+Z)的相似性。

项目目前发布了两个模型:单帧模型和多帧模型。

- paints_undo_single_frame

- paints_undo_multi_frame

单帧模型将一个图像和一个作为输入,并输出一个图像。

- 假设始终可以通过 1000 次人工绘画创建图稿,并且绘画的次序是一个从 0 到 999 的整数。 0 代表的次序是完成的最终艺术品,999 是在纯白色画布上绘制的第一个笔触。可以将此模型理解为「撤消」(或称为 Ctrl+Z)模型。

- 输入最终图像,并指示要「Ctrl+Z」的次数,按下这些「Ctrl+Z」后,模型将生成相应次数的绘画过程截图。如果选择的次数是 100,则表示您要在此图像上模拟「Ctrl+Z」100 次,以获得 100 次「Ctrl+Z」之后的截图。

多帧模型将两个图像作为输入,并在两个输入图像之间输出 16 个中间帧。

- 相较于单帧模型,两张图像的差别更小,但速度也慢得多,随机性更小。

- 仅限于生成 16 帧的图像。

在本项目的生成方法中,默认方法是将它们一起使用。首先使用单帧模型推断大约 5-7 次,得到 5-7 个「关键帧」,然后使用多帧模型对这些关键帧进行「插值」生成,以实际生成一个相对较长的视频。最终一般能够得到 100 张左右的中间图。

从理论上讲,该系统可以以多种方式使用,甚至可以提供无限长的视频,但在目前实践中,当最终帧数约为 100-500 时,效果较好。

本教程采用资源为单卡 RTX 5090 。

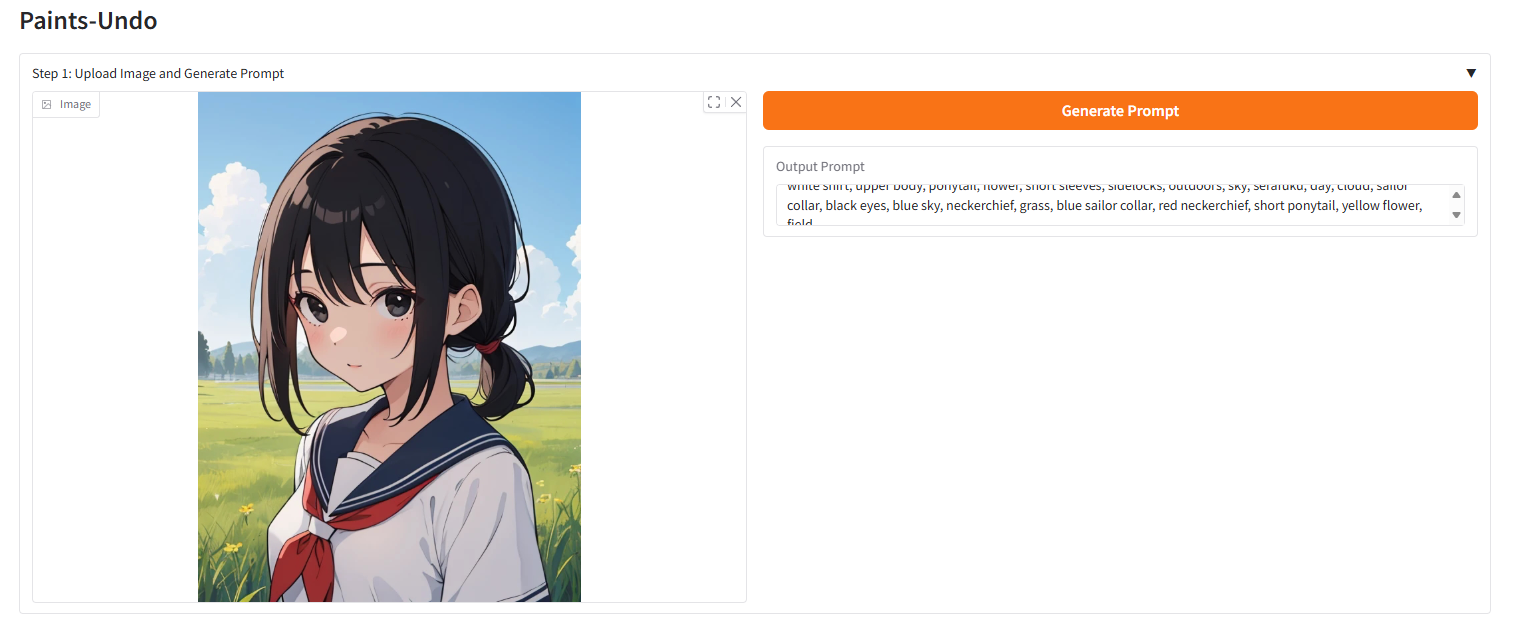

效果展示

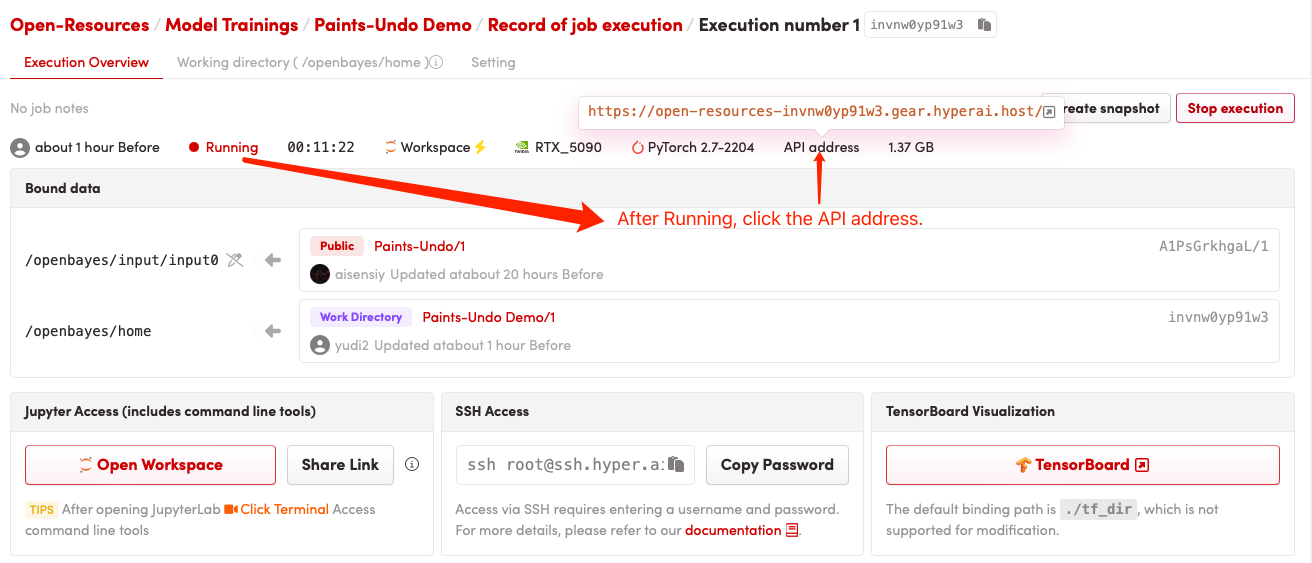

运行方法(启动容器后需要约 10s 初始化,之后再进行如下操作)

1. 克隆并启动容器后,复制 API 到浏览器中

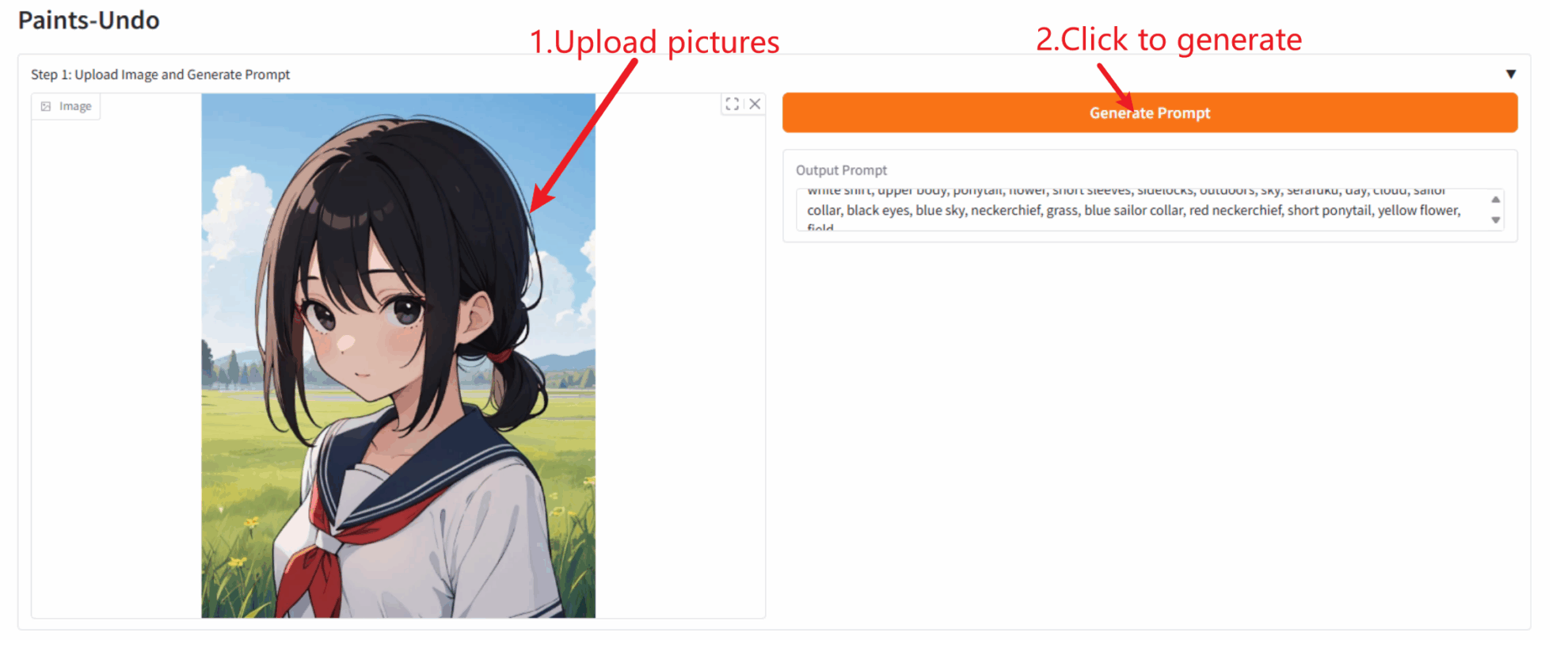

2. 使用步骤

若显示「Bad Gateway」,这表示模型正在初始化,由于模型较大,请等待约 2-3 分钟后刷新页面。

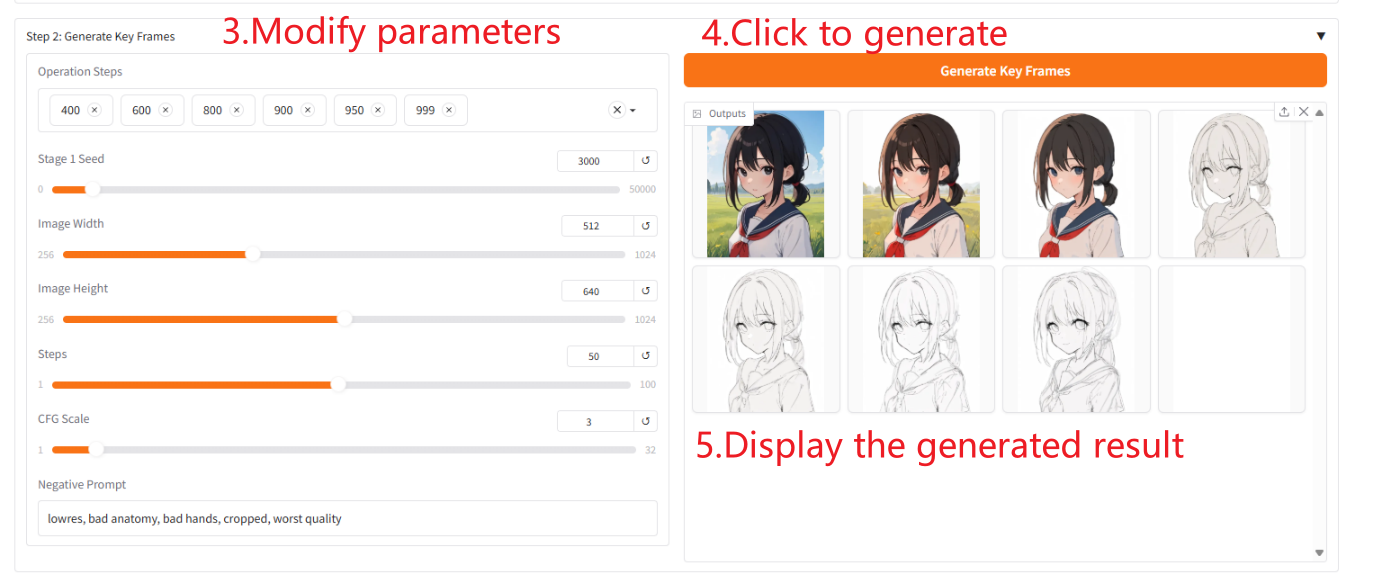

单帧模型输出

总模型输出

参数说明

- 「Operation Steps」:可以选择输出的关键帧次序,选择的次序越大,生成的图像越相似于原图。

- 「Stage 1 Seed」:可以随机选择种子进行关键帧生成。

- 「Steps」:可以选择每帧的模型运行步数。

- 「CFG Scale」:可以控制生成图像的随机性,该值越小生成的图像随机性越高。

- 「Nagative Prompt」:填写负面词,可以缓解生成图像中包含这些负面词的情况。

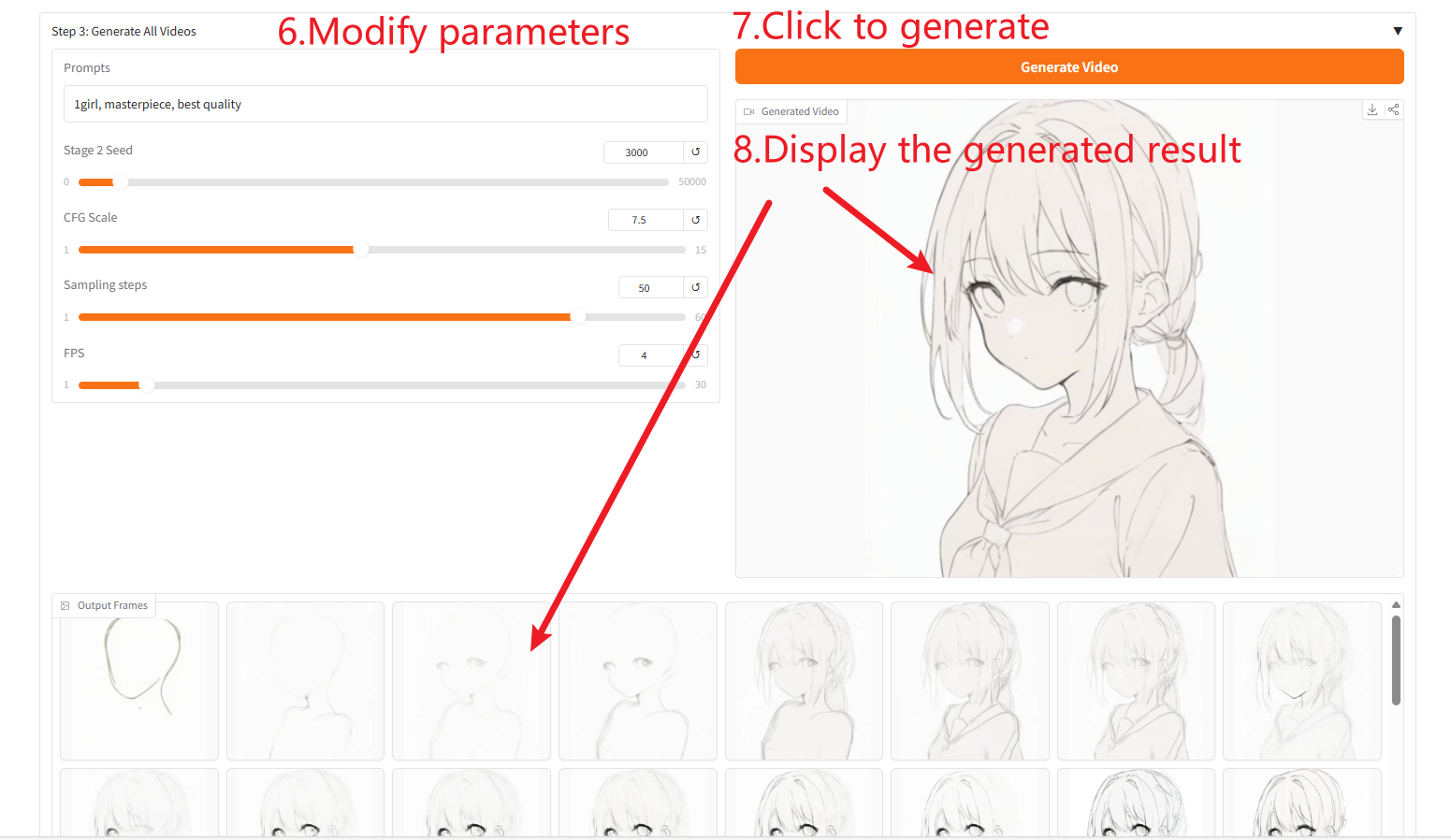

生成视频

参数说明

- 「Prompts」:填写正面提示词,可以提升生成图像的质量和内容。

- 「Stage 2 Seed」:可以随机选择种子进行图像生成。

- 「CFG Scale」:可以控制生成图像的随机性,该值越小生成的图像随机性越高。

- 「Sampling steps」:可以改变采样经过的迭代步数,该值越大生成的图像越精确。

- 「FPS」:可以改变生成视频的帧率,默认为 4 帧,即每秒视频包含四张生成的图像。

引用信息

本项目引用信息如下:

@Misc{paintsundo,

author = {Paints-Undo Team},

title = {Paints-Undo GitHub Page},

year = {2024},

}

@article{paintsalter,

author = {Zhang, Lvmin and Yan, Chuan and Guo, Yuwei and Xing, Jinbo and Agrawala, Maneesh},

title = {Generating Past and Future in Digital Painting Processes},

journal = {ACM Transactions on Graphics (SIGGRAPH 2025)},

year = {2025},

volume = {44},

number = {4},

articleno = {127},

numpages = {13},

}