Command Palette

Search for a command to run...

TacQuad 多模态多传感器触觉数据集

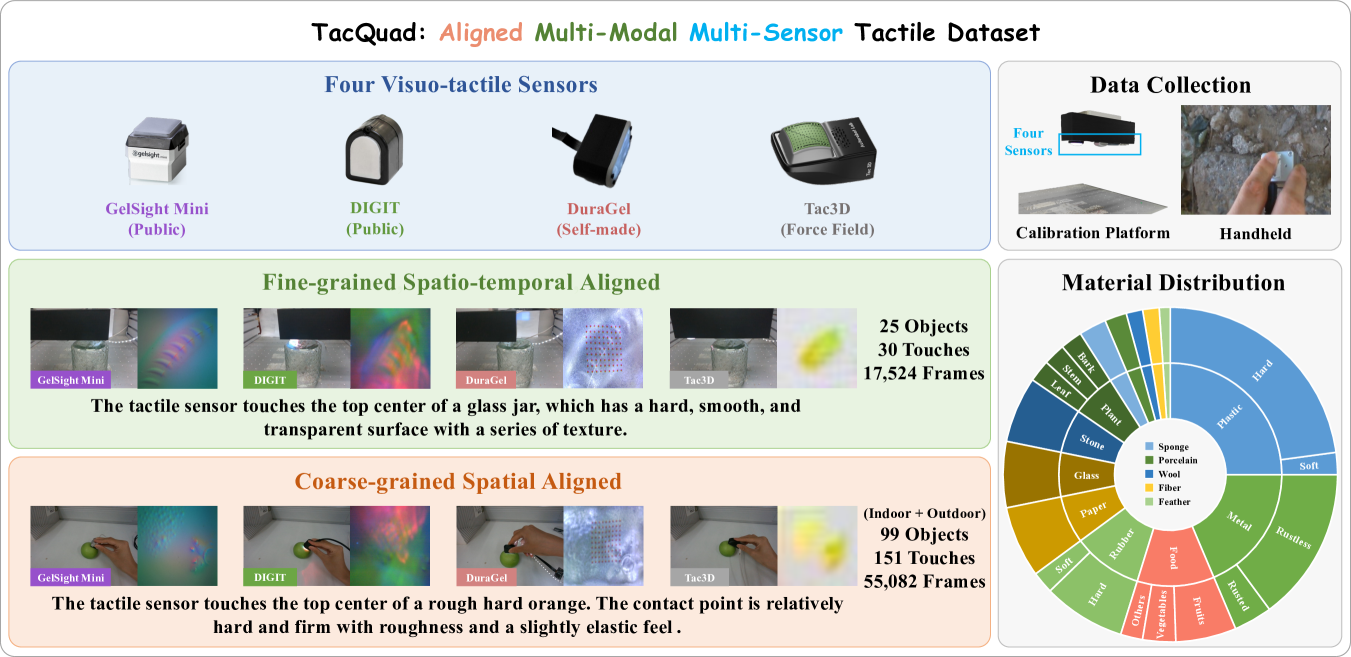

TacQuad 是一个对齐的多模态多传感器触觉数据集,收集自 4 种类型的视觉触觉传感器(GelSight Mini 、 DIGIT 、 DuraGel 和 Tac3D)。该数据集由中国人民大学、武汉科技大学和北京邮电大学的研究团队于 2025 年发布,相关论文成果为「AnyTouch: Learning Unified Static-Dynamic Representation across Multiple Visuo-tactile Sensors」。 它通过提供带有文本和视觉图像的多传感器对齐数据,为视觉触觉传感器的低标准化提供了更全面的解决方案。这明确地使模型能够学习语义级触觉属性和与传感器无关的特征,从而通过数据驱动的方法形成统一的多传感器表示空间。此数据集包括两个具有不同对齐级别的配对数据子集:

- **细粒度时空对齐数据:**这部分数据是通过四个传感器以相同速度按压同一物体的同一位置收集的。它包含来自 25 个物体的总共 17,524 个接触帧,可用于跨传感器生成等细粒度任务。

- **粗粒度空间对齐数据:**这部分数据是手动收集的,四个传感器按压同一物体上的同一位置,但不能保证时间对齐。它包含来自 99 个物体的 55,082 个接触帧,包括室内和室外场景,可用于跨传感器匹配任务。