Command Palette

Search for a command to run...

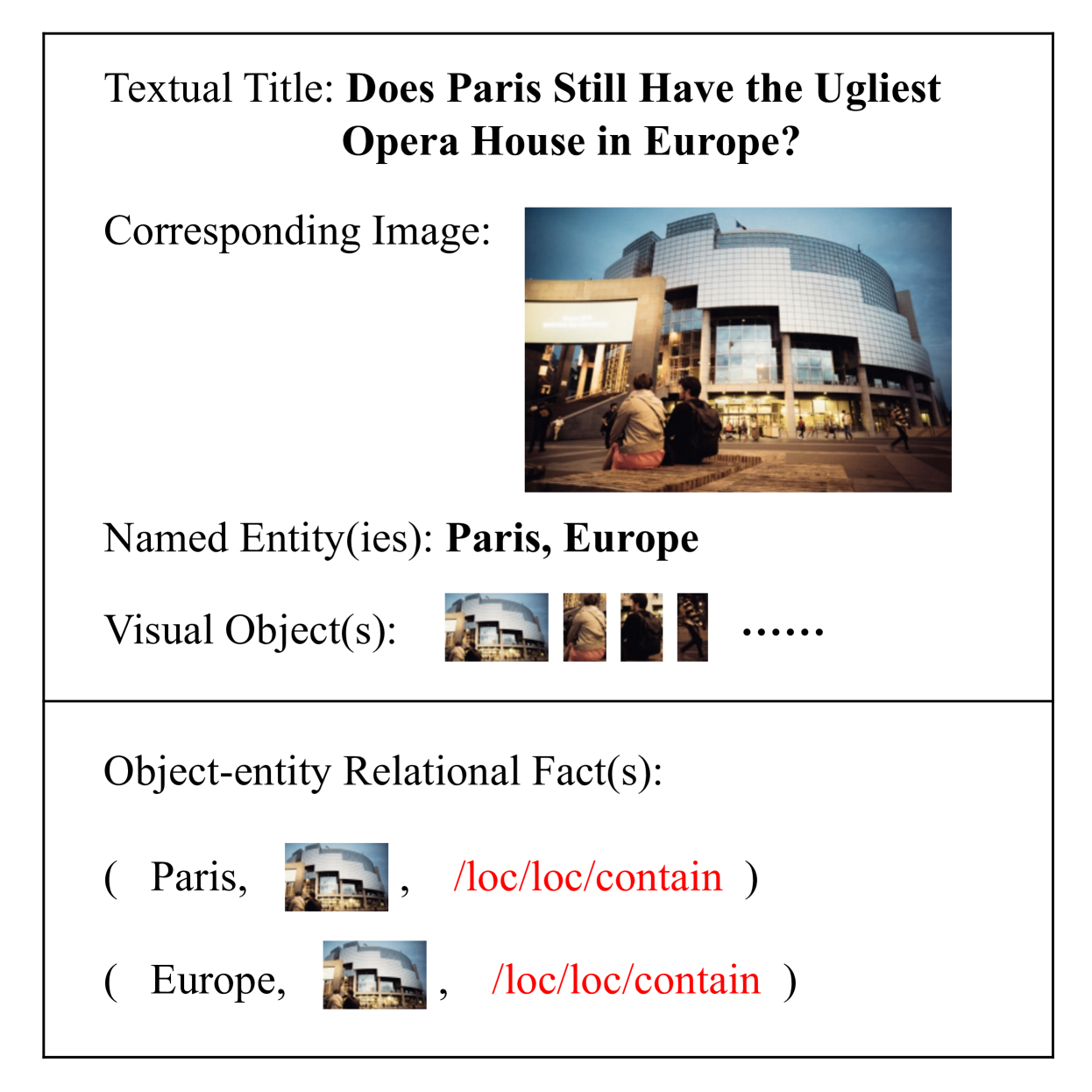

MORE 多模态对象-实体关系抽取数据集

MORE (A Multimodal Object-Entity Relation Extraction Dataset) 是一个由南京大学国家重点实验室于 2024 年提出的多模态对象-实体关系抽取数据集,相关论文成果为「MORE: A Multimodal Object-Entity Relation Extraction Dataset with a Benchmark Evaluation」。 这个数据集通过结合文本和图像信息,为机器学习模型提供了一个复杂的挑战,即如何准确地从文本中提取实体,并与图像中的视觉对象建立正确的关系。 MORE 数据集包含了 21 种不同的关系类型,涵盖了 20,264 个多模态关系事实,这些事实标注在 3,559 对文本标题和对应的图像上。数据集中的每个事实都涉及到从文本中识别出的实体和从图像中检测到的对象,这要求模型不仅要理解文本内容,还要能够识别和理解图像内容。此外,数据集还包含 13,520 个视觉对象,平均每张图像包含 3.8 个对象。