Command Palette

Search for a command to run...

Yolov13 원클릭 배포

1. 튜토리얼 소개

YOLOv13은 칭화대학교, 타이위안 이공대학교, 시안 교통대학교 등 여러 대학의 공동 연구팀이 2025년 6월에 제안한 객체 탐지 모델입니다. YOLO 시리즈의 실시간 탐지 장점을 기반으로, 이 모델은 하이퍼그래프 향상, 고차 의미론적 모델링, 경량 구조 재구성 등 일련의 새로운 메커니즘을 도입했습니다. MS COCO 및 Pascal VOC와 같은 주류 데이터셋에서 포괄적인 리더십을 확보하여 더욱 강력한 일반화 능력과 실질적인 적용 가능성을 보여줍니다. 관련 논문의 제목은 "YOLOv13: 하이퍼그래프 강화 적응형 시각 인식을 통한 실시간 객체 감지".

이 튜토리얼에서는 리소스로 단일 RTX 5090 카드를 사용합니다.

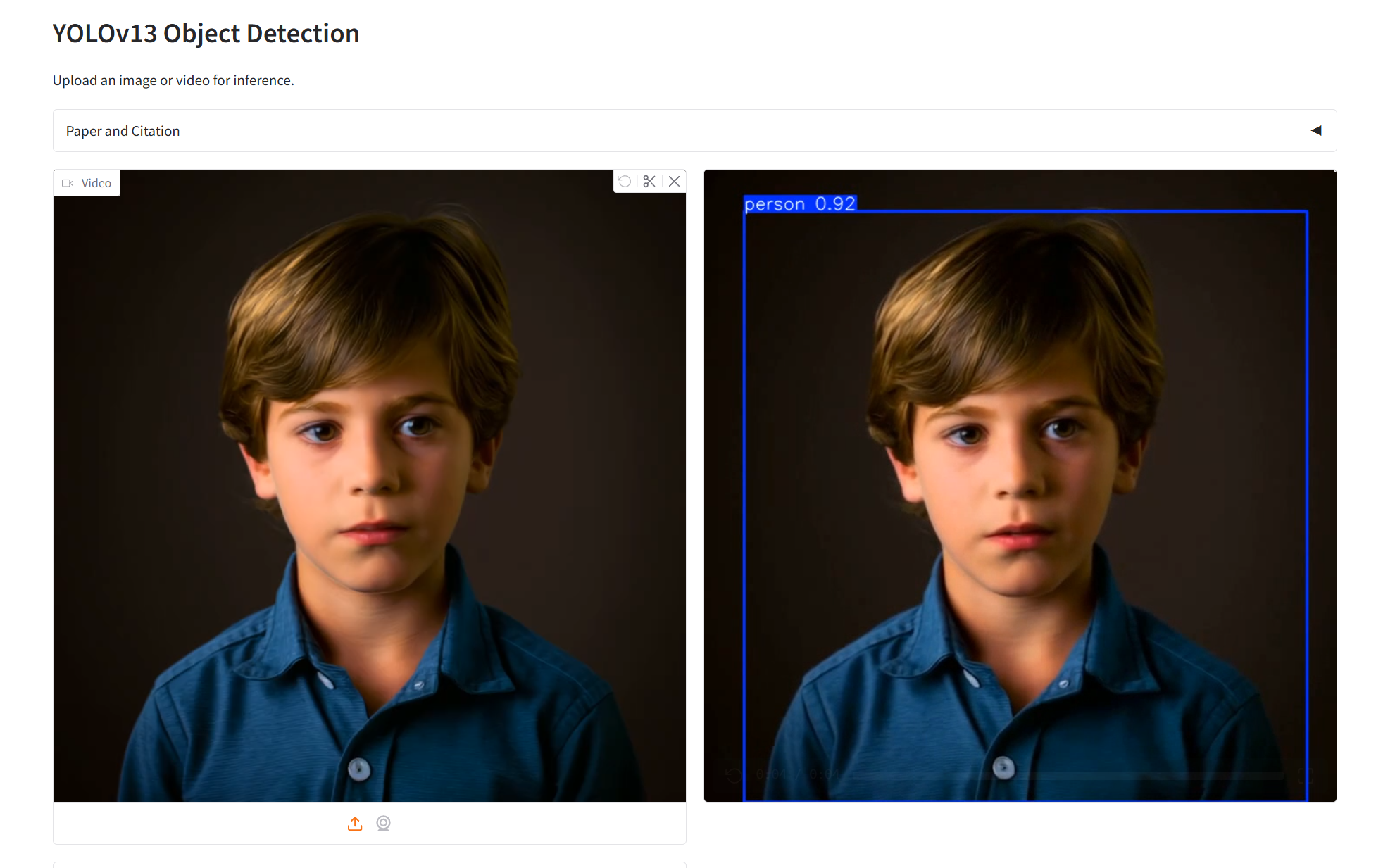

2. 프로젝트 예시

영상

동영상

3. 작업 단계

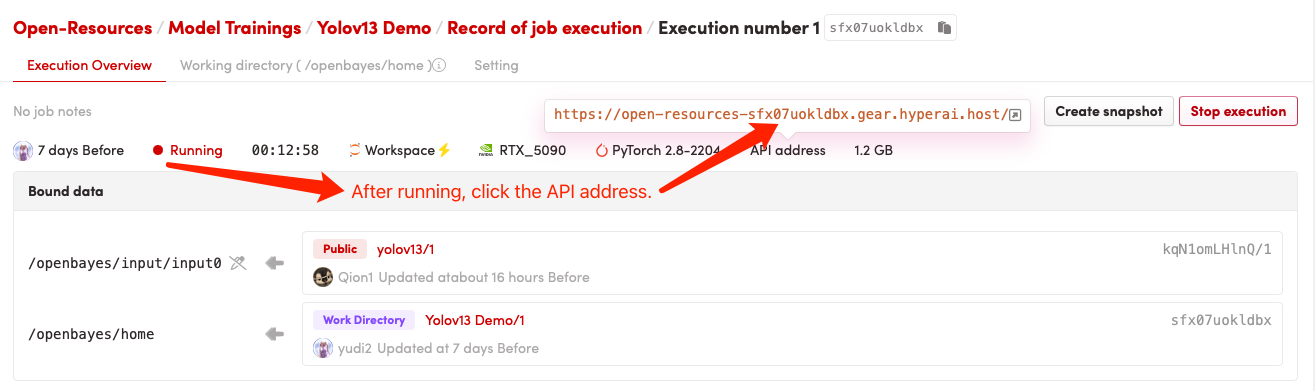

1. 컨테이너 시작 후 API 주소를 클릭하여 웹 인터페이스로 진입합니다.

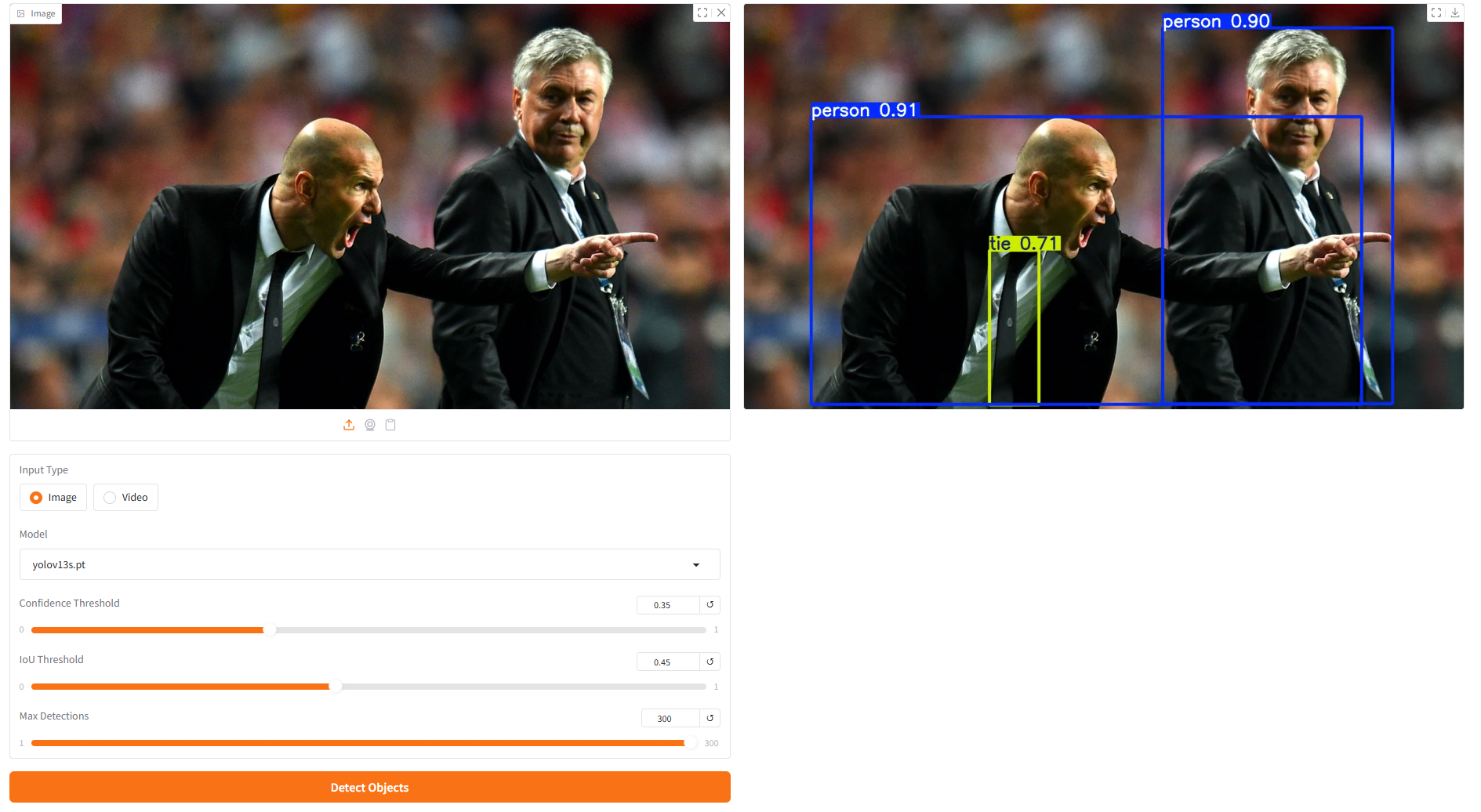

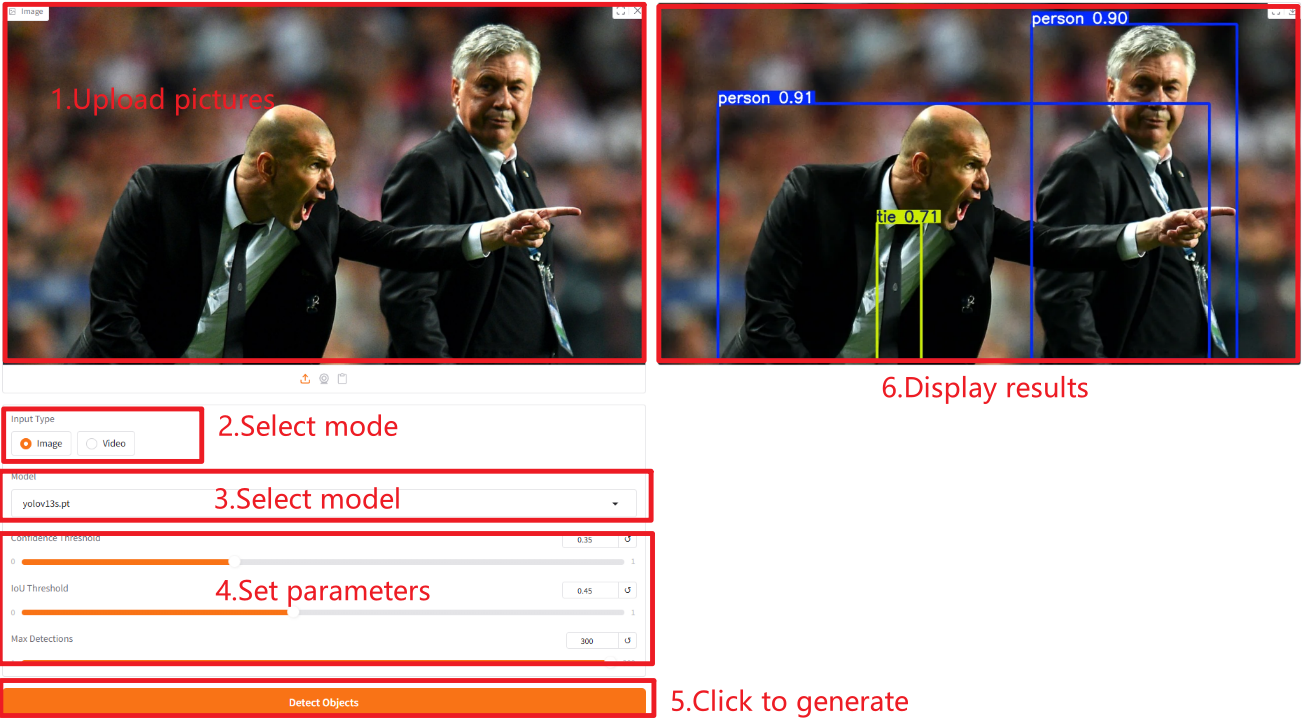

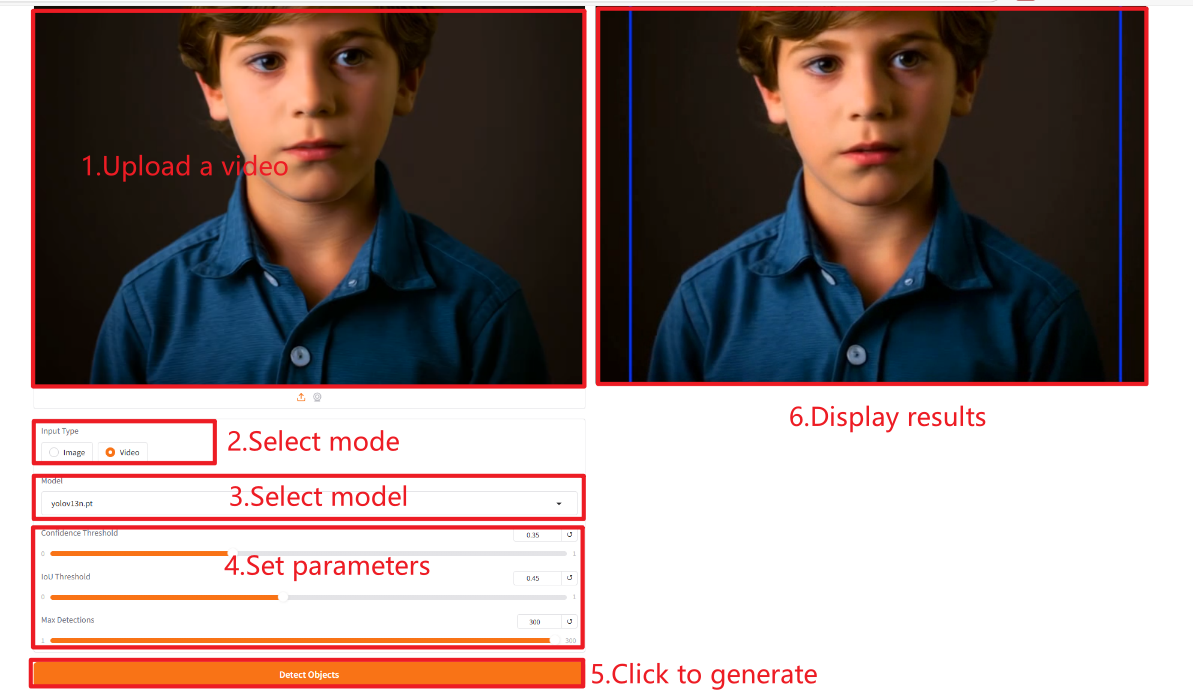

2. 사용 단계

"잘못된 게이트웨이"가 표시되면 모델이 초기화 중임을 의미합니다. 모델이 크기 때문에 약 2~3분 정도 기다리신 후 페이지를 새로고침해 주시기 바랍니다.

영상

동영상

매개변수 설명

- 모델: yolov13n.pt(나노), yolov13s.pt(소형), yolov13l.pt(대형), yolov13x.pt(초대형). 모델이 클수록 일반적으로 정확도(mAP)가 높지만, 매개변수 수, 계산 비용(FLOP)이 더 많고 추론 시간도 더 깁니다.

- 신뢰 임계값: 신뢰 임계값.

- IoU 임계값: NMS에서 사용되는 IoU(Intersection over Union) 임계값입니다.

- 이미지당 최대 감지 수: 이미지당 감지 상자의 최대 수입니다.

🖌️ 고품질 프로젝트를 발견하시면, 백그라운드에 메시지를 남겨 추천해주세요! 또한, 튜토리얼 교환 그룹도 만들었습니다. 친구들의 QR코드 스캔과 [SD 튜토리얼] 댓글을 통해 그룹에 가입하여 다양한 기술 이슈에 대해 논의하고 신청 결과를 공유해 주시기 바랍니다.↓

인용 정보

이 프로젝트에 대한 인용 정보는 다음과 같습니다.

@article{yolov13,

title={YOLOv13: Real-Time Object Detection with Hypergraph-Enhanced Adaptive Visual Perception},

author={Lei, Mengqi and Li, Siqi and Wu, Yihong and et al.},

journal={arXiv preprint arXiv:2506.17733},

year={2025}

}