Command Palette

Search for a command to run...

HuMo-17B: 삼중 협력 창조

1. 튜토리얼 소개

HuMo는 칭화대학교와 바이트댄스 지능형 창조 연구소가 2025년 9월 발표한 멀티모달 비디오 생성 프레임워크로, 인간 중심 비디오 생성에 중점을 두고 있습니다. 텍스트, 이미지, 오디오 등 다양한 모달 입력으로부터 고품질의 상세하고 제어 가능한 인간 비디오를 생성할 수 있습니다. HuMo는 강력한 텍스트 프롬프트 추적 기능, 일관된 주제 유지, 그리고 오디오 기반 모션 동기화를 지원합니다. 텍스트-이미지(텍스트-이미지 기반 VideoGen), 텍스트-오디오(텍스트-오디오 기반 VideoGen), 그리고 텍스트-이미지-오디오(텍스트-이미지-오디오 기반 VideoGen)를 기반으로 비디오 생성을 지원합니다. 관련 논문 결과는 다음과 같습니다.HuMo: 협업적 다중 모달 컨디셔닝을 통한 인간 중심 비디오 생성".

HuMo 프로젝트는 1.7B와 17B의 두 가지 사양으로 모델 배포를 제공합니다. 이 튜토리얼에서는 17B 모델과 RTX Pro 6000 카드 하나를 리소스로 사용합니다.

→ 클릭하시면 체험 페이지로 이동합니다.HuMo 1.7B: 다중 모드 비디오 생성을 위한 프레임워크".

2. 프로젝트 예시

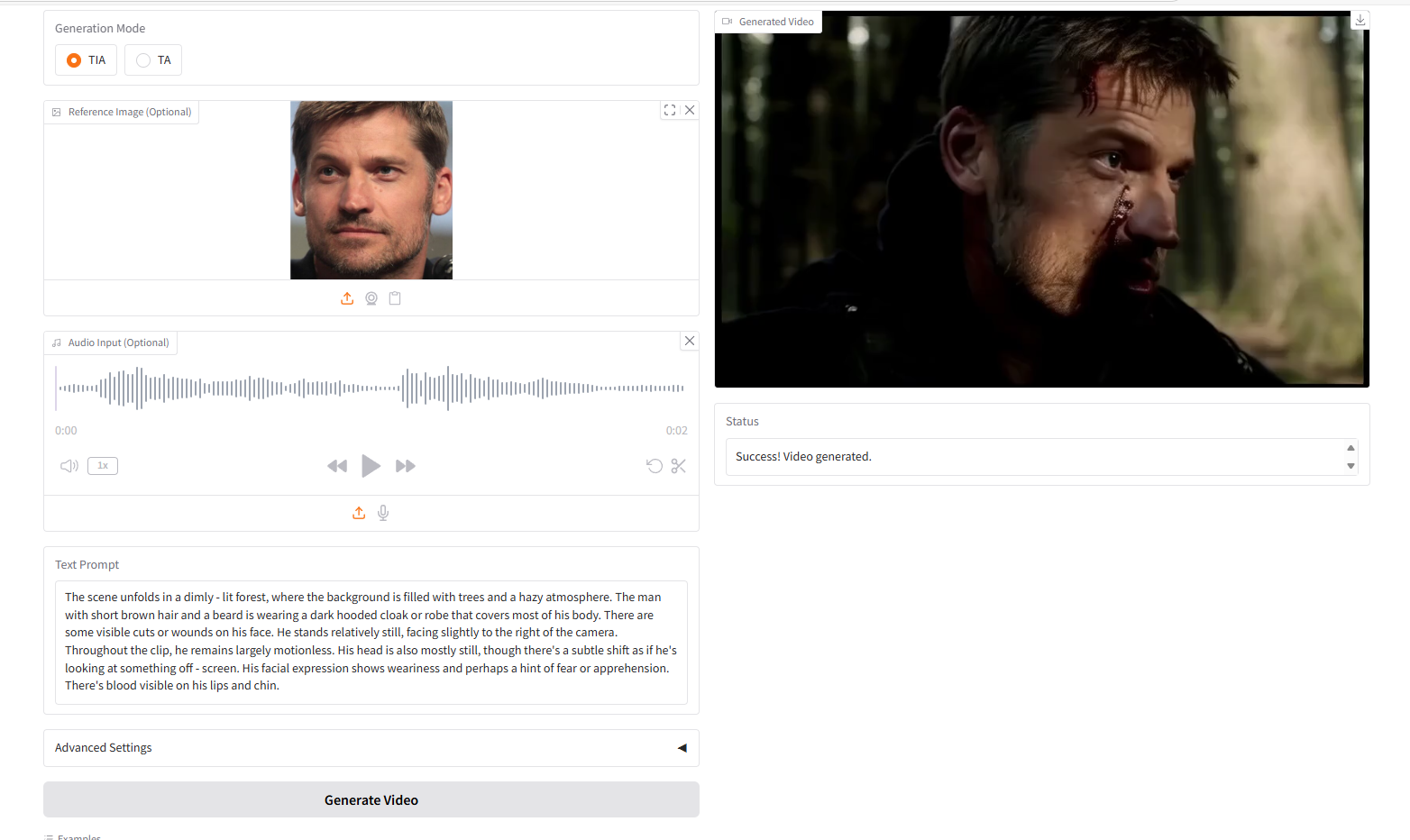

Text-Image-Audio,TIA의 VideoGen

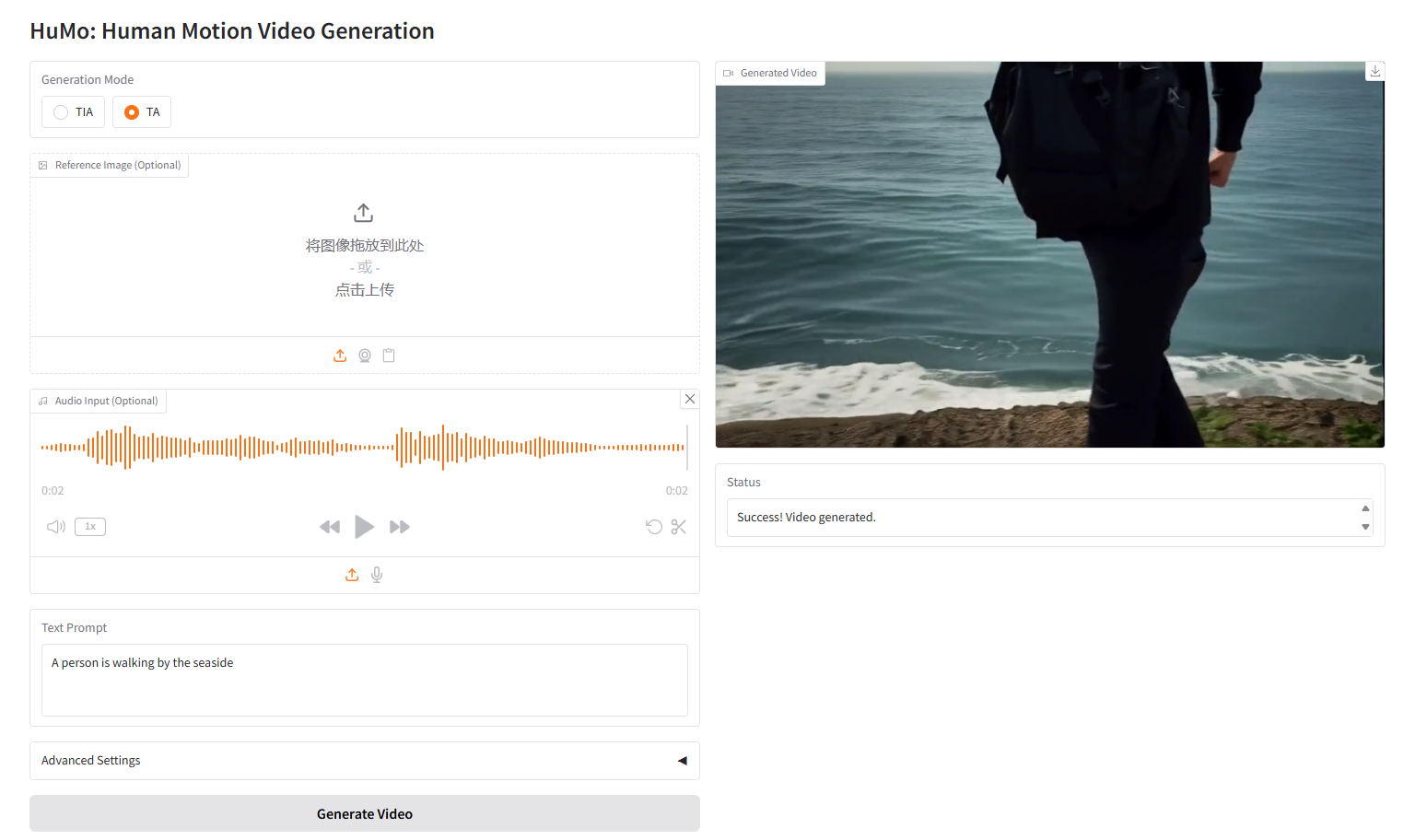

Text-Audio,TA의 VideoGen

3. 작업 단계

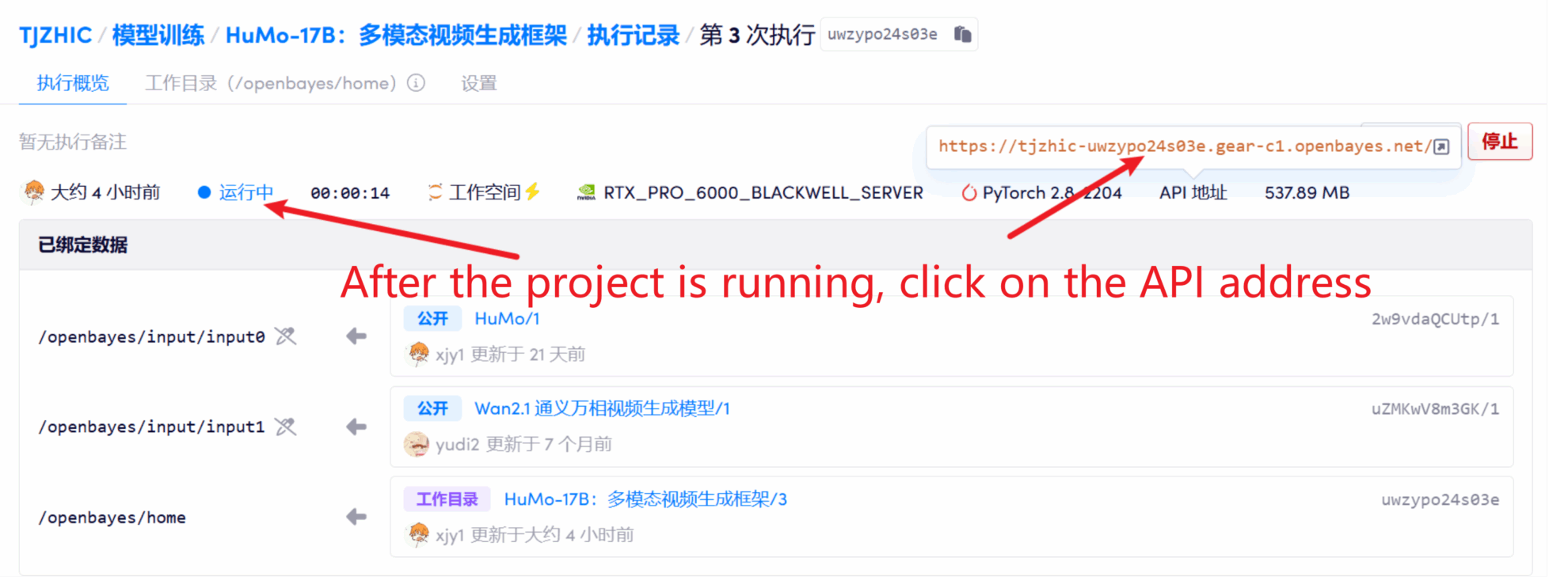

1. 컨테이너 시작 후 API 주소를 클릭하여 웹 인터페이스로 진입합니다.

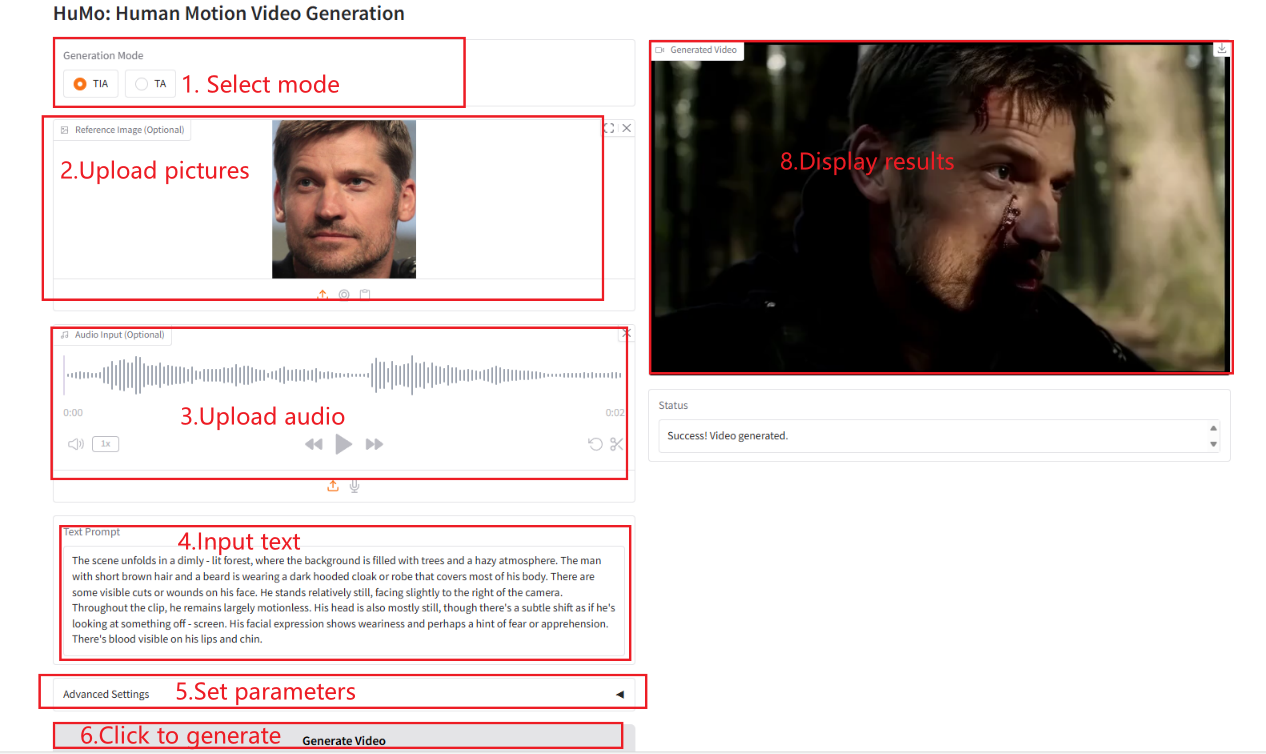

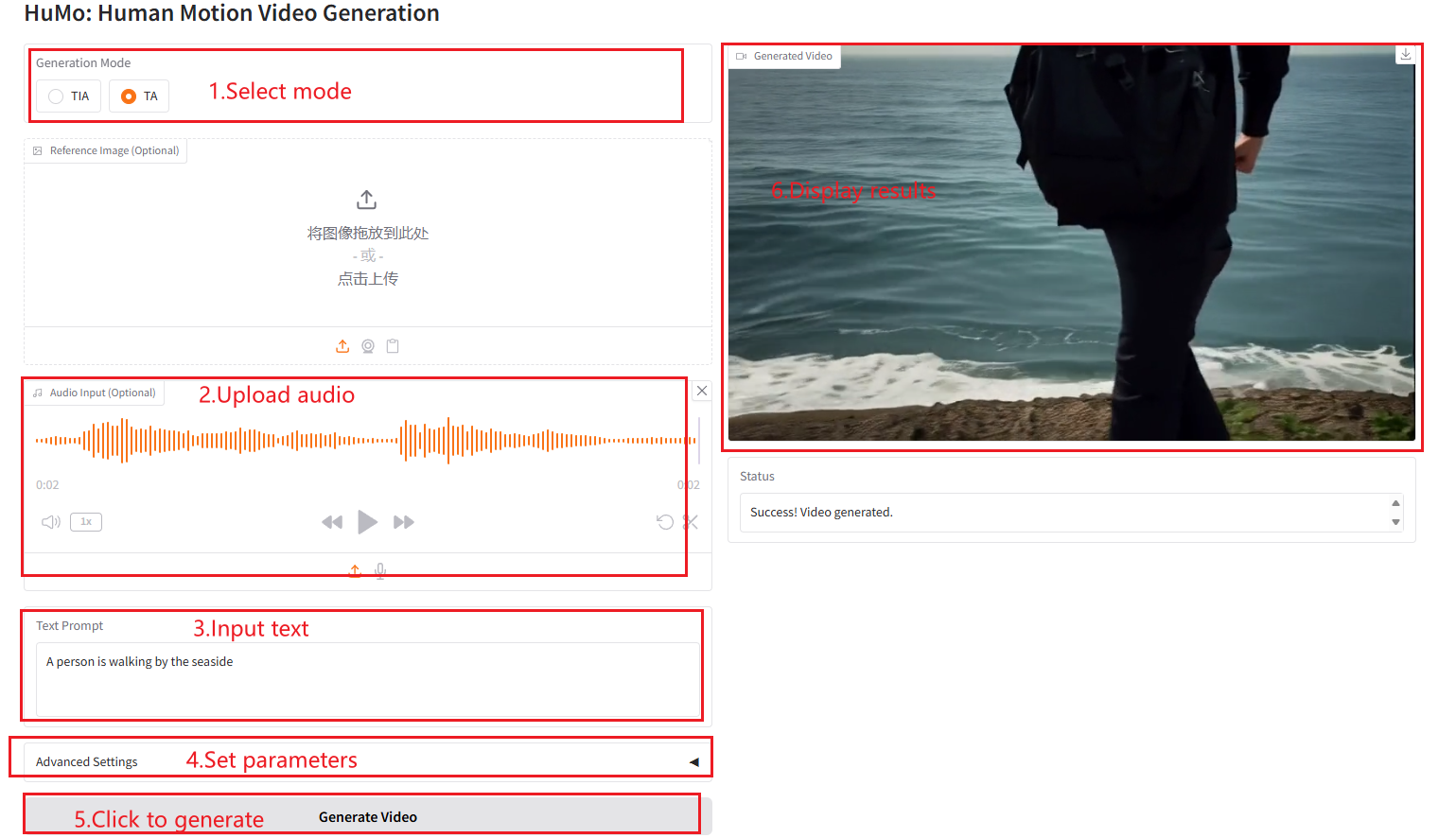

2. 사용 단계

"잘못된 게이트웨이"가 표시되면 모델이 초기화 중임을 의미합니다. 모델이 크기 때문에 약 2~3분 정도 기다리신 후 페이지를 새로고침해 주시기 바랍니다. 참고: 샘플링 단계를 10으로 설정하면 결과를 생성하는 데 약 3~5분이 걸립니다.

티아

고마워

매개변수 설명

- 높이: 비디오의 높이를 설정합니다.

- 너비: 비디오의 너비를 설정합니다.

- 프레임: 비디오 프레임 수를 설정합니다.

- 텍스트 안내 스케일: 텍스트 안내 스케일은 비디오 생성에 대한 텍스트 프롬프트의 영향을 제어하는 데 사용됩니다.

- 이미지 유도 스케일: 이미지 유도 스케일링은 비디오 생성에 대한 이미지 신호의 영향을 제어하는 데 사용됩니다.

- 오디오 안내 척도: 오디오 안내 척도로, 비디오 생성에 대한 오디오 신호의 영향을 제어하는 데 사용됩니다.

- 샘플링 단계: 생성된 비디오의 품질과 세부 정보를 제어하는 데 사용되는 샘플링 단계 수입니다.

- 난수 시드: 비디오 생성의 무작위성을 제어하는 데 사용되는 난수 시드입니다.

인용 정보

이 프로젝트에 대한 인용 정보는 다음과 같습니다.

@misc{chen2025humo,

title={HuMo: Human-Centric Video Generation via Collaborative Multi-Modal Conditioning},

author={Liyang Chen and Tianxiang Ma and Jiawei Liu and Bingchuan Li and Zhuowei Chen and Lijie Liu and Xu He and Gen Li and Qian He and Zhiyong Wu},

year={2025},

eprint={2509.08519},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2509.08519},

}