Command Palette

Search for a command to run...

DiffRhythm: 1분 안에 완전한 음악 데모를 생성하세요

DiffRhythm-full의 원클릭 배포

1. 튜토리얼 소개

DiffRhythm은 잠재적 확산 모델을 기반으로 하는 종단 간 음악 생성 도구로, 서북공과대학(ASLP@NPU)의 음성 및 언어 처리 연구실과 홍콩 중국 대학(선전)이 공동으로 개발했습니다. 짧은 시간 안에 보컬과 반주를 포함해 최대 4분 45초 길이의 완전한 노래를 생성할 수 있습니다. 사용자는 가사와 스타일 힌트만 제공하면 DiffRhythm이 가사에 맞는 멜로디와 반주를 자동으로 생성해 다국어 입력을 지원합니다.

DiffRhythm(중국어: 狄韵, Dì Yùn)은 완전한 노래를 작곡할 수 있는 최초의 확산 기반 노래 생성 모델입니다. 이 이름은 "Diff"(확산된 건축 양식에 대한 언급)와 "Rhythm"(음악과 작곡에 중점을 둔다는 의미)을 합친 것입니다. 중국어 이름 디윈(Di Yun)은 "디프리덤(DiffRhythm)"과 발음이 비슷한데, "디(Dì)"는 주의 깊게 듣는다는 뜻으로 청각적 지각을 상징하고 "운(Yun)"은 멜로디적 매력을 뜻하며 음악성을 나타낸다.

2. 작업 단계

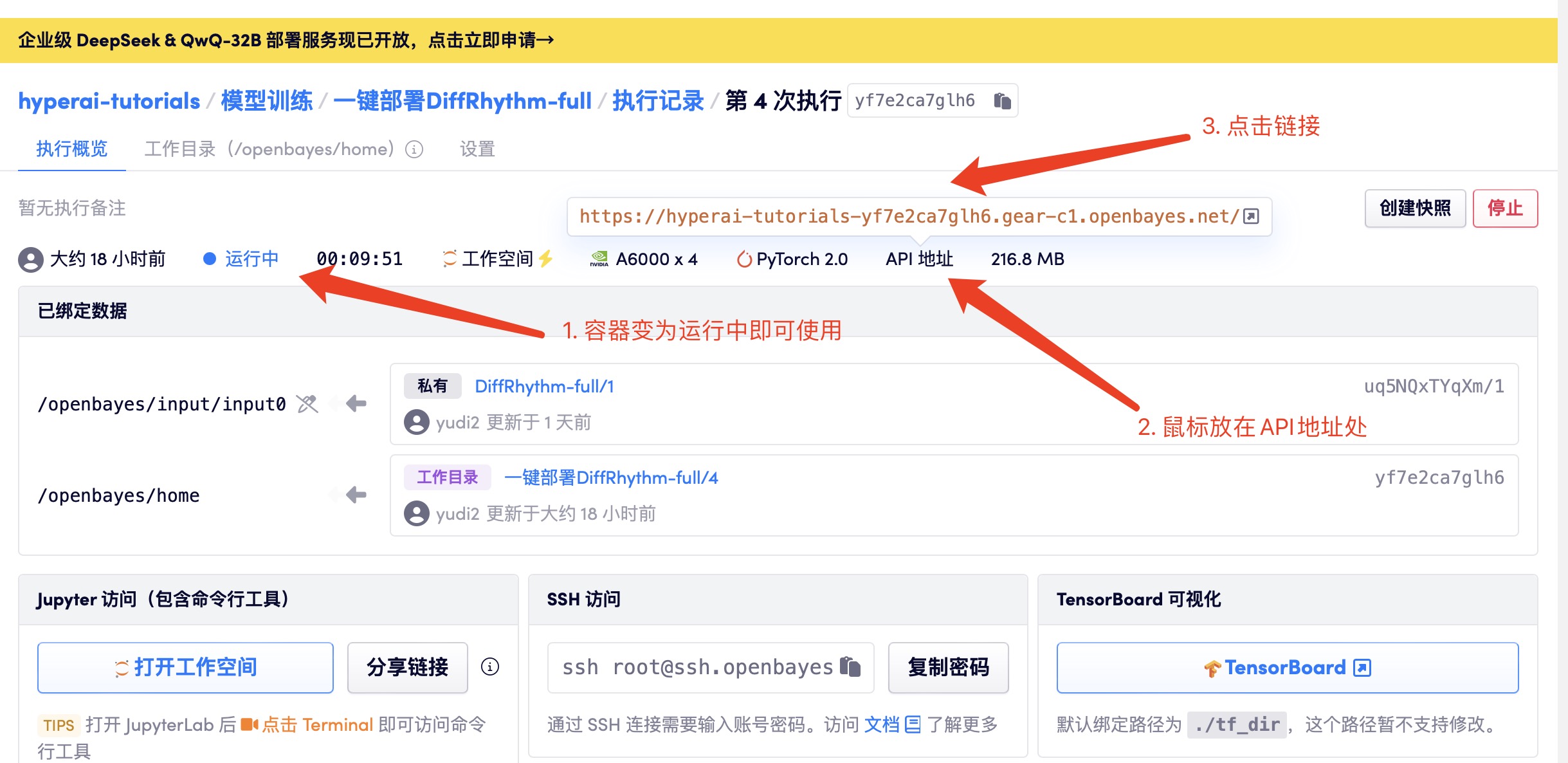

1. 컨테이너를 시작하세요

컨테이너를 시작한 후 API 주소를 클릭하여 웹 인터페이스로 들어갑니다. 모델이 크기 때문에 WebUI 인터페이스를 표시하는 데 약 3분이 소요되며, 그렇지 않으면 "Bad Gateway"가 표시됩니다.

2. 음악 세대

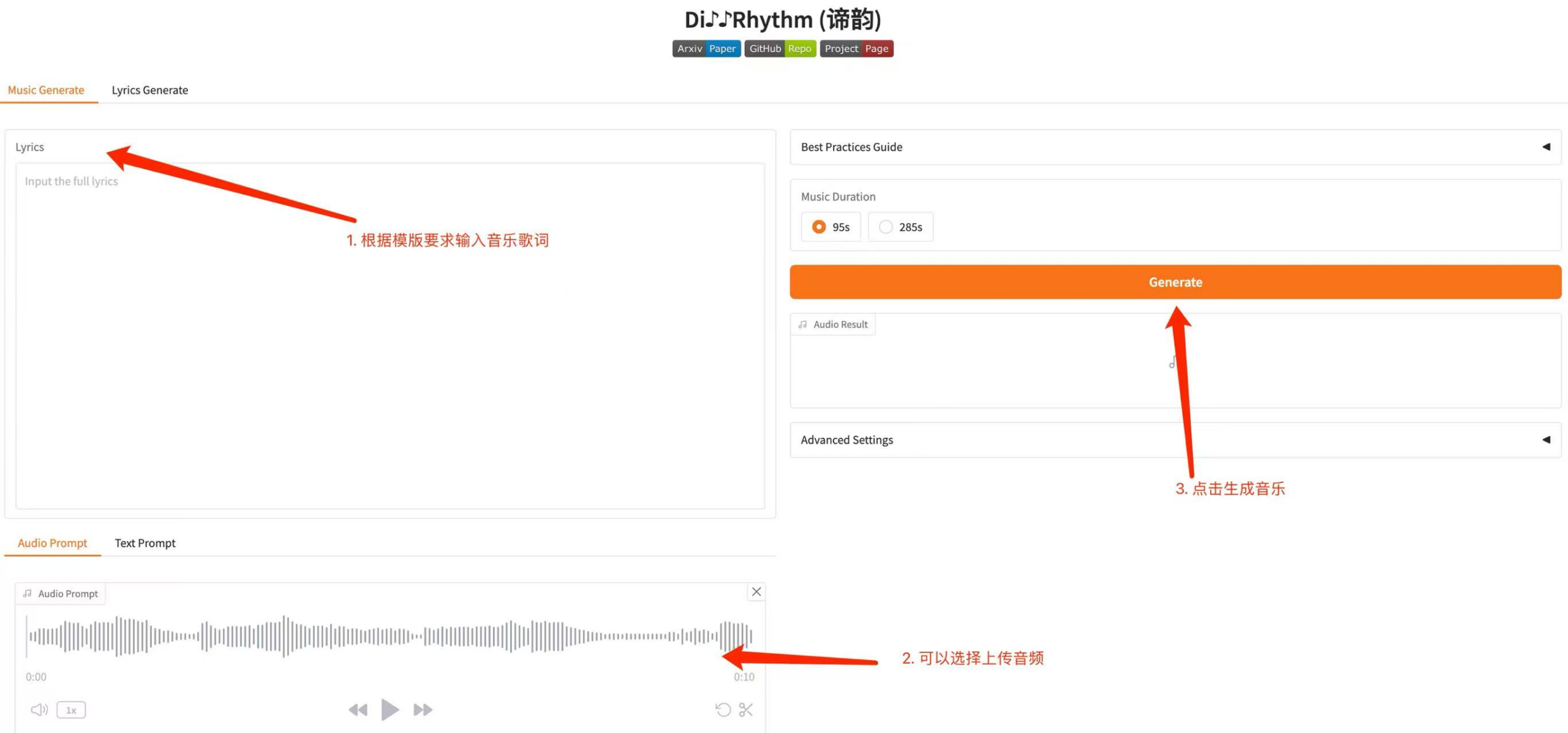

2.1 가사 또는 오디오를 기반으로 음악을 생성하도록 선택하세요

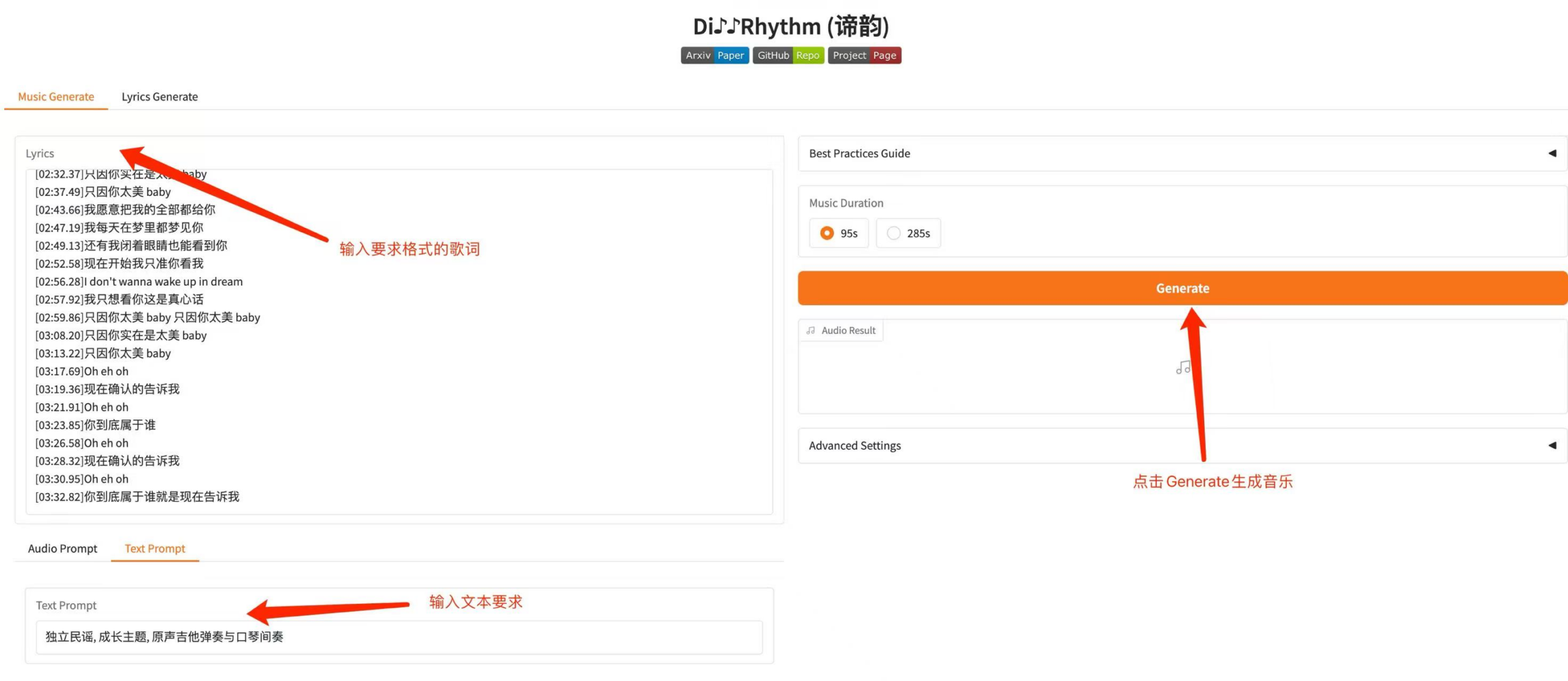

2.2 가사나 텍스트를 기반으로 음악을 생성할 수 있습니다.

3. 토론

🖌️ 고품질 프로젝트를 발견하시면, 백그라운드에 메시지를 남겨 추천해주세요! 또한, 튜토리얼 교환 그룹도 만들었습니다. 친구들의 QR코드 스캔과 [SD 튜토리얼] 댓글을 통해 그룹에 가입하여 다양한 기술 이슈에 대해 논의하고 신청 결과를 공유해 주시기 바랍니다.↓