2달 전

텍스트 피드백을 활용한 시각언어적 주의 학습을 통한 이미지 검색

{ Loris Bazzani, Shaogang Gong, Yanbei Chen}

초록

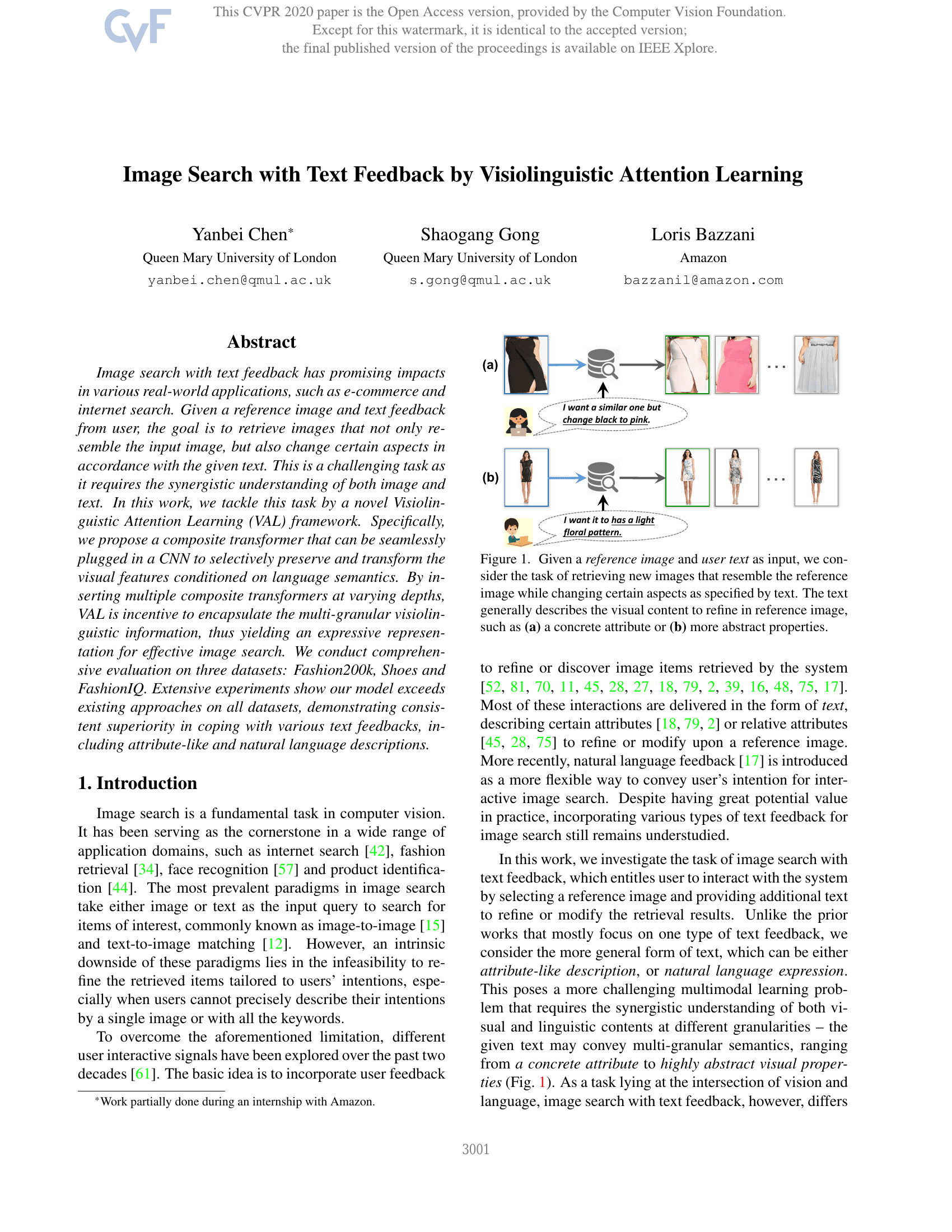

텍스트 피드백을 활용한 이미지 검색은 전자상거래 및 인터넷 검색과 같은 다양한 실용적 응용 분야에서 큰 잠재력을 지니고 있다. 참조 이미지와 사용자로부터 제공된 텍스트 피드백을 바탕으로, 입력 이미지와 유사한 이미지를 검색하는 동시에 주어진 텍스트에 따라 특정 측면을 변화시킨 이미지를 추출하는 것이 목표이다. 이는 이미지와 텍스트의 상호작용을 종합적으로 이해해야 하는 도전적인 과제이다. 본 연구에서는 새로운 비전언어주의 주의 학습(Visiolinguistic Attention Learning, VAL) 프레임워크를 제안하여 이 문제를 해결한다. 구체적으로, 언어 의미에 따라 조건부로 시각적 특징을 선택적으로 보존하고 변환할 수 있는 복합형 트랜스포머(Composite Transformer)를 제안한다. 이 복합형 트랜스포머를 CNN의 다양한 깊이에 다수 삽입함으로써 VAL은 다중 분해능 수준의 비전언어주의 정보를 효과적으로 통합할 수 있으며, 이는 효과적인 이미지 검색을 위한 표현력이 풍부한 특징 표현을 가능하게 한다. 우리는 Fashion200k, Shoes, FashionIQ 세 가지 데이터셋에서 포괄적인 평가를 수행하였으며, 광범위한 실험 결과를 통해 제안한 모델이 모든 데이터셋에서 기존 방법들을 초월함을 확인하였다. 이는 속성 기반 설명과 자연어 설명을 포함한 다양한 유형의 텍스트 피드백에 대해 일관된 우수성을 보여주며, 실제 응용 환경에서의 유연성과 강력한 성능을 입증한다.