Command Palette

Search for a command to run...

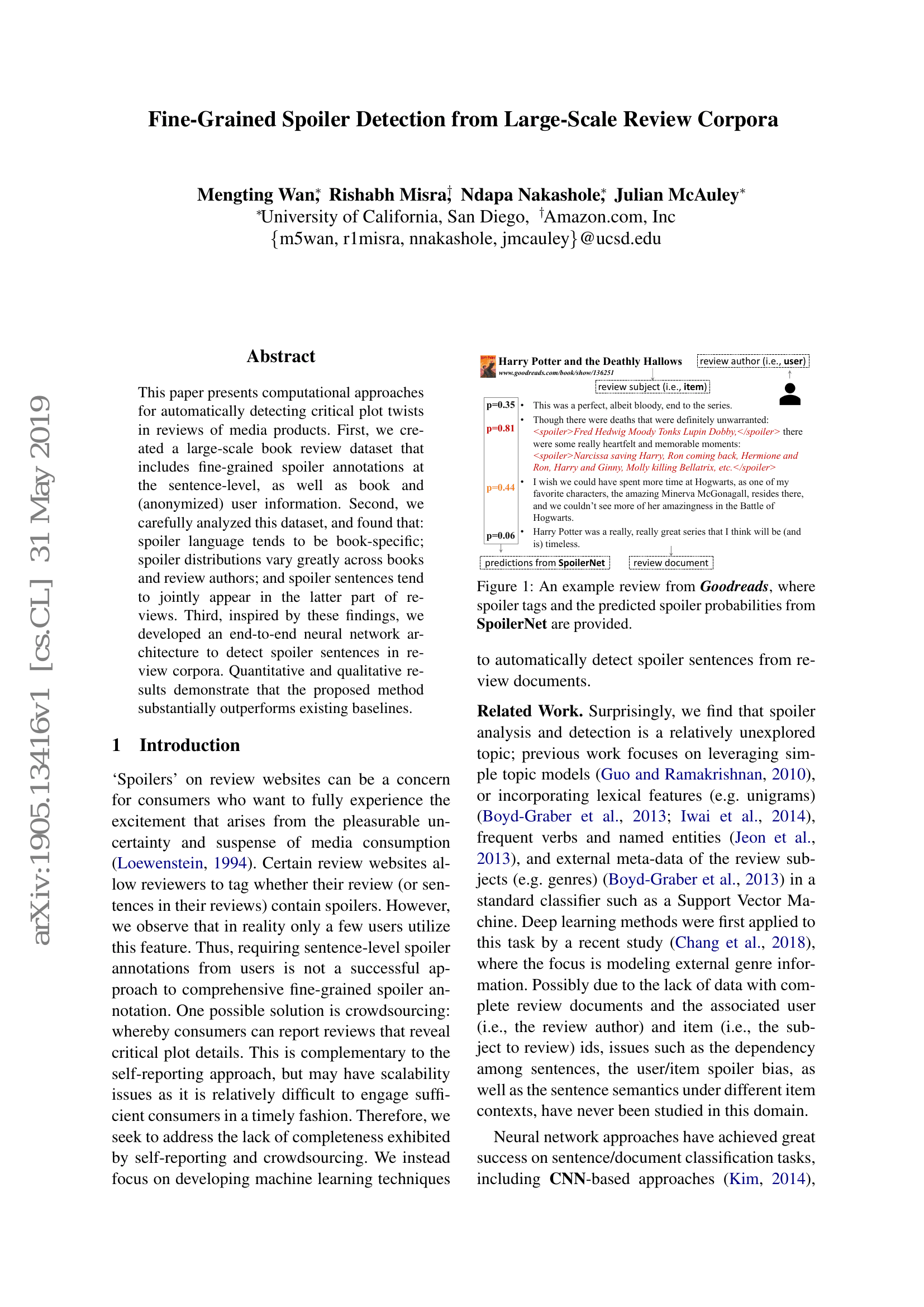

{Wei-Shi Zheng Xintong Han AnCong Wu Tao Wu Peixian Hong}

초록

최근 사람 재식별(Person Re-identification, Re-ID) 기술은 큰 발전을 이루었으나, 기존의 방법들은 대부분 색상적 외관에 크게 의존하고 있어, 사람의 옷이 변경될 경우 신뢰성이 떨어지는 문제가 있다. 옷을 바꾸는 상황에서의 재식별은 보행자의 이미지가 옷의 변화로 인해 클래스 내 변동이 크고 클래스 간 차이가 작기 때문에 매우 도전적인 과제이다. 정체성을 식별하는 데 중요한 특징들은 보행자 간에 미묘한 신체 형태의 차이에 숨겨져 있다. 이러한 신체 형태 정보를 활용하여 옷 변화 상황에서도 효과적인 재식별을 가능하게 하기 위해, 본 연구에서는 미세한 형태-외관 상호학습 프레임워크(Fine-grained Shape-Appearance Mutual learning, FSAM)를 제안한다. FSAM은 형태 스트림과 외관 스트림으로 구성된 이중 스트림 아키텍처로, 형태 스트림에서는 정체성 정보를 기반으로 미세한 구분 가능한 마스크를 학습하고, 자세에 따라 특화된 다중 브랜치 네트워크를 통해 미세한 신체 형태 특징을 추출한다. 이후, 외관 스트림에서 옷에 영향을 받지 않는 형태 지식을 보완하기 위해 저수준과 고수준 특징 간에 밀도 높은 상호학습을 수행함으로써, 형태 스트림의 지식을 외관 스트림으로 전달한다. 이를 통해 외관 스트림은 마스크 추정을 위한 추가적인 계산 없이도 독립적으로 활용 가능하다. 제안한 방법은 기준 데이터셋을 기반으로 한 옷 변화 재식별 평가에서 최신 기술 대비 뛰어난 성능을 달성하였다.

벤치마크

| 벤치마크 | 방법론 | 지표 |

|---|---|---|

| person-re-identification-on-ltcc | FSAM | Rank-1: 38.5 mAP: 16.2 |

| person-re-identification-on-prcc | FSAM | Rank-1: 54.5 |

| person-re-identification-on-vc-clothes | FSAM | Rank-1: 78.6 mAP: 78.9 |