Command Palette

Search for a command to run...

초록

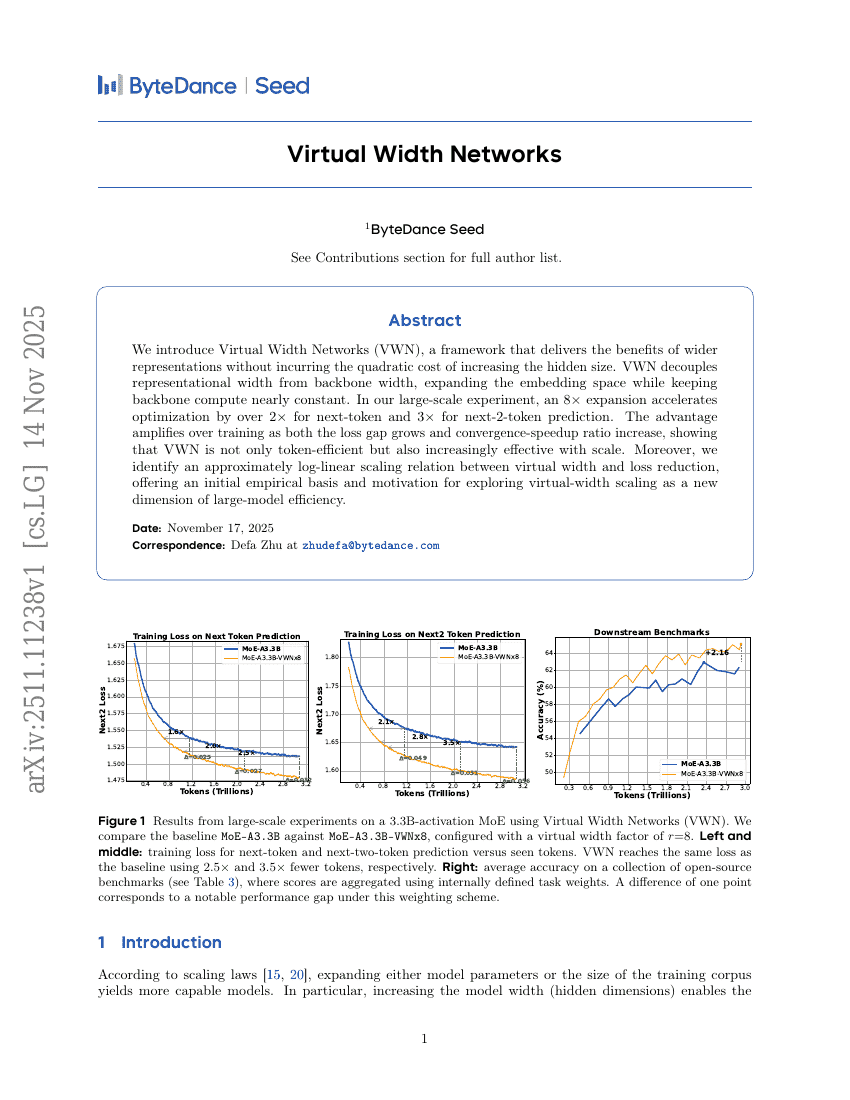

우리는 가상 폭 네트워크(Virtual Width Networks, VWN)를 제안한다. 이 프레임워크는 은닉층 크기를 증가시키는 데 따른 이차적 비용을 수반하지 않으면서도 더 넓은 표현력의 이점을 제공한다. VWN은 표현 폭(representational width)을 백본(백본)의 폭과 분리함으로써, 임베딩 공간을 확장하면서도 백본의 계산량을 거의 일정하게 유지한다. 대규모 실험에서, 가상 폭을 8배로 확장함으로써 다음 토큰 예측의 최적화 속도가 2배 이상, 다음 2개 토큰 예측의 경우 3배 이상 향상되는 효과를 확인하였다. 학습이 진행될수록 손실 갭(loss gap)이 증가하고 수렴 속도 향상 비율이 더욱 커지면서, VWN이 단순히 토큰 효율적인 것뿐만 아니라 규모가 증가할수록 점점 더 효과적인 성능을 발휘함을 보여준다. 또한, 우리는 가상 폭과 손실 감소 사이에 약한 로그선형 스케일링 관계가 존재함을 규명하였으며, 이는 대규모 모델의 효율성에 대한 새로운 차원으로 가상 폭 스케일링을 탐구할 수 있는 초기 경험적 근거와 동기를 제공한다.