Command Palette

Search for a command to run...

초록

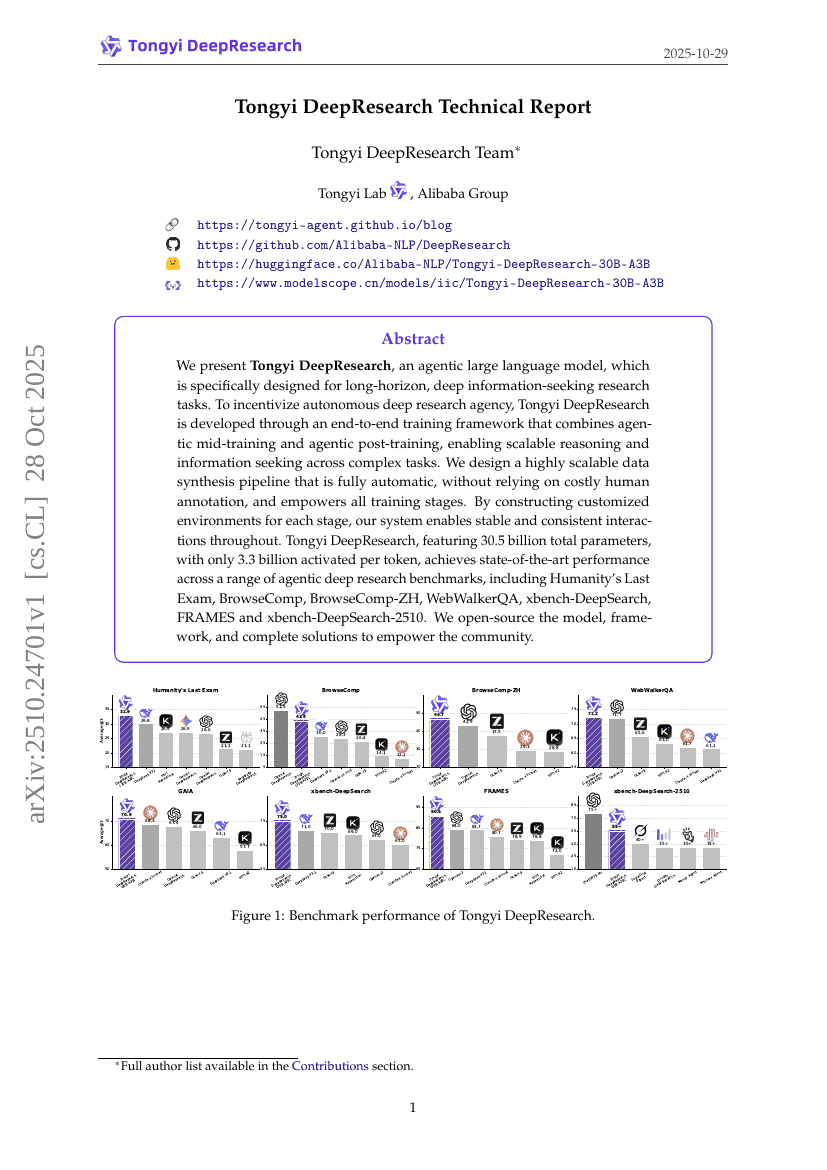

우리는 장기적인 시점에서 깊이 있는 정보 탐색 작업에 특화된 에이전트형 대규모 언어 모델인 '통의 딥리서치(Tongyi DeepResearch)'를 소개합니다. 자율적인 심층 연구 에이전트를 유도하기 위해, 통의 딥리서치는 에이전트 기반 중간 학습(agentic mid-training)과 에이전트 기반 후속 학습(agentic post-training)을 통합한 엔드투엔드 학습 프레임워크를 통해 개발되었으며, 복잡한 작업들에 걸쳐 확장 가능한 추론 및 정보 탐색 능력을 제공합니다. 우리는 고도로 확장 가능한 데이터 합성 파이프라인을 설계하여, 비용이 큰 인간 주석(annotation)에 의존하지 않고 모든 학습 단계를 지원합니다. 각 단계에 맞춰 맞춤형 환경을 구축함으로써, 시스템은 안정적이고 일관된 상호작용을 가능하게 합니다. 총 파라미터 수가 305억 개이며, 토큰당 활성화되는 파라미터는 33억 개에 불과한 통의 딥리서치는 '휴먼리티스 라스트 엑스엠(Humanity's Last Exam)', '브라우즈컴프(BrowseComp)', '브라우즈컴프-ZH(BrowseComp-ZH)', '웹워커QA(WebWalkerQA)', 'xbench-DeepSearch', 'FRAMES', 'xbench-DeepSearch-2510' 등 다양한 에이전트 기반 심층 연구 벤치마크에서 최고 수준의 성능을 달성했습니다. 본 모델, 프레임워크 및 완전한 솔루션을 오픈소스로 공개하여 연구 공동체의 발전을 지원합니다.